softmax回归的简洁实现

我们发现(通过深度学习框架的高级API能够使实现) (softmax) 线性(回归变得更加容易)。 同样,通过深度学习框架的高级API也能更方便地实现softmax回归模型。 本节如在 :numref:sec_softmax_scratch中一样, 继续使用Fashion-MNIST数据集,并保持批量大小为256。

import torch

from torch import nn

from d2l import torch as d2lbatch_size = 256

train_iter, test_iter = d2l.load_data_fashion_mnist(batch_size)初始化模型参数

[softmax回归的输出层是一个全连接层]。 因此,为了实现我们的模型, 我们只需在Sequential中添加一个带有10个输出的全连接层。 同样,在这里Sequential并不是必要的, 但它是实现深度模型的基础。 我们仍然以均值0和标准差0.01随机初始化权重。

# PyTorch不会隐式地调整输入的形状。因此,

# 我们在线性层前定义了展平层(flatten),来调整网络输入的形状

net = nn.Sequential(nn.Flatten(), nn.Linear(784, 10))

def init_weights(m):

if type(m) == nn.Linear:

nn.init.normal_(m.weight, std=0.01)

net.apply(init_weights);重新审视Softmax的实现

我们计算了模型的输出,然后将此输出送入交叉熵损失。 从数学上讲,这是一件完全合理的事情。 然而,从计算角度来看,指数可能会造成数值稳定性问题。

回想一下,softmax函数̂ =exp()∑exp()y^j=exp(oj)∑kexp(ok), 其中̂ y^j是预测的概率分布。 oj是未规范化的预测o的第j个元素。 如果ok中的一些数值非常大, 那么exp()exp(ok)可能大于数据类型容许的最大数字,即上溢(overflow)。 这将使分母或分子变为inf(无穷大), 最后得到的是0、inf或nan(不是数字)的̂ y^j。 在这些情况下,我们无法得到一个明确定义的交叉熵值。

解决这个问题的一个技巧是: 在继续softmax计算之前,先从所有ok中减去max()max(ok)。 你可以看到每个ok按常数进行的移动不会改变softmax的返回值:

̂ =exp(−max())exp(max())∑exp(−max())exp(max())=exp(−max())∑exp(−max()).y^j=exp(oj−max(ok))exp(max(ok))∑kexp(ok−max(ok))exp(max(ok))=exp(oj−max(ok))∑kexp(ok−max(ok)).

在减法和规范化步骤之后,可能有些−max()oj−max(ok)具有较大的负值。 由于精度受限,exp(−max())exp(oj−max(ok))将有接近零的值,即下溢(underflow)。 这些值可能会四舍五入为零,使̂ y^j为零, 并且使得log(̂ )log(y^j)的值为-inf。 反向传播几步后,我们可能会发现自己面对一屏幕可怕的nan结果。

尽管我们要计算指数函数,但我们最终在计算交叉熵损失时会取它们的对数。 通过将softmax和交叉熵结合在一起,可以避免反向传播过程中可能会困扰我们的数值稳定性问题。 如下面的等式所示,我们避免计算exp(−max())exp(oj−max(ok)), 而可以直接使用−max()oj−max(ok),因为log(exp(⋅))log(exp(⋅))被抵消了。

log(̂ )=log(exp(−max())∑exp(−max()))=log(exp(−max()))−log(∑exp(−max()))=−max()−log(∑exp(−max())).log(y^j)=log(exp(oj−max(ok))∑kexp(ok−max(ok)))=log(exp(oj−max(ok)))−log(∑kexp(ok−max(ok)))=oj−max(ok)−log(∑kexp(ok−max(ok))).

我们也希望保留传统的softmax函数,以备我们需要评估通过模型输出的概率。 但是,我们没有将softmax概率传递到损失函数中, 而是[在交叉熵损失函数中传递未规范化的预测,并同时计算softmax及其对数], 这是一种类似"LogSumExp技巧"的聪明方式。

loss = nn.CrossEntropyLoss(reduction='none')优化算法

在这里,我们(使用学习率为0.1的小批量随机梯度下降作为优化算法)。 这与我们在线性回归例子中的相同,这说明了优化器的普适性。

trainer = torch.optim.SGD(net.parameters(), lr=0.1)训练

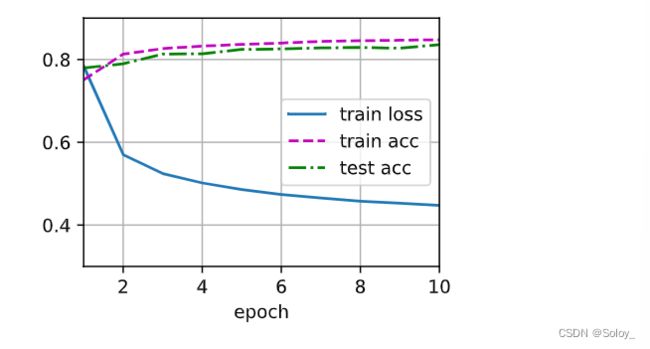

num_epochs = 10

d2l.train_ch3(net, train_iter, test_iter, loss, num_epochs, trainer)

和以前一样,这个算法使结果收敛到一个相当高的精度,而且这次的代码比之前更精简了。

小结

- 使用深度学习框架的高级API,我们可以更简洁地实现softmax回归。

- 从计算的角度来看,实现softmax回归比较复杂。在许多情况下,深度学习框架在这些著名的技巧之外采取了额外的预防措施,来确保数值的稳定性。这使我们避免了在实践中从零开始编写模型时可能遇到的陷阱。