Linux系统多网卡绑定各配置模式详解

Linux系统多网卡绑定各配置模式详解

- 1. 配置多网卡bond

-

- 1.1. mode=0 模式

- 1.2. mode=1 模式

-

- 1.2.1. 关闭NetworkManager服务

- 1.2.2. 网卡配置

- 1.2.3. 配置bond

- 1.2.4. 加载bonding内核模块

- 1.2.5. 配置bonding驱动

- 1.2.6. 查看bond是否生效

- 1.3. mode=2 模式

- 1.4. mode=3 模式

- 1.5. mode=4 模式

- 1.6. mode=5 模式

- 1.7. mode=6模式

- 2. 拆解网卡bond

-

- 2.1 清除bonding驱动

- 2.2. 修改网卡配置信息

- 2.3. 清除bonding内核模块

- 2.4. 修改路由表添加永久路由

- 2.5. 重启服务器

1. 配置多网卡bond

网卡绑定mode共有七种(0~6) bond0、bond1、bond2、bond3、bond4、bond5、bond6

常用的有三种:

● mode=0:平衡负载模式,有自动备援,但需要”Switch”支援及设定。

● mode=1:自动备援模式,其中一条线若断线,其他线路将会自动备援。

● mode=6:平衡负载模式,有自动备援,不必”Switch”支援及设定。

需要说明的是如果想做成mode 0的负载均衡,仅仅设置这里options bond0 miimon=100 mode=0是不够的,与网卡相连的交换机必须做特殊配置(这两个端口应该采取聚合方式),因为做bonding的这两块网卡是使用同一个MAC地址.从原理分析一下:

bond运行在mode 0模式下,mode 0下bond所绑定的网卡的IP都被修改成相同的mac地址,如果这些网卡都被接在同一个交换机,那么交换机的ARP表里这个MAC地址对应的端口就有多 个,那么交换机接受到发往这个MAC地址的包应该往哪个端口转发呢?正常情况下MAC地址是全球唯一的,一个MAC地址对应多个端口肯定使交换机迷惑了。所以 mode0下的bond如果连接到交换机,交换机这几个端口应该采取聚合方式(cisco称为 ethernetchannel,foundry称为portgroup),因为交换机做了聚合后,聚合下的几个端口也被捆绑成一个MAC地址。我们的解决办法是,两个网卡接入不同的交换机即可。

在后面各个模式的网卡流量压测中,使用的是压测工具对网卡打流量,并非实际业务访问后的网卡真实流量,压测中只针对某个bond网卡进行压测,为方便观察只展示压测的bond网卡以及该bond网卡绑定的真实物理网卡

查看bond网卡流量以及该bond网卡绑定的物理网卡流量命令如下:

sar -n DEV 5 3 | grep -v -E "bond0 | lo | enp59s0f0 | enp59s0f1 | enp59s0f2 | enp59s0f3 |平均时间"

1.1. mode=0 模式

(balance-rr) Round-robin policy(平衡抡循环策略)

特点:传输数据包顺序是依次传输(即:第1个包走eth0,下一个包就走eth1….一直循环下去,直到最后一个传输完毕),此模式提供负载平衡和容错能力;但是我们知道如果一个连接或者会话的数据包从不同的接口发出的话,中途再经过不同的链路,在客户端很有可能会出现数据包无序到达的问题,而无序到达的数据包需要重新要求被发送,这样网络的吞吐量就会下降

cat /proc/net/bonding/bond1

Ethernet Channel Bonding Driver: v3.7.1 (April 27, 2011)

Bonding Mode: load balancing (round-robin)

MII Status: up

MII Polling Interval (ms): 100

Up Delay (ms): 0

Down Delay (ms): 0

Slave Interface: enp60s0f0

MII Status: up

Speed: 10000 Mbps

Duplex: full

Link Failure Count: 0

Permanent HW addr: b4:05:5d:64:f3:23

Slave queue ID: 0

Slave Interface: enp60s0f1

MII Status: up

Speed: 10000 Mbps

Duplex: full

Link Failure Count: 0

Permanent HW addr: b4:05:5d:64:f3:24

Slave queue ID: 0

对该模式下网卡进行压测,查看每块单独网卡流量的分布:

1.2. mode=1 模式

(active-backup) Active-backup policy(主-备份策略)

特点:只有一个设备处于活动状态,当一个宕掉另一个马上由备份转换为主设备。mac地址是外部可见得,从外面看来,bond的MAC地址是唯一的,以避免switch(交换机)发生混乱。此模式只提供了容错能力;由此可见此算法的优点是可以提供高网络连接的可用性,但是它的资源利用率较低,只有一个接口处于工作状态,在有 N 个网络接口的情况下,资源利用率为1/N

1.2.1. 关闭NetworkManager服务

systemctl stop NetworkManager.service

systemctl disable NetworkManager.service

1.2.2. 网卡配置

cp /etc/sysconfig/network-scripts/{ifcfg-enp59s0f0,ifcfg-enp59s0f1,ifcfg-enp59s0f2,ifcfg-enp59s0f3,ifcfg-enp60s0f0,ifcfg-enp60s0f1} /root

- enp59s0f2网卡

cat /etc/sysconfig/network-scripts/ifcfg-enp59s0f2

TYPE=Ethernet

DEVICE=enp59s0f2

ONBOOT=yes

BOOTPROTO=none

USERCTL=no

MASTER=bond0

SLAVE=yes

- enp59s0f3网卡

cat /etc/sysconfig/network-scripts/ifcfg-enp59s0f3

TYPE=Ethernet

DEVICE=enp59s0f3

ONBOOT=yes

BOOTPROTO=none

USERCTL=no

MASTER=bond0

SLAVE=yes

- enp60s0f0网卡

cat /etc/sysconfig/network-scripts/ifcfg-enp60s0f0

TYPE=Ethernet

DEVICE=enp60s0f0

ONBOOT=yes

BOOTPROTO=none

USERCTL=no

MASTER=bond1

SLAVE=yes

- enp60s0f1网卡

cat /etc/sysconfig/network-scripts/ifcfg-enp60s0f1

TYPE=Ethernet

DEVICE=enp60s0f1

ONBOOT=yes

BOOTPROTO=none

USERCTL=no

MASTER=bond1

SLAVE=yes

1.2.3. 配置bond

cat /etc/sysconfig/network-scripts/ifcfg-bond0

TYPE=Bond

BOOTPROTO=none

ONBOOT=yes

USERCTL=no

DEVICE=bond0

IPADDR=111.xxx.xxx.107

PREFIX=24

BONDING_OPTS="mode=1 miimon=100 primary=enp59s0f2" # 该项也可以写在/etc/modprobe.d/bond.conf文件中

NM_CONTROLLED=no

BONDING_MASTER=yes

cat /etc/sysconfig/network-scripts/ifcfg-bond1

TYPE=Bond

BOOTPROTO=none

ONBOOT=yes

USERCTL=no

DEVICE=bond1

IPADDR=172.xxx.xxx.97

PREFIX=24

GATEWAY=172.xxx.xxx.1

BONDING_OPTS="mode=1 miimon=100 primary=enp60s0f0"

NM_CONTROLLED=no

BONDING_MASTER=yes

# miimon是用来进行链路监测的:miimon=100表示系统每100ms监测一次链路连接状态,如果有一条线路不通就转入另一条线路。

# mode=1表示属于主备模式。

1.2.4. 加载bonding内核模块

modprobe bonding #centos7默认是没有加载的

查看是否加载了bonding内核模块:

modinfo bonding

filename: /lib/modules/3.10.0-957.el7.x86_64/kernel/drivers/net/bonding/bonding.ko.xz

lsmod | grep bonding

bonding 152656 0

重启系统就会消失,需要配置自动加载(有时重启也没有发生丢失,最好配置上)

# 配置系统启动时加载bonding模块

vim /etc/sysconfig/modules/bonding.modules

#!/bin/sh

/sbin/modinfo -F filename bonding > /dev/null 2>&1

if [ $? -eq 0 ];then

/sbin/modprobe bonding

fi

# 设置执行权限

chmod 755 /etc/sysconfig/modules/bonding.modules

1.2.5. 配置bonding驱动

注意现在是设置多个bond口, em1和em2组成bond0,em3和em4组成bond1

那么该配置文件/etc/modprobe.d/bonding.conf的设定就不能像下面这样简单的叠加了:

alias bond0 bonding

options bonding mode=1 miimon=100

alias bond1 bonding

options bonding mode=1 miimon=100

- 第一种方式:

vim /etc/modprobe.d/bond.conf

alias bond0 binding

alias bond1 binding

# options bonding mode=1 miimon=100 这个配置写在各自的bond网卡中,也就是本例中的配置,这也是最有效的方式,其余三种方式可能会有问题

- 第二种方式

cat /etc/modprobe.d/bond0.conf

alias bond0 bonding

options bond0 miimon=100 mode=1

cat /etc/modprobe.d/bond1.conf

alias bond1 bonding

options bond1 miimon=100 mode=1

- 第三种方式

alias bond0 bonding

alias bond1 bonding

options bonding max_bonds=2 miimon=100 mode=1

# 这种方式多个bond口的模式就只能设成相同的了

- 第四种方式

alias bond0 bonding

options bond0 miimon=100 mode=1

install bond1 /sbin/modprobe bonding -o bond1 miimon=100 mode=1

options里的一些参数的含义:

miimon:监视网络链接的频度,单位是毫秒,我们设置的是100毫秒

max_bonds:配置的bond口个数

mode bond:bond的模式

systemctl restart network

1.2.6. 查看bond是否生效

cat /proc/net/bonding/bond0

cat /proc/net/bonding/bond1

Ethernet Channel Bonding Driver: v3.7.1 (April 27, 2011)

Bonding Mode: fault-tolerance (active-backup) # 主备模式,当然设置mode=0也是主备模式

Primary Slave: enp60s0f0 (primary_reselect always)

Currently Active Slave: enp60s0f0 # 现在Active状态的网卡是enp60s0f0

MII Status: up

MII Polling Interval (ms): 100

Up Delay (ms): 0

Down Delay (ms): 0

Slave Interface: enp60s0f0

MII Status: up

Speed: 10000 Mbps

Duplex: full

Link Failure Count: 0

Permanent HW addr: b4:05:5d:64:f3:23

Slave queue ID: 0

Slave Interface: enp60s0f1

MII Status: up

Speed: 10000 Mbps

Duplex: full

Link Failure Count: 0

Permanent HW addr: b4:05:5d:64:f3:24

Slave queue ID: 0

# 如果是mode=0模式,bond网卡、em2的物理地址会和active网卡的物理地址相同,这样是为了避免上位交换机发生混乱

确认网络是网卡的速度:

ethtool bond1

Settings for bond1:

Supported ports: [ ]

Supported link modes: Not reported

Supported pause frame use: No

Supports auto-negotiation: No

Supported FEC modes: Not reported

Advertised link modes: Not reported

Advertised pause frame use: No

Advertised auto-negotiation: No

Advertised FEC modes: Not reported

Speed: 10000Mb/s

Duplex: Full

Port: Other

PHYAD: 0

Transceiver: internal

Auto-negotiation: off

Link detected: yes

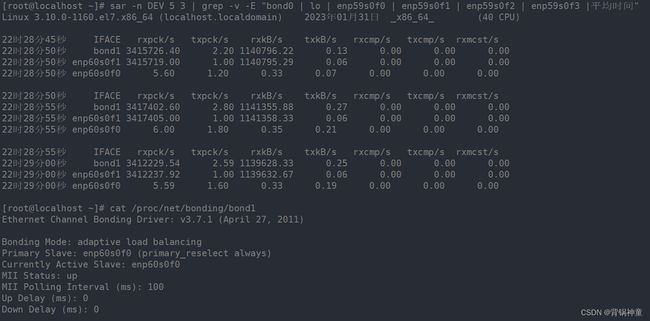

查询网卡流量是否与配置的mode模式相符:

yum install sysstat

sar -n DEV 1 2 # 每一秒钟取1次值,取2次

# mode1模式每个bond网卡应该只有一块实际网卡有流量

测试:down掉一块网卡试试

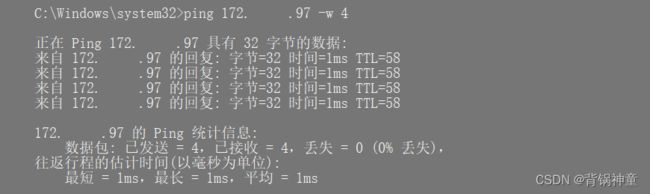

首先一直ping bond1的网卡IP地址(172.xxx.xxx.97),模拟down掉一块网卡,看是否有丢包

ifdown enp60s0f0

cat /proc/net/bonding/bond1

Ethernet Channel Bonding Driver: v3.7.1 (April 27, 2011)

Bonding Mode: fault-tolerance (active-backup)

Primary Slave: None

Currently Active Slave: enp60s0f1

MII Status: up

MII Polling Interval (ms): 100

Up Delay (ms): 0

Down Delay (ms): 0

Slave Interface: enp60s0f1

MII Status: up

Speed: 10000 Mbps

Duplex: full

Link Failure Count: 0

Permanent HW addr: b4:05:5d:64:f3:24

Slave queue ID: 0

可以看到数据包并没有丢包:

一直进行网卡流量压测,压测过程中down掉主网卡,可以看到最开始流量在主网卡,当主网卡down掉之后,流量切换到另外一块网卡中

再开启enp60s0f0后,Currently Active Slave的网卡还会是enp60s0f1,而不会再变为原来的主网卡enp60s0f0

对该模式下网卡进行压测,查看每块单独网卡流量的分布:

1.3. mode=2 模式

(balance-xor) XOR policy(平衡策略)

特点:基于指定的传输HASH策略传输数据包。缺省的策略是:(源MAC地址 XOR 目标MAC地址) % slave数量。其他的传输策略可以通过xmit_hash_policy选项指定,此模式提供负载平衡和容错能力

对该模式下网卡进行压测,查看每块单独网卡流量的分布:

1.4. mode=3 模式

broadcast(广播策略)

特点:在每个slave接口上传输每个数据包,此模式提供了容错能力

1.5. mode=4 模式

(802.3ad) IEEE 802.3ad Dynamic link aggregation(IEEE 802.3ad 动态链接聚合)

特点:创建一个聚合组,它们共享同样的速率和双工设定。根据802.3ad规范将多个slave工作在同一个激活的聚合体下。外出流量的slave选举是基于传输hash策略,该策略可以通过xmit_hash_policy选项从缺省的XOR策略改变到其他策略。需要注意的 是,并不是所有的传输策略都是802.3ad适应的,尤其考虑到在802.3ad标准43.2.4章节提及的包乱序问题。不同的实现可能会有不同的适应性。

必要条件:

● 条件1:ethtool支持获取每个slave的速率和双工设定

● 条件2:switch(交换机)支持IEEE 802.3ad Dynamic link aggregation

● 条件3:大多数switch(交换机)需要经过特定配置才能支持802.3ad模式

1.6. mode=5 模式

(balance-tlb) Adaptive transmit load balancing(适配器传输负载均衡)

特点:不需要任何特别的switch(交换机)支持的通道bonding。在每个slave上根据当前的负载(根据速度计算)分配外出流量。如果正在接受数据的slave出故障了,另一个slave接管失败的slave的MAC地址。

该模式的必要条件:ethtool支持获取每个slave的速率

对该模式下网卡进行压测,查看每块单独网卡流量的分布:

1.7. mode=6模式

(balance-alb) Adaptive load balancing(适配器适应性负载均衡)

特点:该模式包含了balance-tlb模式,同时加上针对IPV4流量的接收负载均衡(receive load balance, rlb),而且不需要任何switch(交换机)的支持。接收负载均衡是通过ARP协商实现的。bonding驱动截获本机发送的ARP应答,并把源硬件地址改写为bond中某个slave的唯一硬件地址,从而使得不同的对端使用不同的硬件地址进行通信。

来自服务器端的接收流量也会被均衡。当本机发送ARP请求时,bonding驱动把对端的IP信息从ARP包中复制并保存下来。当ARP应答从对端到达 时,bonding驱动把它的硬件地址提取出来,并发起一个ARP应答给bond中的某个slave。使用ARP协商进行负载均衡的一个问题是:每次广播 ARP请求时都会使用bond的硬件地址,因此对端学习到这个硬件地址后,接收流量将会全部流向当前的slave。这个问题可以通过给所有的对端发送更新 (ARP应答)来解决,应答中包含他们独一无二的硬件地址,从而导致流量重新分布。当新的slave加入到bond中时,或者某个未激活的slave重新 激活时,接收流量也要重新分布。接收的负载被顺序地分布(round robin)在bond中最高速的slave上

当某个链路被重新接上,或者一个新的slave加入到bond中,接收流量在所有当前激活的slave中全部重新分配,通过使用指定的MAC地址给每个 client发起ARP应答。下面介绍的updelay参数必须被设置为某个大于等于switch(交换机)转发延时的值,从而保证发往对端的ARP应答 不会被switch(交换机)阻截。

必要条件:

● 条件1:ethtool支持获取每个slave的速率;

● 条件2:底层驱动支持设置某个设备的硬件地址,从而使得总是有个slave(curr_active_slave)使用bond的硬件地址,同时保证每个bond 中的slave都有一个唯一的硬件地址。如果curr_active_slave出故障,它的硬件地址将会被新选出来的 curr_active_slave接管

对该模式下网卡进行压测,查看每块单独网卡流量的分布:

其实mod=6与mod=0的区别:mod=6,先把eth0流量占满,再占eth1,….ethX;而mod=0的话,会发现2个口的流量都很稳定,基本一样的带宽。而mod=6,会发现第一个口流量很高,第2个口只占了小部分流量

2. 拆解网卡bond

2.1 清除bonding驱动

vim /etc/modprobe.d/bond.conf

# alias bond0 binding

# alias bond1 binding

vim /etc/sysconfig/network-scripts/ifcfg-bond0

# BONDING_OPTS="mode=0 miimon=100"

vim /etc/sysconfig/network-scripts/ifcfg-bond1

#BONDING_OPTS="mode=0 miimon=100"

2.2. 修改网卡配置信息

将bond信息全部清除

cd /etc/sysconfig/network-scripts/

cat ifcfg-em1

TYPE=Ethernet

UUID=3729aebe-3c7b-4452-a0f4-c3c402d37c1c

DEVICE=em1

ONBOOT=yes

BOOTPROTO=none

USERCTL=no

cat ifcfg-em2

TYPE=Ethernet

UUID=44954b27-3fd3-4252-8955-13590960a8ax

DEVICE=em2

ONBOOT=yes

BOOTPROTO=none

USERCTL=no

cat ifcfg-em3

TYPE=Ethernet

UUID=d7c3a4ca-067c-4eaf-900e-eef87b94cc4x

DEVICE=em3

ONBOOT=yes

BOOTPROTO=none

USERCTL=no

IPADDR=172.xxx.xxx.97

PREFIX=24

GATEWAY=172.xxx.xxx.1

cat ifcfg-em4

TYPE=Ethernet

UUID=f6f9996e-97bb-4e5f-8fbf-2f314986662x

DEVICE=em4

ONBOOT=yes

BOOTPROTO=none

USERCTL=no

rm -rf ifcfg-bond0

rm -rf ifcfg-bond1

2.3. 清除bonding内核模块

lsmod | grep bonding

bonding 152979 0 # 查看到还是存在模块信息的,需要清除

rmmod bonding # 这步一定放在最后,重启服务器之前,否则如果是远程连接的服务器将连接失效

2.4. 修改路由表添加永久路由

vim /etc/sysconfig/network-scripts/route-em3

172.xxx.xxx.9/32 via 172.xxx.xxx.1 dev em3

172.xxx.xxx.109/32 via 172.xxx.xxx.1 dev em3

2.5. 重启服务器

reboot

以上纯属个人的理解,如有不同见解,评论区大家可以一起讨论哈~