【TGRS 2023】RingMo-Sense: Remote Sensing Foundation Model for Spatiotemporal Prediction via Spatiotem

RingMo-Sense: Remote Sensing Foundation Model for Spatiotemporal Prediction via Spatiotemporal Evolution Disentangling, IEEE TGRS 2023

论文:https://ieeexplore.ieee.org/abstract/document/10254320

代码:暂未找到

摘要

遥感时空预测旨在从视频和时间序列图像等历史时空数据中推断未来趋势,在许多领域具有广泛的应用前景。基础模型由于其强大的特征提取能力,是时空信息挖掘的一个很有前途的研究方向,在自然场景中取得了快速的进展。然而,由于遥感数据的空间多尺度和时间多尺度特性,这些方法在应用于遥感时仍然会遇到瓶颈。

因此,论文提出了一种基于时空演化去模糊的时空预测遥感基础模型,简称RingMo-Sense。考虑到空间亲和性、时间连续性和时空相互作用,论文构建了空间、时间和时空三分支预测网络。具体而言,使用参数共享和渐进式联合训练策略来实现稳定的长期预测。

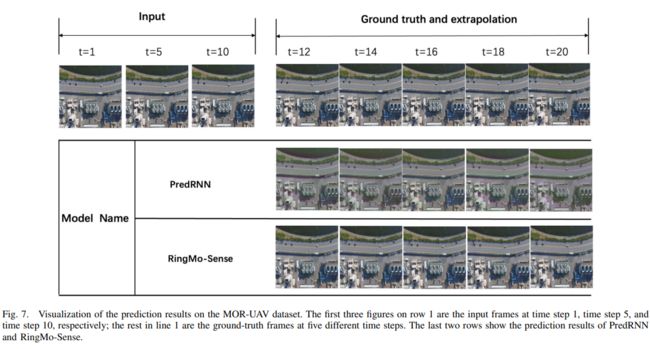

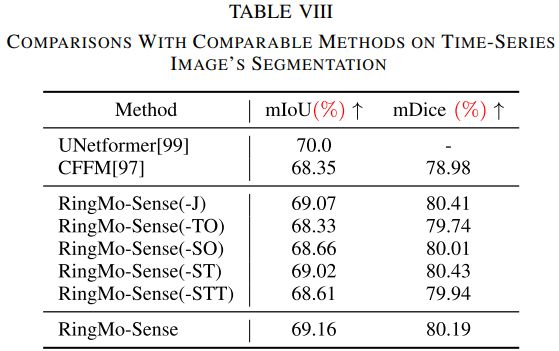

此外,论文通过收集各种RS视频和时间序列图像来构建RS时空数据集。在六个下游时空任务上的实验结果表明,所提出的模型具有竞争力。

引言

背景

时空预测是指挖掘历史数据以了解固有的变化模式,从而推断未知的趋势和状态。人类有能力通过后天学习总结数据模式来做出未来预测,模型也可以通过从大量数据中学习来获得这种能力。在遥感(RS)领域,预测模型可以为各种应用任务做出贡献,如天气预测、轨迹预测和场景预测。

为了训练具有良好性能的时空预测模型,需要大量的时空数据,而RS技术的进步导致了满足这一要求的RS数据的激增。一些研究人员已经使用这些数据构建了时空数据集,例如使用卫星数据的中尺度涡旋跟踪和使用航空数据的场景分割。基于这些数据,一些工作探索了时空预测的启发式模型。然而,这些模型是特定于任务的。RS的时空预测任务很多;设计和训练许多特定于任务的模型会消耗大量的资源。因此,有必要设计一个通用的时空预测模型,以满足RS领域对广泛预测任务的一般需求。

在计算机视觉领域,BERT风格的预训练方法已被证明可以获得一般特征,并在许多图像任务中表现出出色的性能。现在,有一些工作将BERT风格的训练方法迁移到视频识别的基础模型中,并在下游预测任务上取得了很大的效果。BEVT使用两分支网络来解耦模型对数据的空间和时间信息的学习,并在图像分类任务上取得了良好的效果。MaskViT使用两种窗口注意力机制,并在训练策略中用可变掩码比代替常见的固定掩码比,从而在视频预测任务上获得优异的性能。

动机

现有的基础模型具有很大的参考价值,但不能直接用于RS中的任务,因为它们是用很少的对象、简单的背景自然场景视频进行训练的。考虑到RS和自然场景数据之间的巨大差异,这些模型在通过微调应用于RS预测任务时需要更好地工作。这些差异如图1所示

- 时间多尺度:RS数据包括视频和时间序列图像,其中时间序列图像数据占大多数。时间序列图像在时间上是离散的,而计算机视觉中现有的基础模型只能处理连续视频,这是帧在时间维度上的等距分布。

- 空间多尺度:遥感数据有非常复杂的背景,不同物体的大小差异很大。在具有干净背景和中心对象的数据上训练的计算机视觉基础模型在应用于RS数据时会影响性能。

另一挑战是,现有的预测工作并没有同时明确地对RS预测的三个特征进行建模(见图2)。

另一挑战是,现有的预测工作并没有同时明确地对RS预测的三个特征进行建模(见图2)。

- 时间连续性:RS对象在离散数据中的位置随时间连续变化。

- 空间亲和性:在大规模RS数据中,对象相距遥远,但在类别中相互关联。

- 时空交互:多个RS目标之间的交互是动态演变的。

为缓解上述问题,论文遵循“时空进化解纠缠”的核心思想,设计了时空预测的RS基础模型。为应对RS数据在时间和空间上的多尺度特征,基础模型需要具有时间连续性和空间亲和性。此外,基础模型需要正确学习多个RS对象之间动态交互的时空演化过程,以实现长期稳定的预测。因此,本文提出了一种通过时空演化解纠缠进行时空预测的遥感基础模型(RingMo Sense)。

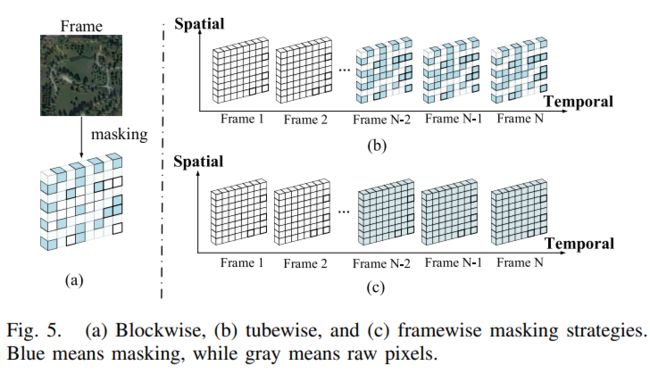

基于多尺度时空RS数据,论文分别通过构建与块blockwise、立体cubewise和帧framewise掩蔽方法相对应的空间、时间和时空三分支预测网络来学习空间亲和性、时间连续性和时空相互作用。在此基础上,采用渐进式训练策略,实现三个分支的联合训练以共享参数,实现对大面积复杂场景中RS数据的稳定预测。

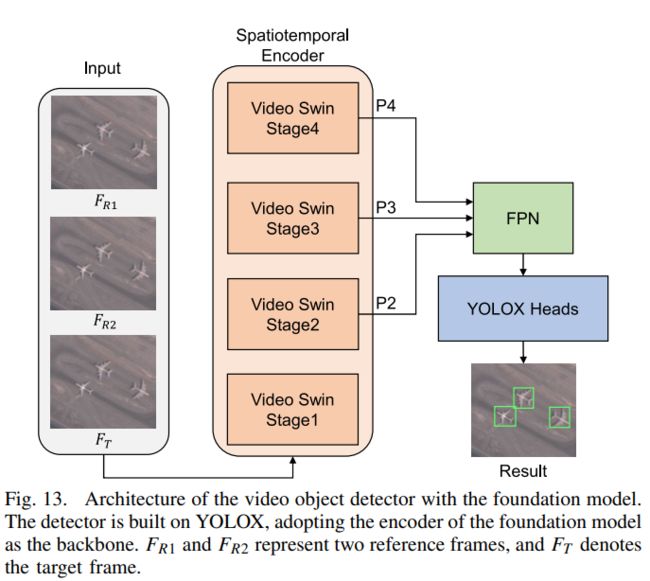

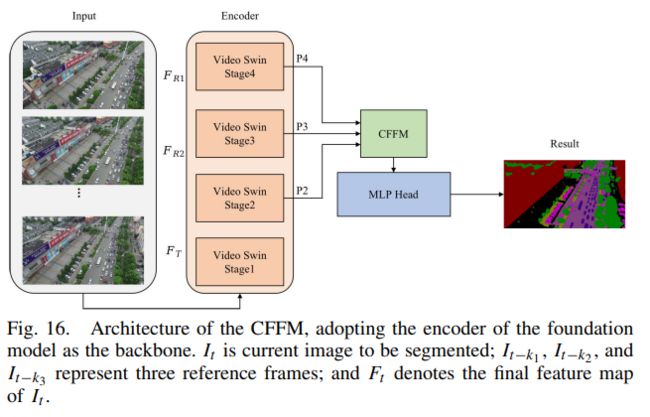

为了支持RS预测基础模型的训练,论文通过收集多个RS视频数据和时间序列数据来构建RS时空数据集。并将它们用于基础模型的预训练,然后将预训练的模型与下游数据集进行微调,以获得特定任务的模型。通过测试多个时空预测任务(云预测、雷达回波外推和RS视频预测)和时空感知任务(多目标跟踪、视频检测和时间序列图像分割),该时空预测基础模型取得了有竞争力的性能。

贡献

- 提出了第一个RS预测基础模型(RingMo Sense),该模型在大规模RS时空数据上进行预训练,以获得一般的预测特征,并提高多个下游RS时空任务的性能。

- 为了解决遥感数据在空间和时间维度上的多尺度问题,创新性地提出了三个分支网络,分别对空间亲和性、时间连续性和时空相互作用进行建模。此外,设计了一种两阶段渐进式联合训练范式,以减少参数,同时提高泛化性能。

- 在没有任何人工监督的情况下,构建了一个RS时空数据集。在收集的数据集上推导出预测基础模型后,论文在六个典型的RS任务上对其进行了微调。实验表明,本文方法在六个下游数据集上取得了令人满意的结果。

方法RingMo-Sense

时空预测任务的基础模型(RingMo-Sense),该模型是专门为RS领域设计的,其架构如图所示。为了获得RS时空数据的建模能力,降低训练难度,该模型采用多分支网络结构和渐进训练策略。该模型在自监督训练方法中进行预训练,用于在海量RS数据上进行多任务重建。

Preliminary

假设构建了一个大型未标记的RS数据集D=(x1,x2,…,xn),其中xi表示输入样本,例如RS视频剪辑。预训练的目标是以无监督的方式学习编码器模型fθ,其中θ表示编码器的参数,使模型能够对输入样本进行编码并生成有意义的表示。

具体地,首先对minibatch的输入样本[input]进行预处理和预编码。在被随机屏蔽之后,获得![]() 并将其发送到编码器

并将其发送到编码器![]() 。然后,对表达特征

。然后,对表达特征![]() 进行解码,并产生预测结果

进行解码,并产生预测结果![]() 以与输入样本进行比较。预训练的目标是最小化标签T(标签)和输出

以与输入样本进行比较。预训练的目标是最小化标签T(标签)和输出![]() 之间的间隙。在这里,利用标记器T(·)来压缩地面实况,提高训练效率。通过监督方法对特定的RS数据集进行微调后,可以实现下游任务的要求。

之间的间隙。在这里,利用标记器T(·)来压缩地面实况,提高训练效率。通过监督方法对特定的RS数据集进行微调后,可以实现下游任务的要求。

RingMo-Sense

模型设计为三分支结构,并通过不同的掩蔽策略实现三个解纠缠的训练分支(即空间分支、时间分支和空间-时间分支),以便不同的分支学习不同的建模能力。此外,将权重共享策略应用于三个分支的权重参数,以减少模型中的参数数量。

首先介绍了RingMo Sense的核心架构,然后提供了支持该架构的细节,包括补丁的生成、掩蔽策略、权重共享策略和目标函数.

纠缠学习架构

模型有三个分支,所有分支的基础模型都基于Video Swin Transformer。每个分支的细节如图所示。其中,对于空间分支,T等于1,但对于其他两个分支,T大于1。

编码器由空间分支、时间分支和时空分支组成。空间分支致力于学习图像中对象之间的空间相对位置关系,并解决空间多尺度问题。时间分支对时间序列RS图像或视频中对象位置的连续变化过程进行建模,以解决时间多尺度问题。此外,时空分支被设计用于对多个目标之间的动态交互进行建模,并提高长期稳定预测的性能。

解码器由以下三个部分组成:一个用于从第4阶段在空间上对特征进行上采样的转置卷积层,一个用于融合从第3阶段和最后一个上采样阶段导出的级联特征的线性层,以及另一个用于在时间上对特征进行上采样的转置卷积层。

对于输入图像或视频数据,在实现不同的线性层和掩蔽策略后,可以使用video Swin Transformer编码器获得具有降低的空间分辨率和扩展的通道数量的信息特征。然后,将特征馈送到不同的上采样层,然后是共享的轻量解码器,以计算最终的交叉熵损失。公式化为

其中,Input_s、Input_t和Input_st分别表示空间编码器、时间编码器和时空编码器的输入,并且在通过2-D或3-D卷积的编码处理之后,获得特征f_s、f_t和f_st。模型的最终输出是通过向上述特征添加线性层来获得的,其中*表示s、t或st。

补丁的生成

对于空间分支,在训练过程中,将输入图像![]() 转换为多个4×4×C补丁,然后乘以掩码,并随机初始化掩码位置的像素值。对于时间和时空分支,将输入视频的帧设置为T,然后将

转换为多个4×4×C补丁,然后乘以掩码,并随机初始化掩码位置的像素值。对于时间和时空分支,将输入视频的帧设置为T,然后将![]() 转换为2×4×4×C的三维块。实验中,为了与视频格式一致并同时训练,将时间序列的RS图像拼接到视频中,作为时间分支和时空分支的输入。

转换为2×4×4×C的三维块。实验中,为了与视频格式一致并同时训练,将时间序列的RS图像拼接到视频中,作为时间分支和时空分支的输入。

掩蔽策略

如图5所示,为了让特定的分支获得指定的建模能力,并帮助模型学习不同的表示,论文设计了三种掩蔽策略,并在不同的分支中使用它们。

- 对于空间分支,利用block掩蔽策略来帮助关注空间特征;给定掩模比例的范围,掩模的位置和纵横比在一定范围内随机选择。

- 对于时间分支,使用逐tube掩蔽策略来帮助捕获时间信息,该时间信息是从时间维度上的逐块掩蔽策略直接扩展而来的,即,在一定范围内随机确定时间维度上逐tube掩蔽的起始位置和长度,然后,对所有确定的视频帧执行根据分块掩蔽策略生成的掩蔽。注意,时间分支中的单帧掩码和空间分支中的掩码是在相同的策略下生成的,但由于某些设置的随机性,它们可能不同。

- 对于时空分支,逐frame掩蔽策略用于帮助理解时空动态交互,其中掩模的时间起始位置是在输入切片的特定范围内随机确定的,并且掩模的长度是恒定的;从起始位置开始,掩码长度内的帧的所有像素都被掩码。

三个分支的不同掩码策略允许模型同时获得不同的建模能力,即空间、时间和时空建模能力。

权重共享策略

Transformer中的主要结构,如注意力模块和MLP层,都与输入令牌的不规则维度有关,在分别输入到不同分支之前,图像和视频令牌通过不同的线性层,以确保令牌的维度一致。此外,掩码操作显然不会改变令牌的维度。出于这些原因,论文有以下权重共享策略:时间和时空分支的参数完全共享,空间分支的大多数参数与其他两个分支共享,但与数据类型相关的操作除外,如上采样层。在减少模型中参数数量的同时,权重共享还允许模型学习具有相同参数的多种建模能力。

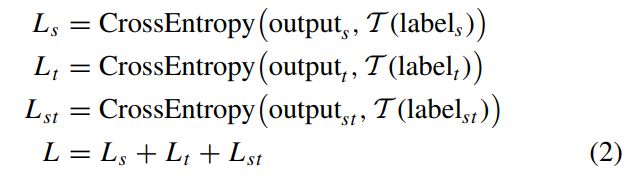

目标函数

采用交叉熵损失作为目标函数来训练模型,可以定义如下:

其中T(label_s)、T(label_t)和T(label_st)是通过在各个输入上应用标记器而获得的基本事实标记。T(·)表示表征器tokenizer,L表示总损失,这是三个f分支所产生的损失之和。

Training Strategies

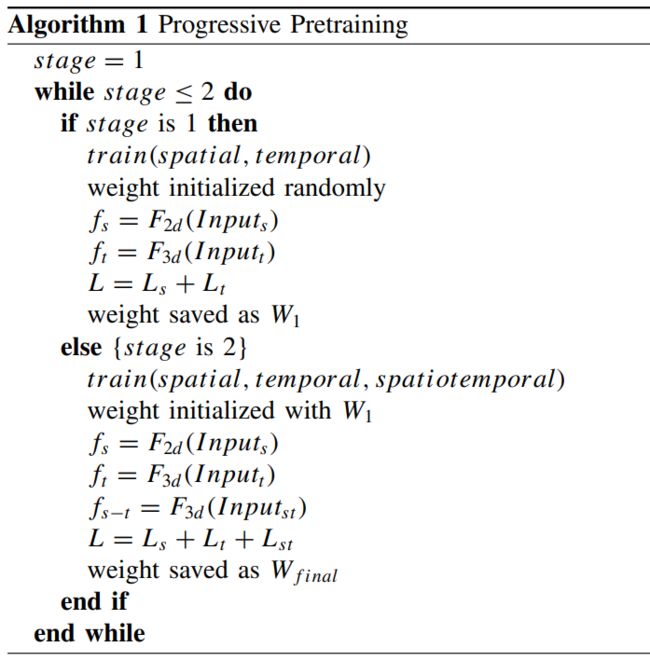

为了缓解多分支导致的模型训练难度,论文将模型的预训练分为两个训练阶段,渐进训练策略降低了训练难度。但是这个模型在应用于特定的下游任务之前需要微调步骤。

渐进预训练方法

由于不同的分支关注不同的信息,时空基础模型同时获得一般能力是具有挑战性的。因此,论文使用两阶段渐进训练策略,让模型逐渐学习更高维度的建模能力,这降低了训练的难度,提高了有效性和效率。

- 第一阶段,在参数随机初始化的情况下,论文使用图像数据和视频数据训练空间分支和时间分支,使模型能够分别学习数据的空间和时间信息。

- 第一阶段预训练之后,时空分支被添加到训练中,并用从第一阶段获得的预训练的时间分支参数初始化。在第一阶段训练的基础上,借助分块掩蔽策略和管掩蔽策略,该模型对空间和时间信息具有一定的建模能力。由于时空分支的掩蔽策略是掩蔽所有选定的视频帧,添加时空分支后,模型恢复掩蔽像素的难度大大增加,这将增强模型对时空信息建模的能力。

详细的渐进训练过程如算法1所示:

下游任务微调

为了适应多种类型的下游任务,通过丢弃预训练中使用的轻量级解码器,并将其替换为特定于下游任务的解码器,将模型应用于下游任务。基于从预训练中获得的参数,RingMo Sense可以使用来自下游任务的数据进行微调。