Hadoop学习笔记

HDFS、YARN、MapReduce概述及三者之间的关系

一、 Hadoop 组成(面试重点)

1.1 Hadoop1.x、2.x、3.x区别

在 Hadoop1.x 时 代 ,Hadoop中 的MapReduce同时处理业务逻辑运算和资源的调度,耦合性较大。在Hadoop2.x时 代,增加 了Yarn。Yarn只负责资 源 的 调 度 ,MapReduce 只负责运算Hadoop3.x在组成上没有变化。

1.2 HDFS 架构概述

HDFS(Hadoop Distributed File System) 它是一个文件系统,用于存储文件,通过目录树来定位文件;其次,它是分布式的,由很多服务器联合起来实现其功能,集群中的服务器有各自的角色。

HDFS的使用场景:适合一次写入,多次读出的场景。一个文件经过创建、写入和关闭之后就不需要改变。

1. HDFS组成

1、NameNode(nn): 就是Master,它是一个主管、管理者。存储文件的元数据,如文件名、文件目录结构、文件属性(生成时间、副本数、文件权限),以及每个文件的块列表和块所在的DataNode等。(告诉在哪存储,储存什么内容)

管理HDFS的名称空间 ;

配置副本策略;

管理数据块(Block)映射信息;

处理客户端读写请求。

2、DataNode : 就是slave,NameNode下达命令,DataNode执行实际的操作。

存储实际的数据块;

执行数据块的读、写操作

3、2nn:每隔一段时间对NameNode元数据备份

2. HDFS文件块大小

HDFS中的文件在物理上是分块存储(Block),块大小可以通过配置参数(dfs.blocksize)来规定,默认大小在Hadoop2.x/3.x版本中是128M,1.x版本是64M

结论:

(1)如果寻址时间约为10ms,即查找到目标block的时间为10ms

(2)寻址时间为传输时间的1%时,则为最佳状态。即:10ms/10%=1000ms

(3)而目前磁盘的传输速率普遍为100MB/s。因此块大小按最小单元设置为128M

(4)HDFS的块设置太小,会增加寻址时间,程序一直在找块的开始位置;

(5)HDFS的块设置太大,从磁盘传输数据的时间会明显大于定位这个块开始位置的时间。导致程序在处理这块数据时,会非常慢。

3. HDFS的优点

1)高容错性:数据自动保存多个副本。它通过增加副本的形式,提高容错性。如果某个副本丢失以后,如果有机器,它可自动恢复。

2)适合处理大数据:数据规模:能够处理数据规模达到GB、TB、甚至PB级别的数据;文件规模:能够处理百万规模以上的文件数量,数量相当之大。

3)可构建在廉价机器上,通过多副本机制,提高可靠性。

4. HDFS的缺点

1)不适合低延时数据访问,比如毫秒级的存储数据,是做不到的。

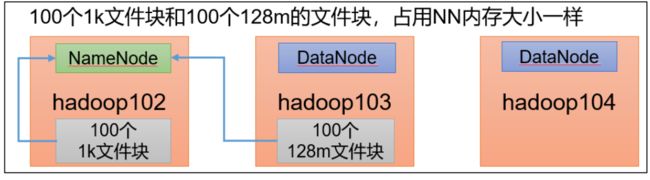

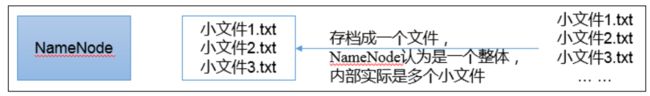

2)无法高效的对大量小文件进行存储。

存储大量小文件的话,它会占用NameNode大量的内存来存储文件目录和块信息,这样是不可取的,因为NameNode的内存总是有限的。

小文件存储的寻址时间会超过读取时间,它违反了HDFS的设计目标。

3)不支持并发写入、文件随机修改。

一个文件只能有一个写,不允许多个线程同时写;

仅支持数据append(追加),不支持文件的随机修改。

5. HDFS读数据流程

(1)client创建文件对象,请求NameNode确认是否有权限以及NameNode是否存在client需要的内容,如果有NameNode将返回给client文件的元数据;

(2)client创建流去读DataNode的数据块,读取规则: 首先访问节点最近的block,其次保证负载均衡

(3)同时访问多个DataNode,数据是串行存储到client,即数据追加

6. NameNode工作原理

(1)服务器启动之后,edits和fsimage 加载编辑日志和镜像文件到内存中;

(2)client 发起数据内容增删改请求对NameNode

(3)edits_inprogress 先记录需要操作的内容,更新滚动日志, 记录到fsimages

(4)操作内存进行数据的增删改

(5)2nn: checkPoint触发条件:

到了设置的定时时间;

Edits中的数据满了

满足任一个条件,Secondary NameNode请求Namnode确实是否可同步,如果回应即可开始同步

(6)滚动正在写的Edits,为edits_inprogress_002,如果这个时间client正请求修改,将记录到edits_inprogress_002,完成之后修改名称为edits_001

(7)拷贝edits_001到2nn,并拉取镜像fsimages

(8)2nn加载edits_001和fsimages到内存,生成新得fsimages.chkpoint,并拷贝到NameNode上,并命名为fsimage.chkpoint, 保证数据是最新的

9)如果namenode 其中一台active挂了(ip:50070),处理方法如下:

修改 hdfs-site.xml:中的内容,增加shell(/bin/true),update hadoop组件即可

具体看博客:https://blog.csdn.net/w892824196/article/details/100059674

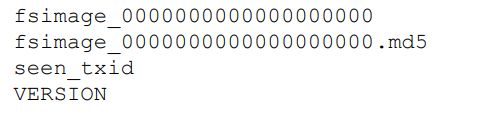

Fsimage 和 Edits概念:

NameNode格式化之后,将在以下目录下生成文件:

Fsimage文件:HDFS文件系统元数据得一个永久性得检查点,其中包括HDFS文件系统的所有目录和文件inode的序列化信息;

Edits文件:存放HDFS文件系统的所有更新操作的路径,文件系统客户端执行的所有写操作首先会被记录到Edits文件中。

seen_txid:文件保存的是一个数据,就是最后一个edits_的数字

7. DataNode工作原理

(1)DataNode启动后向NameNode注册。

(2)NameNode上标记注册成功;

(3)DataNode每周期(6小时)上报所有块信息给NameNode

(4)心跳每3s/次,心跳返回结果带有NameNode给当前DataNode的命令

(5)超过10分钟+30秒没有收到DataNode2的心跳,则认为该节点不可用。NameNode将不会在存储数据到该节点。

1.3 YARN 架构概述

Yarn是一个资源调度平台,负责为运算程序提供服务器运算资源,相当于一个分布式的操作平台,而MapReduce等运算程序则相当于运行于操作系统之上的应用程序。

1. YARN组成

1)ResourceManager(RM)

:整个集群资源(内存、CPU等)的老大,通俗一点讲就是协调分配整个集群的内存和CPU。

处理客户端请求;

监控NodeManager

启动和监控ApplicationMaster

资源的分配和调度

查看rm的主备方法: 进入到容器,执行yarn rmadmin -getAllServiceState, 手动停一台active的rm,standby一分钟左右自动切换到active。

2)NodeManager(NM)

:单个节点服务器资源老大。也就是单台机器该节点所需要的内存和cpu

管理单个节点上的资源

处理来自ResourceManager的命令

处理来自ApplicationMaster的命令

3)ApplicationMaster(AM)

:单个任务运行的老大

为应用程序申请资源并分配给内部的任务

任务的监控与容错

4)Container

容器,相当一台独立的服务器,里面封装了任务运行所需要的资源,如内存、CPU、磁盘、网络等。

5) client就是客户端

文件切分。文件上传HDFS的时候,Client将文件切分成一个一个的Block(块)

与NameNode交互,获取文件的位置信息;

与DataNode交互,读取或者写入数据;

Client提供一些命令来管理HDFS, 比如NameNode格式化。

Client可以通过一些命令来访问HDFS, 比如对HDFS增啥改查操作。

说明1:客户端可以有多个说明2:集群上可以运行多个ApplicationMaster说明3:每个NodeManager上可以有多个Container

1.4 MapReduce 架构概述

MapReduce 将计算过程分为两个阶段:Map 和 Reduce

1)Map 阶段并行处理输入数据

2)Reduce 阶段对 Map 结果进行汇总

1、MapReduce优点:

易于编程。用户只关系业务逻辑,实现框架的接口。

良好扩展性。可以动态增加服务器,解决计算资源不够问题

高容错性。任何一台机器挂掉,可以将任务转移到其他节点。

适合海量数据计算,几千台服务器共同计算。

2、MapReduce缺点:

不擅长实时计算。Mysql

不擅长流式计算。Sparkstreaming flink

1.5 HDFS、YARN、MapReduce 三者关系

客户端Client提交任务到资源管理器(ResourceManager),资源管理器接收到任务之后去NodeManager节点开启任务(ApplicationMaster), ApplicationMaster向ResourceManager申请资源, 若有资源ApplicationMaster负责开启任务即MapTask。开始干活了即分析任务,每个map独立工作,各自负责检索各自对应的DataNode,将结果记录到HDFS, DataNode负责存储,NameNode负责记录,2nn负责备份部分数据。

推荐系统框架

常问面试题

1、常用端口

hadoop 3.x

HDFS NameNode 内部通常端口:8020/9000/9820HDFS NameNode 对用户得查询端口:9870Yarn查看任务运行情况:8088历史服务器:19888

hadoop 2.x

HDFS NameNode 内部通常端口:8020/9000HDFS NameNode 对用户得查询端口:50070Yarn查看任务运行情况:8088历史服务器:19888

2、常用的配置文件

3.x版本:

core-site.xml

hdfs-site.xml

yarn-site.xml

mapred-site.xml

workers

2.x版本:

core-site.xml

hdfs-site.xml

yarn-site.xml

mapred-site.xml

slaves

Hadoop 运行环境搭建(开发重点)

一、模板虚拟机环境准备

0)安装模板虚拟机,IP 地址 192.168.10.100、主机名称 hadoop100、内存 4G、硬盘 50G

Hadoop100在Linux阶段就部署好了,如有疑问回去看Linux笔记

1)hadoop100 虚拟机配置要求如下(本文 Linux 系统全部以 CentOS-7.5-x86-1804 为例)

①使用 yum 安装需要虚拟机可以正常上网,yum 安装前可以先测试下虚拟机联网情况(ping一下外网看看是否ping的通)

②安装 epel-release

注:Extra Packages for Enterprise Linux 是为“红帽系”的操作系统提供额外的软件包,适用于 RHEL、CentOS 和 Scientific Linux。相当于是一个软件仓库,大多数 rpm 包在官方repository 中是找不到的)

yum install -y epel-release- ③注意:如果 Linux 安装的是最小系统版,还需要安装如下工具;果安装的是 Linux桌面标准版,不需要执行如下操作

**net-tool:工具包集合,包含 ifconfig 等命令** yum install -y net-tools vim:编辑器yum install -y vim2)关闭防火墙,关闭防火墙开机自启

systemctl stop firewalld

systemctl disable firewalld.service

注意:在企业开发时,通常单个服务器的防火墙时关闭的。公司整体对外会设置非常安全的防火墙

3)创建用户,并修改用户的密码

useradd xxxxxx

passwd xxxxxx

4)配置 xxxxxx 用户具有 root 权限,方便后期加 sudo 执行 root 权限的命令

#修改配置文件给它授权

vim /etc/sudoers

修改/etc/sudoers 文件,在%wheel 这行下面添加一行,如下所示:

## Allow root to run any commands anywhere

root ALL=(ALL) ALL

## Allows people in group wheel to run all commands

%wheel ALL=(ALL) ALL

**xxxxxx(用户名) ALL=(ALL) NOPASSWD:ALL**注意:atguigu 这一行不要直接放到 root 行下面,因为所有用户都属于 wheel 组,你先配置了 atguigu 具有免密功能,但是程序执行到%wheel 行时,该功能又被覆盖回需要密码。所以 atguigu 要到%wheel 这行下面。

5)在/opt 目录下创建文件夹,并修改所属主和所属组

(1)在/opt 目录下创建 module、software 文件夹(创建存放安装包目录及软件安装目录)

[root@hadoop100 ~]# mkdir /opt/module

[root@hadoop100 ~]# mkdir /opt/software(2)修改 module、software 文件夹的所有者和所属组均为 atguigu 用户(以下的案例以此用户进行)

[root@hadoop100 ~]# chown atguigu:atguigu /opt/module

[root@hadoop100 ~]# chown atguigu:atguigu /opt/software(3)查看 module、software 文件夹的所有者和所属组

[root@hadoop100 ~]# cd /opt/

[root@hadoop100 opt]# ll

总用量 12

drwxr-xr-x. 2 atguigu atguigu 4096 5 月 28 17:18 module

drwxr-xr-x. 2 root root 4096 9 月 7 2017 rh

drwxr-xr-x. 2 atguigu atguigu 4096 5 月 28 17:18 software6)卸载虚拟机自带的 JDK

注意:如果你的虚拟机是最小化安装不需要执行这一步。

[root@hadoop100 ~]# rpm -qa | grep -i java | xargs -n1 rpm -e --nodeps

➢ rpm -qa:查询所安装的所有 rpm 软件包

➢ grep -i:忽略大小写

➢ xargs -n1:表示每次只传递一个参数

➢ rpm -e –nodeps:强制卸载软件

7)重启虚拟机

[root@hadoop100 ~]# reboot二、克隆虚拟机

1)利用模板机 hadoop100,克隆三台虚拟机:hadoop102 hadoop103 hadoop104

①修改相关配置

2)修改克隆机 IP,以下以hadoop102 举例说明

(1)修改克隆虚拟机的静态 IP

root@hadoop100 ~]# vim /etc/sysconfig/network-scripts/ifcfg-ens33

3)修改克隆机主机名,以下以 hadoop102 举例说明

(1)修改主机名称

[root@hadoop100 ~]# vim /etc/hostname②安装JDK

1)卸载现有 JDK

注意:安装 JDK 前,一定确保提前删除了虚拟机自带的 JDK。怎么卸载上面有说到(以下操作在非root用户身份操作)

2)解压 JDK 到/opt/module 目录下

tar -zxvf jdk-8u212-linux-x64.tar.gz -C /opt/module/3)配置 JDK 环境变量

(1)新建/etc/profile.d/my_env.sh 文件(文件名可以自己取)

sudo vim /etc/profile.d/my_env.sh

添加如下内容

#JAVA_HOME

export JAVA_HOME=/opt/module/jdk1.8.0_212

export PATH=$PATH:$JAVA_HOME/bin(2)source 一下/etc/profile 文件,让新的环境变量 PATH 生效

source /etc/profile

③安装 Hadoop

Hadoop 下载地址:https://archive.apache.org/dist/hadoop/common/hadoop-3.1.3/

把安装包传到相应存放目录

1)解压安装文件到/opt/module 下面

tar -zxvf hadoop-3.1.3.tar.gz -C /opt/module/2)将 Hadoop 添加到环境变量

(1)获取 Hadoop 安装路径

[atguigu@hadoop102 hadoop-3.1.3]$ pwd

/opt/module/hadoop-3.1.3(2)打开/etc/profile.d/my_env.sh 文件

sudo vim /etc/profile.d/my_env.sh

➢ 在 my_env.sh 文件末尾添加如下内容:(shift+g)

#HADOOP_HOME

export HADOOP_HOME=/opt/module/hadoop-3.1.3

export PATH=$PATH:$HADOOP_HOME/bin

export PATH=$PATH:$HADOOP_HOME/sbin

(3)让修改后的文件生效

source /etc/profile三、完全分布式运行模式(开发重点)

分析:

1)准备 3 台客户机(关闭防火墙、静态 IP、主机名称)

2)安装 JDK

3)配置环境变量

4)安装 Hadoop

5)配置环境变量

6)配置集群

7)单点启动

8)配置 ssh

9)群起并测试集群

3.1 编写集群分发脚本 xsync

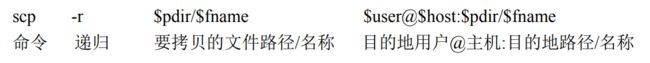

1)scp(secure copy)安全拷贝

(1)scp 定义scp 可以实现服务器与服务器之间的数据拷贝。(from server1 to server2)

(2)基本语法

(3)将hadoop102安装好的jdk、hadoop拷贝到其余两台虚拟机

➢ 前提:在 hadoop102、hadoop103、hadoop104 都已经创建好的/opt/module、/opt/software 两个目录,并且已经把这两个目录修改为 atguigu:atguigu

[atguigu@hadoop102 ~]$ sudo chown atguigu:atguigu -R /opt/module(a)在 hadoop102 上,将 hadoop102 中/opt/module/jdk1.8.0_212 目录拷贝到hadoop103 上。

[atguigu@hadoop102 ~]$ scp -r /opt/module/jdk1.8.0_212 atguigu@hadoop103:/opt/module(b)在 hadoop103 上,将 hadoop102 中/opt/module/hadoop-3.1.3 目录拷贝到hadoop103 上。

[atguigu@hadoop103 opt]$ scp -r atguigu@hadoop102:/opt/module/*atguigu@hadoop104:/opt/module

2)rsync 远程同步工具

rsync 主要用于备份和镜像。具有速度快、避免复制相同内容和支持符号链接的优点。

rsync 和 scp 区别:用 rsync 做文件的复制要比 scp 的速度快,rsync 只对差异文件做更新。scp 是把所有文件都复制过去。

(2)案例实操(a)删除 hadoop103 中/opt/module/hadoop-3.1.3/wcinput

[atguigu@hadoop103 hadoop-3.1.3]$ rm -rf wcinput/(b)同步 hadoop102 中的/opt/module/hadoop-3.1.3 到 hadoop103

[atguigu@hadoop102 module]$ rsync -av hadoop-3.1.3/ atguigu@hadoop103:/opt/module/hadoop-3.1.3/3)xsync 集群分发脚本

目的:把一台机器上配好的文件及软件通过脚本分发,不用自己一台台的配置了,而且每台机器都去配置是很不现实的

(1)需求:循环复制文件到所有节点的相同目录下

(a)期望脚本:

xsync 要同步的文件名称

(b)期望脚本在任何路径都能使用(脚本放在声明了全局环境变量的路径)

(2)脚本实现

(a)在/home/atguigu/bin 目录下创建 xsync 文件

[atguigu@hadoop102 opt]$ cd /home/atguigu

[atguigu@hadoop102 ~]$ mkdir bin

[atguigu@hadoop102 ~]$ cd bin

[atguigu@hadoop102 bin]$ vim xsync在该文件中编写如下代码

#!/bin/bash

#1. 判断参数个数

if [ $# -lt 1 ]

then

echo Not Enough Arguement!

exit;

fi

#2. 遍历集群所有机器

for host in hadoop102 hadoop103 hadoop104

do

echo ==================== $host ====================

#3. 遍历所有目录,挨个发送

for file in $@

do

#4. 判断文件是否存在

if [ -e $file ]

then

#5. 获取父目录

pdir=$(cd -P $(dirname $file); pwd)

#6. 获取当前文件的名称

fname=$(basename $file)

ssh $host "mkdir -p $pdir"

rsync -av $pdir/$fname $host:$pdir

else

echo $file does not exists!

fi

done

done

(b)修改脚本 xsync 具有执行权限

[atguigu@hadoop102 bin]$ chmod +x xsync(c)测试脚本

xsync /home/atguigu/bin(d)将脚本复制到/bin 中,以便全局调用

sudo cp xsync /bin/(e)同步环境变量配置(root 所有者)

[atguigu@hadoop102 ~]$ sudo ./bin/xsync /etc/profile.d/my_env.sh注意:如果用了 sudo,那么 xsync 一定要给它的路径补全。

让环境变量生效

[atguigu@hadoop103 bin]$ source /etc/profile

[atguigu@hadoop104 opt]$ source /etc/profile3.2 SSH 无密登录配置

1)配置 ssh

基本语法ssh 另一台电脑的 IP 地址

2)无密钥配置

(1)免密登录原理

(2)生成公钥和私钥(进行初始化)

[atguigu@hadoop102 .ssh]$ pwd

/home/atguigu/.ssh

[atguigu@hadoop102 .ssh]$ **ssh-keygen -t rsa**然后敲(三个回车),就会生成两个文件 id_rsa(私钥)、id_rsa.pub(公钥)

(3)将公钥拷贝到要免密登录的目标机器上

[atguigu@hadoop102 .ssh]$ ssh-copy-id hadoop102

[atguigu@hadoop102 .ssh]$ ssh-copy-id hadoop103

[atguigu@hadoop102 .ssh]$ ssh-copy-id hadoop104注意:

还需要在 hadoop103 上采用 atguigu 账号配置一下无密登录到 hadoop102、hadoop103、hadoop104 服务器上。

还需要在 hadoop104 上采用 atguigu 账号配置一下无密登录到 hadoop102、hadoop103、hadoop104 服务器上。

还需要在 hadoop102 上采用 root 账号,配置一下无密登录到 hadoop102、hadoop103、hadoop104

3).ssh 文件夹下(~/.ssh)的文件功能解释

四、集群配置

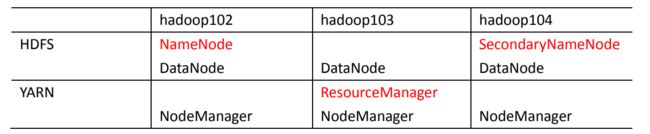

1)集群部署规划

注意:

➢ NameNode 和 SecondaryNameNode 不要安装在同一台服务器

➢ ResourceManager 也很消耗内存,不要和 NameNode、SecondaryNameNode 配置在同一台机器上。

2)配置文件说明

Hadoop 配置文件分两类:默认配置文件和自定义配置文件,只有用户想修改某一默认配置值时,才需要修改自定义配置文件,更改相应属性值。

(1)默认配置文件:(文件存放在 Hadoop 的 jar 包中的位置)

(2)自定义配置文件:

**core-site.xml、hdfs-site.xml、yarn-site.xml、mapred-site.xml **四个配置文件存放$HADOOP_HOME/etc/hadoop 这个路径上,用户可以根据项目需求重新进行修改配置。

3)配置集群

常用端口号说明

端口名称 |

Hadoop2.x |

NameNode 内部通信端口 |

8020 / 9000 |

NameNode HTTP UI |

50070 |

MapReduce 查看执行任务端口 |

8088 |

历史服务器通信端口 |

19888 |

①核心(core-site.xml)配置文件

配置 core-site.xml

[atguigu@hadoop102 ~]$ cd $HADOOP_HOME/etc/hadoop

[atguigu@hadoop102 hadoop]$ vim core-site.xml文件内容如下:

fs.defaultFS

hdfs://hadoop102:8020

hadoop.tmp.dir

/opt/module/hadoop-3.1.3/data

hadoop.http.staticuser.user

atguigu

②HDFS (hdfs-site.xml)配置文件

配置 hdfs-site.xml

[atguigu@hadoop102 hadoop]$ vim hdfs-site.xml文件内容如下:

dfs.namenode.http-address

hadoop102:9870

dfs.namenode.secondary.http-address

hadoop104:9868

③YARN (yarn-site.xml)配置文件

配置 yarn-site.xml,并且配置的日志聚集的功能

日志聚集概念:应用运行完成以后,将程序运行日志信息上传到 HDFS 系统上。

日志聚集功能好处:可以方便的查看到程序运行详情,方便开发调试。

注意:开启日志聚集功能,需要重新启动 NodeManager 、ResourceManager 和HistoryServer。

[atguigu@hadoop102 hadoop]$ vim yarn-site.xml文件内容如下:

yarn.nodemanager.aux-services

mapreduce_shuffle

yarn.resourcemanager.hostname

hadoop103

yarn.nodemanager.env-whitelist

JAVA_HOME,HADOOP_COMMON_HOME,HADOOP_HDFS_HOME,HADOOP_CO

NF_DIR,CLASSPATH_PREPEND_DISTCACHE,HADOOP_YARN_HOME,HADOOP_MAP

RED_HOME

yarn.log-aggregation-enable

true

yarn.log.server.url

http://hadoop102:19888/jobhistory/logs

yarn.log-aggregation.retain-seconds

604800

④MapReduce(mapred-site.xml)配置文件

配置 mapred-site.xml,并配置了历史服务器

为了查看程序的历史运行情况,需要配置一下历史服务器。具体配置步骤如下:

[atguigu@hadoop102 hadoop]$ vim mapred-site.xml文件内容如下:

mapreduce.framework.name

yarn

yarn.app.mapreduce.am.env

HADOOP_MAPRED_HOME=/opt/module/hadoop-3.1.3

mapreduce.map.env

HADOOP_MAPRED_HOME=/opt/module/hadoop-3.1.3

mapreduce.reduce.env

HADOOP_MAPRED_HOME=/opt/module/hadoop-3.1.3

mapreduce.jobhistory.address

hadoop102:10020

mapreduce.jobhistory.webapp.address

hadoop102:19888

4)在集群上分发配置好的 Hadoop 配置文件

atguigu@hadoop102 hadoop]$ xsync /opt/module/hadoop-3.1.3/etc/hadoop/

5)去 103 和 104 上查看文件分发情况

atguigu@hadoop103 ~]$ cat /opt/module/hadoop3.1.3/etc/hadoop/core-site.xml

[atguigu@hadoop104 ~]$ cat /opt/module/hadoop3.1.3/etc/hadoop/core-site.xml五、群起集群

1)配置 workers

[atguigu@hadoop102 hadoop]$ vim /opt/module/hadoop3.1.3/etc/hadoop/workers向里面添加“工作者”

hadoop102

hadoop103

hadoop104注意:该文件中添加的内容结尾不允许有空格,文件中不允许有空行。

同步所有节点配置文件

[atguigu@hadoop102 hadoop]$ xsync /opt/module/hadoop-3.1.3/etc2)启动集群

(1)如果集群是第一次启动,需要在 hadoop102 节点格式化 NameNode(注意:格式化NameNode,会产生新的集群 id,导致 NameNode 和 DataNode 的集群 id 不一致,集群找不到已往数据。如果集群在运行过程中报错,需要重新格式化 NameNode 的话,一定要先停止 namenode 和 datanode 进程,并且要删除所有机器的 data 和 logs 目录,然后再进行格式化。)

[atguigu@hadoop102 hadoop-3.1.3]$ hdfs namenode -format(2)启动 HDFS

[atguigu@hadoop102 hadoop-3.1.3]$ sbin/start-dfs.sh(3)**在配置了 ResourceManager 的节点(hadoop103)**启动 YARN

[atguigu@hadoop103 hadoop-3.1.3]$ sbin/start-yarn.sh(4)Web 端查看 HDFS 的 NameNode

(a)浏览器中输入:http://hadoop102:9870

(b)查看 HDFS 上存储的数据信息

(5)Web 端查看 YARN 的 ResourceManager

(a)浏览器中输入:http://hadoop103:8088

(b)查看 YARN 上运行的 Job 信息

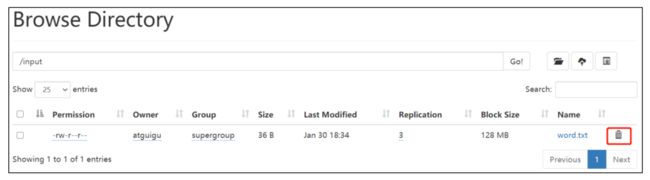

3)集群基本测试

(1)上传文件到集群

➢ 上传小文件

[atguigu@hadoop102 ~]$ hadoop fs -mkdir /input

[atguigu@hadoop102 ~]$ hadoop fs -put $HADOOP_HOME/wcinput/word.txt /input➢ 上传大文件

[atguigu@hadoop102 ~]$ hadoop fs -put /opt/software/jdk-8u212-linux-x64.tar.gz /

(2)上传文件后查看文件存放在什么位置

➢ 查看 HDFS 文件存储路径

[atguigu@hadoop102 subdir0]$ pwd

/opt/module/hadoop-3.1.3/data/dfs/data/current/BP-1436128598-192.168.10.102-1610603650062/current/finalized/subdir0/subdir0

4)启动历史服务器

1.在 hadoop102 启动历史服务器

[atguigu@hadoop102 hadoop]$ mapred --daemon start historyserver2.查看历史服务器是否启动

[atguigu@hadoop102 hadoop]$ jps

3.查看 JobHistory

http://hadoop102:19888/jobhistory

5)启动日志的聚集

1.关闭 NodeManager 、ResourceManager 和 HistoryServer

[atguigu@hadoop103 hadoop-3.1.3]$ sbin/stop-yarn.sh

[atguigu@hadoop103 hadoop-3.1.3]$ mapred --daemon stop historyserver2.启动 NodeManager 、ResourceManage 和 HistoryServer

[atguigu@hadoop103 ~]$ start-yarn.sh

[atguigu@hadoop102 ~]$ mapred --daemon start historyserver3.删除 HDFS 上已经存在的输出文件

[atguigu@hadoop102 ~]$ hadoop fs -rm -r /output4.执行 WordCount 程序

[atguigu@hadoop102 hadoop-3.1.3]$ hadoop jar share/hadoop/mapreduce/hadoop-mapreduce-examples-3.1.3.jar wordcount /input /output

5.查看日志

(1)历史服务器地址

http://hadoop102:19888/jobhistory

(2)历史任务列表

(3)查看任务运行日志

(4)运行日志详情

六、集群启动/停止方式总结

1)各个模块分开启动/停止

各个模块分开启动/停止(配置 ssh 是前提)常用

(1)整体启动/停止 HDFS

start-dfs.sh/stop-dfs.sh(2)整体启动/停止 YARN

start-yarn.sh/stop-yarn.sh2)各个服务组件逐一启动/停止

(1)分别启动/停止 HDFS 组件

hdfs --daemon start/stop namenode/datanode/secondarynamenode(2)启动/停止 YARN

yarn --daemon start/stop resourcemanager/nodemanager七、编写 Hadoop 集群常用脚本

1)Hadoop 集群启停脚本

(包含 HDFS,Yarn,Historyserver):myhadoop.sh(名字可以随便起)

[atguigu@hadoop102 ~]$ cd /home/atguigu/bin

[atguigu@hadoop102 bin]$ vim myhadoop.sh➢ 输入如下内容(脚本内容)

#!/bin/bash

if [ $# -lt 1 ]

then

echo "No Args Input..."

exit ;

fi

case $1 in

"start")

echo " =================== 启动 hadoop 集群 ==================="

echo " --------------- 启动 hdfs ---------------"

ssh hadoop102 "/opt/module/hadoop-3.1.3/sbin/start-dfs.sh"

echo " --------------- 启动 yarn ---------------"

ssh hadoop103 "/opt/module/hadoop-3.1.3/sbin/start-yarn.sh"

echo " --------------- 启动 historyserver ---------------"

ssh hadoop102 "/opt/module/hadoop-3.1.3/bin/mapred --daemon start historyserver"

;;

"stop")

echo " =================== 关闭 hadoop 集群 ==================="

echo " --------------- 关闭 historyserver ---------------"

ssh hadoop102 "/opt/module/hadoop-3.1.3/bin/mapred --daemon stop historyserver"

echo " --------------- 关闭 yarn ---------------"

ssh hadoop103 "/opt/module/hadoop-3.1.3/sbin/stop-yarn.sh"

echo " --------------- 关闭 hdfs ---------------"

ssh hadoop102 "/opt/module/hadoop-3.1.3/sbin/stop-dfs.sh"

;;

*)

echo "Input Args Error..."

;;

esac

➢ 保存后退出,然后赋予脚本执行权限

[atguigu@hadoop102 bin]$ chmod +x myhadoop.sh2)查看服务器 Java 进程脚本

查看三台服务器 Java 进程脚本:jpsall

[atguigu@hadoop102 ~]$ cd /home/atguigu/bin

[atguigu@hadoop102 bin]$ vim jpsall➢ 输入如下内容

#!/bin/bash

for host in hadoop102 hadoop103 hadoop104

do

echo =============== $host ===============

ssh $host jps

done➢ 保存后退出,然后赋予脚本执行权限

[atguigu@hadoop102 bin]$ chmod +x jpsall3)分发/home/atguigu/bin 目录,保证自定义脚本在三台机器上都可以使用

[atguigu@hadoop102 ~]$ xsync /home/atguigu/bin/八、常见错误及解决方案

1)防火墙没关闭、或者没有启动 YARN

INFO client.RMProxy: Connecting to ResourceManager at hadoop108/192.168.10.108:8032

2)主机名称配置错误

3)IP 地址配置错误

4)ssh 没有配置好

5)root 用户和 atguigu 两个用户启动集群不统一

6)配置文件修改不细心

7)不识别主机名称

java.net.UnknownHostException: hadoop102: hadoop102

at

java.net.InetAddress.getLocalHost(InetAddress.java:1475)

at

org.apache.hadoop.mapreduce.JobSubmitter.submitJobInternal(Job

Submitter.java:146)

at org.apache.hadoop.mapreduce.Job$10.run(Job.java:1290)

at org.apache.hadoop.mapreduce.Job$10.run(Job.java:1287)

at java.security.AccessController.doPrivileged(Native

Method)

at javax.security.auth.Subject.doAs(Subject.java:415)解决办法:

(1)在/etc/hosts 文件中添加 192.168.10.102 hadoop102

(2)主机名称不要起 hadoop hadoop000 等特殊名称

8)DataNode 和 NameNode 进程同时只能工作一个。

解决办法:

在格式化之前,先删除DataNode里面的信息(默认在/tmp,如果配置了该目录,那就去你配置的目录下删除数据)

9)执行命令不生效,粘贴 Word 中命令时,遇到-和长–没区分开。导致命令失效

**解决办法:**尽量不要粘贴 Word 中代码。

10)jps 发现进程已经没有,但是重新启动集群,提示进程已经开启。

原因是在 Linux 的根目录下/tmp 目录中存在启动的进程临时文件,将集群相关进程删除掉,再重新启动集群。

11)jps 不生效

原因:全局变量 hadoop java 没有生效。解决办法:需要 source /etc/profile 文件。

12)8088 端口连接不上

[atguigu@hadoop102 桌面]$ cat /etc/hosts

注释掉如下代码

#127.0.0.1 localhost localhost.localdomain localhost4 localhost4.localdomain4

#::1 hadoop102HDFS详解

第 1 章 HDFS 概述

1.1 HDFS 产出背景及定义

1)HDFS 产生背景

随着数据量越来越大,在一个操作系统存不下所有的数据,那么就分配到更多的操作系统管理的磁盘中,但是不方便管理和维护,迫切需要一种系统来管理多台机器上的文件,这就是分布式文件管理系统。HDFS 只是分布式文件管理系统中的一种。

2)HDFS 定义

HDFS(Hadoop Distributed File System),它是一个文件系统,用于存储文件,通过目录树来定位文件;其次,它是分布式的,由很多服务器联合起来实现其功能,集群中的服务器有各自的角色。

HDFS 的使用场景:适合一次写入,多次读出的场景。一个文件经过创建、写入和关闭之后就不需要改变。

1.2 HDFS 优缺点

HDFS优点

1)高容错性

➢ 数据自动保存多个副本。它通过增加副本的形式,提高容错性。

➢ 某一个副本丢失以后,它可以自动恢复。

2)适合处理大数据

➢ 数据规模:能够处理数据规模达到GB、TB、甚至PB级别的数据;➢ 文件规模:能够处理百万规模以上的文件数量,数量相当之大。

3)可构建在廉价机器上

可构建在廉价机器上,通过多副本机制,提高可靠性。

HDFS缺点

1)不适合低延时数据访问,比如毫秒级的存储数据,是做不到的。

2)无法高效的对大量小文件进行存储。

➢ 存储大量小文件的话,它会占用NameNode大量的内存来存储文件目录和块信息。这样是不可取的,因为NameNode的内存总是有限的;➢ 小文件存储的寻址时间会超过读取时间,它违反了HDFS的设计目标。

3)不支持并发写入、文件随机修改。

➢ 一个文件只能有一个写,不允许多个线程同时写;➢ 仅支持数据append(追加),不支持文件的随机修改。

1.3 HDFS 组成架构

HDFS组成架构

1)NameNode(nn):就是Master,它是一个主管、管理者。

(1)管理HDFS的名称空间;(2)配置副本策略;(3)管理数据块(Block)映射信息;(4)处理客户端读写请求。

2)DataNode:就是Slave。NameNode下达命令,DataNode执行实际的操作。

(1)存储实际的数据块;(2)执行数据块的读/写操作。

3)Client:就是客户端。

(1)文件切分。文件上传HDFS的时候,Client将文件切分成一个一个的Block,然后进行上传;(2)与NameNode交互,获取文件的位置信息;(3)与DataNode交互,读取或者写入数据;(4)Client提供一些命令来管理HDFS,比如NameNode格式化;(5)Client可以通过一些命令来访问HDFS,比如对HDFS增删查改操作;

4)Secondary NameNode:并非NameNode的热备。当NameNode挂掉的时候,它并不能马上替换NameNode并提供服务。

(1)辅助NameNode,分担其工作量,比如定期合并Fsimage和Edits,并推送给NameNode ;(2)在紧急情况下,可辅助恢复NameNode。

1.4 HDFS 文件块大小(面试重点)

HDFS 文件块大小

HDFS中的文件在物理上是分块存储(Block),块的大小可以通过配置参数( dfs.blocksize)来规定,默认大小在Hadoop2.x/3.x版本中是128M,1.x版本中是64M。

思考:为什么块的大小不能设置太小,也不能设置太大?

(1)HDFS的块设置太小,会增加寻址时间,程序一直在找块的开始位置;

(2)如果块设置的太大,从磁盘传输数据的时间会明显大于定位这个块开始位置所需的时间。导致程序在处理这块数据时,会非常慢。

总结:HDFS块的大小设置主要取决于磁盘传输速率。

第 2 章 HDFS 的 Shell 操作(开发重点)

2.1 基本语法

hadoop fs 具体命令或 hdfs dfs 具体命令

两个是完全相同的。

2.2 命令大全

bin/hadoop fs2.3 常用命令实操

2.3.1 准备工作

1)启动 Hadoop 集群(方便后续的测试)

[atguigu@hadoop102 hadoop-3.1.3]$ sbin/start-dfs.sh

[atguigu@hadoop103 hadoop-3.1.3]$ sbin/start-yarn.sh2)-help:输出这个命令参数

[atguigu@hadoop102 hadoop-3.1.3]$ hadoop fs -help rm3)创建/sanguo 文件夹

[atguigu@hadoop102 hadoop-3.1.3]$ hadoop fs -mkdir /sanguo2.3.2 上传

1)-moveFromLocal:从本地剪切粘贴到 HDFS

[atguigu@hadoop102 hadoop-3.1.3]$ vim shuguo.txt

[atguigu@hadoop102 hadoop-3.1.3]$ hadoop fs -moveFromLocal ./shuguo.txt /sanguo2)-copyFromLocal:从本地文件系统中拷贝文件到 HDFS 路径去

[atguigu@hadoop102 hadoop-3.1.3]$ vim weiguo.txt

[atguigu@hadoop102 hadoop-3.1.3]$ hadoop fs -copyFromLocal weiguo.txt /sanguo

3)-put:等同于 copyFromLocal,生产环境更习惯用 put

[atguigu@hadoop102 hadoop-3.1.3]$ vim wuguo.txt

[atguigu@hadoop102 hadoop-3.1.3]$ hadoop fs -put ./wuguo.txt /sanguo

4)-appendToFile:追加一个文件到已经存在的文件末尾

[atguigu@hadoop102 hadoop-3.1.3]$ vim liubei.txt

[atguigu@hadoop102 hadoop-3.1.3]$ hadoop fs -appendToFile liubei.txt /sanguo/shuguo.txt

2.3.3 下载

1)-copyToLocal:从 HDFS 拷贝到本地

[atguigu@hadoop102 hadoop-3.1.3]$ hadoop fs -copyToLocal /sanguo/shuguo.txt ./

2)-get:等同于 copyToLocal,生产环境更习惯用 get

[atguigu@hadoop102 hadoop-3.1.3]$ hadoop fs -get /sanguo/shuguo.txt ./shuguo2.txt

2.3.4 HDFS 直接操作

1)-ls: 显示目录信息

[atguigu@hadoop102 hadoop-3.1.3]$ hadoop fs -ls /sanguo2)-cat:显示文件内容

[atguigu@hadoop102 hadoop-3.1.3]$ hadoop fs -cat /sanguo/shuguo.txt3)-chgrp、-chmod、-chown:Linux 文件系统中的用法一样,修改文件所属权限

[atguigu@hadoop102 hadoop-3.1.3]$ hadoop fs -chmod 666 /sanguo/shuguo.txt

[atguigu@hadoop102 hadoop-3.1.3]$ hadoop fs -chown atguigu:atguigu /sanguo/shuguo.txt

4)-mkdir:创建路径

[atguigu@hadoop102 hadoop-3.1.3]$ hadoop fs -mkdir /jinguo5)-cp:从 HDFS 的一个路径拷贝到 HDFS 的另一个路径

[atguigu@hadoop102 hadoop-3.1.3]$ hadoop fs -cp /sanguo/shuguo.txt /jinguo6)-mv:在 HDFS 目录中移动文件

[atguigu@hadoop102 hadoop-3.1.3]$ hadoop fs -mv /sanguo/wuguo.txt /jinguo

[atguigu@hadoop102 hadoop-3.1.3]$ hadoop fs -mv /sanguo/weiguo.txt /jinguo7)-tail:显示一个文件的末尾 1kb 的数据

[atguigu@hadoop102 hadoop-3.1.3]$ hadoop fs -tail /jinguo/shuguo.txt8)-rm:删除文件或文件夹

[atguigu@hadoop102 hadoop-3.1.3]$ hadoop fs -rm /sanguo/shuguo.txt

9)-rm -r:递归删除目录及目录里面内容

[atguigu@hadoop102 hadoop-3.1.3]$ hadoop fs -rm -r /sanguo10)-du 统计文件夹的大小信息

[atguigu@hadoop102 hadoop-3.1.3]$ hadoop fs -du -s -h /jinguo

27 81 /jinguo

[atguigu@hadoop102 hadoop-3.1.3]$ hadoop fs -du -h /jinguo

14 42 /jinguo/shuguo.txt

7 21 /jinguo/weiguo.txt

6 18 /jinguo/wuguo.tx说明:27 表示文件大小;81 表示 27*3 个副本;/jinguo 表示查看的目录

11)-setrep:设置 HDFS 中文件的副本数量

[atguigu@hadoop102 hadoop-3.1.3]$ hadoop fs -setrep 10 /jinguo/shuguo.txt

这里设置的副本数只是记录在 NameNode 的元数据中,是否真的会有这么多副本,还得看 DataNode 的数量。因为目前只有 3 台设备,最多也就 3 个副本,只有节点数的增加到 10台时,副本数才能达到 10。

第 3 章 HDFS 的 API 操作

3.1 客户端环境准备

1)找到资料包路径下的 Windows 依赖文件夹,拷贝 hadoop-3.1.0 到非中文路径(比如 d:\)。

2)配置 HADOOP_HOME 环境变量

3)配置 Path 环境变量。

运行客户端的Hadoop,点击如下程序(双击 winutils.exe),如果一闪而过说明启动成功,如果报如下错误。说明缺少微软运行库(正版系统往往有这个问题)。再资料包里面有对应的微软运行库安装包双击安装即可。

4)在 IDEA 中创建一个 Maven 工程 HdfsClientDemo,并导入相应的依赖坐标+日志添加

pom.xml依赖中添加如下的包

org.apache.hadoop

hadoop-client

3.1.3

junit

junit

4.12

org.slf4j

slf4j-log4j12

1.7.30

在项目的 src/main/resources 目录下,新建一个文件,命名为“log4j.properties”,在文件中填入

log4j.rootLogger=INFO, stdout

log4j.appender.stdout=org.apache.log4j.ConsoleAppender

log4j.appender.stdout.layout=org.apache.log4j.PatternLayout

log4j.appender.stdout.layout.ConversionPattern=%d %p [%c] - %m%n

log4j.appender.logfile=org.apache.log4j.FileAppender

log4j.appender.logfile.File=target/spring.log

log4j.appender.logfile.layout=org.apache.log4j.PatternLayout

log4j.appender.logfile.layout.ConversionPattern=%d %p [%c] - %m%n5)创建包名:com.atguigu.hdfs

6)创建 HdfsClient 类

public class HdfsClient {

@Test

public void myMkdir() throws Exception {

//连接集群的地址

URI uri = new URI("hdfs://hadoop102:8020");

//用户

String user="lucas";

//创建一个配置文件

Configuration configuration = new Configuration();

//获取到客户端集群

FileSystem fs = FileSystem.get(uri,configuration,user);

//创建一个文件夹

fs.mkdirs(new Path("/XiYouJi/sunWuKon"));

//关闭资源

fs.close();

}

}

7)执行程序客户端去操作 HDFS 时,是有一个用户身份的。默认情况下,HDFS 客户端 API 会从采用 Windows 默认用户访问 HDFS,会报权限异常错误。所以在访问 HDFS 时,一定要配置用户。

3.2 HDFS 的 API 案例实操

3.2.1 HDFS 文件上传(测试参数优先级)

1)编写源代码

private FileSystem fs;

@Before

public void init() throws Exception {

//连接集群的地址

URI uri = new URI("hdfs://hadoop102:8020");

//用户

String user="lucas";

//创建一个配置文件

Configuration configuration = new Configuration();

//获取到客户端集群

fs = FileSystem.get(uri,configuration,user);

}

@After

public void close() throws Exception {

fs.close();

}

//创建一个文件目录

@Test

public void testMkdir() throws IOException {

//创建一个文件夹

fs.mkdirs(new Path("/XiYouJi/zhuBaJie"));

}

//上传文件

@Test

public void testPut() throws IOException {

// 参数解读:参数一:表示删除原数据; 参数二:是否允许覆盖;参数三:原数据路径; 参数四:目的地路径

fs.copyFromLocalFile(false,ture,new Path("E:\\learn\\huaguoshang.txt"), new Path("/XiYouJi/sunWuKon"));

}

}2)在 resources 资源目录下创建hdfs-site.xml 配置文件

dfs.replication

1

参数优先级排序:

(1)客户端代码中设置的值 >(2)ClassPath 下的用户自定义配置文件 >(3)然后是服务器的自定义配置(xxx-site.xml)>(4)服务器的默认配置(xxx-default.xml)

3.2.2 HDFS 文件下载

// 文件下载

@Test

public void testGet() throws IOException {

// 参数的解读:参数一:原文件是否删除;参数二:原文件路径HDFS; 参数三:目标地址路径Win ; 参数四:是否开启crc校验

//fs.copyToLocalFile(true, new Path("hdfs://hadoop102/xiyou/huaguoshan/"), new Path("D:\\"), true);

fs.copyToLocalFile(false, new Path("hdfs://hadoop102/a.txt"), new Path("D:\\"), false);

}注意:如果执行上面代码,下载不了文件,有可能是你电脑的微软支持的运行库少,需要安装一下微软运行库。

3.2.3 HDFS 文件更名和移动

// 文件的更名和移动

@Test

public void testmv() throws IOException {

// 参数解读:参数1 :原文件路径; 参数2 :目标文件路径

// 对文件名称的修改

//fs.rename(new Path("/input/word.txt"), new Path("/input/ss.txt"));

// 文件的移动和更名

//fs.rename(new Path("/input/ss.txt"),new Path("/cls.txt"));

// 目录更名

fs.rename(new Path("/input"), new Path("/output"));

}

3.2.4 HDFS 删除文件和目录

// 删除

@Test

public void testRm() throws IOException {

// 参数解读:参数1:要删除的路径; 参数2 : 是否递归删除

// 删除文件

//fs.delete(new Path("/jdk-8u212-linux-x64.tar.gz"),false);

// 删除空目录

//fs.delete(new Path("/xiyou"), false);

// 删除非空目录

fs.delete(new Path("/jinguo"), true);

}3.2.5 HDFS 文件详情查看

查看文件名称、权限、长度、块信息

// 获取文件详细信息

@Test

public void fileDetail() throws IOException {

// 获取所有文件信息

RemoteIterator listFiles = fs.listFiles(new Path("/"), true);

// 遍历文件

while (listFiles.hasNext()) {

LocatedFileStatus fileStatus = listFiles.next();

System.out.println("==========" + fileStatus.getPath() + "=========");

System.out.println(fileStatus.getPermission());

System.out.println(fileStatus.getOwner());

System.out.println(fileStatus.getGroup());

System.out.println(fileStatus.getLen());

System.out.println(fileStatus.getModificationTime());

System.out.println(fileStatus.getReplication());

System.out.println(fileStatus.getBlockSize());

System.out.println(fileStatus.getPath().getName());

// 获取块信息

BlockLocation[] blockLocations = fileStatus.getBlockLocations();

System.out.println(Arrays.toString(blockLocations));

}

} 3.2.6 HDFS 文件和文件夹判断

// 判断是文件夹还是文件

@Test

public void testFile() throws IOException {

FileStatus[] listStatus = fs.listStatus(new Path("/"));

for (FileStatus status : listStatus) {

if (status.isFile()) {

System.out.println("文件:" + status.getPath().getName());

} else {

System.out.println("目录:" + status.getPath().getName());

}

}

}

第 4 章 HDFS 的读写流程(面试重点)

4.1 HDFS 写数据流程

4.1.1 剖析文件写入

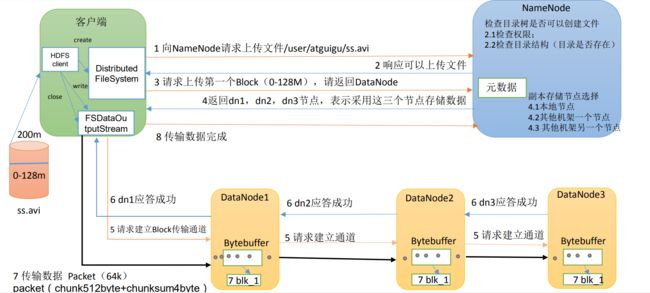

HDFS的写数据流程

(1)客户端通过 Distributed FileSystem 模块向 NameNode 请求上传文件,NameNode 检查目标文件是否已存在,父目录是否存在。

(2)NameNode 返回是否可以上传。

(3)客户端请求第一个 Block 上传到哪几个 DataNode 服务器上。

(4)NameNode 返回 3 个 DataNode 节点,分别为 dn1、dn2、dn3。

(5)客户端通过 FSDataOutputStream 模块请求 dn1 上传数据,dn1 收到请求会继续调用dn2,然后 dn2 调用 dn3,将这个通信管道建立完成。

(6)dn1、dn2、dn3 逐级应答客户端。

(7)客户端开始往 dn1 上传第一个 Block(先从磁盘读取数据放到一个本地内存缓存),以 Packet 为单位,dn1 收到一个 Packet 就会传给 dn2,dn2 传给 dn3;dn1 每传一个 packet会放入一个应答队列等待应答。

(8)当一个 Block 传输完成之后,客户端再次请求 NameNode 上传第二个 Block 的服务器。(重复执行 3-7 步)。

4.1.2 网络拓扑-节点距离计算

在 HDFS 写数据的过程中,NameNode 会选择距离待上传数据最近距离的 DataNode 接收数据。那么这个最近距离怎么计算呢?

节点距离:两个节点到达最近的共同祖先的距离总和。

网络拓扑-节点距离计算

例如,假设有数据中心 d1 机架 r1 中的节点 n1。该节点可以表示为/d1/r1/n1。利用这种标记,这里给出四种距离描述。大家算一算每两个节点之间的距离。

4.1.3 机架感知(副本存储节点选择)

1)机架感知说明

(1)官方说明

Apache Hadoop 3.1.3 – HDFS Architecture

For the common case, when the replication factor is three, HDFS’s

placement policy is to put one replica on the local machine if the writer

is on a datanode, otherwise on a random datanode, another replica on a

node in a different (remote) rack, and the last on a different node in

the same remote rack. This policy cuts the inter-rack write traffic which

generally improves write performance. The chance of rack failure is far

less than that of node failure; this policy does not impact data

reliability and availability guarantees. However, it does reduce the

aggregate network bandwidth used when reading data since a block is

placed in only two unique racks rather than three. With this policy, the

replicas of a file do not evenly distribute across the racks. One third

of replicas are on one node, two thirds of replicas are on one rack, and

the other third are evenly distributed across the remaining racks. This

policy improves write performance without compromising data reliability

or read performance.(2)源码说明

Crtl + n 查找 BlockPlacementPolicyDefault,在该类中查找 chooseTargetInOrder 方法。

2)Hadoop3.1.3 副本节点选择

第一个副本在Client所处的节点上。如果客户端在集群外,随机选一个。

第二个副本在另一个机架的随机一个节点

第三个副本在第二个副本所在机架的随机节点

4.2 HDFS 读数据流程

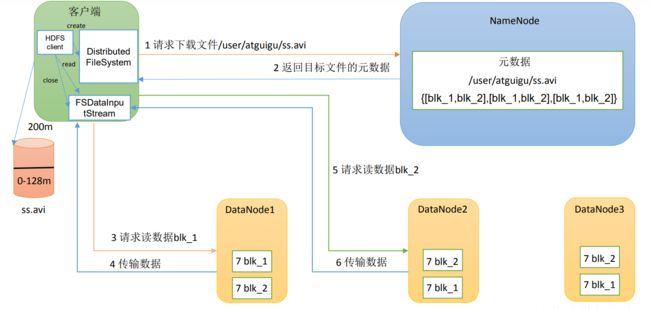

HDFS的读数据流程

(1)客户端通过 DistributedFileSystem 向 NameNode 请求下载文件,NameNode 通过查询元数据,找到文件块所在的 DataNode 地址。

(2)挑选一台 DataNode(就近原则,然后随机)服务器,请求读取数据。

(3)DataNode 开始传输数据给客户端(从磁盘里面读取数据输入流,以 Packet 为单位来做校验)。

(4)客户端以 Packet 为单位接收,先在本地缓存,然后写入目标文件。(在读取资源时是串行读入的先把blk1读完再读blk2然后再进行拼接)

第 5 章 NameNode 和 SecondaryNameNode

5.1 NN 和 2NN 工作机制

思考:NameNode 中的元数据是存储在哪里的?

首先,我们做个假设,如果存储在 NameNode 节点的磁盘中,因为经常需要进行随机访问,还有响应客户请求,必然是效率过低。因此,元数据需要存放在内存中。**但如果只存在内存中,一旦断电,元数据丢失,整个集群就无法工作了。因此产生在磁盘中备份元数据的FsImage。**

这样又会带来新的问题,当在内存中的元数据更新时,如果同时更新 FsImage,就会导致效率过低,但如果不更新,就会发生一致性问题,一旦 NameNode 节点断电,就会产生数据丢失。**因此,引入 Edits 文件(只进行追加操作,效率很高)。每当元数据有更新或者添加元数据时,修改内存中的元数据并追加到 Edits 中**。**这样,一旦 NameNode 节点断电,可以通过 FsImage 和 Edits 的合并,合成元数据。**

但是,如果长时间添加数据到 Edits 中,会导致该文件数据过大,效率降低,而且一旦断电,恢复元数据需要的时间过长。因此,需要定期进行 FsImage 和 Edits 的合并,如果这个操作由NameNode节点完成,又会效率过低。因此,引入一个新的节点SecondaryNamenode,专门用于 FsImage 和 Edits 的合并。NameNode工作机制

1)第一阶段:NameNode 启动

(1)第一次启动 NameNode 格式化后,创建 Fsimage 和 Edits 文件。如果不是第一次启动,直接加载编辑日志和镜像文件到内存。

(2)客户端对元数据进行增删改的请求。

(3)NameNode 记录操作日志,更新滚动日志。

(4)NameNode 在内存中对元数据进行增删改。

2)第二阶段:Secondary NameNode 工作

(1)Secondary NameNode 询问 NameNode 是否需要 CheckPoint。直接带回 NameNode是否检查结果。

(2)Secondary NameNode 请求执行 CheckPoint。

(3)NameNode 滚动正在写的 Edits 日志。

(4)将滚动前的编辑日志和镜像文件拷贝到 Secondary NameNode。

(5)Secondary NameNode 加载编辑日志和镜像文件到内存,并合并。

(6)生成新的镜像文件 fsimage.chkpoint。

(7)拷贝 fsimage.chkpoint 到 NameNode。

(8)NameNode 将 fsimage.chkpoint 重新命名成 fsimage。

5.2 Fsimage 和 Edits 解析

Fsimage和Edits概念

NameNode被格式化之后,将在/opt/module/hadoop-3.1.3/data/tmp/dfs/name/current(这个目录不一定存在在)目录中产生如下文件:

(1)Fsimage文件:HDFS文件系统元数据的一个永久性的检查点,其中包含HDFS文件系统的所有目录和文件inode的序列化信息。

(2)Edits文件:存放HDFS文件系统的所有更新操作的路径,文件系统客户端执行的所有写操作首先会被记录到Edits文件中。

(3)seen_txid文件保存的是一个数字,就是最后一个edits_的数字

(4)每 次NameNode启动的时候都会将Fsimage文件读入内存,加 载Edits里面的更新操作,保证内存(5)中的元数据信息是最新的、同步的,可以看成NameNode启动的时候就将Fsimage和Edits文件进行了合并。

1)oiv 查看 Fsimage 文件

(1)查看 oiv 和 oev 命令

[atguigu@hadoop102 current]$ hdfs

oiv apply the offline fsimage viewer to an fsimage

oev apply the offline edits viewer to an edits file

(2)基本语法

**hdfs oiv -p 文件类型 -i 镜像文件 -o 转换后文件输出路径**(3)案例实操

/opt/module/hadoop-3.1.3/data/dfs/name/current(都在这个目录)

[atguigu@hadoop102 current]$ pwd

/opt/module/hadoop-3.1.3/data/dfs/name/current

[atguigu@hadoop102 current]$ hdfs oiv -p XML -i fsimage_0000000000000000025 -o /opt/module/hadoop-3.1.3/fsimage.xml

[atguigu@hadoop102 current]$ cat /opt/module/hadoop-3.1.3/fsimage.xml将显示的 xml 文件内容拷贝到 Idea 中创建的 xml 文件中,并格式化。部分显示结果如下。

16386

DIRECTORY

user

1512722284477

atguigu:supergroup:rwxr-xr-x

-1

-1

16387

DIRECTORY

atguigu

1512790549080

atguigu:supergroup:rwxr-xr-x

-1

-1

16389

FILE

wc.input

3

1512722322219

1512722321610

134217728

atguigu:supergroup:rw-r--r--

1073741825

1001

59

思考:可以看出,Fsimage 中没有记录块所对应 DataNode,为什么?

在集群启动后,要求 DataNode 上报数据块信息,并间隔一段时间后再次上报。

2)oev 查看 Edits 文件

(1)基本语法

**hdfs oev -p 文件类型 -i 编辑日志 -o 转换后文件输出路径**(2)案例实操

[atguigu@hadoop102 current]$ hdfs oev -p XML -i

edits_0000000000000000012-0000000000000000013 -o /opt/module/hadoop3.1.3/edits.xml

[atguigu@hadoop102 current]$ cat /opt/module/hadoop-3.1.3/edits.xml将显示的 xml 文件内容拷贝到 Idea 中创建的 xml 文件中,并格式化。显示结果如下。

-63

OP_START_LOG_SEGMENT

129

OP_ADD

130

0

16407

/hello7.txt

2

1512943607866

1512943607866

134217728

DFSClient_NONMAPREDUCE_-

1544295051_1

192.168.10.102

true

atguigu

supergroup

420

908eafd4-9aec-4288-96f1-

e8011d181561

0

OP_ALLOCATE_BLOCK_ID

131

1073741839

OP_SET_GENSTAMP_V2

132

1016

MapReduce详解

第 1 章 MapReduce 概述

1.1 MapReduce 定义

MapReduce 是一个分布式运算程序的编程框架,是用户开发“基于 Hadoop 的数据分析应用”的核心框架。

MapReduce 核心功能是将用户编写的业务逻辑代码和自带默认组件整合成一个完整的分布式运算程序,并发运行在一个 Hadoop 集群上。

1.2 MapReduce 优缺点

1.2.1 优点

1)MapReduce 易于编程

它简单的实现一些接口,就可以完成一个分布式程序,这个分布式程序可以分布到大量廉价的 PC 机器上运行。也就是说你写一个分布式程序,跟写一个简单的串行程序是一模一样的。就是因为这个特点使得MapReduce 编程变得非常流行。2)良好的扩展性

当你的计算资源不能得到满足的时候,你可以通过简单的增加机器来扩展它的计算能力。

3)高容错性

MapReduce 设计的初衷就是使程序能够部署在廉价的 PC 机器上,这就要求它具有很高的容错性。比如其中一台机器挂了,它可以把上面的计算任务转移到另外一个节点上运行,不至于这个任务运行失败,而且这个过程不需要人工参与,而完全是由 Hadoop 内部完成的。

4)适合 PB 级以上海量数据的离线处理

可以实现上千台服务器集群并发工作,提供数据处理能力。

1.2.2 缺点

1)不擅长实时计算

MapReduce 无法像 MySQL 一样,在毫秒或者秒级内返回结果。

2)不擅长流式计算

流式计算的输入数据是动态的,而 MapReduce 的输入数据集是静态的,不能动态变化。这是因为 MapReduce 自身的设计特点决定了数据源必须是静态的。

3)不擅长 DAG(有向无环图)计算

多个应用程序存在依赖关系,后一个应用程序的输入为前一个的输出。在这种情况下,MapReduce 并不是不能做,而是使用后,每个 MapReduce 作业的输出结果都会写入到磁盘,会造成大量的磁盘 IO,导致性能非常的低下。

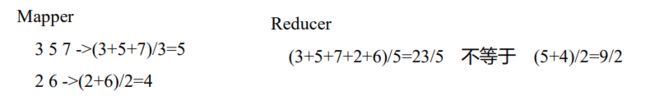

1.3 MapReduce 核心思想

MapReduce核心编程思想

(1)分布式的运算程序往往需要分成至少 2 个阶段。

(2)第一个阶段的 MapTask 并发实例,完全并行运行,互不相干。

(3)第二个阶段的 ReduceTask 并发实例互不相干,但是他们的数据依赖于上一个阶段的所有 MapTask 并发实例的输出。

(4)MapReduce 编程模型只能包含一个 Map 阶段和一个 Reduce 阶段,如果用户的业务逻辑非常复杂,那就只能多个 MapReduce 程序,串行运行。

总结:分析 WordCount 数据流走向深入理解 MapReduce 核心思想。

1.4 MapReduce 进程

一个完整的 MapReduce 程序在分布式运行时有三类实例进程:

**(1)MrAppMaster:**负责整个程序的过程调度及状态协调。

**(2)MapTask:**负责 Map 阶段的整个数据处理流程。

**(3)ReduceTask:**负责 Reduce 阶段的整个数据处理流程。

1.5 官方 WordCount 源码

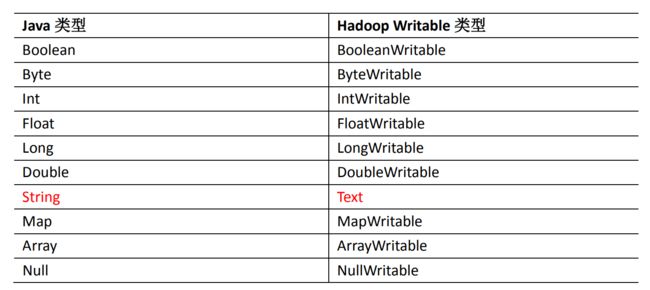

采用反编译工具反编译源码,发现 WordCount 案例有 Map 类、Reduce 类和驱动类。且数据的类型是 Hadoop 自身封装的序列化类型。

1.6 常用数据序列化类型

*1.7 MapReduce 编程规范

用户编写的程序分成三个部分:Mapper、Reducer 和 Driver。

MapReduce编程规范

1.Mapper阶段

(1)用户自定义的Mapper要继承自己的父类(也就是Mapper类)

(2)Mapper的输入数据是KV对的形式(KV的类型可自定义)

(3)Mapper中的业务逻辑写在map()方法中

(4)Mapper的输出数据是KV对的形式(KV的类型可自定义)

(5)map()方法(MapTask进程)对每一个

2.Reducer阶段

(1)用户自定义的Reducer要继承自己的父类(也就是Reducer类)

(2)Reducer的输入数据类型对应Mapper的输出数据类型,也是KV

(3)Reducer的业务逻辑写在reduce()方法中

(4)ReduceTask进程对每一组相同k的

3.Driver阶段

相当于YARN集群的客户端,用于提交我们整个程序到YARN集群,提交的是封装了MapReduce程序相关运行参数的job对象

1.8 WordCount 案例实操

1.8.1 本地测试

需求:统计一堆文件中单词出现的个数(WordCount案例)

1、Mapper

// 3.1 将MapTask传给我们的文本内容先转换成String

atguigu atguigu

// 3.2 根据空格将这一行切分成单词

atguiguatguigu

// 3.3 将单词输出为<单词,1>

2、Reducer

// 4.1 汇总各个key的个数

atguigu, 1atguigu, 1

// 4.2 输出该key的总次数

atguigu, 2

3、Driver

// 5.1 获取配置信息,获取job对象实例

// 5.3 关联Mapper/Reducer业务类

// 5.4 指定Mapper输出数据的kv类型

// 5.5 指定最终输出的数据的kv类型

// 5.6 指定job的输入原始文件所在目录

// 5.7 指定job的输出结果所在目录

// 5.2 指定本程序的jar包所在的本地路径

// 5.8 提交作业

(1)创建一个maven工程 ,导入以下的依赖

org.apache.hadoop

hadoop-client

3.1.3

junit

junit

4.12

org.slf4j

slf4j-log4j12

1.7.30

(2)在项目的 src/main/resources 目录下,新建一个文件,命名为“log4j.properties”,在文件中填入。(配置好日志文件)

log4j.rootLogger=INFO, stdout

log4j.appender.stdout=org.apache.log4j.ConsoleAppender

log4j.appender.stdout.layout=org.apache.log4j.PatternLayout

log4j.appender.stdout.layout.ConversionPattern=%d %p [%c] - %m%n

log4j.appender.logfile=org.apache.log4j.FileAppender

log4j.appender.logfile.File=target/spring.log

log4j.appender.logfile.layout=org.apache.log4j.PatternLayout

log4j.appender.logfile.layout.ConversionPattern=%d %p [%c] - %m%n(3)创建包名:com.learn.mapreduce

4)编写程序

(1)编写 Mapper 类

package com.learn.mapreduce;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Mapper;

import java.io.IOException;

/**

* KEYIN:map阶段输入的key类型:LongWritable

* VALUEIN:map阶段输入的value类型:Text

* KEYOUT:map阶段输出的value类型:Text

* VALUEOUT:map阶段输出的value类型:IntWritable

* @author Lucaslee

* @create 2022-12-09 15:04

*/

public class WordCountMapper extends Mapper {

private Text outKey = new Text();

private IntWritable outValue=new IntWritable(1);

@Override

protected void map(LongWritable key, Text value, Mapper.Context context) throws IOException, InterruptedException {

//1.获取一行

String line = value.toString();

//2.切割(用空格切割)

String[] words = line.split(" ");

//3.循环写出

for(String word:words){

//将word封装到hadoop体系的,text类型中

outKey.set(word);

//写出(key,value)--->(hadoop,1)

context.write(outKey,outValue);

}

}

}

(2)编写 Reducer 类

package com.learn.mapreduce;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Reducer;

import java.io.IOException;

/**

* KEYIN:Reduce阶段输入的key类型:Text

* VALUEIN:Reduce阶段输入的value类型:IntWritable

* KEYOUT:Reduce阶段输出的value类型:Text

* VALUEOUT:Reduce阶段输出的value类型:IntWritable

* @author Lucaslee

* @create 2022-12-09 15:04

*/

public class WordCountReduce extends Reducer {

private IntWritable outV=new IntWritable(0);

//重写reduce

//传进来的值

//lucas,(1,1..)

//ss,(1,1,1..)

@Override

protected void reduce(Text key, Iterable values, Reducer.Context context) throws IOException, InterruptedException {

int sum=0;

for (IntWritable value:values){

//value.get() 是将IntWritable转化成int类型

sum+=value.get();

}

//将int型转化成IntWritable

outV.set(sum);

context.write(key,outV);

}

}

(3)编写 Driver 驱动类

package com.learn.mapreduce;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

/**

* @author Lucaslee

* @create 2022-12-09 15:03

*/

public class WordCountDriver {

public static void main(String[] args) throws Exception {

//1.获取job

Configuration conf = new Configuration();

Job job = Job.getInstance(conf);

//2.设置jar包路径(通过全类名反射获取当前jar包的位置)

job.setJarByClass(WordCountDriver.class);

//3.关联mapper和reduce

job.setMapperClass(WordCountMapper.class);

job.setReducerClass(WordCountReduce.class);

//4.设置mapper输出的k-v类型

job.setMapOutputKeyClass(Text.class);

job.setMapOutputValueClass(IntWritable.class);

//5.设置最终输出的k-v类型

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(IntWritable.class);

//6.设置输入路径和输出路径

FileInputFormat.setInputPaths(job,new Path(args[0]));

FileOutputFormat.setOutputPath(job,new Path(args[1]));

//提交job

boolean result = job.waitForCompletion(true);

System.exit(result?0:1);

}

}

运行,进行debug测试,多测试几遍。

1.8.2 提交到集群测试

集群上测试

(1)用 maven 打 jar 包,需要添加的打包插件依赖

maven-compiler-plugin

3.6.1

1.8

1.8

maven-assembly-plugin

jar-with-dependencies

make-assembly

package

single

注意:如果工程上显示红叉。在项目上右键->maven->Reimport 刷新即可。

(2)将程序打成 jar 包

(3)将jar包上传到集群中。

(4)在集群中执行我们自定义的 WordCount 程序

hadoop jar wc.jar jar包的全类名 (输入路径)/input (输出路径)/output

第 2 章 Hadoop 序列化

2.1 序列化概述

1)什么是序列化

序列化就是把内存中的对象,转换成字节序列(或其他数据传输协议)以便于存储到磁盘(持久化)和网络传输。

反序列化就是将收到字节序列(或其他数据传输协议)或者是磁盘的持久化数据,转换成内存中的对象。

2)为什么要序列化

一般来说,“活的”对象只生存在内存里,关机断电就没有了。而且“活的”对象只能由本地的进程使用,不能被发送到网络上的另外一台计算机。 然而序列化可以存储“活的”对象,可以将“活的”对象发送到远程计算机。

3)为什么不用 Java 的序列化

Java 的序列化是一个重量级序列化框架(Serializable),一个对象被序列化后,会附带很多额外的信息(各种校验信息,Header,继承体系等),不便于在网络中高效传输。所以,Hadoop 自己开发了一套序列化机制(Writable)。

4)Hadoop 序列化特点:

(1)紧凑 :高效使用存储空间。

(2)快速:读写数据的额外开销小。

(3)互操作:支持多语言的交互

2.2 自定义 bean 对象实现序列化接口(Writable)

在企业开发中往往常用的基本序列化类型不能满足所有需求,比如在 Hadoop 框架内部传递一个 bean 对象,那么该对象就需要实现序列化接口。

具体实现 bean 对象序列化步骤如下 7 步。

(1)必须实现 Writable 接口

(2)反序列化时,需要反射调用空参构造函数,所以必须有空参构造

public FlowBean() {

super();

}

(3)重写序列化方法

@Override

public void write(DataOutput out) throws IOException {

out.writeLong(upFlow);

out.writeLong(downFlow);

out.writeLong(sumFlow);

}

(4)重写反序列化方法

@Override

public void readFields(DataInput in) throws IOException {

upFlow = in.readLong();

downFlow = in.readLong();

sumFlow = in.readLong();

}(5)注意反序列化的顺序和序列化的顺序完全一致

(6)要想把结果显示在文件中,需要重写 toString(),可用"\t"分开,方便后续用。

**(7)如果需要将自定义的 bean 放在 key 中传输,则还需要实现 Comparable 接口,因为MapReduce 框中的 Shuffle 过程要求对 key 必须能排序。**详见后面排序案例。

@Override

public int compareTo(FlowBean o) {

// 倒序排列,从大到小

return this.sumFlow > o.getSumFlow() ? -1 : 1;

}2.3 序列化案例实操

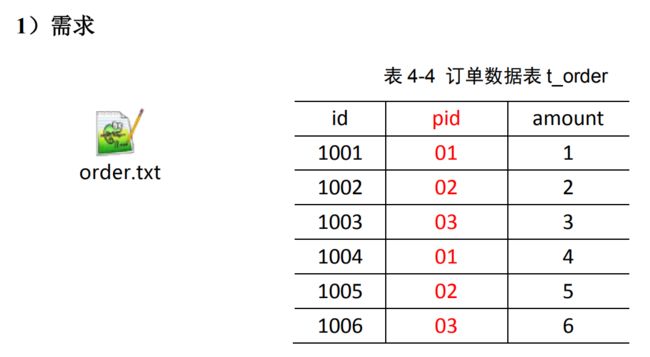

1)需求

统计每一个手机号耗费的总上行流量、总下行流量、总流量

输入数据格式:

期望输出数据格式:

2)需求分析

序列化案例分析

3)编写 MapReduce 程序

(1)编写流量统计的 Bean 对象

package com.learn.mapreduce.wtitable;

import org.apache.hadoop.io.Writable;

import java.io.DataInput;

import java.io.DataOutput;

import java.io.IOException;

/**

* 编写流量统计的 Bean 对象

* @author Lucaslee

* @create 2022-12-10 9:53

*/

//1 继承 Writable 接口

public class FlowBean implements Writable {

private long upFlow;//上行流量

private long dwnFlow;//下行流量

private long sumFlow;//总流量

//2 空参构造器

public FlowBean(){

}

//3 提供三个参数的 getter 和 setter 方法

public long getUpFlow() {

return upFlow;

}

public long getDwnFlow() {

return dwnFlow;

}

public long getSumFlow() {

return sumFlow;

}

public void setUpFlow(long upFlow) {

this.upFlow = upFlow;

}

public void setDwnFlow(long dwnFlow) {

this.dwnFlow = dwnFlow;

}

public void setSumFlow(long sumFlow) {

this.sumFlow = sumFlow;

}

//业务逻辑决定

public void setSumFlow() {

this.sumFlow = this.dwnFlow+this.upFlow;

}

//实现接口要重写的两个接口

//进行序列化

@Override

public void write(DataOutput dataOutput) throws IOException {

dataOutput.writeLong(upFlow);

dataOutput.writeLong(dwnFlow);

dataOutput.writeLong(sumFlow);

}

//序列化顺序一旦确定,反序列化顺序也要跟其一致

//反序列化

@Override

public void readFields(DataInput dataInput) throws IOException {

this.upFlow=dataInput.readLong();

this.dwnFlow=dataInput.readLong();

this.sumFlow=dataInput.readLong();

}

//重写toString方法

@Override

public String toString() {

return upFlow+"\t"+dwnFlow+ "\t" + sumFlow;

}

}

(2)编写 Mapper 类

package com.learn.mapreduce.wtitable;

import com.sun.javafx.collections.MappingChange;

import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Mapper;

import java.io.IOException;

/**

* @author Lucaslee

* @create 2022-12-10 10:18

*/

//继承mapper类

public class FlowMapper extends Mapper {

private Text outKey=new Text();

private FlowBean outValue=new FlowBean();

//重写mapper方法

@Override

protected void map(LongWritable key, Text value, Mapper.Context context) throws IOException, InterruptedException {

//1.获取一行

String line = value.toString();

//2.数据切割

String[] word = line.split("\t");

//3.抓取自己想要的数据

String phone = word[1];

String upFile = word[word.length-3];

String dwnFile = word[word.length-2];

//4.封装输出的Key-value

outKey.set(phone);

outValue.setUpFlow(Long.parseLong(upFile));

outValue.setDwnFlow(Long.parseLong(dwnFile));

outValue.setSumFlow();

//将k-v写出(下一步交给reduce)

context.write(outKey,outValue);

}

}

(3)编写 Reducer 类

package com.learn.mapreduce.wtitable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Reducer;

import java.io.IOException;

/**

* @author Lucaslee

* @create 2022-12-10 10:49

*/

public class FlowReduce extends Reducer {

private FlowBean outValue=new FlowBean();

@Override

protected void reduce(Text key, Iterable values, Reducer.Context context) throws IOException, InterruptedException {

//1.遍历集合累加值(上下行流量)

long totalUp = 0;//上行流量总和

long totalDwn = 0;//下行流量总和

for (FlowBean value:values){

totalUp+= value.getUpFlow();

totalDwn+= value.getDwnFlow();

}

//2.封装输出的ourKey,outValue

outValue.setUpFlow(totalUp);

outValue.setDwnFlow(totalDwn);

outValue.setSumFlow();

//写出

context.write(key,outValue);

}

}

(4)编写 Driver 驱动类

package com.learn.mapreduce.wtitable;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

import java.io.IOException;

/**

* @author Lucaslee

* @create 2022-12-10 11:06

*/

public class FlowDriver {

public static void main(String[] args) throws IOException, InterruptedException, ClassNotFoundException {

//1.获取对象

Configuration conf = new Configuration();

Job job = Job.getInstance(conf);

//2.设置jar包(反射)

job.setJarByClass(FlowDriver.class);

//3.关联mapper,reduce

job.setMapperClass(FlowMapper.class);

job.setReducerClass(FlowReduce.class);

//4.设置mapper,输出的key-value的类型

job.setMapOutputKeyClass(Text.class);

job.setMapOutputValueClass(FlowBean.class);

//5.设置最终数据输出key-value类型

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(FlowBean.class);

//6.设置数据的输入路劲和输出路径

FileInputFormat.setInputPaths(job,new Path("E:\\Learn\\input"));

FileOutputFormat.setOutputPath(job,new Path("E:\\Learn\\output"));

//7.提交作业

boolean b = job.waitForCompletion(true);

System.exit(b?0:1);

}

}

第 3 章 MapReduce 框架原理

3.1 InputFormat 数据输入

3.1.1 切片与 MapTask 并行度决定机制

1)问题引出

MapTask 的并行度决定 Map 阶段的任务处理并发度,进而影响到整个 Job 的处理速度。

思考:1G 的数据,启动 8 个 MapTask,可以提高集群的并发处理能力。那么 1K 的数据,也启动 8 个 MapTask,会提高集群性能吗?MapTask 并行任务是否越多越好呢?哪些因素影响了 MapTask 并行度?

2)MapTask 并行度决定机制

数据块:Block 是 HDFS 物理上把数据分成一块一块。数据块是 HDFS 存储数据单位。

数据切片:数据切片只是在逻辑上对输入进行分片,并不会在磁盘上将其切分成片进行存储。**数据切片是 MapReduce 程序计算输入数据的单位,**一个切片会对应启动一个 MapTask。

3.1.2 Job 提交流程源码和切片源码详

1)Job 提交流程源码详解

waitForCompletion()

submit();

// 1 建立连接

connect();

// 1)创建提交 Job 的代理

new Cluster(getConfiguration());

// (1)判断是本地运行环境还是 yarn 集群运行环境

initialize(jobTrackAddr, conf);

// 2 提交 job

submitter.submitJobInternal(Job.this, cluster)

// 1)创建给集群提交数据的 Stag 路径

Path jobStagingArea = JobSubmissionFiles.getStagingDir(cluster, conf);

// 2)获取 jobid ,并创建 Job 路径

JobID jobId = submitClient.getNewJobID();

// 3)拷贝 jar 包到集群

copyAndConfigureFiles(job, submitJobDir);

rUploader.uploadFiles(job, jobSubmitDir);

// 4)计算切片,生成切片规划文件

writeSplits(job, submitJobDir);

maps = writeNewSplits(job, jobSubmitDir);

input.getSplits(job);

// 5)向 Stag 路径写 XML 配置文件

writeConf(conf, submitJobFile);

conf.writeXml(out);

// 6)提交 Job,返回提交状态

status = submitClient.submitJob(jobId, submitJobDir.toString(),job.getCredentials());Job提交流程源码解析

2)FileInputFormat 切片源码解析(input.getSplits(job))

(1)程序先找到你数据存储的目录。

(2)开始遍历处理(规划切片)目录下的每一个文件

(3)遍历第一个文件ss.txt

a)获取文件大小fs.sizeOf(ss.txt)

b)计算切片大小

computeSplitSize(Math.max(minSize,Math.min(maxSize,blocksize)))=blocksize=128M**c)默认情况下,切片大小=blocksize**

d)开始切,形成第1个切片:ss.txt—0:128M 第2个切片ss.txt—128:256M 第3个切片ss.txt—256M:300M(**每次切片时,都要判断切完剩下的部分是否大于块的1.1倍,不大于1.1倍就划分一块切片**)

e)将切片信息写到一个切片规划文件中

f)整个切片的核心过程在getSplit()方法中完成

g)**InputSplit只记录了切片的元数据信息**,比如起始位置、长度以及所在的节点列表等。(4)提交切片规划文件到YARN上,YARN上的MrAppMaster就可以根据切片规划文件计算开启MapTask个数。

3.1.3 FileInputFormat 切片机制

1、切片机制

(1)简单地按照文件的内容长度进行切片

(2)切片大小,默认等于Block大小

(3)切片时不考虑数据集整体,而是逐个针对每一个文件单独切片

2、案例分析

(1)源码中计算切片大小的公式

Math.max(minSize, Math.min(maxSize, blockSize));

mapreduce.input.fileinputformat.split.minsize=1 默认值为1

mapreduce.input.fileinputformat.split.maxsize= Long.MAXValue 默认值Long.MAXValue因此,默认情况下,切片大小=blocksize。

(2)切片大小设置

**maxsize(切片最大值):**参数如果调得比blockSize小,则会让切片变小,而且就等于配置的这个参数的值。

**minsize(切片最小值):**参数调的比blockSize大,则可以让切片变得比blockSize还大。

(3)获取切片信息API

// 获取切片的文件名称

String name = inputSplit.getPath().getName();

// 根据文件类型获取切片信息

FileSplit inputSplit = (FileSplit) context.getInputSplit();3.1.4 TextInputFormat

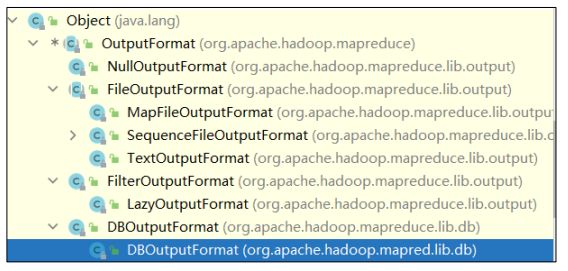

1)FileInputFormat 实现类

思考:在运行 MapReduce 程序时,输入的文件格式包括:基于行的日志文件、二进制格式文件、数据库表等。那么,针对不同的数据类型,MapReduce 是如何读取这些数据的呢?

FileInputFormat 常见的接口实现类包括:**TextInputFormat、**KeyValueTextInputFormat、NLineInputFormat、CombineTextInputFormat 和自定义 InputFormat 等。

2)TextInputFormat

TextInputFormat 是默认的 FileInputFormat 实现类。按行读取每条记录。键是存储该行在整个文件中的起始字节偏移量, LongWritable 类型。值是这行的内容,不包括任何行终止符(换行符和回车符),Text 类型。以下是一个示例,比如,一个分片包含了如下 4 条文本记录。

Rich learning form

Intelligent learning engine

Learning more convenient

From the real demand for more close to the enterprise每条记录表示为以下键/值对:

(0,Rich learning form)

(20,Intelligent learning engine)

(49,Learning more convenient)

(74,From the real demand for more close to the enterprise)3.1.5 CombineTextInputFormat 切片机制

框架默认的 TextInputFormat 切片机制是对任务按文件规划切片,**不管文件多小,都会是一个单独的切片,都会交给一个 MapTask,**这样如果有大量小文件,就会产生大量的MapTask,处理效率极其低下。

1)应用场景:

CombineTextInputFormat 用于小文件过多的场景,它可以将多个小文件从逻辑上规划到一个切片中,这样,多个小文件就可以交给一个 MapTask 处理。

2)虚拟存储切片最大值设置

CombineTextInputFormat.setMaxInputSplitSize(job, 4194304);// 4m

注意:虚拟存储切片最大值设置最好根据实际的小文件大小情况来设置具体的值。

3)切片机制

生成切片过程包括:虚拟存储过程和切片过程二部分。

(1)虚拟存储过程:

将输入目录下所有文件大小,依次和设置的 setMaxInputSplitSize 值比较,如果不大于设置的最大值,逻辑上划分一个块。如果输入文件大于设置的最大值且大于两倍,那么以最大值切割一块;当剩余数据大小超过设置的最大值且不大于最大值 2 倍,此时将文件均分成 2 个虚拟存储块(防止出现太小切片)。

例如 setMaxInputSplitSize 值为 4M,输入文件大小为 8.02M,则先逻辑上分成一个4M。剩余的大小为 4.02M,如果按照 4M 逻辑划分,就会出现 0.02M 的小的虚拟存储文件,所以将剩余的 4.02M 文件切分成(2.01M 和 2.01M)两个文件。

(2)切片过程:

(a)判断虚拟存储的文件大小是否大于 setMaxInputSplitSize 值,大于等于则单独形成一个切片。

(b)如果不大于则跟下一个虚拟存储文件进行合并,共同形成一个切片。

(c)测试举例:有 4 个小文件大小分别为 1.7M、5.1M、3.4M 以及 6.8M 这四个小文件,则虚拟存储之后形成 6 个文件块,大小分别为:

1.7M,(2.55M、2.55M),3.4M 以及(3.4M、3.4M)最终会形成 3 个切片,大小分别为:(1.7+2.55)M,(2.55+3.4)M,(3.4+3.4)M

3.1.6 CombineTextInputFormat 案例实操

1)需求

将输入的大量小文件合并成一个切片统一处理。(1)输入数据准备 4 个小文件

(2)期望

期望一个切片处理 4 个文件

2)实现过程

(1)不做任何处理,运行 1.8 节的 WordCount 案例程序,观察切片个数为 4。

number of splits:4(2)在 WordcountDriver 中增加如下代码,运行程序,并观察运行的切片个数为 3。

(a)驱动类中添加代码如下:

// 如果不设置 InputFormat,它默认用的是 TextInputFormat.class

job.setInputFormatClass(CombineTextInputFormat.class);

//虚拟存储切片最大值设置 4m

CombineTextInputFormat.setMaxInputSplitSize(job, 4194304);(b)运行如果为 3 个切片。

number of splits:3(3)在 WordcountDriver 中增加如下代码,运行程序,并观察运行的切片个数为 1。

(a)驱动中添加代码如下:

// 如果不设置 InputFormat,它默认用的是 TextInputFormat.class

job.setInputFormatClass(CombineTextInputFormat.class);

//虚拟存储切片最大值设置 20m

CombineTextInputFormat.setMaxInputSplitSize(job, 20971520);(b)运行如果为 1 个切片

number of splits:1

3.2 MapReduce 工作流程

MapReduce详细工作流程

MapReduce详细工作流程(续上)

上面的流程是整个 MapReduce 最全工作流程,但是 Shuffle 过程只是从第 7 步开始到第16 步结束,具体 Shuffle 过程详解,如下:

(1)MapTask 收集我们的 map()方法输出的 kv 对,放到内存缓冲区中

(2)从内存缓冲区不断溢出本地磁盘文件,可能会溢出多个文件

(3)多个溢出文件会被合并成大的溢出文件

(4)在溢出过程及合并的过程中,都要调用 Partitioner 进行分区和针对 key 进行排序

(5)ReduceTask 根据自己的分区号,去各个 MapTask 机器上取相应的结果分区数据

(6)ReduceTask 会抓取到同一个分区的来自不同 MapTask 的结果文件,ReduceTask 会将这些文件再进行合并(归并排序)

(7)合并成大文件后,Shuffle 的过程也就结束了,后面进入 ReduceTask 的逻辑运算过程(从文件中取出一个一个的键值对 Group,调用用户自定义的 reduce()方法)

注意:

(1)Shuffle 中的缓冲区大小会影响到 MapReduce 程序的执行效率,原则上说,缓冲区越大,磁盘 io 的次数越少,执行速度就越快。

(2)缓冲区的大小可以通过参数调整,参数:mapreduce.task.io.sort.mb 默认 100M。

*3.3 Shuffle 机制

Map 方法之后,Reduce 方法之前的数据处理过程称之为 Shuffle。

3.3.1 Shuffle机制

3.3.2 Partition 分区

1、问题引出

要求将统计结果按照条件输出到不同文件中(分区)。比如:将统计结果按照手机归属地不同省份输出到不同文件中(分区)

2、默认Partitioner分区

public class HashPartitioner extends Partitioner {

public int getPartition(K key, V value, int numReduceTasks) {

return (key.hashCode() & Integer.MAX_VALUE) % numReduceTasks;

}

}

//默认分区是根据key的hashCode对ReduceTasks个数取模得到的。用户没法控制哪个key存储到哪个分区。 3、自定义Partitioner步骤

(1)自定义类继承Partitioner,重写getPartition()方法

package com.learn.mapreduce.Partition;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Partitioner;

/**

* 分区规则

* @author Lucaslee

* @create 2022-12-12 11:42

*/

public class ProvincePartitioner extends Partitioner {

@Override

public int getPartition(Text text, FlowBean flowBean, int i) {

//Text是手机号

String phone = text.toString();

//截取手机前三位

String prePhone = phone.substring(0, 3);

int partition;

if("136".equals(prePhone)){

partition=0;

} else if ("137".equals(prePhone)) {

partition=1;

} else if ("138".equals(prePhone)) {

partition=2;

} else if ("139".equals(prePhone)) {

partition=3;

}else {

partition=4;

}

return partition;

}

}

(2)在Job驱动类中,设置自定义Partitioner

job.setPartitionerClass(ProvincePartitioner.class);(3)自定义Partition后,要根据自定义Partitioner的逻辑设置相应数量的ReduceTask

job.setNumReduceTasks(5);package com.learn.mapreduce.Partition;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

import java.io.IOException;

/**

* @author Lucaslee

* @create 2022-12-10 11:06

*/

public class FlowDriver {

public static void main(String[] args) throws IOException, InterruptedException, ClassNotFoundException {

//1.获取对象

Configuration conf = new Configuration();

Job job = Job.getInstance(conf);

//2.设置jar包(反射)

job.setJarByClass(FlowDriver.class);

//3.关联mapper,reduce

job.setMapperClass(FlowMapper.class);

job.setReducerClass(FlowReduce.class);

//4.设置mapper,输出的key-value的类型

job.setMapOutputKeyClass(Text.class);

job.setMapOutputValueClass(FlowBean.class);

//5.设置最终数据输出key-value类型

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(FlowBean.class);

//设置启用自定义的分区规则

job.setPartitionerClass(ProvincePartitioner.class);

job.setNumReduceTasks(5);

//6.设置数据的输入路劲和输出路径

FileInputFormat.setInputPaths(job,new Path("E:\\Learn\\input"));

FileOutputFormat.setOutputPath(job,new Path("E:\\Learn\\output_1"));

//7.提交作业

boolean b = job.waitForCompletion(true);

System.exit(b?0:1);

}

}

4、分区总结

(1)如果ReduceTask的数量> getPartition的结果数,则会多产生几个空的输出文件part-r-000xx;