2023 Unite 大会关于“Muse“ AI 大模型训练

Unity Muse 借助强大的 AI 能力帮助你探索、构思和迭代,其中包括纹理和精灵两项功能,可将自然语言和视觉输入转化为可用资产。

将 AI 引入 Unity Editor 中的 Muse 提供了更快将想法转化为实物的选项。您可以调整并使用文本提示、图案、颜色和草图,将其转化为真实且项目准备就绪的输出。

为了提供有用、负责任和尊重其他创作者版权的输出,我们挑战自己在 Muse 的精灵和纹理生成 AI 模型训练方法上进行创新。

在本文中,我们分享了 Muse 如何生成结果,解构我们的模型训练方法,并介绍我们的两个新基础模型。

训练AI模型

在我们推出Muse的Texture和Sprite功能的同时,我们还创新了两个专有的扩散模型,每个模型都从零开始,在Unity拥有或授权的专用数据上进行训练。

扩展我们的自有内容库

为了增强我们数据集的规模和多样性,我们采用了一种关键技术——数据增强,使我们能够从原始 Unity 拥有的数据样本中产生许多变异。这极大地丰富了我们的训练集,并提高了模型从有限样本中进行泛化的能力。我们还使用了一些技术,如几何变换、色彩空间调整、噪声注入和生成模型(如稳定扩散)的样本变异,以人工扩展我们的数据集。

最近,稳定扩散模型因为最初是在从互联网上抓取的数据上进行训练而引发了伦理担忧。在构建 Muse 的纹理和精灵功能过程中,我们尽量减少对预训练模型的依赖,从零开始在 Unity 拥有并负责任地策展的原始数据集上训练潜在的扩散模型架构。通过将稳定扩散模型作为数据增强技术的一部分,我们能够安全地利用这个模型,将原始的 Unity 拥有的资产库扩展为一个强大且多样化的输出库,这些输出具有独特性、原创性,且不包含任何受版权保护的艺术风格。在此基础上,我们还采取了额外的缓解措施,如下所述。支撑 Muse 纹理和精灵功能的潜在扩散模型的训练数据集并未包含从互联网上抓取的任何数据。

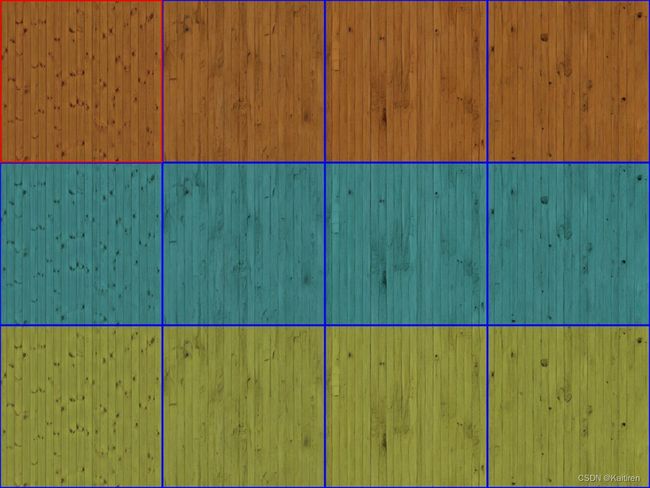

以下是一些通过上述增强技术扩展的内容示例。

一个原始数据样本(左上角)以及通过混合多种增强技术获得的结果合成变异,包括基于扰动的技术(从上到下:色彩空间调整)和基于生成的技术(从左到右)

在增强现有数据后,我们仍在许多主题上发现了空白,需要填补。为了实现这一目标,我们在自己的内容上训练了稳定扩散模型,直到其行为发生显著变化。然后,我们使用这些派生模型,根据预过滤的主题列表创建了全新的合成数据。这个主题列表经过人类审查和额外的大型语言模型(LLM)自动过滤,以确保我们不会试图创建任何违反我们指导原则和目标的合成图像:一个完全不含可识别的艺术风格、受版权保护的材料和潜在有害内容的数据集。

结果是两个大型数据集,包括增强和完全合成的图像,我们对此有很高的信心,认为这两个数据集中不会包含不想要的概念。然而,尽管我们非常有信心,但我们仍然希望添加更多的过滤以确保模型的安全性。

额外的数据过滤以确保安全且有用的输出

由于我们的主要任务是确保安全、隐私和使我们的工具不会产生负面影响,因此我们开发了四个独立的分类器模型,它们负责对数据集进行额外的过滤。这些模型有助于确保数据集中的所有内容都符合我们的人工智能指导原则,以及对图像质量的额外检查。

这四个评审模型共同负责确定合成图像:

- 不包含任何可识别的人类特征

- 不包含任何非通用的艺术风格

- 不包含任何知识产权的人物或标志

- 质量可以达到可接受水平

如果一张图像没有通过四个评审模型中的任何一个所要求的高置信度阈值,那么它将被丢弃在我们的数据集中。我们决定采取谨慎的立场,并使我们的模型倾向于拒绝,以便只有具有最高置信度的图像才能通过过滤器并进入最终数据集。

Muse Modle:Photo-Real-Unity-Texture-1 和 Photo-Real-Unity-Sprite-1

在 2023 Unite 活动中,我们宣布了 Muse 的纹理和精灵功能的早期访问。驱动这些工具的第一个模型的内部版本分别称为 Photo-Real-Unity-Texture-1 和 Photo-Real-Unity-Sprite-1。这些模型仅具有基本的装饰理解,主要专注于照片写实风格。

此外,如果您想让模型匹配您项目中现有的风格,可以通过向我们风格训练系统提供少量您自己的参考资产来教导我们的模型以创建特定艺术风格的内容。这将创建一个与主模型协同工作的较小二次模型,以引导其输出。这个小二次模型对于您或您组织来说是私有的,因为它是由训练师训练的,我们永远不会使用这个内容来训练我们的主模型。

由于我们的模型专注于照片写实风格,因此我们无需在无数不同的风格上训练主模型。这种架构使我们在保持对负责任的人工智能承诺的同时,为您提供了深入的艺术控制。

今天,这些模型只是开始。我们期望 Muse 能够继续变得更聪明,并提供更好的输出,我们将通过模型改进路线图来引导这些模型走上这一道路。

Photo-Real-Unity-Texture-1 roadmap

目前,我们的纹理模型在各个方面都非常出色。它掌握了许多概念,您可以在纹理模型中自由混合完全无关的概念,并获得美丽的结果,如“金属史莱姆”或“蓝色水晶玻璃岩石”,如上所示。

尽管模型在当前状态下非常出色,但在学习它对不同提示和输入方式的反应后,我们发现使用单个单词提示可能难以实现高级材料概念。除了基本的提示准确性外,我们还计划通过添加新的指导模型方式来为您提供更多控制。

在未来,我们计划添加颜色选择器、额外的预制指导图案、改进的自定义指导图案创建系统,以及其他新的视觉输入方法,我们目前正在实验。

展望未来,我们 Photo-Real-Unity-Texture-1 的主要关注点是确定任何弱的材料概念,并通过频繁的模型重训练来继续提高整体质量和能力。您通过内置评分系统提供的反馈对于帮助我们构建最好的工具至关重要,因为它可以帮助我们确定模型能力的薄弱环节。结合我们频繁的训练计划,我们正在快速改进模型,使其更易于使用并对材料世界更加了解。

Photo-Real-Unity-Sprite-1 roadmap

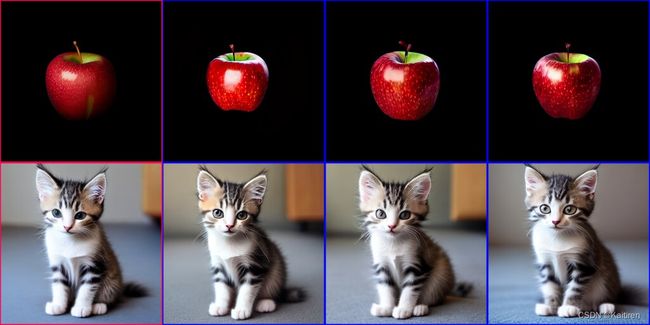

类似于 Photo-Real-Unity-Texture-1,我们的基础精灵模型整体上非常出色,并知道许多概念。由于该工具目前尚未具备内置动画功能,我们选择将初期努力集中在最常见静态精灵概念的质量最大化上。您可以在上面的图片中看到基础模型的原始输出。在正常使用中,这些输出将由用户训练的模型引导,以匹配特定的艺术风格。

虽然静态物体已经非常可靠,但我们仍在努力改进动物和人类的解剖学准确性。在这些类型的主题上,您可能会获得很好的结果,但可能会遇到四肢过多或缺失,或者面部扭曲的情况。这是我们对负责任的人工智能的承诺和严格限制可使用数据所导致的结果。我们非常重视隐私和安全,即使这意味着在初期早期访问版本中某些主题的质量会受到影响。

这是我们致力于负责任的人工智能并对可用数据设置严格限制所导致的结果。我们非常重视隐私和安全,即使在初期早期访问版本中某些主题的质量受到影响,也在所不惜。

您可能会遇到生成的Sprite完全空白的情况。这是因为我们的视觉内容审核过滤器。在 Photo-Real-Unity-Sprite-1 的输出过滤方面,我们选择在初期启动时过于谨慎,因此,某些艺术风格可能会引发审核过滤器的误报。我们计划随着时间的推移,在收到您的反馈并改进内容过滤后,放宽限制。

我们期待着在获取反馈并继续负责任地收集更多数据后,所有主题的质量都会迅速提高。我们打算对 Photo-Real-Unity-Sprite-1 进行与 Photo-Real-Unity-Texture-1 类似的严格训练计划。

统一负责任的AI开发之路

Unity Muse 是我们在负责任和尊重的方式下,利用生成式AI为社区带来更大创意控制的第一步。我们以用户为中心打造这个产品,并计划根据您的反馈不断进行改进和优化。

我们认识到生成式AI对创意行业可能产生的影响,并对此非常重视。我们花费了很长时间开发这些工具,以确保我们不是在取代创作者,而是提升他们的能力。我们相信,世界上有越多创作者,世界就会变得越好,而 Unity Muse 和其背后驱动的模型,正是我们支持这一使命的持续努力。

请关注未来关于 Unity Muse 和 AI 开发的更多信息。如果您对这些产品有任何疑问,请查看我们网站上的 FAQ,或访问 Discussions与我们直接交流。

如果您是从 Unite 2023 过来的,我们将在未来几周内分享活动的录像。您可以在这里找到完整的报道。