微服务学习|初识elasticsearch、操作索引库、文档操作、RestClient操作索引库、RestClient操作文档

初识elasticsearch

什么是elasticsearch?

elasticsearch是一款非常强大的开源搜索引擎,可以帮助我们从海量数据中快速找到需要的内容。

elasticsearch结合kibana、Logstash、Beats,也就是elastic stack (ELK)。被广泛应用在日志数据分析、实时监控等领域

elasticsearch是elastic stack的核心,负责存储、搜索、分析数据

elasticsearch的发展

Lucene是一个java语言的搜索引擎类库,是Apache公司的顶级项目,由DougCutting于1999年研发官网地址: https://lucene.apache.org/

2004年shay Banon基于Lucene开发了Compass

2010年shay Banon 重写了Compass,取名为Elasticsearch。

官网地址: https://www.elastic.co/cn/,它的优点就是能够被任何语言调用,发送http请求即可

正向索引和倒排索引

传统数据库(如MySQL)采用正向索引,例如给下表 (tb_goods)中的id创建索引

![]()

elasticsearch采用倒排索引:

文档(document):每条数据就是一个文档

词条(term):文档按照语义分成的词语

什么是文档和词条?

每一条数据就是一个文档

对文档中的内容分词,得到的词语就是词条

什么是正向索引?

基于文档id创建索引。查询词条时必须先找到文档,而后判断是否包含词条

什么是倒排索引?

对文档内容分词,对词条创建索引,并记录词条所在文档的信息。查询时先根据词条查询到文档id,而后获取到文档

文档

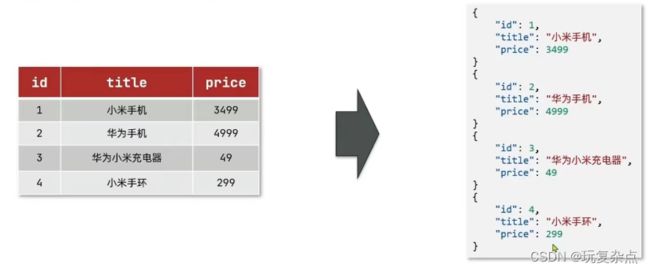

elasticsearch是面向文档存储的,可以是数据库中的一条商品数据,一个订单信息。文档数据会被序列化为json格式后存储在elasticsearch中

索引(Index)

索引(index):相同类型的文档的集合,相当于数据库中的表

映射 (mapping):索引中文档的字段约束信息,类似数据库中表的结构约束

概念对比

架构

Mysql: 擅长事务类型操作,可以确保数据的安全和一致性

Elasticsearch: 擅长海量数据的搜索、分析、计算

部署单点es

1.创建网络

因为我们还需要部署kibana容器,因此需要让es和kibana容器互联。这里先创建一个网络

2.加载镜像

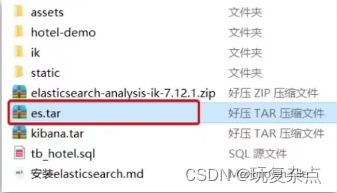

这里我们采用elasticsearch的7.12.1版本的镜像,这个镜像体积非常大,接近1G。不建议大

家自己pull。课前资料提供了镜像的tar包

大家将其上传到虚拟机中,然后运行命令加载即可

同理还有kibana的tar包也需要这样做

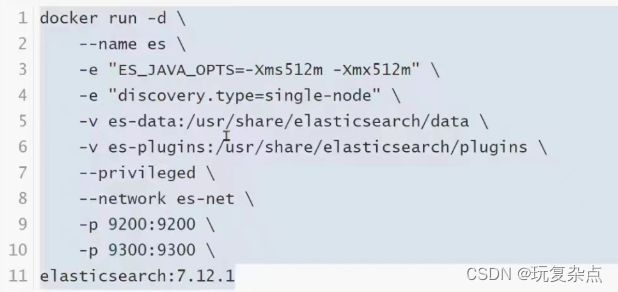

3.运行

运行docker命令,部署单点es

访问本机ip+es的端口号,发现已经可以访问,部署es容器成功

部署kibana

kibana可以给我们提供一个elasticsearch的可视化界面,便于我们学习

部署

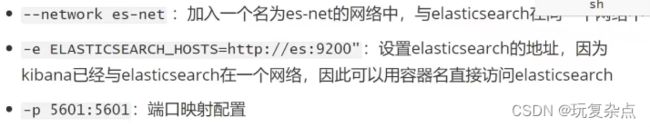

运行docker命令,部署kibana

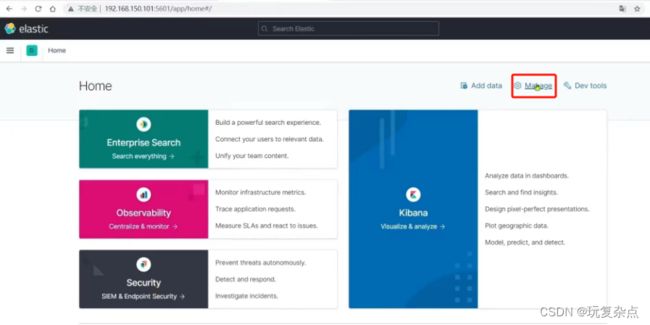

访问本机ip+kibana端口

发现可以访问kibana了,说明容器创建成功

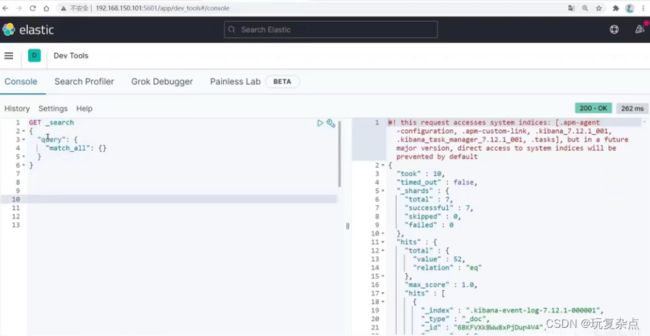

可在控制台编写DSL语句访问es

分词器

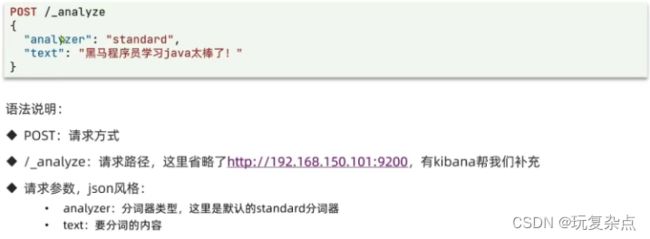

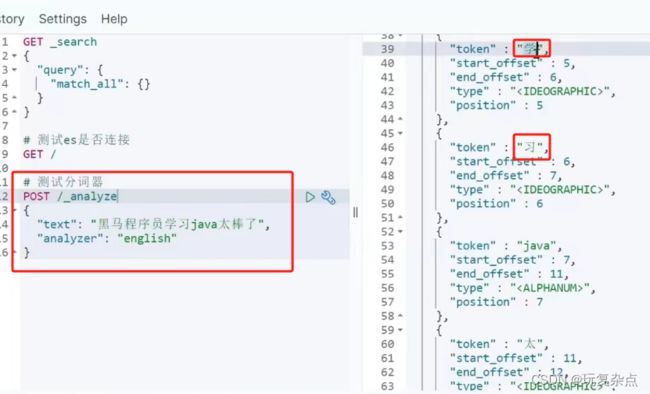

es在创建倒排索引时需要对文档分词;在搜索时,需要对用户输入内容分词。但默认的分词规则对中文处理并不友好。我们在kibana的DevTools中测试

可以看到自带的分词器对中文的处理并不友好,都是一个字一个字的分

处理中文分词,一般会使用IK分词器。https://github.com/medcl/elasticsearch-analysis-ik

安装IK分词器,参考课前资料《安装elasticsearch.md》

1.查看数据卷目录

安装插件需要知道elasticsearch的plugins目录位置,而我们用了数据卷挂载,因此需要查看elasticsearch的数据卷目录,通过下面命令查看

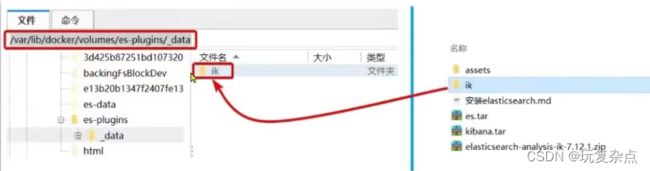

显示结果,说明plugins目录被挂载到了:/var/1ib/docker/volumes/es-plugins/_data这个目录中

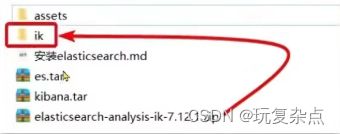

2.解压缩分词器安装包

下面我们需要把课前资料中的ik分词器解压缩,重命名为ik

3.上传到es容器的插件数据卷中

也就是/var/Tib/docker/voTumes/es-plugins/_data

4.重启容器

5.测试

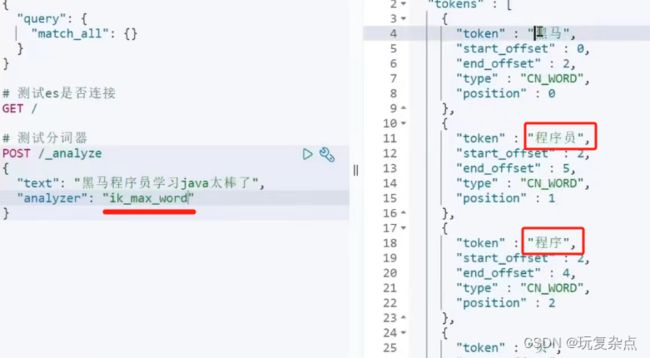

IK分词器包含两种模式,ik_smart:最少切分,ik_max_word:最细切分

可以看到使用ik_smart方式进行分词后,中文词语被成功切分,不再是一个一个字的被分开

使用ik_max_word方式分词,则比如“程序员”被分开了,然而“程序”也是一个词,就依然被弄成了一个词条

比如说,网络上流行的一些新的词汇,比如“奥力给”我们也想将它弄成一个词条,ik分词器识别不出来怎么办呢?用ik分词器-拓展词库解决。

ik分词器-拓展词库

要拓展ik分词器的词库,只需要修改一个ik分词器目录中的config目录中的IkAnalyzer.cfg.xml文件

在ext.dic文件中添加想要拓展的词语即可,如果没有该文件,则在该目录下新建一个

ik分词器-停用词库

要禁用某些敏感词条,只需要修改一个ik分词器目录中的config目录中的IkAnalyzer.cfg.xml文件

在stopword.dic文件中添加想要停用的词语即可

重启es容器

重新测试,我们可以看到我们添加的新的词汇被ik分词器识别,分成了独立的词条

分词器的作用是什么?

创建倒排索引时对文档分词

用户搜索时,对输入的内容分词

IK分词器有几种模式?

ik smart:智能切分,粗粒度

ik max word:最细切分,细粒度

IK分词器如何拓展词条?如何停用词条?

利用config目录的IkAnalyzer.cfg.xml文件添加拓展词典和停用词典

在词典中添加拓展词条或者停用词条

操作索引库

mapping属性

mapping是对索引库中文档的约束,常见的mapping属性包括

type:字段数据类型,常见的简单类型有:

字符串:text (可分词的文本)、keyword (精确值,例如:品牌、国家、ip地址)数值: long、integer、short、byte、double、float、布尔: boolean、日期: date、对象:object

index:是否创建索引,默认为true

analvzer:使用哪种分词器

properties:该字段的子字段

创建索引库

ES中通过Restful请求操作索引库、文档。请求内容用DSL语句来表示。创建索引库和mapping的DSL语法如下

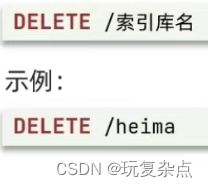

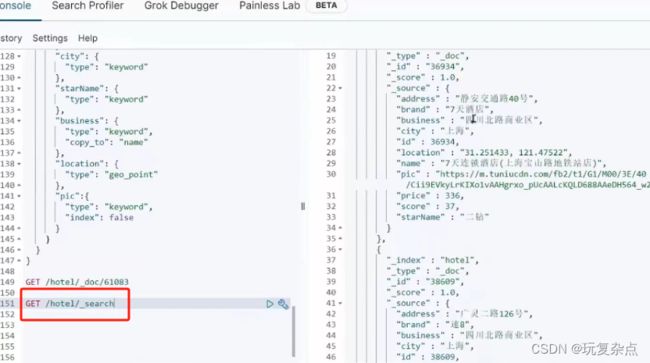

查看、删除索引库

查看索引库语法

删除索引库的语法

修改索引库

索引库和mapping一旦创建无法修改,但是可以添加新的字段,语法如下

文档操作

添加文档

新增文档的DSL语法如下

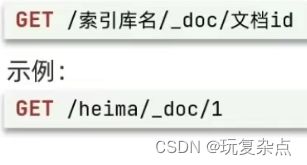

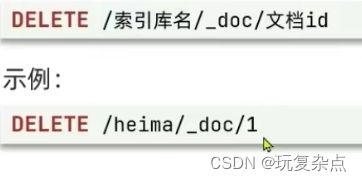

查看、删除文档

查看文档语法

删除文档的语法

修改文档

方式一:全量修改,会删除旧文档,添加新文档

方式二:增量修改,修改指定字段值

RestClient操作索引库

什么是RestClient?

ES官方提供了各种不同语言的客户端,用来操作ES。这些客户端的本质就是组装DSL语句,通过http请求发送给ES。官方文档地址: https://www.elastic.co/guide/en/elasticsearch/client/index.html

案例:利用JavaRestClient实现创建、删除索引库,判断索引库是否存在

根据课前资料提供的酒店数据创建索引库,索引库名为hotel,mapping属性根据数据库结构定义。基本步骤如下:

1,导入课前资料Demo

2.分析数据结构,定义mapping属性

3.初始化avaRestClient

4.利用JavaRestClient创建索引库

5.利用JavaRestClient删除索引库

6.利用JavaRestClient判断索引库是否存在

步骤1: 导入课前资料Demo

首先导入课前资料提供的数据库数据

然后导入课前资料提供的项目

该项目已经提供好了对上述表的增删改查等一些基本操作

步骤2: 分析数据结构

mapping要考虑的问题:

字段名、数据类型、是否参与搜索、是否分词、如果分词,分词器是什么

根据数据库中该表的字段约束,编写这个索引库的mapping约束

在最后创建一个all,可以用来将所有分词查询的字段添加其中

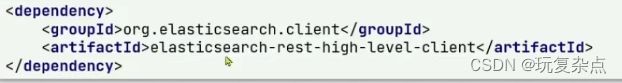

步骤3: 初始化JavaRestClient

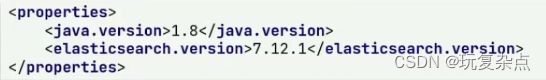

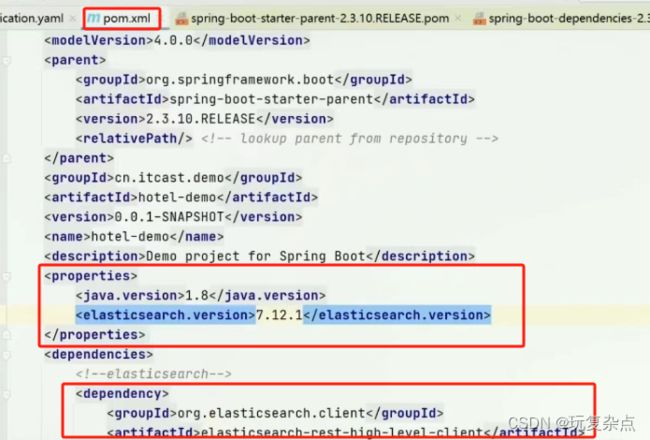

1.引入es的RestHighLevelclient依赖

2.因为SpringBoot默认的ES版本是7.6.2,所以我们需要覆盖默认的ES版本

3.初始化RestHighLevelClient

创建一个测试类,在启动前初始化RestHighLevelClient,结束后,关闭该客户端资源

步骤4:创建索引库

创建索引库代码如下

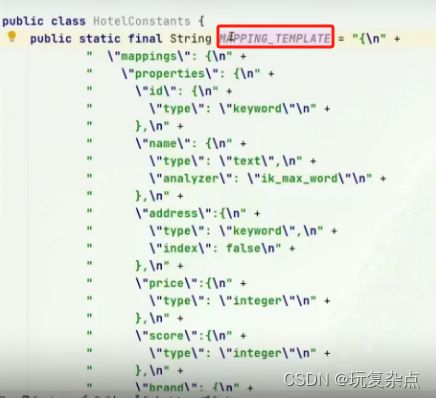

创建一个常量类,在里面定义静态变量MAPPING_TEMPLATE,也就是创建索引库的DSL语句

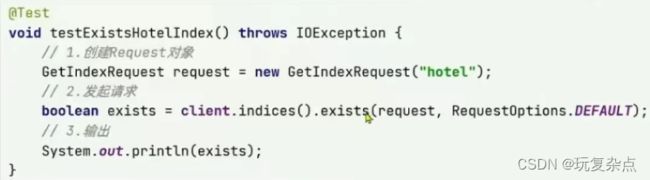

步骤5: 删除索引库、判断索引库是否存在

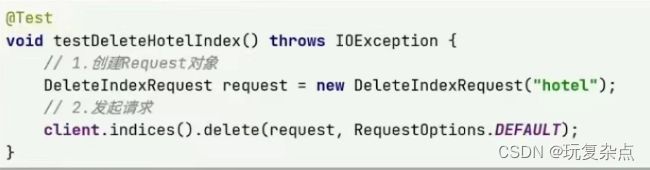

删除索引库代码如下

判断索引库是否存在

RestClient操作文档

案例:利用JavaRestClient实现文档的CRUD

去数据库查询酒店数据,导入到hotel索引库,实现酒店数据的CRUD基本步骤如下:

1.初始化JavaRestClient

2.利用JavaRestClient新增酒店数据

3.利用avaRestClient根据id查询酒店数据

4.利用JavaRestClient删除酒店数据

5.利用lavaRestClient修改酒店数据

步骤1:初始化JavaRestClient

创建一个测试类,在启动前初始化RestHighLevelClient,结束后,关闭该客户端资源

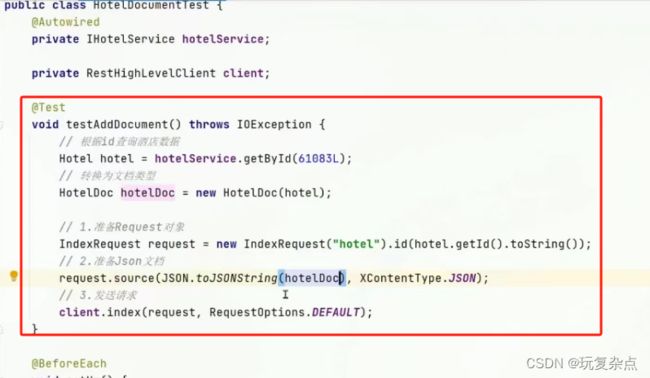

步骤2: 添加酒店数据到索引库

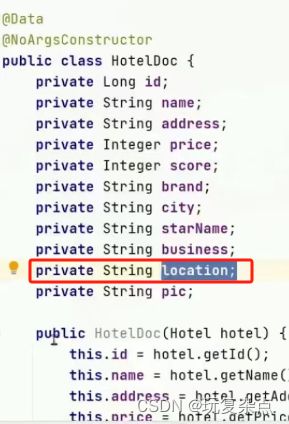

先查询酒店数据,然后给这条数据创建倒排索引,即可完成添加

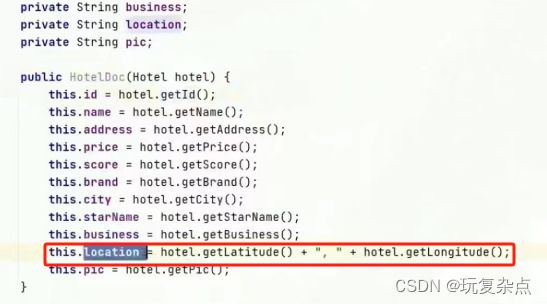

添加到es索引库中的酒店数据,里面的坐标与数据库中的不一致,我们需要构建一个构造器,来让数据库中的类转换成要存入索引库中的这个类

将数据库中查询到的酒店数据,添加到es索引库中去的代码如下

运行后,我们去查询该文档,可以查询出结果,说明添加到索引库成功

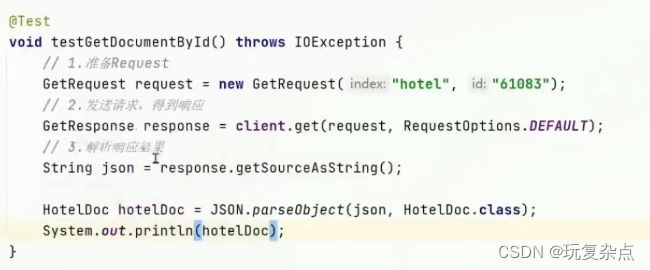

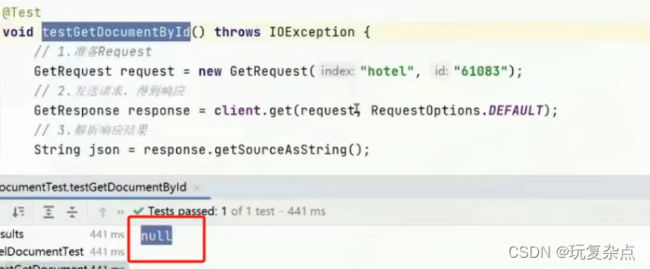

步骤3: 根据id查询酒店数据

根据id查询到的文档数据是json,需要反序列化为java对象

运行后,控制台输出结果

步骤4: 根据id修改酒店数据

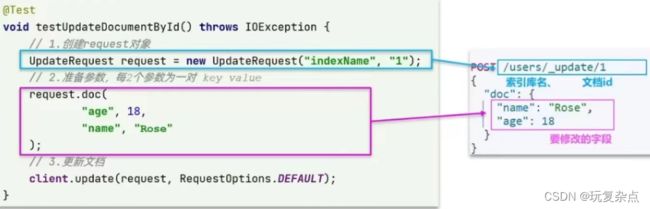

修改文档数据有两种方式:

方式一:全量更新。再次写入id一样的文档,就会删除旧文档,添加新文档

方式二:局部更新。只更新部分字段,我们演示方式二

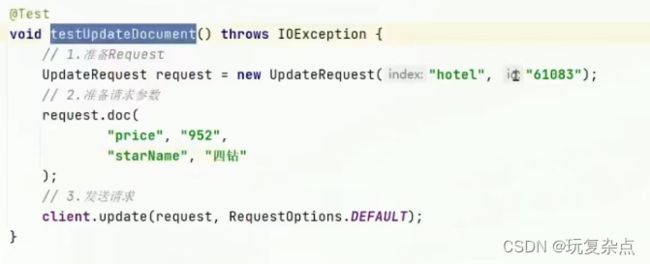

修改文档数据代码如下

再次调用根据id查询酒店数据的方法,发现查询出的数据的price和starName已经被修改

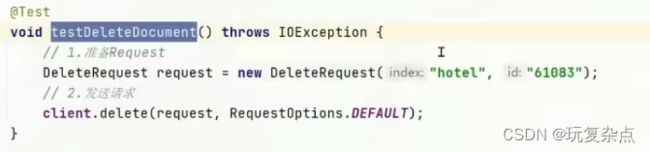

步骤5: 根据id删除文档数据

删除文档代码如下

demo中删除文档代码如下

再调用根据id查询酒店数据的方法,发现该条文档已经查询不到,说明删除成功

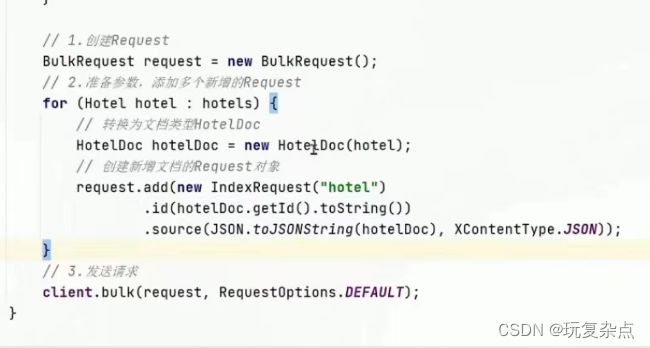

案例:利用JavaRestClient批量导入酒店数据到ES

需求:批量查询酒店数据,然后批量导入索引库中

思路:

1.利用mybatis-plus查询酒店数据

2.将查询到的酒店数据 (Hotel) 转换为文档类型数据 (HotelDoc)

3,利用JavaRestClient中的Bulk批处理,实现批量新增文档,示例代码如下

demo中的具体代码如下

查询hotel索引库的全部内容,发现所有酒店数据信息已经被导入进来