搭建神经网络(六步法)

https://www.bilibili.com/video/BV1B7411L7Qt?spm_id_from=333.1007.top_right_bar_window_custom_collection.content.click

文章目录

- 六步法

-

- 一,import:导入相关模块

- 二,train, test:划分训练集与测试集

- 三,搭建网络结构逐层描述网络,相当于走了一次前向传播

-

- 1,拉直层:tf.keras.layers.Flatten( )

-

- 1.1描述

- 1.2举例

- 2,全连接层tf.keras.layers.Dense()

- 3,卷积层(CBAPD)tf.keras.layers.Conv2D()

-

- 3.1经典卷积网络

- 3.2描述

- 3.3CBAPD

- 4, 循环核tf.keras.layers.SimpleRNN()

- 四,五,六,

六步法

一,import:导入相关模块

二,train, test:划分训练集与测试集

三,搭建网络结构逐层描述网络,相当于走了一次前向传播

1,拉直层:tf.keras.layers.Flatten( )

1.1描述

用于将输入层的数据压成一维的数据,一般用再卷积层和全连接层之间(因为全连接层只能接收一维数据,而卷积层可以处理二维数据,就是全连接层处理的是向量,而卷积层处理的是矩阵)

1.2举例

input=keras.layers.Input(shape=[28,28])

layers_Flatten=keras.layers.Flatten(input_shape=[28,28])(input)

layers1=keras.layers.Dense(100,activation='relu')(layers_Flatten)

layers2=keras.layers.Dense(200,activation='relu')(layers1)

layers3=keras.layers.Dense(100,activation='relu')(layers2)

output=keras.layers.Dense(10,activation='softmax')(layers3)

model=keras.models.Model(inputs=[input], outputs=[output])

2,全连接层tf.keras.layers.Dense()

tf.keras.layers.Dense(神经元个数, activation= "激活函数“ ,kernel_regularizer=哪种正则化)

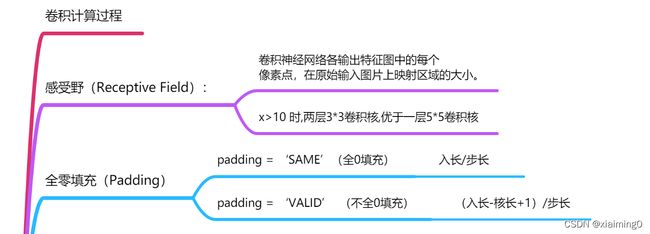

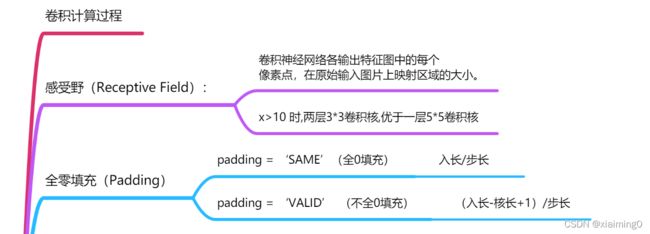

3,卷积层(CBAPD)tf.keras.layers.Conv2D()

3.1经典卷积网络

3.2描述

特点:卷积计算可认为是一种有效提取图像特征的方法

原理:一般会用一个正方形的卷积核,按指定步长,在输入特征图上滑动,遍历输入特征图中的每个像素 点。每一个步长,卷积核会与输入特征图出现重合区域,重合区域对应元素相乘、求和再加上偏置项得到输出特征的一个像素点。

示例:

self.c1 = Conv2D(filters=6, kernel_size=(5, 5), padding='same')

self.b1 = BatchNormalization() # BN层

self.a1 = Activation('relu') # 激活层

self.p1 = MaxPool2D(pool_size=(2, 2), strides=2, padding='same')

self.d1 = Dropout(0.2) # dropout层

self.flatten = Flatten()

self.f1 = Dense(128, activation='relu')

self.d2 = Dropout(0.2)

self.f2 = Dense(10, activation='softmax')

3.3CBAPD

model = tf.keras.models.Sequential([

C Conv2D(filters=6, kernel_size=(5, 5), padding='same'), # 卷积层

B BatchNormalization(), # 批标准化(Batch Normalization, BN)

A Activation('relu'), # 激活层

P MaxPool2D(pool_size=(2, 2), strides=2, padding='same'), # 池化(Pooling)池化用于减少特征数据量

D Dropout(0.2), # 舍弃,dropout层

])

B:

A:

对于初学者的建议:

1,首选relu激活函数;

2, 学习率设置较小值;

3,输入特征标准化,即让输入特征满足以0为均值,1为标准差的正态分布;

4, 初始参数中心化,即让随机生成的参数满足以0为均值

P:

最大值池化可保留背景特征

tf.keras.layers.MaxPool2D(

pool_size=池化核尺寸,#正方形写核长整数,或(核高h,核宽w)

strides=池化步长,#步长整数, 或(纵向步长h,横向步长w),默认为pool_size

padding=

"valid" or "same" #使用全零填充是“same”,不使用是“valid”(默认)

)

均值池化可提取图片纹理

tf.keras.layers.AveragePooling2D(

pool_size=池化核尺寸,#正方形写核长整数,或(核高h,核宽w)

strides=池化步长,#步长整数, 或(纵向步长h,横向步长w),默认为pool_size

padding=‘valid’or‘same’ #使用全零填充是“same”,不使用是“valid”(默认)

)

D:

在神经网络训练时,将一部分神经元按照一定概率从神经网络中暂时舍弃。神经网络使用时,被舍弃的神经元恢复链接。

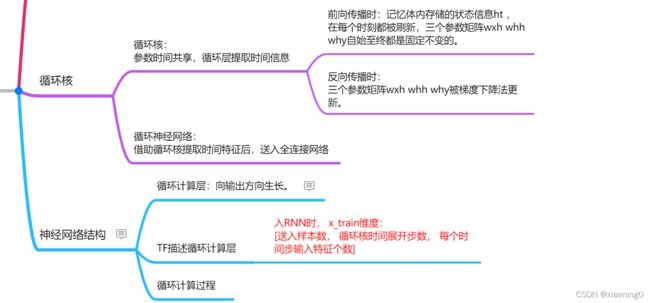

4, 循环核tf.keras.layers.SimpleRNN()

# 使x_train符合SimpleRNN输入要求:[送入样本数, 循环核时间展开步

# 数, 每个时间步输入特征个数]。

# 此处整个数据集送入,送入样本数为len(x_train);输入1个字母出结果,# 循环核时间展开步数为1; 表示为独热码有5个输入特征,每个时间步输入# 特征个数为5

x_train = np.reshape(x_train, (len(x_train), 1, 5))

y_train = np.array(y_train)

model = tf.keras.Sequential([

SimpleRNN(3),

Dense(5, activation='softmax')

])