傅里叶变换

提示:文章写完后,目录可以自动生成,如何生成可参考右边的帮助文档

文章目录

- 摘要

- Abstract

- 文献阅读:人类视频作为机器人学习资料的可供性

-

- 1、研究背景

- 2、方法提出

- 3、方法实现

-

- 3.1、需要解决的三个问题

- 3.2、VRB解决问题的思路

- 3.2.1、功能可供性的可执行方法 -- 接触点和接触后轨迹

- 3.2.2、从人类视频中获取可供性信息

- 3.3、VRB的实现步骤

- 4、实验设置和结果

- 5、结果贡献

- 傅里叶变换

-

- 1、转换的思想

- 2、傅里叶级数

- 3、时域与频域

- 4、傅里叶级数的转换

- 4、连续傅里叶变换

- 5、 二维离散傅里叶变换

- 总结

摘要

本周主要阅读了2023CVPR的文章,人类视频作为机器人学习资料的可供性,在文章中讲解了当前机器人学习人类行为的困难之处,并提出了一种方法视觉机器⼈桥(VRB)方法来解决,其主要思路就是以接触点和接触后轨迹来构建一个机器人能学习的模型,在最终的几个场景测试下,都取得比较好的成绩。除此之外,我还学习了解了傅里叶变换,了解其是如何对函数进行分解的,从傅里叶级数到时域和频域等等相关概念知识,开拓了视野。

Abstract

This week, I primarily focused on reading articles from the 2023 Conference on Computer Vision and Pattern Recognition (CVPR). One paper that stood out was on the availability of human videos as learning materials for robots. The article delved into the current difficulties in robots learning human behaviors and proposed a solution called the Visual Robot Bridge (VRB) method. The main idea of this approach is to construct a model that robots can learn from, using contact points and post-contact trajectories. In the final testing scenarios, this method achieved commendable results.In addition to this, I also delved into understanding Fourier Transforms, exploring how they decompose functions. I familiarized myself with concepts ranging from Fourier series to time and frequency domains, thereby broadening my knowledge horizons.

文献阅读:人类视频作为机器人学习资料的可供性

Title: affordances from human videos as a versatile representation for roboticsn

Author:Shikhar Bahl , Russell Mendonca , Lili Chen1 Unnat Jain , Deepak Pathak

From:2023 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR)

1、研究背景

近年来,建立一个可以通过观察人类来理解和学习互动的机器人激发了人们对这方面的研究。想象⼀下人们站在⼀个全新的厨房⾥。在采取任何⾏动之前,我们已经很好地理解了⼤多数对象应该如何操作,因为我们相信在哪⾥放置物体以及将它们移动到哪个⽅向,从⽽使我们能够与其交互,那能不能让机器人也能实现类似的行为呢?机器人要学习和理解这些行为和交互依然比较难,尽管在交互静态数据集上取得了⼀些成功的结果,得到一个比较理想的人类行为交互模型,但⽬前仍不清楚如何将当前模型直接⽤于机器⼈,因为大多数的机器人的构造与人类不一样,就比如机器臂应该如何模仿人类复杂的行为。

2、方法提出

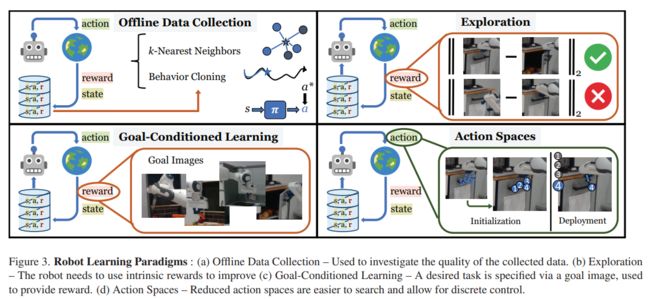

提出一个视觉机器⼈桥(VRB)方法来解决人类与机器人行为之间的转化,其整体的思路是通过以环境为中⼼的⽅式利⽤⼈类互动的视频来弥合这⼀差距。利⽤⼈类⾏为的互联⽹视频,训练了⼀个视觉可供性模型来估计在哪⾥和如何在场景中⼈类可能会进⾏互动。这些⾏为可供性的结构直接使机器⼈能够执⾏许多复杂的任务。通过VRB实现的结果展⽰了如何将我们的可供性模型与四种机器⼈学习范例⽆缝集成,包括离线模仿学习、探索、⽬标条件学习和强化学习的动作参数化,展⽰了我们的⽅法的有效性,其跨越 4 个现实世界环境、10 多个不同的任务以及2个在野外运⾏的机器⼈平台。

3、方法实现

3.1、需要解决的三个问题

最近,随着静态数据集性能的提⾼,该领域越来越多地通过研究以⾃我为中⼼的视觉理解和⼈类互动视频中的视觉可供性。但是先前的可供性学习⽅法主要在⼈类视频数据集上进⾏测试,没有物理机器⼈或野外实验。如果不与机器⼈系统集成,即使是最基本的可供性如何定义或表⽰的问题也仍然没有答案,更不⽤说评估其性能。相反,如果从机器人角度去模仿人来,⼤多数机器⼈学习⽅法,⽆论是模仿还是强化学习,都是接近一个全新的任务或环境。如何缩⼩视觉学习和机器⼈技术之间的明显差距?这个问题可以分为以下三个子问题:

- 一种代表可供性的可执行方的方法法是什么样的?

- 如何以数据驱动和可扩展的⽅式学习这种表⽰?

- 如何调整视觉可供性以跨机器⼈学习范例进⾏部署?

3.2、VRB解决问题的思路

3.2.1、功能可供性的可执行方法 – 接触点和接触后轨迹

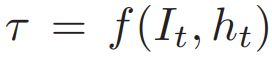

只有当有⾏动者来执⾏可供性时,它们才有意义。例如,只有当某⼈可以坐在椅⼦上时,椅⼦才具有坐姿可供性。要实现以机器人作为中心的模型,采⽤由机器⼈学习需求驱动的第⼀原理⽅法,机器⼈⾝体的知识通常是已知的,因此使⽤运动规划到达 3D 空间中的⼀点是可⾏的 ,困难在于弄清楚如何进⾏交互。受到移动盖子的手势操作的启发,采⽤接触点和接触后轨迹作为视觉可供性的简单可操作表⽰,这样能将模型转移到机器人上。假设用c作为标记,来表示接触点,下面式子来表示整个过程的运行轨迹,其中 It 是t时间的一帧画面图像,ht 则是人手再改图像中的位置,f 则表示的是学习模型。

3.2.2、从人类视频中获取可供性信息

- 接触点信息:为了获得接触点和接触后轨迹,有⼀个双重⽬标,即找到在哪⾥和什么时候接触发⽣了,并估计接触后⼿如何移动。对于每个图像 It 会使用一个手部的2D边界框 ht 和一个和⼀个离散接触变量Ot ,利用肤色检测方法,以及使用这些信息来找到每个视频中的接触部分以及接触出现的时间点 – tcontact ,然后找到每个接触的位置{ ht }t-contact 。除此之外还定义接触点{ci}N,N可能会随着图像、物体、场景和交互类型而变化,为了使接触点相关参数不再变化,定义了一个函数来更好地表示参数点,如下图所示。式子表达的意思使在不同场景下,将所有出现的接触点,与权重相乘,最后进行累加,得到最终所有包含接触带点的结果。

- 接触后轨迹信息:在获得所有的接触点之后,要开始寻找接触后轨迹,因为要从开始接触时间 tcontact 到离开时间 t’会产生一个运动轨迹,通过在时间步使⽤单应矩阵来解决这个过程产生的轨迹,Ht 用于表示将点投影回起始帧的坐标。Ht 是通过匹配连续帧之间的特征来获得单应矩阵,最后的运动轨迹可以由下图的公式来表示。

- 训练损失信息:得到相应的数据信息后,应该如何进行训练呢?通过使⽤同⼀模型预测交互点的多个热图来处理这个问题,构建空间概率分布。首先对输入图像 It 使用ResNet进行卷积操作,然后再将该结果进行逆卷积,将其放到K个可能性区域或热力图中,接着使用空间的SoftMaxca操作,得到最终的可能性,使用真实可能性与该可能性值进行距离计算得到最终的损失值,整个过程可以由下面的公式来表示。

3.3、VRB的实现步骤

- 从收集的离线数据中进⾏模仿学习:根据输入的图像进行数据提取,得到接触点以及接触后轨迹数据,将这些提取到的数据保存到数据库当中。使用 K - Nearest Neighoors 方法来计算它们再特征空间中与目标图像的距离。使用行为克隆方法来获得更多的数据。

- 通过⽆奖励探索去发现更多行为技能:可供性模型可以通过从预测的可供性中引导探索来⾮常有益,从⽽允许代理专注于⼈类可能感兴趣的场景部分。首先使用模型 f (x) 用于数据收集,然后使用与任务无关的探索指标对收集的所有轨迹进⾏排名选择,假如没有好的行为轨迹,则继续使用可供性模型。

- 具体的⽬标条件学习:在获得足够多的可供性数据后,开始以该目标进行学习,不断通过缩短与目标图像的数据进行优化。

- 调整⾏动空间的可供性数据:因为先前得到大量的预测,将 GMM 拟合到这些点以获得⼀组离散的接触点和接触后轨迹信息值,不断搜索相关区间,获得一个较大可能的可供性行为。

4、实验设置和结果

- 机器人设置:使⽤两个不同的机器⼈平台 -Franka Emika Panda ⼿臂和 Hello Stretch 移动机械⼿。在两个不同厨房环境中运⾏ Franka,并测试涉及与橱柜、⼑和⼀些蔬菜交互以及操作架⼦和锅的任务。Hello 机器⼈在实验室环境之外的多项野外任务中进⾏了测试,包括打开垃圾桶、打开盖⼦、打开⻔、拉出抽屉和打开洗碗机等任务。

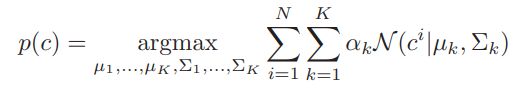

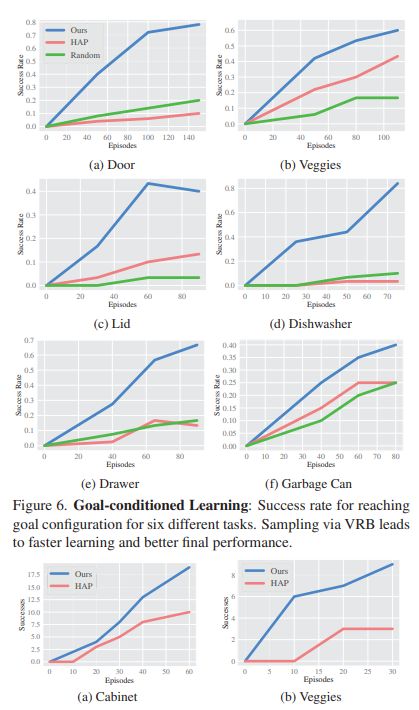

- 实验结果:由下图可以看出,VRB方法比先前的HAP、Random方法的性能都要提高了许多。

5、结果贡献

提出了一种名为视觉机器⼈桥(VRB)的可扩展⽅法,⽤于从被动⼈类视频数据中学习有⽤的可供性,并将其部署在许多不同的机器⼈学习范例上(例如⽤于模仿的数据收集、⽆奖励探索、⽬标条件学习和参数化⾏动空间)。因为目前大多数的机器人结构与人类不一样,难以实现彼此间的数据联系,但这种可供性表⽰由接触点和接触后轨迹组成,这样能有效地将采集到的人类行为数据信息用在机器人训练上。这种⽅法成功在四种范式和 10 种不同的现实世界机器⼈任务(包括许多野外任务)上验证其有效性,而且 VRB 的性能远远优于之前的⽅法。

傅里叶变换

1、转换的思想

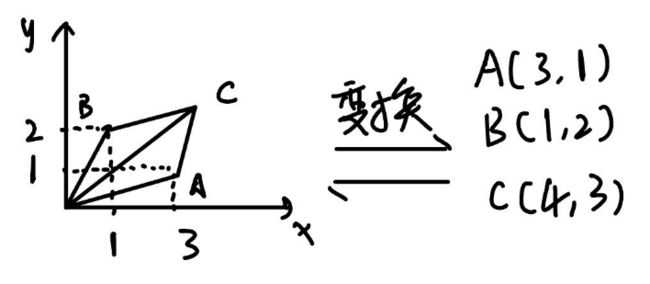

如下图所示,假如有三个点A、B、C,其位置在坐标图中有对应的位置,其中C是A和B的向量和,这三个点在坐标轴的坐标位置可以通过 (x,y) 值来表示。同理知道点的 (x,y) 值便能知道点在坐标轴的位置。这样在一种图像上的位置信息就能使用数值来进行表示。那为什么可以简单地实现这种转换呢?这其中标准正交基为这两者的转化提供了很大的帮助,通过将点投影到标准正交基上就能知道其准确位置。通过标准正交基这个桥梁来构建的转换就是傅里叶变换的重要思想。

2、傅里叶级数

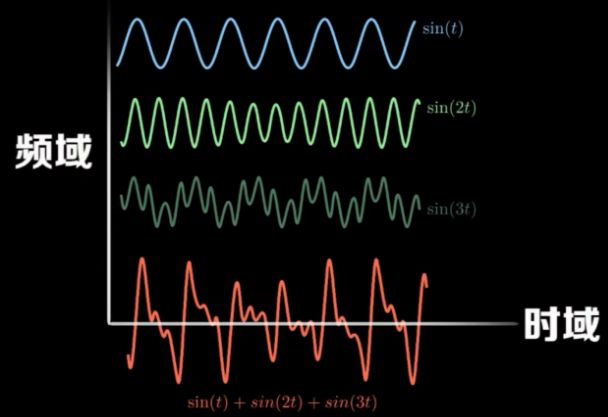

傅里叶级数是一种对周期信号进行分解的方式,其表示所有的周期函数都能由一系列的正(余)弦函数来进行表示的。如下图所示,一个相较复杂的周期函数可以由几个频率不一样的正弦函数来进行合成得到的。

3、时域与频域

时域分析与频域分析是对信号的两个观察面。时域分析是以时间轴为坐标表示动态信号的关系;频域分析是把信号变为以频率轴为坐标表示出来。一般来说,时域的表示较为形象与直观,频域分析则更为简练,剖析问题更为深刻和方便。目前,信号分析的趋势是从时域向频域发展。然而,它们是互相联系,缺一不可,相辅相成的。将上述的函数进行时域与频域的分解,并得到如下图所示的结果。

4、傅里叶级数的转换

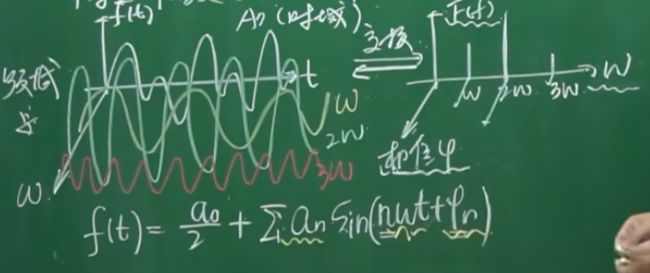

如下图所示,通过傅里叶级数的变换,可以将一个普通的周期函数分解成多个不同的正(余)弦函数,其中这些正(余)弦函数都有着不同的频率以及振幅,这些参数可以理解成在不同的维度的参数,就比如是上述的二维平面的转换,知道两者的参数就能完成两者的转化,即知道原来周期函数,就能拆分成多个不同的正(余)弦函数;同理,知道这些不同的正(余)弦函数,就能知道原来的这个周期函数。

4、连续傅里叶变换

对于非周期的函数可以通过傅里叶变换转换成其他函数集合吗?答案是可以的。选用一组正交基作为作为每一个组成部分特征分解基,最后将所有分解之后的地方利用积分合起来就得到最后的分解函数的集合,当然这个分解函数的集合就如上述提到的频率和振幅之类的特征属性。要根据分解函数来求原函数,只需重新求一次积分即可。

5、 二维离散傅里叶变换

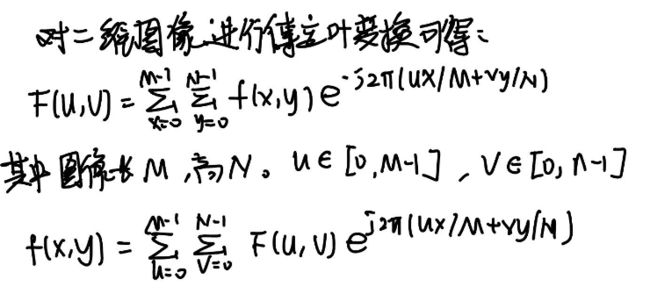

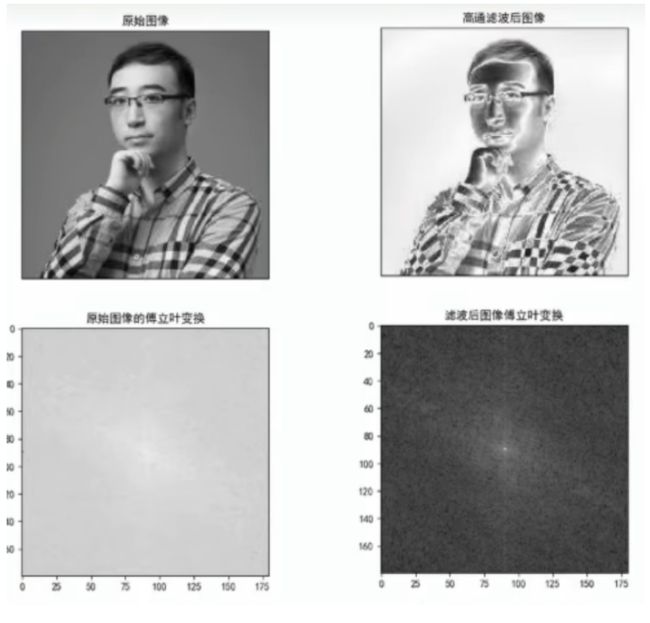

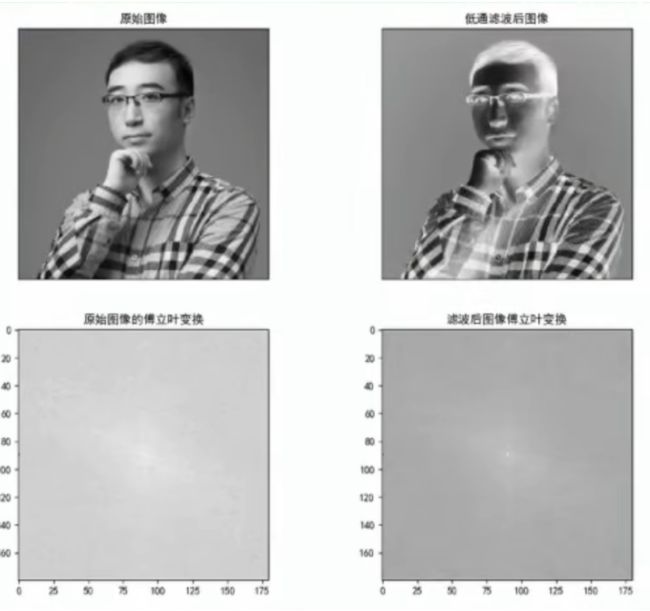

灰度图像是由二维的离散的点构成的。二维离散傅里叶变换(Two-Dimensional Discrete Fourier Transform)常用于图像处理中,对图像进行傅里叶变换后得到其频谱图。频谱图中频率高低表征图像中灰度变化的剧烈程度。图像中边缘和噪声往往是高频信号,而图像背景往往是低频信号。我们在频率域内可以很方便地对图像的高频或低频信息进行操作,完成图像去噪,图像增强,图像边缘提取等操作。

其中对滤去低频信息后可以得到下面的信息

其中对滤去高频信息后可以得到下面的信息

总结

提示:这里对文章进行总结:

例如:以上就是今天要讲的内容,本文仅仅简单介绍了pandas的使用,而pandas提供了大量能使我们快速便捷地处理数据的函数和方法。