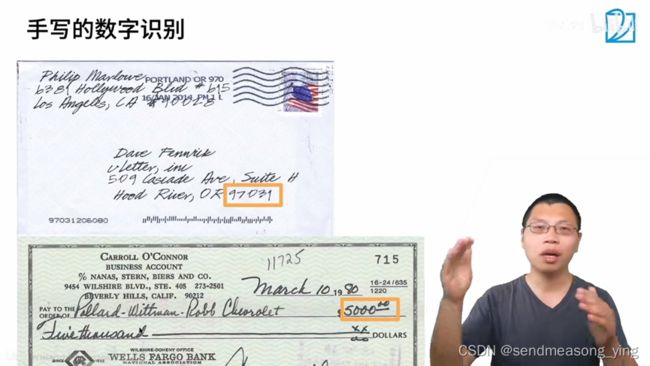

李沐之经典卷积神经网络

目录

1. LeNet

2. 代码实现

1. LeNet

输入是32*32图片,放到一个5*5的卷积层里面,卷积层的输出通道数是6,高宽都是28(32-5+1=28)。再经过2*2的池化层,把28*28变成14*14(28-2+2)/2=14,这里的步幅和窗口的大小一样。再经过5*5的卷积层,输出就变成10*10的(14-5+1=10)。通道数增加了从6变到16。再经过一个池化层,也是16个通道(用了16个卷积核),大小是5*5(10-2+2)/2=5。再把它拉成一个向量输入到全连接层,第一个全连接层的输出是120,第二个的输出是84,最后一个的输出是10。

2. 代码实现

import torch

from torch import nn

from d2l import torch as d2l

#原来的数据集是32*32,这里为了一样每边各padding2行(同时也是为了框住字),4个边就是32行*32列,

#为了得到非线性加一个sigmoid函数

net=nn.Sequential(

nn.Conv2d(1,6,kernel_size=5,padding=2),nn.Sigmoid(),

nn.AvgPool2d(kernel_size=2,stride=2),

nn.Conv2d(6,16,keinel_size=5),nn.Sigmoid(),

nn.AvgPool2d(kernel_size=2,stride=2),nn.Flatten(),

nn.Linear(16*5*5,120),nn.Sigmoid(),

nn.Linear(120,84),nn.Sigmoid(),

nn.Linear(84,10))

X=torch.rand(size=(1,1,28,28),dtype=torch.float32)

for layer in net:

X=layer(X)

print(layer.__class__.__name__,'output shape:\t',X.shape)

"""结果输出:

Conv2d output shape: torch.Size([1, 6, 28, 28])

Sigmoid output shape: torch.Size([1, 6, 28, 28])

AvgPool2d output shape: torch.Size([1, 6, 14, 14])

Conv2d output shape: torch.Size([1, 16, 10, 10])

Sigmoid output shape: torch.Size([1, 16, 10, 10])

AvgPool2d output shape: torch.Size([1, 16, 5, 5])

Flatten output shape: torch.Size([1, 400])

Linear output shape: torch.Size([1, 120])

Sigmoid output shape: torch.Size([1, 120])

Linear output shape: torch.Size([1, 84])

Sigmoid output shape: torch.Size([1, 84])

Linear output shape: torch.Size([1, 10])

"""

#在整个卷积块中,与上一层相比,每一层特征的高度和宽度都减小了。 第一个卷积层使用2个像素的填充,

#来补偿卷积核导致的特征减少。 相反,第二个卷积层没有填充,因此高度和宽度都减少了4个像素。 随着

#层叠的上升,通道的数量从输入时的1个,增加到第一个卷积层之后的6个,再到第二个卷积层之后的16个。

#同时,每个汇聚层的高度和宽度都减半。最后,每个全连接层减少维数,最终输出一个维数与结果分类数

#相匹配的输出。

#第一个模块卷积激活池化把1通道,28*28变成6通道14*14,高宽减半,通道数增加了6倍,信息变多了。

#看看LeNet在Fashion-MNIST数据集上的表现

batch_size=256

train_iter,test_iter=d2l.load_data_fashion_mnist(batch_size=batch_size)

#evaluate_accuracy函数进行轻微的修改, 由于完整的数据集位于内存中,因此在模型使用GPU计算数

#据集之前,我们需要将其复制到显存中。

def evaluate_accuracy_gpu(net,data_iter,device=None):

"""使用GPU计算模型在数据集上的精度"""

if isinstance(net,nn.Module):

#isinstance() 函数来判断一个对象是否是一个已知的类型

net.eval()

#设置为评估模式

if not device:

#如果device没有给定

device=next(iter(net.parameters())).device

#把net的参数构建成一个迭代器,把第一个net的参数拿出来看他的device在哪里

#正确预测的数量,总预测的数量

metric=d2l.Accumulator(2)

with torch.no_grad():

for X,y in data_iter:

if isinstance(X,list):

#如果X的类型是一个list,就每一个都挪到那个device上面去

X=[x.to(device) for x in X]

else:

#如果是个tensor就挪一次

X=X.to(device)

y=y.to(device)

metric=add(d2l.accuracy(net(X),y),y.numel())

return metric[0]/metric[1]

def train_ch6(net,train_iter,test_iter,num_epochs,lr,device):

"""用GPU训练模型"""

def init_weights(m):

if type(m)==mm.Linear or type(m)==nn.Conv2d:

nn.init.xavier_uniform_(m.weight)

net.apply(init_weights)

#对每一个parameter都run一下初始化权重函数

print('training on',device)

net.to(device)

#把整个参数搬到GPU上

optimizer=torch.optim.SGD(net.parameters(),lr=lr)

loss=nn.CrossEntropyLoss()

animator=d2l.Animator(xlabel='epoch',xlim=[1,num_epochs],legend=['train loss',

'train acc','test_acc'])

timer,num_batches=d2l.Timer(),len(train_iter)

for epoch in range(num_epochs):

metric=d2l.Accumulator(3)

net.train()

for i,(X,y) in enumerate(train_iter):

timer.start()

optimizer.zero_grad()

X,y=X.to(device),y.to(device)

y_hat=net(X)

l=loss(y_hat,y)

l.backward()

optimizer.step()

with torch.no_grad():

metric.add(l*X.shape[0],d2l.accuracy(y_hat,y),X.shape[0])

timer.stop()

train_l=metric[0]/metric[2]

train_acc=metric[1]/metric[2]

if(i+1)%(num_batches//5)==0 or i==num_batches-1:

animator.add(epoch+(i+1)/num_batches),(train_l,train_acc,None)

test_acc=evaluate_accuracy_gpu(net,test_iter)

animator.add(epoch+1,(None,None,test_acc))

print(f'loss {train_l:.3f}, train acc {train_acc:.3f}, '

f'test acc {test_acc:.3f}')

print(f'{metric[2] * num_epochs / timer.sum():.1f} examples/sec '

f'on {str(device)}')

#训练和评估LeNet-5模型。

lr,num_epochs=0.9,10

train_ch6=(net,train_iter,num_epochs,lr,d2l.try_gpu())

"""结果输出:

loss 0.469, train acc 0.823, test acc 0.779

55296.6 examples/sec on cuda:0"""

卷积神经网络(CNN)是一类使用卷积层的网络。

在卷积神经网络中,我们组合使用卷积层、非线性激活函数和汇聚层。

为了构造高性能的卷积神经网络,我们通常对卷积层进行排列,逐渐降低其表示的空间分辨率,同时增加通道数。

在传统的卷积神经网络中,卷积块编码得到的表征在输出之前需由一个或多个全连接层进行处理。

LeNet是最早发布的卷积神经网络之一。

参考:

python中isinstance()函数详解_python instance函数-CSDN博客

Pytorch torch.device()的简单用法_torch.device('cuda:0')-CSDN博客

Python迭代器基本方法iter()及其魔法方法__iter__()原理详解-CSDN博客