[docker] Docker容器服务更新与发现之consul

一、consul的相关知识

1.1 什么是注册与发现

服务注册与发现是微服务架构中不可或缺的重要组件。起初服务都是单节点的,不保障高可用性,也不考虑服务的压力承载,服务之间调用单纯的通过接口访问。直到后来出现了多个节点的分布式架构,起初的解决手段是在服务前端负载均衡,这样前端必须要知道所有后端服务的网络位置,并配置在配置文件中。这里就会有几个问题:

●如果需要调用后端服务A-N,就需要配置N个服务的网络位置,配置很麻烦

●后端服务的网络位置变化,都需要改变每个调用者的配置

既然有这些问题,那么服务注册与发现就是解决这些问题的。后端服务A-N可以把当前自己的网络位置注册到服务发现模块,服务发现就以K-V的方式记录下来,K一般是服务名,V就是IP:PORT。服务发现模块定时的进行健康检查,轮询查看这些后端服务能不能访问的了。前端在调用后端服务A-N的时候,就跑去服务发现模块问下它们的网络位置,然后再调用它们的服务。这样的方式就可以解决上面的问题了,前端完全不需要记录这些后端服务的网络位置,前端和后端完全解耦!

1.2 什么是consul

consul是google开源的一个使用go语言开发的服务管理软件。支持多数据中心、分布式高可用的、服务发现和配置共享。采用Raft算法,用来保证服务的高可用。内置了服务注册与发现框架、分布一致性协议实现、健康检查、Key/Value存储、多数据中心方案,不再需要依赖其他工具(比如ZooKeeper等)。服务部署简单,只有一个可运行的二进制的包。每个节点都需要运行agent,他有两种运行模式server 和 client。 每个数据中心官方建议需要3或5个server节点以保证数据安全,同时保证server-leader的选举能够正确的进行。

在client模式下,所有注册到当前节点的服务会被转发到server节点,本身是不持久化这些信息。

在server模式下,功能和client模式相似,唯一不同的是,它会把所有的信息持久化到本地,这样遇到故障,信息是可以被保留的。

server-leader是所有server节点的老大,它和其它server节点不同的是,它需要负责同步注册的信息给其它的server节点,同时也要负责各个节点的健康监测。

consul提供的一些关键特性:

服务注册与发现:consul通过DNS或者HTTP接口使服务注册和服务发现变的很容易,一些外部服务,例如saas提供的也可以一样注册。

健康检查:健康检测使consul可以快速的告警在集群中的操作。和服务发现的集成,可以防止服务转发到故障的服务上面。

Key/Value存储:一个用来存储动态配置的系统。提供简单的HTTP接口,可以在任何地方操作。

多数据中心:无需复杂的配置,即可支持任意数量的区域。

安装consul是用于服务注册,也就是容器本身的一些信息注册到consul里面,其他程序可以通过consul获取注册的相关服务信息,这就是服务注册与发现。

1.3 zookeeper和consul的区别

zookeeper使用临时节点特性来用于服务发现(当服务断开时,临时节点删除)这种服务发现机制比心跳检测更精致,复杂,但是同样也有一些固有的扩展性问题和增加客户端复杂性,所有的服务端都必须维持同zookeeper的活动连接。

consul的服务发现机制:Consul在集群的每一个节点都运行一个客户端,这些客户端就是 gossip pool(分布式健康检查 分布式健康检查)的一部分,gossip协议实现在服务宕机发现上很高效,无论服务集群中服务数多少,Consul可以通过简单的检查服务返回200状态来进行健康检查。

| 对比的项目 | consul | zookeeper |

| 一致性协议 | cp模型 | cp模型 |

| 健康检查 | TCP/HTTP/gRPC/Cmd | KeepAlive |

| 负载均衡策略 | Fabio | - |

| 雪崩保护 | 无 | 无 |

| 自动注销实例 | 不支持 | 支持 |

| 访问协议 | HTTP/DNS | TCP |

| 监听支持 | 支持 | 支持 |

| 多数据中心 | 支持 | 不支持 |

| 跨注册中心同步 | 支持 | 不支持 |

| SpringCloud集成 | 支持 | 不支持 |

| Dubbo集成 | 不支持 | 支持 |

| K8s集成 | 支持 | 不支持 |

二、consul 部署

| 服务器 | IP | 主要作用 |

| consul服务器 | 192.168.136.198 | 运行consul服务、nginx服务、consul-template守护进程 |

| registrator服务器 | 192.168.136.150 | 运行registrator容器、运行nginx容器 |

2.1 部署consul服务器

systemctl stop firewalld.service

setenforce 0

-------- consul服务器 --------

1. 建立 Consul 服务

mkdir /opt/consul

cp consul_0.9.2_linux_amd64.zip /opt/consul

cd /opt/consul

unzip consul_0.9.2_linux_amd64.zip

mv consul /usr/local/bin/

//设置代理,在后台启动 consul 服务端

consul agent \

-server \

-bootstrap \

-ui \

-data-dir=/var/lib/consul-data \

-bind=192.168.80.15 \

-client=0.0.0.0 \

-node=consul-server01 &> /var/log/consul.log &

----------------------------------------------------------------------------------------------------------

-server: 以server身份启动。默认是client。

-bootstrap :用来控制一个server是否在bootstrap模式,在一个数据中心中只能有一个server处于bootstrap模式,当一个server处于 bootstrap模式时,可以自己选举为 server-leader。

-bootstrap-expect=2 :集群要求的最少server数量,当低于这个数量,集群即失效。

-ui :指定开启 UI 界面,这样可以通过 http://localhost:8500/ui 这样的地址访问 consul 自带的 web UI 界面。

-data-dir :指定数据存储目录。

-bind :指定用来在集群内部的通讯地址,集群内的所有节点到此地址都必须是可达的,默认是0.0.0.0。

-client :指定 consul 绑定在哪个 client 地址上,这个地址提供 HTTP、DNS、RPC 等服务,默认是 127.0.0.1。

-node :节点在集群中的名称,在一个集群中必须是唯一的,默认是该节点的主机名。

-datacenter :指定数据中心名称,默认是dc1。

----------------------------------------------------------------------------------------------------------

netstat -natp | grep consul

consul agent -server -bootstrap -ui -data-dir=/opt/consul/data -bind=192.168.136.198 -client=0.0.0.0 -node=consul-server01 &> /opt/consul/logs/consul.log &2. 查看集群信息

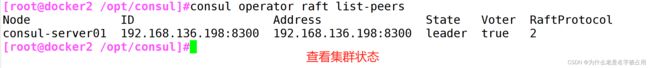

#查看members状态

consul members

#查看集群状态

consul operator raft list-peers

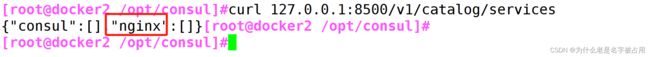

consul info | grep leader3. 通过 http api 获取集群信息

curl 127.0.0.1:8500/v1/status/peers #查看集群server成员

curl 127.0.0.1:8500/v1/status/leader #集群 server-leader

curl 127.0.0.1:8500/v1/catalog/services #注册的所有服务

curl 127.0.0.1:8500/v1/catalog/nginx #查看 nginx 服务信息

curl 127.0.0.1:8500/v1/catalog/nodes #集群节点详细信息2.2 registrator服务器

//容器服务自动加入 Nginx 集群

1. 安装 Gliderlabs/Registrator

Gliderlabs/Registrator 可检查容器运行状态自动注册,还可注销 docker 容器的服务到服务配置中心。目前支持 Consul、Etcd 和 SkyDNS2。

docker run -d \

--name=registrator \

--net=host \

-v /var/run/docker.sock:/tmp/docker.sock \

--restart=always \

gliderlabs/registrator:latest \

--ip=192.168.136.150 \

consul://192.168.136.198:8500

----------------------------------------------------------------------------------------------------------

--net=host :把运行的docker容器设定为host网络模式。

-v /var/run/docker.sock:/tmp/docker.sock :把宿主机的Docker守护进程(Docker daemon)默认监听的Unix域套接字挂载到容器中。

--restart=always :设置在容器退出时总是重启容器。

--ip :刚才把network指定了host模式,所以我们指定ip为宿主机的ip。

consul :指定consul服务器的IP和端口。

----------------------------------------------------------------------------------------------------------2. 测试服务发现功能是否正常

yum -y install nginx

docker run -d -p 9526:80 --name n1 nginx:1.24

docker run -d -p 9527:80 --name n2 nginx:1.24

docker run -d -p 9528:80 --name n3 nginx:1.24

docker run -d -p 9529:80 --name n4 nginx:1.24

3. 验证 http 和 nginx 服务是否注册到 consul

浏览器中,输入 http://192.168.73.105:8500,在 Web 页面中“单击 NODES”,然后单击“consurl-server01”,会出现 5 个服务。

//在consul服务器使用curl测试连接服务器

curl 127.0.0.1:8500/v1/catalog/services 三、consul-template 的引入

3.1 consul-template的作用

Consul-Template是基于Consul的自动替换配置文件的应用。Consul-Template是一个守护进程,用于实时查询Consul集群信息,并更新文件系统上任意数量的指定模板,生成配置文件。更新完成以后,可以选择运行 shell 命令执行更新操作,重新加载 Nginx。

Consul-Template可以查询Consul中的服务目录、Key、Key-values 等。这种强大的抽象功能和查询语言模板可以使 Consul-Template 特别适合动态的创建配置文件。例如:创建Apache/Nginx Proxy Balancers 、 Haproxy Backends等。

3.2 consul-template的具体部署运用

(1)准备 template nginx 模板文件

vim nginx.ctmpl

upstream nginx-backend {

{{range service "nginx"}}

server {{.Address}}:{{.Port}};

{{end}}

}

(2) 安装配置 nginx

yum -y install nginx

vim /etc/nginx/nginx.conf

user nginx;

worker_processes auto;

error_log /var/log/nginx/error.log notice;

pid /var/run/nginx.pid;

events {

worker_connections 1024;

}

http {

include /etc/nginx/consul.conf;

include /etc/nginx/mime.types;

default_type application/octet-stream;

log_format main '$remote_addr - $remote_user [$time_local] "$request" '

'$status $body_bytes_sent "$http_referer" '

'"$http_user_agent" "$http_x_forwarded_for"';

access_log /var/log/nginx/access.log main;

sendfile on;

#tcp_nopush on;

keepalive_timeout 65;

#gzip on;

include /etc/nginx/conf.d/*.conf;

}

vim /etc/nginx/conf.d/default.conf

server {

listen 80;

server_name localhost;

#access_log /var/log/nginx/host.access.log main;

location / {

#root /usr/share/nginx/html;

#index index.html index.htm;

proxy_set_header HOST $host;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

proxy_pass http://nginx-backend;

}

#error_page 404 /404.html;

# redirect server error pages to the static page /50x.html

#

error_page 500 502 503 504 /50x.html;

location = /50x.html {

root /usr/share/nginx/html;

}

# proxy the PHP scripts to Apache listening on 127.0.0.1:80

#

#location ~ \.php$ {

# proxy_pass http://127.0.0.1;

#}

# pass the PHP scripts to FastCGI server listening on 127.0.0.1:9000

#

#location ~ \.php$ {

# root html;

# fastcgi_pass 127.0.0.1:9000;

# fastcgi_index index.php;

# fastcgi_param SCRIPT_FILENAME /scripts$fastcgi_script_name;

# include fastcgi_params;

#}

# deny access to .htaccess files, if Apache's document root

# concurs with nginx's one

#

#location ~ /\.ht {

# deny all;

#}

}

(3) 配置并启动 template

unzip consul-template_0.19.3_linux_amd64.zip -d /opt/

cd /opt/

mv consul-template /usr/local/bin/

//在前台启动 template 服务,启动后不要按 ctrl+c 中止 consul-template 进程。

consul-template --consul-addr 192.168.136.198:8500 --template "/opt/consul-template/nginx.ctmpl:/etc/nginx/consul.conf:/usr/sbin/nginx -s reload" --log-level=info(4)访问 template-nginx

#在registrator主机中

docker ps -a

docker exec -it n1 bash

echo "this is test1 web" > /usr/share/nginx/html/index.html

docker exec -it n2 bash

echo "this is test2 web" > /usr/share/nginx/html/index.html

浏览器访问:http://192.168.136.198:80/ ,并不断刷新。四、consul 多节点部署

//添加一台已有docker环境的服务器192.168.73.107/24加入已有的群集中

#通过sever1(192.168.73.105)将consul执行文件传送给新的服务端

scp consul 192.168.136.150:`pwd` #192.168.136.198的操作

scp consul 192.168.136.197:`pwd

mkdir -p /opt/consul/{data,logs}

consul agent -server -ui -data-dir=/opt/consul/data -bind=192.168.136.150 -client=0.0.0.0 -node=consul-server02 -enable-script-checks=true -datacenter=dc1 -join 192.168.136.198 &> /opt/consul/logs/consul.log &

consul agent -server -ui -data-dir=/opt/consul/data -bind=192.168.136.197 -client=0.0.0.0 -node=consul-server03 -enable-script-checks=true -datacenter=dc1 -join 192.168.136.198 &> /opt/consul/logs/consul.log &

------------------------------------------------------------------------

-enable-script-checks=true :设置检查服务为可用

-datacenter : 数据中心名称

-join :加入到已有的集群中

------------------------------------------------------------------------

consul members

consul operator raft list-peers脱离consul集群的方法

consul leave

![[docker] Docker容器服务更新与发现之consul_第1张图片](http://img.e-com-net.com/image/info8/51a996fad318495a908c2adef006640a.jpg)

![[docker] Docker容器服务更新与发现之consul_第2张图片](http://img.e-com-net.com/image/info8/17ca47510d984dd7a29d78a580417eff.jpg)

![[docker] Docker容器服务更新与发现之consul_第3张图片](http://img.e-com-net.com/image/info8/68b59e232bf84a6f83b69f1fd699bf2e.jpg)

![[docker] Docker容器服务更新与发现之consul_第4张图片](http://img.e-com-net.com/image/info8/b1c6bfdfcde54395ad791bd6b01c31f0.jpg)

![[docker] Docker容器服务更新与发现之consul_第5张图片](http://img.e-com-net.com/image/info8/c1a63c563dfe4909867fe7c3792bf3d6.jpg)

![[docker] Docker容器服务更新与发现之consul_第6张图片](http://img.e-com-net.com/image/info8/6aa9c2e6043f4db99efa60e4d256f98f.jpg)

![[docker] Docker容器服务更新与发现之consul_第7张图片](http://img.e-com-net.com/image/info8/274f41443adb4d889f9400fc386ce987.jpg)

![[docker] Docker容器服务更新与发现之consul_第8张图片](http://img.e-com-net.com/image/info8/25acd92dbb4e43efa705d20fa3fa3ec7.jpg)

![[docker] Docker容器服务更新与发现之consul_第9张图片](http://img.e-com-net.com/image/info8/c3d76753653e48dda4cbd5f518d512d1.jpg)

![[docker] Docker容器服务更新与发现之consul_第10张图片](http://img.e-com-net.com/image/info8/bb5542b3db554bd183d58c3f2d1789ec.jpg)

![[docker] Docker容器服务更新与发现之consul_第11张图片](http://img.e-com-net.com/image/info8/c55e6f8931be4f378ac10afeb5d90ce1.jpg)

![[docker] Docker容器服务更新与发现之consul_第12张图片](http://img.e-com-net.com/image/info8/e8291c06ca4b477296342877776fa662.jpg)

![[docker] Docker容器服务更新与发现之consul_第13张图片](http://img.e-com-net.com/image/info8/b0d9adb9c4144aee93dda1d4d3c03c18.jpg)

![[docker] Docker容器服务更新与发现之consul_第14张图片](http://img.e-com-net.com/image/info8/e1f999ae6ea942968b6c6e945cdbff44.jpg)

![[docker] Docker容器服务更新与发现之consul_第15张图片](http://img.e-com-net.com/image/info8/94c5520f291b468182e31965bcea0a15.jpg)

![[docker] Docker容器服务更新与发现之consul_第16张图片](http://img.e-com-net.com/image/info8/143bacad65bd4ef0997028ded1853ddd.jpg)

![[docker] Docker容器服务更新与发现之consul_第17张图片](http://img.e-com-net.com/image/info8/ee236ae9bc914c39906a544474b901ad.jpg)

![[docker] Docker容器服务更新与发现之consul_第18张图片](http://img.e-com-net.com/image/info8/07ba68a358e64ac9aa7119b6b4db202e.jpg)

![[docker] Docker容器服务更新与发现之consul_第19张图片](http://img.e-com-net.com/image/info8/c9f9b080077b417d9eb774f9966546cc.jpg)

![[docker] Docker容器服务更新与发现之consul_第20张图片](http://img.e-com-net.com/image/info8/42978ec2d4714643bc08e7a12f72e553.jpg)

![[docker] Docker容器服务更新与发现之consul_第21张图片](http://img.e-com-net.com/image/info8/54af2fdf71de48b2b3825c0ff2a39e44.jpg)

![[docker] Docker容器服务更新与发现之consul_第22张图片](http://img.e-com-net.com/image/info8/1de5bee84d6f488399588d4f5838a47c.jpg)

![[docker] Docker容器服务更新与发现之consul_第23张图片](http://img.e-com-net.com/image/info8/183f4068357e4707bae8b60fd438554c.jpg)

![[docker] Docker容器服务更新与发现之consul_第24张图片](http://img.e-com-net.com/image/info8/b0699ce7b35e453f88fab7f20890cd30.jpg)

![[docker] Docker容器服务更新与发现之consul_第25张图片](http://img.e-com-net.com/image/info8/74874fb2ddff4542a4b676871a680aed.jpg)