- 基于Spark的实时计算服务的流程架构

小小搬运工40

spark大数据

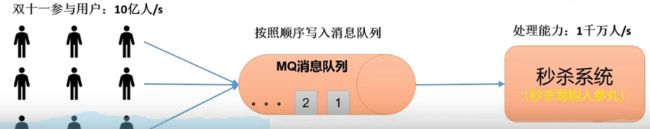

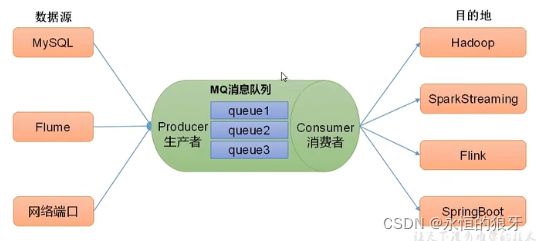

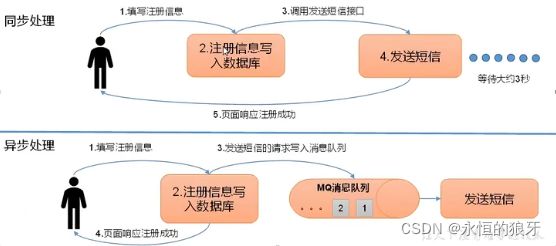

基于Spark的实时计算服务的流程架构通常涉及多个组件和步骤,从数据采集到数据处理,再到结果输出和监控。以下是一个典型的基于Spark的实时计算服务的流程架构:1.数据源数据源是实时计算服务的起点,常见的数据源包括:消息队列:如Kafka、RabbitMQ、AmazonKinesis等。日志系统:如Flume、Logstash等。传感器数据:物联网设备产生的数据流。数据库变更数据捕获(CDC):如

- Kafka 消费端反复 Rebalance: `Attempt to heartbeat failed since group is rebalancing`

大秦王多鱼

Kafka修炼手册kafka分布式运维apache

文章目录Kafka消费端反复Rebalance:`Attempttoheartbeatfailedsincegroupisrebalancing`1.Rebalance过程概述2.错误原因分析2.1消费者组频繁加入或退出2.1.1消费者故障导致频繁重启2.1.2.消费者加入和退出导致的Rebalance2.1.3消费者心跳超时导致的Rebalance2.1.4如何解决频繁触发Rebalance的问

- 第三章:实时流数据处理与分析

深度学习客

大数据技术进阶linqc#数据分析

目录3.1流处理框架深入解析与实战Flink与KafkaStreams的性能对比:事件驱动架构的代码实现1.ApacheFlink:流处理的“性能怪兽”2.KafkaStreams:轻量级、低延迟的流式处理框架实时异常检测与报警系统:结合FlinkCEP(ComplexEventProcessing)进行实现3.2低延迟流处理优化数据流式计算中的状态管理与容错机制:FlinkCheckpointi

- java集成kafka案例

沉墨的夜

javakafka开发语言

要在Java项目中集成ApacheKafka以实现消息的生产和消费,步骤如下:1.引入Maven依赖在您的pom.xml文件中添加以下依赖,以包含Kafka客户端库:org.apache.kafkakafka-clients2.8.0org.springframework.kafkaspring-kafka2.7.02.配置Kafka生产者首先,设置生产者的配置属性:importorg.apach

- 分布式微服务系统架构第88集:kafka集群

掘金-我是哪吒

分布式微服务系统架构kafka架构

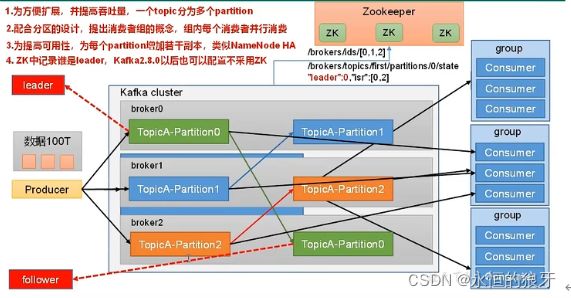

使用集群最大的好处是可以跨服务器进行负载均衡,再则就是可以使用复制功能来避免因单点故障造成的数据丢失。在维护Kafka或底层系统时,使用集群可以确保为客户端提供高可用性。需要多少个broker一个Kafka集群需要多少个broker取决于以下几个因素。首先,需要多少磁盘空间来保留数据,以及单个broker有多少空间可用。如果整个集群需要保留10TB的数据,每个broker可以存储2TB,那么至少需

- 大数据开发的底层逻辑是什么?

瑰茵

大数据

大数据开发的底层逻辑主要围绕数据的生命周期进行,包括数据的采集、存储、处理、分析和可视化等环节。以下是大数据开发的一些关键底层逻辑:数据采集:目的:从不同的数据源(如日志文件、数据库、传感器等)收集数据。方法:使用数据采集工具(如ApacheFlume、ApacheKafka、ApacheSqoop)来捕获和传输数据。数据存储:目的:将收集到的数据存储在可靠且可扩展的存储系统中。方法:使用分布式文

- 【MQ】如何保证消息队列的高性能?

Forest 森林

消息队列MQkafka

零拷贝Kafka使用到了mmap和sendfile的方式来实现零拷贝。分别对应Java的MappedByteBuffer和FileChannel.transferTo顺序写磁盘Kafka采用顺序写文件的方式来提高磁盘写入性能。顺序写文件,基本减少了磁盘寻道和旋转的次数完成一次磁盘IO,需要经过寻道、旋转和数据传输三个步骤,如果在写磁盘的时候省去寻道、旋转可以极大地提高磁盘读写的性能。Kafka中每

- 【MQ】如何保证消息队列的高可用?

Forest 森林

消息队列MQkafka

RocketMQNameServer集群部署Broker做了集群部署主从模式类型:同步复制、异步复制主节点返回消息给客户端的时候是否需要同步从节点Dledger:要求至少消息复制到半数以上的节点之后,才给客户端返回写入成功slave定时从master同步数据(同步刷盘、异步刷盘),master一旦挂了,slave提供消费服务,不能写入消息KafkaKafka从0.8版本开始提供了高可用机制,可保障

- 【面试题】构建高并发、高可用服务架构:技术选型与设计

言之。

redispython面试架构

监控系统消息队列缓存层数据存储层应用层Web层负载均衡与流量分配GrafanaPrometheusAlertmanager消息队列Kafka/RabbitMQ集群/镜像队列缓存层Redis/Memcached数据库MySQL/PostgreSQL主从复制/主主复制应用服务器SpringBoot/Node.js应用服务器SpringBoot/Node.js应用服务器SpringBoot/Node.j

- kafka开启kerberos

蘑菇丁

debian运维

一、基本环境准备创建票据创建Kerberos主体(Principal):使用kadmin.local或kadmin命令为Zookeeper和Kafka服务创建Kerberos主体。例如:注意有几台机器创建几个kadmin.local-q"addprinc-randkeyzookeeper/

[email protected]"kadmin.local-q"addprinc-rand

- springboot kafka配置与使用

摘星喵Pro

javaweb编程技巧kafkaspringbootjava

springbootkafka配置与使用引入spring-kafka依赖org.springframework.kafkaspring-kafkaapplication配置可以根据情况只配置生产着或消费者spring:kafka:#以逗号分隔的地址列表,用于建立与Kafka集群的初始连接(kafka默认的端口号为9092)bootstrap-servers:ip:port,ip:port,ip:p

- MQ的可靠消息投递机制

言之。

面试架构面试

确保消息在发送、传递和消费过程中不会丢失、重复消费或错乱。1.消息的可靠投递消息持久化:消息被发送到队列后会存储在磁盘上,即使消息队列崩溃,消息也不会丢失。例如:Kafka、RabbitMQ等都支持持久化消息。Kafka通过将消息存储在日志文件中,而RabbitMQ通过磁盘队列持久化消息。消息确认机制(ACK):消息生产者发送消息后,消费者需要返回确认(ACK)表示已成功处理,若在超时时间内未确认

- kafka-保姆级配置说明(consumer)

xiao-xiang

kafkakafka分布式

bootstrap.servers=#deserializer应该与producer保持对应#key.deserializer=#value.deserializer=##fetch请求返回时,至少获取的字节数,默认值为1##当数据量不足时,客户端请求将会阻塞##此值越大,客户端请求阻塞的时间越长,这取决于producer生产效率和网络传输能力fetch.min.bytes=1##如果broker

- kafka-部署安装

xiao-xiang

kafkakafka分布式

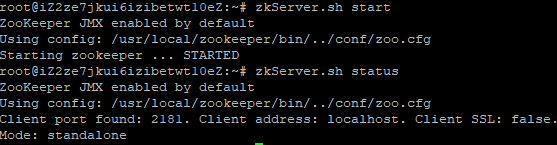

一.简述:Kafka是一个分布式流处理平台,常用于构建实时数据管道和流应用。二.安装部署:1.依赖:a).Java:Kafka需要Java8或更高版本。b).zookeeper:#tarfxvzzookeeper-3.7.0.tar.gz#mvzookeeper-3.7.0zookeeper&&cdzookeeper#mkdirdatalog编辑conf/zoo.cfg文件,设置dataDir和其

- 简述kafka生产者ack确认机制

技匠三石弟弟

数据开发kafka

一、总结该章节主要探讨造成数据丢失问题生产者ack确认机制(目的是要有多少个分区副本收到消息,生产者才认为该消息写入成功;acks参数对数据是否丢失起重要的作用)(1)ack=0,就是表示生产者不会和broker确认消息是否写入成功。这就有可能造成服务器broker因出现问题,导致没有接收到生产者的消息,而生产者却无从得知。这也就造成数据的丢失。--较低延迟和高吞吐量,但是以消息丢失的高风险为代价

- Kafka 生产者中的ack的配置

欧阳冰轩

Kafkakafka分布式

在同步发送的前提下,⽣产者在获得集群返回的ack之前会⼀直阻塞。那么集群什么时候返回ack呢?此时ack有3个配置:1.ack=0kafka-cluster不需要任何的broker收到消息,就⽴即返回ack给⽣产者,最容易丢消息的,效率是最⾼的2.ack=1(默认):多副本之间的leader已经收到消息,并把消息写⼊到本地的log中,才会返回ack给⽣产者,性能和安全性是最均衡的3.ack=-1/

- kafka 生产者发送流程

jxj_cd

mysql数据库

Kafka是由Apache软件基金会开发的一个开源流处理平台,由Scala和Java编写。Kafka是一种高吞吐量的分布式发布订阅消息系统,它可以处理消费者在网站中的所有动作流数据。kafka的基础架构:Kafka生产者发送流程详解:拦截器序列化器分区器生产者端由两个线程协调完成,分别是main线程和Sender线程。main线程在将消息通过拦截器、序列化器和分区器处理后缓存到消息累加器(Reco

- 【53】Camunda8-Zeebe核心引擎-Partitions分区与Internal processing内部处理

AlieNeny

Camundacamunda8流程引擎zeebepartitions分区

Partitions分区在Zeebe中,所有数据都是基于分区的。(一个)分区本质上是一个关于流程事件的持久化流。在broker集群中,分区分布在节点之间,因此可以将其视为分片。启动/初始化Zeebe集群时,用户可以配置所需的分区数。如果使用过Kafka,这部分内容是比较相似的。每当部署流程时,都会将其部署到第一个分区。然后,该流程将分发到所有分区。在所有分区上,此流程接收相同的key和版本,以便可

- Kafka生产者ACK参数与同步复制

WannaRunning

kafka分布式

目录生产者的ACK参数ack等于0ack等于1(默认)ack等于-1或allKafka的同步复制使用误区生产者的ACK参数Kafka的ack机制可以保证生产者发送的消息被broker接收成功。Kafkaproducer有三种ack机制,分别是0,1,-1。这个配置可以在初始化producer时在config中进行配置。默认值是1。ack等于0producer不等待broker同步完成的确认,只要发

- filebeat收集各种类型日志写入logstash,再从logstash中读取日志写入kafka中(有filebeat)

运维实战课程

kafka分布式

filebeat收集各种类型日志写入logstash,再从logstash中读取日志写入kafka中(有filebeat)如果对运维课程感兴趣,可以在b站上、A站或csdn上搜索我的账号:运维实战课程,可以关注我,学习更多免费的运维实战技术视频0.环境机器规划:192.168.43.163kafka1192.168.43.164kafka2192.168.43.165kafka3192.168.4

- kafka日志策略

神云瑟瑟

kafkakafka日志删除配置

kafka日志清除策略kafkalog的清理策略有两种:delete,compact,默认是delete这个对应了kafka中每个topic对于record的管理模式delete:一般是使用按照时间保留的策略,当不活跃的segment的时间戳是大于设置的时间的时候,当前segment就会被删除compact:日志不会被删除,会被去重清理,这种模式要求每个record都必须有key,然后kafka会

- Kafka 日志存储 — 日志索引

黄名富

微服务kafka分布式java微服务

每个日志分段文件对应两个索引文件:偏移量索引文件用来建立消息偏移量到物理地址之间的映射;时间戳索引文件根据指定的时间戳来查找对应的偏移量信息。1日志索引Kafka的索引文件以稀疏索引的方式构造消息的索引。它并不保证每个消息在索引文件中都有对应的索引项。每当写入一定量的消息时,偏移量索引文件和时间戳索引文件分别增加一个索引项。使用二分查找法来快速定位偏移量的位置。1.1日志分段切分的条件日志分段文件

- Kafka 2.2.0 消息日志清理机制:日志删除 日志压缩

A__Plus

kafkaKafka消息队列

Kafka将消息持久化到磁盘中的Log中,为了控制日志文件的大小就需要对消息进行清理操作。每个Log对应一个分区副本,Log可以分为多个日志分段,便于日志的清理操作。在了解日志清理机制之前,请先了解日志存储方式Kafka有两种日志清理策略:日志删除:按照保留策略删除日志分段需要将Broker端参数log.cleanup.policy设置为delete(默认值)日志压缩:根据每个消息的key进行整合

- [每周一更]-(第121期):模拟面试|微服务架构面试思路解析

ifanatic

每周一更Go面试架构面试微服务

这一系列针对Go面试题整理,仅供参考文章目录00|综合服务治理方案:怎么保证微服务应用的高可用?1.**什么是微服务架构?**2.**怎么保证微服务架构的高可用?**3.**怎么判定服务是否已经健康?**4.**如果服务不健康该怎么办?**5.**怎么判定服务已经从不健康状态恢复过来了?**6.**Redis崩溃时如何处理?**7.**Kafka崩溃时如何处理?**8.**设计开放平台时需要考虑哪

- Flink读写Kafka(Table API)

sf_www

实时计算Flinkflinkkafka大数据

前面(Flink读写Kafka(DataStreamAPI)_flinkkafkascram-CSDN博客)我们已经讲解了使用DataStreamAPI来读取Kafka,在这里继续讲解下使用TableAPI来读取Kafka,和前面一样也是引入相同的依赖即可。org.apache.flinkflink-connector-kafka1.15.41.创建KafkaTable可以使用以下方式来创建Kaf

- 【Nginx系列】Nginx配置超时时间

m0_74824552

面试学习路线阿里巴巴nginx运维

???欢迎来到我的博客,很高兴能够在这里和您见面!希望您在这里可以感受到一份轻松愉快的氛围,不仅可以获得有趣的内容和知识,也可以畅所欲言、分享您的想法和见解。推荐:kwan的首页,持续学习,不断总结,共同进步,活到老学到老导航檀越剑指大厂系列:全面总结java核心技术,jvm,并发编程redis,kafka,Spring,微服务等常用开发工具系列:常用的开发工具,IDEA,Mac,Alfred,G

- kafka内部工作机制

一只叫狗的猫

#kafka

集群中成员关系kafka使用zookeeper来维护成员信息。没个broker都有唯一的id,这个标识可以在配置文件中配置,在broker启动的时候,它会创建临时的节点把id注册到zookeeper中,当有其他broker加入集群中时,会判断是否已经有这个id,如果有相同的id则会注册失败。当broker宕机的时候,broker创建的临时节点会从zookeeper中移除,其它的kafka组件也都会

- Kafka 消息存储与销毁机制

AI天才研究院

大数据AI人工智能计算kafkawpf分布式

Kafka消息存储与销毁机制文章目录Kafka消息存储与销毁机制1.背景介绍1.1什么是Kafka1.2Kafka的基本概念解释2.核心概念与联系2.1消息存储机制2.2消息销毁机制2.3分区与副本机制3.核心算法原理具体操作步骤3.1消息存储过程3.2消息消费过程3.3消息销毁过程3.4分区副本同步过程4.数学模型和公式详细讲解举例说明4.1消息存储模型4.2消息销毁模型4.3分区副本同步模型5

- 【Kafka:概念、架构与应用】

三日看尽长安花

系统架构师kafka架构分布式

Kafka:概念、架构与应用目录什么是KafkaKafka的核心概念2.1生产者(Producer)2.2消费者(Consumer)2.3主题(Topic)2.4分区(Partition)2.5消息偏移量(Offset)2.6消费组(ConsumerGroup)Kafka的架构设计3.1Broker与集群3.2Zookeeper的作用Kafka的工作流程Kafka的应用场景Kafka的优缺点分析<

- Kafka:架构与核心机制

J老熊

kafka架构分布式面试系统架构后端

ApacheKafka是一种高吞吐量的分布式消息队列,广泛应用于实时数据流处理和大数据架构中。本文将详细探讨Kafka的架构、Replica管理、消息读取、分区策略、可靠性保障等核心机制。1.Kafka的架构1.1组件概述Kafka的架构由多个组件构成,主要包括以下部分:Broker:Kafka集群中的服务器,每个Broker存储一部分消息。Kafka集群通常由多个Broker组成,以提高可用性和

- Maven

Array_06

eclipsejdkmaven

Maven

Maven是基于项目对象模型(POM), 信息来管理项目的构建,报告和文档的软件项目管理工具。

Maven 除了以程序构建能力为特色之外,还提供高级项目管理工具。由于 Maven 的缺省构建规则有较高的可重用性,所以常常用两三行 Maven 构建脚本就可以构建简单的项目。由于 Maven 的面向项目的方法,许多 Apache Jakarta 项目发文时使用 Maven,而且公司

- ibatis的queyrForList和queryForMap区别

bijian1013

javaibatis

一.说明

iBatis的返回值参数类型也有种:resultMap与resultClass,这两种类型的选择可以用两句话说明之:

1.当结果集列名和类的属性名完全相对应的时候,则可直接用resultClass直接指定查询结果类

- LeetCode[位运算] - #191 计算汉明权重

Cwind

java位运算LeetCodeAlgorithm题解

原题链接:#191 Number of 1 Bits

要求:

写一个函数,以一个无符号整数为参数,返回其汉明权重。例如,‘11’的二进制表示为'00000000000000000000000000001011', 故函数应当返回3。

汉明权重:指一个字符串中非零字符的个数;对于二进制串,即其中‘1’的个数。

难度:简单

分析:

将十进制参数转换为二进制,然后计算其中1的个数即可。

“

- 浅谈java类与对象

15700786134

java

java是一门面向对象的编程语言,类与对象是其最基本的概念。所谓对象,就是一个个具体的物体,一个人,一台电脑,都是对象。而类,就是对象的一种抽象,是多个对象具有的共性的一种集合,其中包含了属性与方法,就是属于该类的对象所具有的共性。当一个类创建了对象,这个对象就拥有了该类全部的属性,方法。相比于结构化的编程思路,面向对象更适用于人的思维

- linux下双网卡同一个IP

被触发

linux

转自:

http://q2482696735.blog.163.com/blog/static/250606077201569029441/

由于需要一台机器有两个网卡,开始时设置在同一个网段的IP,发现数据总是从一个网卡发出,而另一个网卡上没有数据流动。网上找了下,发现相同的问题不少:

一、

关于双网卡设置同一网段IP然后连接交换机的时候出现的奇怪现象。当时没有怎么思考、以为是生成树

- 安卓按主页键隐藏程序之后无法再次打开

肆无忌惮_

安卓

遇到一个奇怪的问题,当SplashActivity跳转到MainActivity之后,按主页键,再去打开程序,程序没法再打开(闪一下),结束任务再开也是这样,只能卸载了再重装。而且每次在Log里都打印了这句话"进入主程序"。后来发现是必须跳转之后再finish掉SplashActivity

本来代码:

// 销毁这个Activity

fin

- 通过cookie保存并读取用户登录信息实例

知了ing

JavaScripthtml

通过cookie的getCookies()方法可获取所有cookie对象的集合;通过getName()方法可以获取指定的名称的cookie;通过getValue()方法获取到cookie对象的值。另外,将一个cookie对象发送到客户端,使用response对象的addCookie()方法。

下面通过cookie保存并读取用户登录信息的例子加深一下理解。

(1)创建index.jsp文件。在改

- JAVA 对象池

矮蛋蛋

javaObjectPool

原文地址:

http://www.blogjava.net/baoyaer/articles/218460.html

Jakarta对象池

☆为什么使用对象池

恰当地使用对象池化技术,可以有效地减少对象生成和初始化时的消耗,提高系统的运行效率。Jakarta Commons Pool组件提供了一整套用于实现对象池化

- ArrayList根据条件+for循环批量删除的方法

alleni123

java

场景如下:

ArrayList<Obj> list

Obj-> createTime, sid.

现在要根据obj的createTime来进行定期清理。(释放内存)

-------------------------

首先想到的方法就是

for(Obj o:list){

if(o.createTime-currentT>xxx){

- 阿里巴巴“耕地宝”大战各种宝

百合不是茶

平台战略

“耕地保”平台是阿里巴巴和安徽农民共同推出的一个 “首个互联网定制私人农场”,“耕地宝”由阿里巴巴投入一亿 ,主要是用来进行农业方面,将农民手中的散地集中起来 不仅加大农民集体在土地上面的话语权,还增加了土地的流通与 利用率,提高了土地的产量,有利于大规模的产业化的高科技农业的 发展,阿里在农业上的探索将会引起新一轮的产业调整,但是集体化之后农民的个体的话语权 将更少,国家应出台相应的法律法规保护

- Spring注入有继承关系的类(1)

bijian1013

javaspring

一个类一个类的注入

1.AClass类

package com.bijian.spring.test2;

public class AClass {

String a;

String b;

public String getA() {

return a;

}

public void setA(Strin

- 30岁转型期你能否成为成功人士

bijian1013

成功

很多人由于年轻时走了弯路,到了30岁一事无成,这样的例子大有人在。但同样也有一些人,整个职业生涯都发展得很优秀,到了30岁已经成为职场的精英阶层。由于做猎头的原因,我们接触很多30岁左右的经理人,发现他们在职业发展道路上往往有很多致命的问题。在30岁之前,他们的职业生涯表现很优秀,但从30岁到40岁这一段,很多人

- [Velocity三]基于Servlet+Velocity的web应用

bit1129

velocity

什么是VelocityViewServlet

使用org.apache.velocity.tools.view.VelocityViewServlet可以将Velocity集成到基于Servlet的web应用中,以Servlet+Velocity的方式实现web应用

Servlet + Velocity的一般步骤

1.自定义Servlet,实现VelocityViewServl

- 【Kafka十二】关于Kafka是一个Commit Log Service

bit1129

service

Kafka is a distributed, partitioned, replicated commit log service.这里的commit log如何理解?

A message is considered "committed" when all in sync replicas for that partition have applied i

- NGINX + LUA实现复杂的控制

ronin47

lua nginx 控制

安装lua_nginx_module 模块

lua_nginx_module 可以一步步的安装,也可以直接用淘宝的OpenResty

Centos和debian的安装就简单了。。

这里说下freebsd的安装:

fetch http://www.lua.org/ftp/lua-5.1.4.tar.gz

tar zxvf lua-5.1.4.tar.gz

cd lua-5.1.4

ma

- java-14.输入一个已经按升序排序过的数组和一个数字, 在数组中查找两个数,使得它们的和正好是输入的那个数字

bylijinnan

java

public class TwoElementEqualSum {

/**

* 第 14 题:

题目:输入一个已经按升序排序过的数组和一个数字,

在数组中查找两个数,使得它们的和正好是输入的那个数字。

要求时间复杂度是 O(n) 。如果有多对数字的和等于输入的数字,输出任意一对即可。

例如输入数组 1 、 2 、 4 、 7 、 11 、 15 和数字 15 。由于

- Netty源码学习-HttpChunkAggregator-HttpRequestEncoder-HttpResponseDecoder

bylijinnan

javanetty

今天看Netty如何实现一个Http Server

org.jboss.netty.example.http.file.HttpStaticFileServerPipelineFactory:

pipeline.addLast("decoder", new HttpRequestDecoder());

pipeline.addLast(&quo

- java敏感词过虑-基于多叉树原理

cngolon

违禁词过虑替换违禁词敏感词过虑多叉树

基于多叉树的敏感词、关键词过滤的工具包,用于java中的敏感词过滤

1、工具包自带敏感词词库,第一次调用时读入词库,故第一次调用时间可能较长,在类加载后普通pc机上html过滤5000字在80毫秒左右,纯文本35毫秒左右。

2、如需自定义词库,将jar包考入WEB-INF工程的lib目录,在WEB-INF/classes目录下建一个

utf-8的words.dict文本文件,

- 多线程知识

cuishikuan

多线程

T1,T2,T3三个线程工作顺序,按照T1,T2,T3依次进行

public class T1 implements Runnable{

@Override

- spring整合activemq

dalan_123

java spring jms

整合spring和activemq需要搞清楚如下的东东1、ConnectionFactory分: a、spring管理连接到activemq服务器的管理ConnectionFactory也即是所谓产生到jms服务器的链接 b、真正产生到JMS服务器链接的ConnectionFactory还得

- MySQL时间字段究竟使用INT还是DateTime?

dcj3sjt126com

mysql

环境:Windows XPPHP Version 5.2.9MySQL Server 5.1

第一步、创建一个表date_test(非定长、int时间)

CREATE TABLE `test`.`date_test` (`id` INT NOT NULL AUTO_INCREMENT ,`start_time` INT NOT NULL ,`some_content`

- Parcel: unable to marshal value

dcj3sjt126com

marshal

在两个activity直接传递List<xxInfo>时,出现Parcel: unable to marshal value异常。 在MainActivity页面(MainActivity页面向NextActivity页面传递一个List<xxInfo>): Intent intent = new Intent(this, Next

- linux进程的查看上(ps)

eksliang

linux pslinux ps -llinux ps aux

ps:将某个时间点的进程运行情况选取下来

转载请出自出处:http://eksliang.iteye.com/admin/blogs/2119469

http://eksliang.iteye.com

ps 这个命令的man page 不是很好查阅,因为很多不同的Unix都使用这儿ps来查阅进程的状态,为了要符合不同版本的需求,所以这个

- 为什么第三方应用能早于System的app启动

gqdy365

System

Android应用的启动顺序网上有一大堆资料可以查阅了,这里就不细述了,这里不阐述ROM启动还有bootloader,软件启动的大致流程应该是启动kernel -> 运行servicemanager 把一些native的服务用命令启动起来(包括wifi, power, rild, surfaceflinger, mediaserver等等)-> 启动Dalivk中的第一个进程Zygot

- App Framework发送JSONP请求(3)

hw1287789687

jsonp跨域请求发送jsonpajax请求越狱请求

App Framework 中如何发送JSONP请求呢?

使用jsonp,详情请参考:http://json-p.org/

如何发送Ajax请求呢?

(1)登录

/***

* 会员登录

* @param username

* @param password

*/

var user_login=function(username,password){

// aler

- 发福利,整理了一份关于“资源汇总”的汇总

justjavac

资源

觉得有用的话,可以去github关注:https://github.com/justjavac/awesome-awesomeness-zh_CN 通用

free-programming-books-zh_CN 免费的计算机编程类中文书籍

精彩博客集合 hacke2/hacke2.github.io#2

ResumeSample 程序员简历

- 用 Java 技术创建 RESTful Web 服务

macroli

java编程WebREST

转载:http://www.ibm.com/developerworks/cn/web/wa-jaxrs/

JAX-RS (JSR-311) 【 Java API for RESTful Web Services 】是一种 Java™ API,可使 Java Restful 服务的开发变得迅速而轻松。这个 API 提供了一种基于注释的模型来描述分布式资源。注释被用来提供资源的位

- CentOS6.5-x86_64位下oracle11g的安装详细步骤及注意事项

超声波

oraclelinux

前言:

这两天项目要上线了,由我负责往服务器部署整个项目,因此首先要往服务器安装oracle,服务器本身是CentOS6.5的64位系统,安装的数据库版本是11g,在整个的安装过程中碰到很多的坑,不过最后还是通过各种途径解决并成功装上了。转别写篇博客来记录完整的安装过程以及在整个过程中的注意事项。希望对以后那些刚刚接触的菜鸟们能起到一定的帮助作用。

安装过程中可能遇到的问题(注

- HttpClient 4.3 设置keeplive 和 timeout 的方法

supben

httpclient

ConnectionKeepAliveStrategy kaStrategy = new DefaultConnectionKeepAliveStrategy() {

@Override

public long getKeepAliveDuration(HttpResponse response, HttpContext context) {

long keepAlive

- Spring 4.2新特性-@Import注解的升级

wiselyman

spring 4

3.1 @Import

@Import注解在4.2之前只支持导入配置类

在4.2,@Import注解支持导入普通的java类,并将其声明成一个bean

3.2 示例

演示java类

package com.wisely.spring4_2.imp;

public class DemoService {

public void doSomethin