AIGC 为何能火爆全网,赋能智能时代?

Hi,大家好,我是半亩花海。2023年,人工智能新浪潮涌起,AIGC 火爆全网,不断赋能各大行业。从短视频平台上火爆的“AI 绘画”,到智能聊天软件 ChatGPT,都引起了大家的广泛关注。那么 AIGC 到底是什么?为什么如此引人关注?AIGC 能产生什么样的应用价值?本文主要从 AIGC 的核心技术与原理、典型应用场景和落地产品形态来探索 AIGC。

目录

一、AIGC 的简要介绍

二、AIGC 的核心技术

1. 基础模型

(1)变分自编码(Variational Autoencoder,VAE)

(2)生成对抗网络(Generative Adversarial Networks,GAN)

(3)扩散模型(Diffusion Model,里程碑式模型)

(4)Transformer

(5)Vision Transformer(ViT)

2. 预训练大模型

(1)计算机视觉(CV)

(2)自然语言处理(NLP)

(3)多模态

三、AIGC 的应用场景

1. 新文报道

2. 新媒体运营

3. 短视频策划

4. 广告创意

5. 游戏设计

6. 教育内容

四、AIGC 的产品形态

1. 基础层(模型服务)

2. 中间层(2B)

3. 应用层(2C)

五、AIGC 平台和工具

一、AIGC 的简要介绍

AIGC(Artificial Intelligence Generated Content)即生成式人工智能,是一种利用人工智能技术自动生成内容的新技术,是相对于专业生成内容(PGC,Professional-generated Content)和用户生成内容(UGC,User-generated Content)而提出的概念。

百度百科对于 AIGC 给出的概念与定义是:AIGC 技术的核心思想是利用人工智能算法生成具有一定创意和质量的内容。通过训练模型和大量数据的学习,AIGC 可以根据输入的条件或指导,生成与之相关的内容。例如,通过输入关键词、描述或样本,AIGC 可以生成与之相匹配的文章、图像、音频等。

| 互联网时代 | Web 1.0 | Web 2.0 | Web 3.0/元宇宙 |

| 内容生成方式 | PGC(专业生成) | UGC(用户生成) | AIGC(AI 生成) |

| 特点 | 专业、质量有保障 | 自由上传、内容丰富 | 高效率 |

二、AIGC 的核心技术

现阶段国内 AIGC 多以单模型应用的形式出现,主要分为文本生成、图像生成、视频生成、音频生成,其中文本生成成为其他内容生成的基础。实现 AIGC 更加智能化、实用化的三大要素是:数据、算力、算法。

1. 基础模型

| 模型名称 | 提出时间 | 应用场景 |

|---|---|---|

| 1、深度变分自编码(VAE) | 2013年 | 图像生成、语音合成 |

| 2、生成对抗神经网络(GAN) | 2014年 | 图像生成、语音合成 |

| 3、扩散模型(Diffusion Model)--DALL-E 2、Imagen | 2015年 | 图像生成 |

| 4、Transformer | 2017年 | 语言模型 |

| 5、Vision Transformer(ViT) | 2020年 | 视觉模型 |

(1)变分自编码(Variational Autoencoder,VAE)

VAE 分为两部分,编码器与解码器。

- 编码器:将原始高维输入数据转换为潜在空间的概率分布描述。

- 解码器:从采样的数据进行重建生成新数据。

(2)生成对抗网络(Generative Adversarial Networks,GAN)

GAN 包含生成器和判别器两个部分:

- 生成器:学习生成合理的数据。对于图像生成来说是给定一个向量,生成一张图片。其生成的数据作为判别器的负样本。

- 判别器:判别输入是生成数据还是真实数据。网络输出越接近于0,生成数据可能性越大;反之,真实数据可能性越大。

(3)扩散模型(Diffusion Model,里程碑式模型)

扩散是受到非平衡热力学的启发,定义一个扩散步骤的马尔科夫链,并逐渐向数据中添加噪声,然后学习逆扩散过程,从噪声中构建出所需的样本。扩散模型的最初设计是用于去除图像中的噪声。随着降噪系统的训练时间越来越长且越来越好,可以从纯噪声作为唯一输入,生成逼真的图片。

一个标准的扩散模型分为两个过程:前向过程与反向过程。

- 前向扩散过程:向原图中逐步加入噪声,直到图像成为完全随机噪声。

- 反向降噪过程:在每个时间步逐步去除噪声,从而从高斯噪声中恢复源数据。

产品与模型:

- DALL-E 2(OpenAI 文本生成图像,图像生成图像)

- Imagen(Google Research 文本生成图像)

- Stable Diffusion(Stability AI 文本生成图像,代码与模型开源)

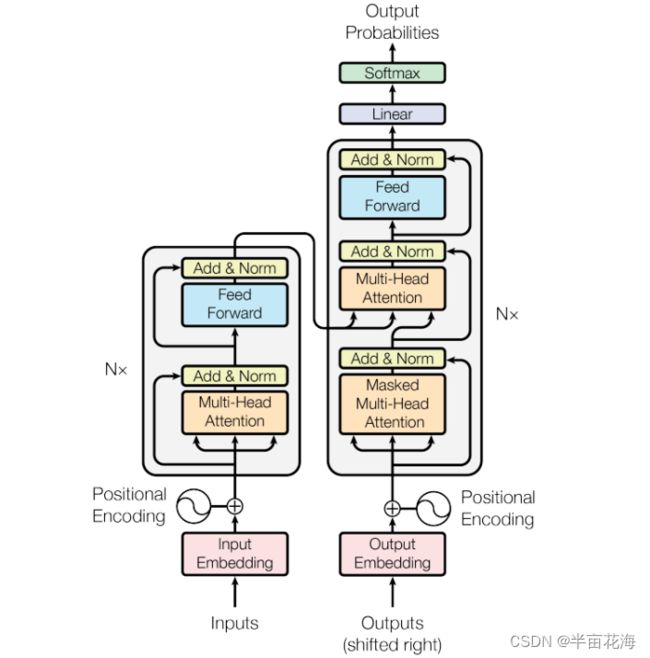

(4)Transformer

采用 Transformer 作为基础模型,发展出了 BERT,LaMDA、PaLM 以及 GPT 系列。人工智能开始进入大模型参数的预训练模型时代。

(5)Vision Transformer(ViT)

ViT 将图片分为 14*14 的 patch,并对每个 patch 进行线性变换得到固定长度的向量送入 Transformer,后续与标准的 Transformer 处理方式相同。以 ViT 为基础衍生出了多重优秀模型,如 SwinTransformer,ViTAE Transformer 等。以 ViT 为代表的视觉大模型赋予了 AI 感知、理解视觉数据的能力,助力 AIGC 发展。

2. 预训练大模型

虽然过去各种模型层出不穷,但是生成的内容偏简单且质量不高,远不能够满足现实场景中灵活多变以高质量内容生成的要求。预训练大模型的出现使 AIGC 发生质变,诸多问题得以解决。大模型在 CV/NLP/多模态领域成果颇丰。诸如,去年爆火的聊天对话模型 ChatGPT,基于 GPT-3.5 大模型发展而来。经典的预训练大模型如下表所示。

| 计算机视觉(CV) | 微软 Florence(SwinTransformer) |

| 自然语言处理(NLP) | 谷歌 Bert / LaMDA / PaLM、OpenAI 的 GPT-3 / ChatGPT |

| 多模态 | OpenAI 的 CLIP / DALL-E、微软的 GLIP、Stability AI的 Stable Diffusion |

(1)计算机视觉(CV)

- Florence

Florence 采用双塔 Transformer 结构。文本采用 12 层 Transformer,视觉采用 SwinTransformer。其可处理的下游任务包括:图文检索、图像分类、目标检测、视觉问答以及动作识别。

(2)自然语言处理(NLP)

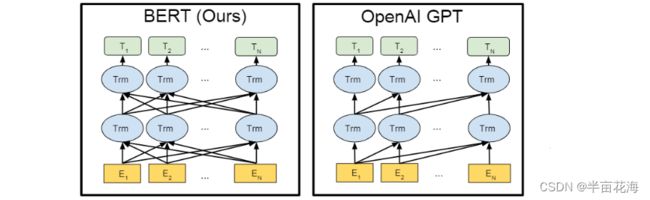

- Bert

Bert 基于 Transformer 的双向编码器表示,通过在所有层中联合调节左右语境,从未标记的文本中预训练深度双向表征。因此,预训练的 BERT 模型可以通过一个额外的输出层进行微调,以创建最先进的模型,用于更广泛的任务,而无需对特定任务的架构进行大量修改。

Bert 模型的目标是利用大规模无标注语料训练、获得文本的包含丰富语义信息的 Representation,即:文本的语义表示,然后将文本的语义表示在特定 NLP 任务中作微调,最终应用于该 NLP 任务。

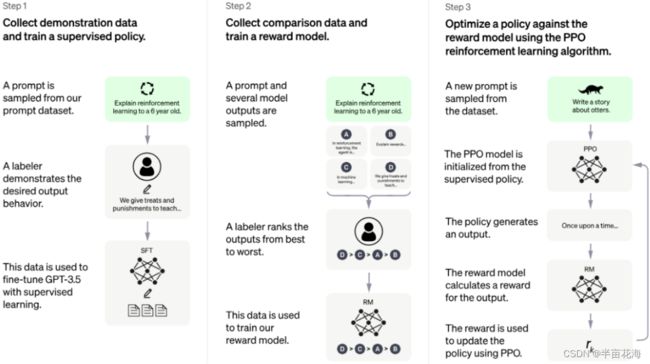

- ChatGPT

ChatGPT 是美国 OpenAI 公司在 2022 年 11 月发布的智能对话模型。ChatGPT 引入了人类反馈强化学习,其训练的整体流程主要分为 3 个阶段,预训练与提示学习阶段,结果评价与奖励建模阶段以及强化学习自我进化阶段;3 个阶段分工明确,实现了模型从模仿期、管教期、自主期的阶段转变。

ChatGPT 的显著特点如下:

- 主动承认错误:若用户指出其错误,模型会听取,并优化答案。

- 敢于质疑:对用户提出的问题,如存在常识性错误,ChatGPT 会指出提问中的错误。

- 承认无知:对于非常专业的问题或超出安全性范围,如果 ChatGPT 不清楚答案,会主动承认无知。

- 支持连续多轮对话:ChatGPT能够记住先前对话内容,并展开多轮自然流畅对话。

Bert 和 OpenAI GPT 都是微调方法,但 Bert 使用一个双向的 Transformer,而 OpenAI GPT 使用一个从左到右的 Transformer。在架构上,Bert 的表征在所有层中是以左和右的上下文为共同条件。Bert 和 OpenAI GPT 二者的形象区别如下图。

(3)多模态

- CLIP(OpenAI)

CLIP(Contrastive Language-Image Pre-training)是一种基于对比文本-图像的预训练方法或者模型。采用双塔模型与比对学习训练方式进行训练。

- Stable Diffusion(Stablility AI)

Stable Diffusion 是英国伦敦 Stability AI 公司开源的图像生成扩散模型,其从功能上来说主要包括两个方面:

- 利用文本输入来生成图像(Text-to-Image)

- 对图像根据文字描述进行修改(输入为文本 + 图像)

三、AIGC 的应用场景

AIGC 在各个领域都有广泛的应用,下面我们来看一些主要领域:

1. 新文报道

AIGC 可以通过自然语言处理和机器学习技术,帮助新闻机构分析海量的新闻数据,提供实时的信息监测和事件预测能力。它还可以生成自动摘要、分类和标记新闻文章,辅助记者进行快速信息筛选和挖掘。

2. 新媒体运营

AIGC 可以通过分析社交媒体数据和用户行为模式,帮助企业和机构优化其社交媒体运营策略。它可以识别热门话题和趋势,推荐合适的内容发布时间和方式,并提供数据驱动的决策支持。

3. 短视频策划

AIGC 可以利用计算机数据算法和图像处理技术,自动生成短视频拍摄的脚本,生成对应的参考样片,也可以从大量的素材中选取最佳的片段,并进行自动剪辑和编辑,以快速生成吸引人的短视频内容。

4. 广告创意

AIGC 可以利用计算机视觉和图像识别算法,分析大量的图像和视频数据,从中提取特征并生成创意性的广告内容。它可以根据目标受众的喜好和需求,自动生成个性化的广告,并优化广告投放效果。

5. 游戏设计

AIGC 可以在游戏设计过程中发挥重要作用。它可以帮助游戏开发人员创建智能的虚拟角色和敌对AI,增强游戏的可玩性和挑战性。同时,AIGC 还可以分析玩家行为和反馈数据,提供个性化的游戏体验,优化游戏关卡设计和平衡性。

6. 教育内容

AIGC 可以为教育领域带来许多创新。它可以根据学生的学习情况和兴趣,生成个性化的教学内容和练习题,提供定制化的学习路径和反馈。

四、AIGC 的产品形态

1. 基础层(模型服务)

基础层为采用预训练大模型搭建的基础设施。由于开发预训练大模型技术门槛高、投入成本高,因此,该层主要由少数头部企业或研发机构主导。如谷歌、微软、Meta、OpenAI、DeepMind、Stability.ai 等。基础层的产品形态主要包括两种:一种为通过受控的 API 接口收取调用费;另一种为基于基础设施开发专业的软件平台收取费用。

2. 中间层(2B)

该层与基础层的最主要区别在于,中间层不具备开发大模型的能力,但是可基于开源大模型等开源技术进行改进、抽取或模型二次开发。该层为在大模型的基础上开发的场景化、垂直化、定制化的应用模型或工具。在 AIGC 的应用场景中基于大模型抽取出个性化、定制化的应用模型或工具满足行业需求。如基于开源的 Stable Diffusion 大模型所开发的二次元风格图像生成器,满足特定行业场景需求。中间层的产品形态、商业模式与基础层保持一致,分别为接口调用费与平台软件费。

3. 应用层(2C)

应用层主要基于基础层与中间层开发,面向C端的场景化工具或软件产品。应用层更加关注用户的需求,将 AIGC 技术切实融入用户需求,实现不同形态、不同功能的产品落地。可以通过网页、小程序、群聊、app 等不同的载体呈现。

基础模型与预训练大模型的发展,促使 AIGC 迎来质变期与大规模应用期,未来随着核心技术演进、产品形态丰富、场景应用多元化、生态建设的日益完善,AIGC 将充分释放应用价值与商业潜力。

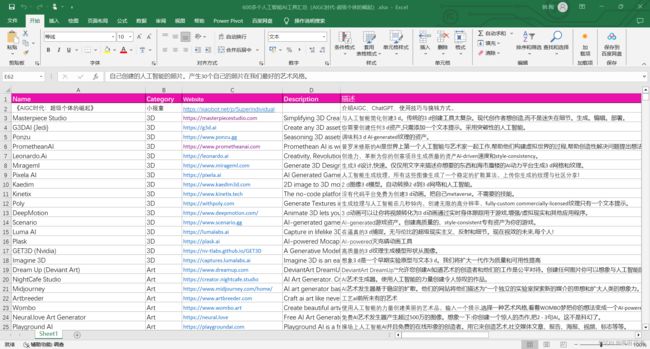

五、AIGC 平台和工具

以下是15个 AIGC 图片生成平台,如下:

分享15个全球顶尖的AIGC图片生成平台_ai生成图片网站-CSDN博客

另外,我这里有 600 个关于 AIGC 工具的文件:600多个人工智能AI工具汇总(AIGC时代-超级个体的崛起).xlsx,感兴趣的朋友可以评论区或者私信我。