RPC服务的发布订阅实现Thrift

Thrift 个人实战--RPC服务的发布订阅实现(基于Zookeeper服务)

前言:

Thrift作为Facebook开源的RPC框架, 通过IDL中间语言, 并借助代码生成引擎生成各种主流语言的rpc框架服务端/客户端代码. 不过Thrift的实现, 简单使用离实际生产环境还是有一定距离, 本系列将对Thrift作代码解读和框架扩充, 使得它更加贴近生产环境. 本文讲述如何借用zookeeper来实现中介角色, 使得服务端和客户端解耦, 并让RPC服务平台化发展.

基础架构:

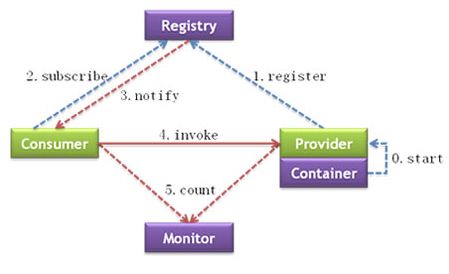

RPC服务往平台化的方向发展, 会屏蔽掉更多的服务细节(服务的IP地址集群, 集群的扩容和迁移), 只暴露服务接口. 这部分的演化, 使得server端和client端完全的解耦合. 两者的交互通过ConfigServer(MetaServer)的中介角色来搭线.

注: 该图源自dubbo的官网

这边借助Zookeeper来扮演该角色, server扮演发布者的角色, 而client扮演订阅者的角色.

Zookeeper基础:

Zookeeper是分布式应用协作服务. 它实现了paxos的一致性算法, 在命名管理/配置推送/数据同步/主从切换方面扮演重要的角色.

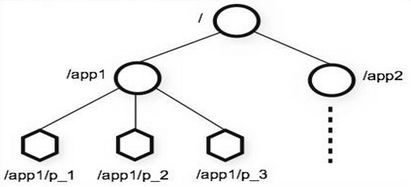

其数据组织类似文件系统的目录结构:

每个节点被称为znode, 为znode节点依据其特性, 又可以分为如下类型:

1). PERSISTENT: 永久节点

2). EPHEMERAL: 临时节点, 会随session(client disconnect)的消失而消失

3). PERSISTENT_SEQUENTIAL: 永久节点, 其节点的名字编号是单调递增的

4). EPHEMERAL_SEQUENTIAL: 临时节点, 其节点的名字编号是单调递增的

注: 临时节点不能成为父节点

Watcher观察模式, client可以注册对节点的状态/内容变更的事件回调机制. 其Event事件的两类属性需要关注下:

1). KeeperState: Disconnected,SyncConnected,Expired

2). EventType: None,NodeCreated,NodeDeleted,NodeDataChanged,NodeChildrenChanged

RPC服务端:

作为具体业务服务的RPC服务发布方, 对其自身的服务描述由以下元素构成.

1). product: 产品名称

2). service: 服务接口, 采用发布方的类全名来表示

3). version: 版本号

借鉴了Maven的GAV坐标系, 三维坐标系更符合服务平台化的大环境.

*) 数据模型的设计

具体RPC服务的注册路径为: /rpc/{product}/{service}/{version}, 该路径上的节点都是永久节点

RPC服务集群节点的注册路径为: /rpc/{product}/{service}/{version}/{ip:port}, 末尾的节点是临时节点

*) RPC服务节点的配置和行为

服务端的配置如下所示:

|

1

2

3

4

5

6

7

8

9

10

11

|

<register>

<server>{ip:port => Zookeeper的地址列表}</servers>

<application>{application name => 服务的应用程序名}</application>

</register>

<server>

<

interface

>{

interface

=> 服务接口名}</

interface

>

<version>{version => 服务版本号}</version>

<

class

>{

class

=>

interface

的具体实现Handler类}</

class

>

<port>{提供服务的监听端口}</port>

</server>

|

服务端的注册逻辑:

|

1

2

3

4

5

6

7

8

|

Zookeeper zk =

new

Zookeeper(

"127.0.0.1:2181"

, timeout,

null

);

while

( !application exit ) {

Stat stat = zk.exists(

"/rpc/{product}/{service}/{version}/{ip:port}"

,

false

);

if

( stat ==

null

) {

zk.create(

"/rpc/{product}/{service}/{version}/{ip:port}"

, Ids.OPEN_ACL_UNSAFE, CreateMode.EPHEMERAL);

}

Thread.sleep(wait_timeout);

}

|

注: zookeeper client与zookeeper的断开会导致临时节点的丢失, 因此需要重新构建, 这边采用开启一个循环线程, 用于定时轮询.

RPC客户端:

客户端的简单注册配置:

|

1

2

3

4

5

6

7

8

9

|

<register>

<server>{ip:port => Zookeeper的地址列表}</servers>

<application>{application name => 服务的应用程序名}</application>

</register>

<service>

<

interface

>{

interface

=> 服务接口名}</

interface

>

<version>{version => 服务版本号}</version>

</sevice>

|

客户端的代码:

1). 初始获取server列表

|

1

2

|

Zookeeper zk =

new

Zookeeper(

"127.0.0.1:2181"

, timeout,

null

);

List<String> childrens = zk.getChildren(path,

true

);

|

2). 注册Watcher监听, EventType.NodeChildrenChanged事件, 每次回调, 重新获取列表

|

1

2

3

4

5

6

7

8

|

class

WatcherWarpper

implements

Watcher {

public

void

process(WatchedEvent event) {

if

( event.getType() == EventType.NodeChildrenChanged ) {

List<String> childrens = zk.getChildren(path,

true

);

// notify Thrift client, rpc service的server ip:port列表发生了变化

}

}

}

|

总结:

这部分其实涉及thrift点并不多, 但该文确实是rpc服务平台化的理论基础. 服务端作为服务的发布方, 而客户端借助zookeeper的watcher机制, 来实现其对服务列表的订阅更新功能. 从而达到解耦, 迈出服务平台化的一步.

后续:

后续文章讲解Thrift client连接池的实现, 也是比较基础的一部分, 敬请期待.