Eclipse下hadoop之旅-第一篇

第一步:eclipse的配置

在浏览器输入网址:http://www.eclipse.org/downloads/

由于我用的是mac os 64位的,所以我下载了Mac OS X 64 Bit

将hadoop的插件hadoop-eclipse-plugin-1.0.3.jar(可在附件中下载)放置到eclipse\plugins目录下,重新启动eclipse。

第二步:建立Hadoop Location

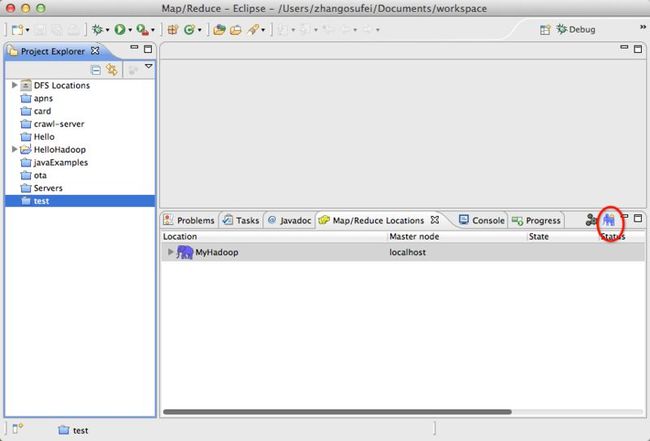

在Windows->Open Perspective中,选择Other,在弹出框中选择Map/Reduce,点击OK。进入Map/Reduce视图,如下图:

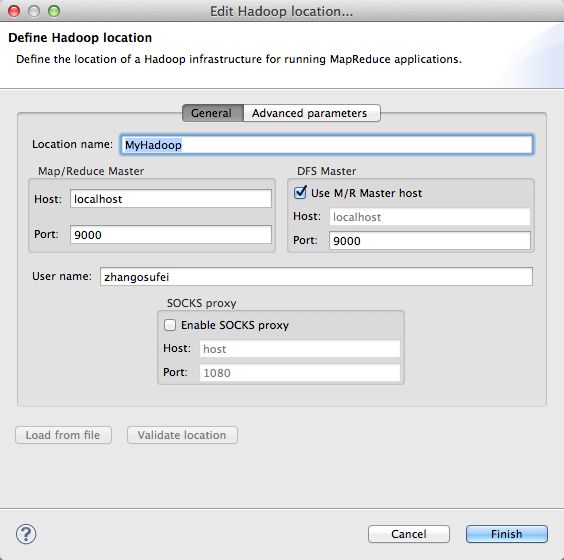

如上图,点击红色框中的添加,新建一个Location,如下图:

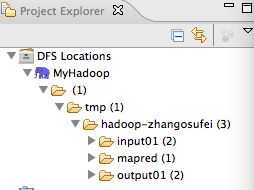

点击Finish,完成后,在左边的Project Explore视图中,即可看到已经建立后的目录结构。如下图:

如上图,可以在hadoop-zhangosufei上,通过右键,新建目录和上传、下载文件。

第三步:创建hadoop project

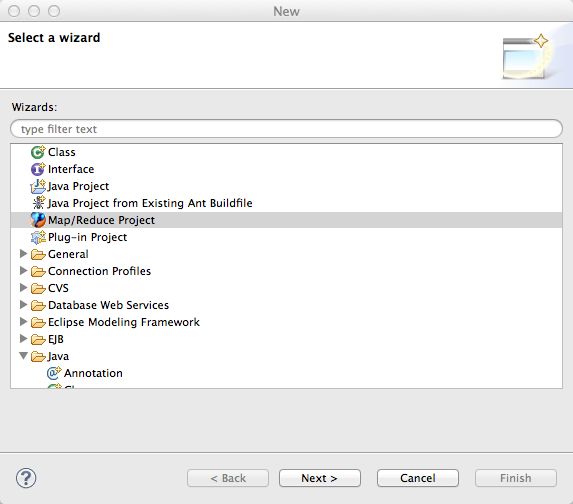

新建一个Map/Reduce的项目,步骤如下:

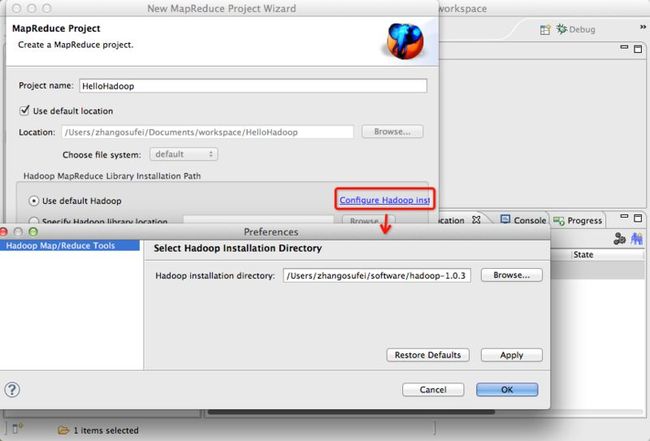

点击next

如上图,配置完hadoop路径后,点击ok,点击Finish。

第四步:测试单词统计的例子

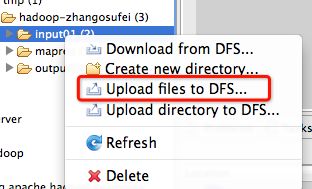

1、在hadoop-zhangosufei目录上右键,新建两个子目录,分别是input01和output01,如下图:

2、在本地新建文本文件file01,内容为:Hello World Bye World

新建文本文件file02,内容为:Hello Hadoop Goodbye Hadoop

在input01目录上,右键,上传file01和file02到dfs,如下图:

3、从路径hadoop-1.0.3/src/examples/org/apache/hadoop/examples下拷贝WordCount.java文件,到HelloHadoop的src下。

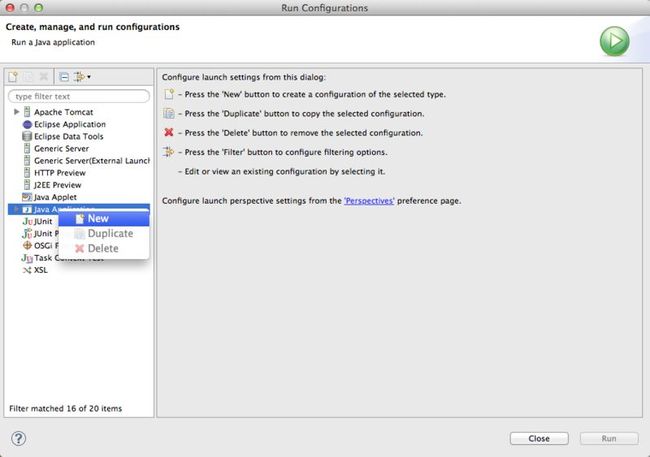

在WordCount.java文件上,右键选择Run As->Run Configurations,在弹出的窗口中,进行参数配置,如下图:

如上图,在Java Application目录上右键,选择New,弹出窗口如下:

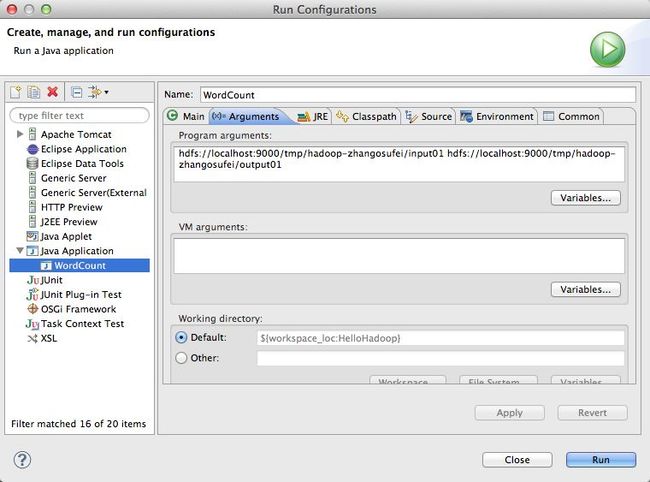

在弹出的窗口中,Name输入WordCount

在Arguments标签中输入以下信息:

hdfs://localhost:9000/tmp/hadoop-zhangosufei/input01 hdfs://localhost:9000/tmp/hadoop-zhangosufei/output01

点击Run,待运行结束后,点击Project Explore中的output01,双击打开_SUCCESS文件,即可看到统计结果。