一.hadoop集群环境配置(完整配置参考上一篇博客)

1.在master节点上(master)修改hdfs-site.xml加上以下内容

<property>

<name>dfs.permissions</name>

<value>false</value>

</property>

旨在取消权限检查,原因是为了解决我在windows机器上配置eclipse连接hadoop服务器时,配置map/reduce连接后报以下错误,org.apache.hadoop.security.AccessControlException: Permission denied:

2.同样在master节点上(master)修改hdfs-site.xml加上以下内容

<property>

<name>dfs.web.ugi</name>

<value>bahaidong,supergroup</value>

</property>

原因是运行时,报如下错误 WARN org.apache.hadoop.security.ShellBasedUnixGroupsMapping: got exception trying to get groups for user jack

应该是我的windows的用户名为bahaidong,无访问权限

更多权限配置可参看官方说明文档

二.windows基础环境准备

windows7(x64),jdk,ant,eclipse,hadoop

1.ant环境配置

apache-ant-1.9.4-bin.zip解压到D:\apache\目录下,配置环境变量ANT_HOME,并将bin目录配置到path

下载地址:http://mirror.bit.edu.cn/apache//ant/binaries/apache-ant-1.9.4-bin.zip

2.下载hadoop-2.5.2.tar.gz

http://mirror.bit.edu.cn/apache/hadoop/common/hadoop-2.5.2/hadoop-2.5.2.tar.gz

3.下载hadoop-2.5.2-src.tar.gz

http://mirror.bit.edu.cn/apache/hadoop/common/hadoop-2.5.2/hadoop-2.5.2-src.tar.gz

4.下载hadoop2x-eclipse-plugin

https://github.com/winghc/hadoop2x-eclipse-plugin

5.下载hadoop-common-2.2.0-bin

https://github.com/srccodes/hadoop-common-2.2.0-bin

6.修改本地hosts文件,加入如下内容:

192.168.189.136 master

192.168.189.138 slave2

192.168.189.137 slave1

三、编译hadoop-eclipse-plugin-2.5.2.jar配置

1.添加环境变量HADOOP_HOME=D:\java\hadoop-2.5.2\

追加环境变量path内容:%HADOOP_HOME%/bin

2.修改编译包及依赖包版本信息

修改F:\hadoop\hadoop2x-eclipse-plugin-master\ivy\libraries.properties

hadoop.version=2.5.2

jackson.version=1.9.13

3.ant编译

D:\java\hadoop-2.5.2\hadoop2x-eclipse-plugin-master\src\contrib\eclipse-plugin>ant jar -Dversion=2.5

.2 -Declipse.home=D:\eclipse32 -Dhadoop.home=D:\java\hadoop-2.5.2

编译好后hadoop-eclipse-plugin-2.5.2.jar会在d:\java\hadoop\hadoop2x-eclipse-plugin-master\build\contrib\eclipse-plugin目录下

四、eclipse环境配置

1.将编译好的hadoop-eclipse-plugin-2.5.2.jar拷贝至eclipse的plugins目录下,然后重启eclipse

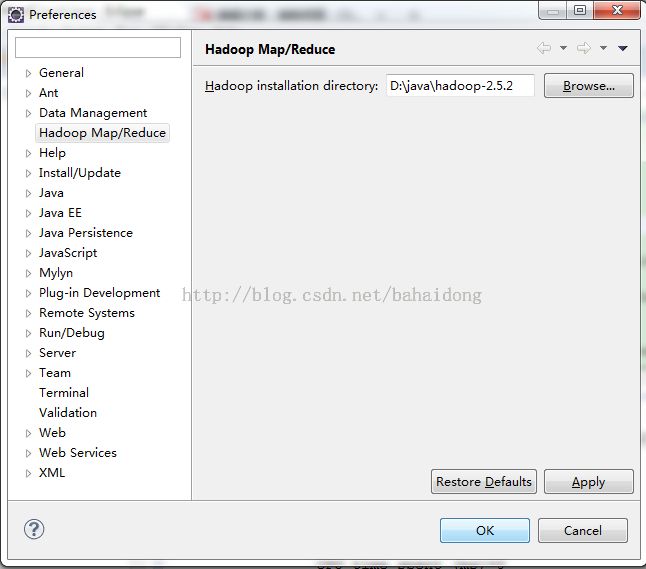

2.打开菜单Window--Preference--Hadoop Map/Reduce进行配置,如下图所示:

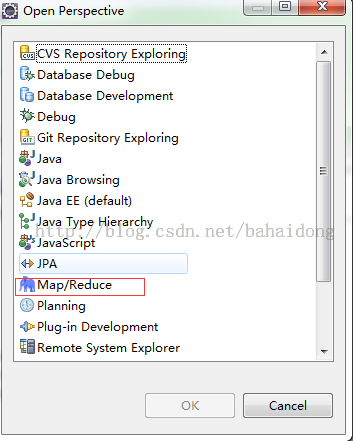

3.显示Hadoop连接配置窗口:Window--OpenPerspective--Other-MapReduce,如下图所示:

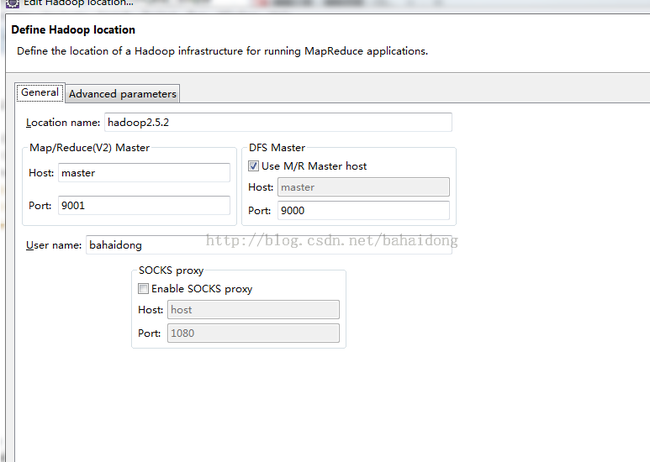

4.配置连接Hadoop,如下图所示:

五、hadoop集群环境添加测试文件

创建input文件夹。并且在该文件夹下面创建两个文件file01,file02

[hadoop@master hadoop-2.5.2]$ mkdir input

[hadoop@master hadoop-2.5.2]$ cd input

[hadoop@master input]$ vim file01

Hello World Bye World

[hadoop@master input]$ vim file02

Hello World GoodBye World

将文件夹input上传到分布式文件系统中

[hadoop@master hadoop-2.5.2]$ bin/hadoop fs -put input input01

查看内容

[hadoop@master hadoop-2.5.2]$ bin/hadoop fs -ls input01

Found 2 items

-rw-r--r-- 2 hadoop supergroup 22 2014-12-16 09:56 input01/file01

-rw-r--r-- 2 hadoop supergroup 26 2014-12-16 09:56 input01/file02

[hadoop@master hadoop-2.5.2]$ bin/hadoop fs -cat input01/*

Hello World Bye World

Hello World GoodBye World

六、创建一个Map/Reduce Project

1.新建项目 File--New--Other--Map/Reduce Project 命名为MR1,

然后创建类org.apache.hadoop.examples.WordCount,从hadoop-2.5.2-src中拷贝覆盖

(F:\hadoop\hadoop-2.5.2-src\hadoop-mapreduce-project\hadoop-mapreduce-examples\src\main\java\org\apache\hadoop\examples\WordCount.java)

2.创建log4j.properties文件

在src目录下创建log4j.properties文件,内容如下:

log4j.rootLogger=debug,stdout,R

log4j.appender.stdout=org.apache.log4j.ConsoleAppender

log4j.appender.stdout.layout=org.apache.log4j.PatternLayout

log4j.appender.stdout.layout.ConversionPattern=%5p - %m%n

log4j.appender.R=org.apache.log4j.RollingFileAppender

log4j.appender.R.File=mapreduce_test.log

log4j.appender.R.MaxFileSize=1MB

log4j.appender.R.MaxBackupIndex=1

log4j.appender.R.layout=org.apache.log4j.PatternLayout

log4j.appender.R.layout.ConversionPattern=%p %t %c - %m%n

log4j.logger.com.codefutures=DEBUG

3.解决java.lang.UnsatisfiedLinkError: org.apache.hadoop.io.nativeio.NativeIO$Windows.access0(Ljava/lang/String;I)异常问题

(由于你的环境和我的可能不一致,可以在后面出现相关问题后再进行修改)

拷贝源码文件org.apache.hadoop.io.nativeio.NativeIO到项目中

然后定位到570行,直接修改为return true;

如下图所示:

七、windows下运行环境配置

需要hadoop.dll,winutils.exe

我是直接拷贝d:\java\hadoop-common-2.2.0-bin-master\bin目录下内容覆盖d:\java\hadoop-2.5.2\bin

八、运行project

在eclipse中点击WordCount.java,右键,点击Run As—>Run Configurations,配置运行参数,即输入和输出文件夹

hdfs://master:9000/user/hadoop/input01 hdfs://master:9000/user/hadoop/outut01

如下图所示:

注意:如果output01目录已经存在,则删掉或换个名字,如output02 。。。

[hadoop@master hadoop-2.5.2]$ bin/hadoop dfs -rmr output01

转载至:http://blog.csdn.net/bahaidong/article/details/41962813