【机器学习】支持向量机SVM学习(2)

支持向量机SVM学习(2)

一、拉格朗日对偶(Lagrange duality)

存在等式约束的极值问题求法,比如下面的最优化问题:

目标函数是f(w),下面是等式约束。通常解法是引入拉格朗日算子,这里使用![]() 来表示算子,得到拉格朗日公式为

来表示算子,得到拉格朗日公式为

l是等式约束的个数。

然后分别对w和![]() 求偏导,使得偏导数等于0,然后解出w和

求偏导,使得偏导数等于0,然后解出w和![]() 。至于为什么引入拉格朗日算子可以求出极值,原因是f(w)的dw变化方向受其他不等式的约束,dw的变化方向与f(w)的梯度垂直时才能获得极值,而且在极值处,f(w)的梯度与其他等式梯度的线性组合平行,因此他们之间存在线性关系。(参考《最优化与KKT条件》)

。至于为什么引入拉格朗日算子可以求出极值,原因是f(w)的dw变化方向受其他不等式的约束,dw的变化方向与f(w)的梯度垂直时才能获得极值,而且在极值处,f(w)的梯度与其他等式梯度的线性组合平行,因此他们之间存在线性关系。(参考《最优化与KKT条件》)

然后我们探讨有不等式约束的极值问题求法,问题如下:

我们定义一般化的拉格朗日公式

这里的![]() 和

和![]() 都是拉格朗日算子。如果按这个公式求解,会出现问题,因为我们求解的是最小值,而这里的

都是拉格朗日算子。如果按这个公式求解,会出现问题,因为我们求解的是最小值,而这里的![]() 已经不是0了,我们可以将

已经不是0了,我们可以将![]() 调整成很大的正值,来使最后的函数结果是负无穷。因此我们需要排除这种情况,我们定义下面的函数:

调整成很大的正值,来使最后的函数结果是负无穷。因此我们需要排除这种情况,我们定义下面的函数:

这里的P代表primal。假设![]() 或者

或者![]() ,那么我们总是可以调整

,那么我们总是可以调整![]() 和

和![]() 来使得

来使得![]() 有最大值为正无穷。而只有g和h满足约束时,

有最大值为正无穷。而只有g和h满足约束时,![]() 为f(w)。这个函数的精妙之处在于

为f(w)。这个函数的精妙之处在于![]() ,而且求极大值。

,而且求极大值。

因此我们可以写作

这样我们原来要求的min f(w)可以转换成求![]() 了。

了。

我们使用![]() 来表示

来表示![]() 。如果直接求解,首先面对的是两个参数,而

。如果直接求解,首先面对的是两个参数,而![]() 也是不等式约束,然后再在w上求最小值。这个过程不容易做,那么怎么办呢?

也是不等式约束,然后再在w上求最小值。这个过程不容易做,那么怎么办呢?

D的意思是对偶,![]() 将问题转化为先求拉格朗日关于w的最小值,将

将问题转化为先求拉格朗日关于w的最小值,将![]() 和

和![]() 看作是固定值。之后在

看作是固定值。之后在![]() 求最大值的话:

求最大值的话:

这个问题是原问题的对偶问题,相对于原问题只是更换了min和max的顺序,而一般更换顺序的结果是Max Min(X) <= MinMax(X)。然而在这里两者相等。用![]() 来表示对偶问题如下:

来表示对偶问题如下:

下面解释在什么条件下两者会等价。假设f和g都是凸函数,h是仿射的(affine,![]() )。并且存在w使得对于所有的i,

)。并且存在w使得对于所有的i,![]() 。在这种假设下,一定存在

。在这种假设下,一定存在![]() 使得

使得![]() 是原问题的解,

是原问题的解,![]() 是对偶问题的解。还有

是对偶问题的解。还有![]() 另外,

另外,![]() 满足库恩-塔克条件(Karush-Kuhn-Tucker, KKT condition),该条件如下:

满足库恩-塔克条件(Karush-Kuhn-Tucker, KKT condition),该条件如下:

所以如果![]() 满足了库恩-塔克条件,那么他们就是原问题和对偶问题的解。让我们再次审视公式(5),这个条件称作是KKT dual complementarity条件。这个条件隐含了如果

满足了库恩-塔克条件,那么他们就是原问题和对偶问题的解。让我们再次审视公式(5),这个条件称作是KKT dual complementarity条件。这个条件隐含了如果![]() ,那么

,那么![]() 。也就是说,

。也就是说,![]() 时,w处于可行域的边界上,这时才是起作用的约束。而其他位于可行域内部(

时,w处于可行域的边界上,这时才是起作用的约束。而其他位于可行域内部(![]() 的)点都是不起作用的约束,其

的)点都是不起作用的约束,其![]() 。这个KKT双重补足条件会用来解释支持向量和SMO的收敛测试。

。这个KKT双重补足条件会用来解释支持向量和SMO的收敛测试。

这部分内容思路比较凌乱,还需要先研究下《非线性规划》中的约束极值问题,再回头看看。KKT的总体思想是将极值会在可行域边界上取得,也就是不等式为0或等式约束里取得,而最优下降方向一般是这些等式的线性组合,其中每个元素要么是不等式为0的约束,要么是等式约束。对于在可行域边界内的点,对最优解不起作用,因此前面的系数为0。

二、 最优间隔分类器(optimal margin classifier)

重新回到SVM的优化问题:

我们将约束条件改写为:

从KKT条件得知只有函数间隔是1(离超平面最近的点)的线性约束式前面的系数![]() ,也就是说这些约束式

,也就是说这些约束式![]() ,对于其他的不在线上的点(

,对于其他的不在线上的点(![]() ),极值不会在他们所在的范围内取得,因此前面的系数

),极值不会在他们所在的范围内取得,因此前面的系数![]() .注意每一个约束式实际就是一个训练样本。

.注意每一个约束式实际就是一个训练样本。

看下面的图:

实线是最大间隔超平面,假设×号的是正例,圆圈的是负例。在虚线上的点就是函数间隔是1的点,那么他们前面的系数![]() ,其他点都是

,其他点都是![]() 。这三个点称作支持向量。构造拉格朗日函数如下:

。这三个点称作支持向量。构造拉格朗日函数如下:

注意到这里只有![]() 没有

没有![]() 是因为原问题中没有等式约束,只有不等式约束。

是因为原问题中没有等式约束,只有不等式约束。

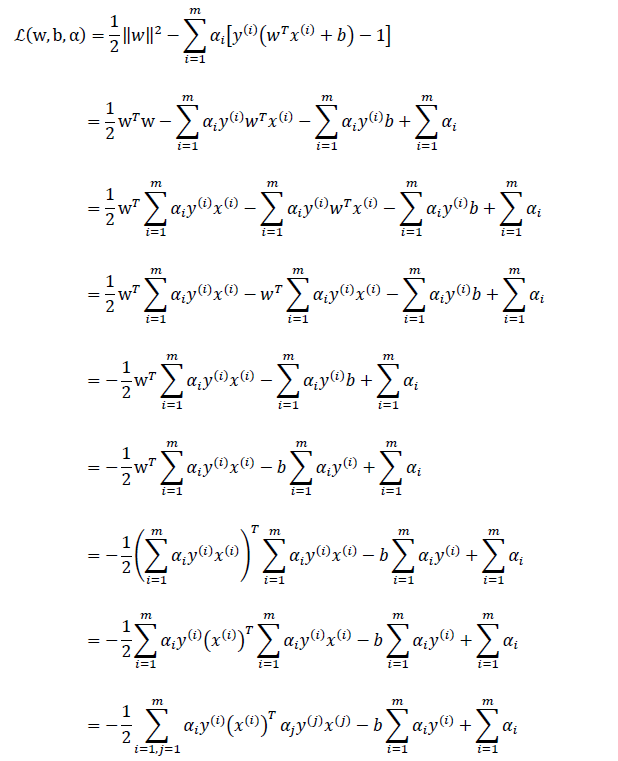

下面我们按照对偶问题的求解步骤来一步步进行,

首先求解![]() 的最小值,对于固定的

的最小值,对于固定的![]() ,

,![]() 的最小值只与w和b有关。对w和b分别求偏导数。

的最小值只与w和b有关。对w和b分别求偏导数。

并得到

将上式带回到拉格朗日函数中得到,此时得到的是该函数的最小值(目标函数是凸函数)

代入后,化简过程如下:

最后得到

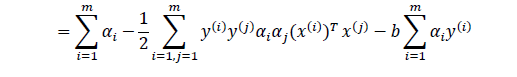

由于最后一项是0(看前面求导的结果),因此简化为

此时的拉格朗日函数只包含了变量![]() 。然而我们求出了

。然而我们求出了![]() 才能得到w和b。

才能得到w和b。

前面提到过对偶问题和原问题满足的几个条件,首先由于目标函数和线性约束都是凸函数,而且这里不存在等式约束h。存在w使得对于所有的i,![]() 。因此,一定存在

。因此,一定存在![]() 使得

使得![]() 是原问题的解,

是原问题的解,![]() 是对偶问题的解。在这里,求

是对偶问题的解。在这里,求![]() 就是求

就是求![]() 了。

了。

即可求出b。即离超平面最近的正的函数间隔要等于离超平面最近的负的函数间隔。

关于上面的对偶问题如何求解,将留给下一篇中的SMO算法来阐明。

这里考虑另外一个问题,由于前面求解中得到

我们通篇考虑问题的出发点是![]() ,根据求解得到的

,根据求解得到的![]() ,我们代入前式得到

,我们代入前式得到

也就是说,以前新来的要分类的样本首先根据w和b做一次线性运算,然后看求的结果是大于0还是小于0,来判断正例还是负例。现在有了![]() ,我们不需要求出w,只需将新来的样本和训练数据中的所有样本做内积和即可。那有人会说,与前面所有的样本都做运算是不是太耗时了?其实不然,我们从KKT条件中得到,只有支持向量的

,我们不需要求出w,只需将新来的样本和训练数据中的所有样本做内积和即可。那有人会说,与前面所有的样本都做运算是不是太耗时了?其实不然,我们从KKT条件中得到,只有支持向量的![]() ,其他情况

,其他情况![]() 。因此,我们只需求新来的样本和支持向量的内积,然后运算即可。这种写法为下面要提到的核函数(kernel)做了很好的铺垫。

。因此,我们只需求新来的样本和支持向量的内积,然后运算即可。这种写法为下面要提到的核函数(kernel)做了很好的铺垫。

![clip_image001[9] clip_image001[9]](http://img.e-com-net.com/image/info5/1caa17ed064641018cfe5724b74c8861.jpg)

![clip_image004[6] clip_image004[6]](http://img.e-com-net.com/image/info5/965f4fb4d48d4f35be2f786f5638fb7b.jpg)

![clip_image007[6] clip_image007[6]](http://img.e-com-net.com/image/info5/c457c08e86394e98b53d242a6e14aaa3.jpg)

![clip_image008[6] clip_image008[6]](http://img.e-com-net.com/image/info5/acba2108e24e4d558c02645b81eaef03.jpg)

![clip_image048[6] 【机器学习】支持向量机SVM学习(2)_第1张图片](http://img.e-com-net.com/image/info5/70e1604d705445e09d1b86433a1f13c1.jpg)

![clip_image057[6] clip_image057[6]](http://img.e-com-net.com/image/info5/af8f2eb948dc407484cea149f7d95639.jpg)

![clip_image067[6] 【机器学习】支持向量机SVM学习(2)_第2张图片](http://img.e-com-net.com/image/info5/c7b0ea962b4844d08e6d618d658b40e1.png)

![clip_image068[6] clip_image068[6]](http://img.e-com-net.com/image/info5/c7a538fe46044ae7832968aee1640d74.jpg)

![clip_image071[6] clip_image071[6]](http://img.e-com-net.com/image/info5/8a406f7f4b9c42e88a0057961dfa84fc.jpg)

![clip_image072[6] clip_image072[6]](http://img.e-com-net.com/image/info5/0b81da8d74ea4625995e58862370a6bf.jpg)

![clip_image073[6] clip_image073[6]](http://img.e-com-net.com/image/info5/d19e17ce2fe948b59d50eb1c053811fd.jpg)

![clip_image074[6] clip_image074[6]](http://img.e-com-net.com/image/info5/03c37dc3500f4c5e94c123cdad8b984e.jpg)

![clip_image075[6] clip_image075[6]](http://img.e-com-net.com/image/info5/2c2b8739b86d485a970bcd4b7cc8a0d7.jpg)

![clip_image078[6] 【机器学习】支持向量机SVM学习(2)_第4张图片](http://img.e-com-net.com/image/info5/ba18288da8ec4b8da20325409caca1de.jpg)

![clip_image083[6] clip_image083[6]](http://img.e-com-net.com/image/info5/893b50090bd34ce5b0dbbbc0eef95973.jpg)

![clip_image086[6] clip_image086[6]](http://img.e-com-net.com/image/info5/d72ea86f3402497eab00dfc6364cfa6d.png)

![clip_image089[6] 【机器学习】支持向量机SVM学习(2)_第5张图片](http://img.e-com-net.com/image/info5/f1111844a1a34dc0b43fab77209fbe10.jpg)