爬虫工具Heritrix初体验

需要找一个工具去爬取某个网站,简单调研后剩下了两个候选:Heritrix和Nutch。最后听说Heritrix可定制的地方比较多,更加灵活。恰好这是我需要的。遂决定采用Heritrix,初步尝试后发现效果不错。具体的好处在于:配置简单,有良好的web界面,不需要写一行代码。

安装

我用的版本是heritrix-1.14.4。

1.下载heritrix-1.14.4.tar.gz,并解压(假设解压后目录为/home/user/ heritrix-1.14.4);

2.找到heritrix-1.14.4/bin/heritrix,改变它的访问权限设置 – chmod;

3.设置好一些环境变量,其中最重要的两个:

export JAVA_HOME=/usr/java/jdk1.6.0_10/jre/

export HERITRIX_HOME=/home/user/heritrix-1.14.4

4.然后就可以启动heritrix了:

heritrix-1.14.4/bin/heritrix --admin=LOGIN:PASSWORD -b 192.168.0.176

(用户名设置成了LOGIN,密码是PASSWORD,如果不设置-b 192.168.0.176,默认是127.0.0.1)

如果启动正常的话,输出是这样:

2011年0712日 星期二 14:09:08 CST Starting heritrix.

Heritrix 1.14.4 is running.

Web console is at: http://192.168.0.176:8080

Web console login and password: LOGIN/PASSWORD

如果启动不正常,输出是:

2011年0712日 星期二 14:09:08 CST Starting heritrix……………..

可以查看heritrix-1.14.4/ heritrix_out.log,文件中有错误信息。

5.Heritrix使用了Jetty,提供了一个web的控制台,URL为: http://192.168.0.176:8080

配置

登陆web控制台,就可以设置和运行具体的爬取任务了。

先解释几个名词:

Job:Heritrix将每个爬取任务称为job,比如我要抓取www.example.com的所有网页,那么我就必须制定一个job来完成这件事;

Profile:一个Job需要设定很多的配置参数。而profile可以看做是Job的配置模板,但它本省不能作为一个job运行;

所以,要让Heritrix执行抓取网页的任务,创建Job是关键:

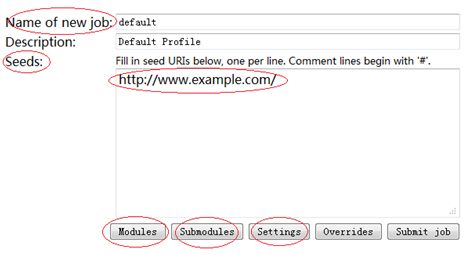

1.进入web控制台,点击 Jobs -> Create New Job -> With defaults,使用默认设置来初始化你的Job;

2.输入Job的名字在“Name of new job”,然后在“Seeds”中填写要抓取的网站,比如: http://www.example.com/ (注意,好像必须有最后那个反斜线)

3.点击“Modules”按钮,进入modules的设置页面。Modules是指Job需要包含的组件,这里就是设置Job到底应该采用哪些组件,比较重要的有两个:

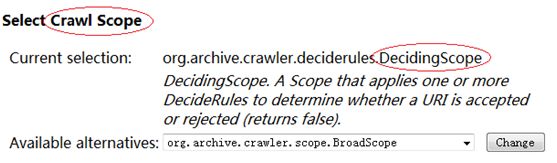

Crawl Scope:

这个module是配置到底哪些link是需要抓取的:

最好选择DecidingScope,因为貌似1.14.4版本后,其它的很多Scope都被“Deprecated”了。

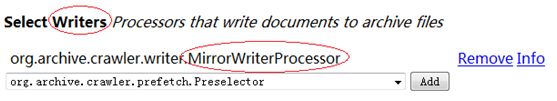

Writers:

这里是设置抓取后的网页怎样保存在本地:

我喜欢设置成MirrorWriterProcessor,这样,抓取下来的文件就会在本地组成“镜像”文件。

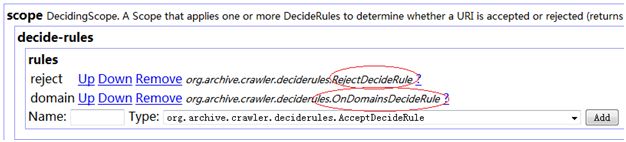

4.设置完Modules后,点击“Submodules”按钮,进入Submodules设置:

Submodules是为了在选定好Modules之后,再分别对Modules的一些细节进行设置,比如我们之前选择了DecidingScope,在“Submodules”中需要设置DecidingScope的一些参数:

Scope的设置比较复杂,还是直接参考官方文档吧。

我因为只想抓取特定网站www.example.com的相关页面,所以这里添加了两条rule:

RejectDecideRule: 表示对于分析得到的link,默认是拒绝抓取的;

OnDomainDecideRule: 表示除非这个link的domain和seed中的匹配,也就是说,如果这个link的域名是example.com,那么它会被抓取;

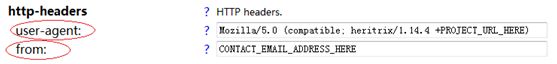

5.设置完SubModules,点击“Settings”按钮:

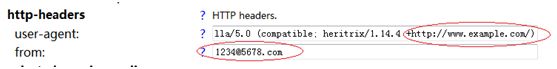

Settings中最重要的一个设置项是http-headers:

这里需要将“PROJECT_URL_HERE”改成seed中的url,比如http://www.example.com;

而“from”中必须填写一个正确格式的邮件地址,比如 [email protected];

设置完成后如下:

6.这些都设置好了,然后就提交Job并运行。能够在:“Console”页面下看见Job运行的状态。同时,在/home/user/heritrix-1.14.4/jobs下能看见job对应的目录,其中有一个子目录“mirror”,就是被抓取网页的保存地了。

除此以外,还能够在web的“Reports”中看见Job的一些统计信息,非常有用。

问题

初次使用,我也还有一些问题没搞明白:

1.如何同时启动多个Job?

看文档中已经可以支持多个Job的同时运行了,但是我不清楚该怎么做;

2. 如何控制爬虫的抓取速度?

这个问题我已经知道答案了。在“Settings”有几个设置项:

delay-factor

max-delay-ms

min-delay-ms

min-interval-ms

通过它们可以控制爬虫的抓取速度。

参数的详细定义见官方文档。

3. 怎样实现增量抓取?

现在我还不清楚,下一步工作重点。

Reference

http://crawler.archive.org/articles/user_manual/index.html 用户手册