mac hadoop运行程序

在mac下运行Hadoop程序有两种方式:

第一种就是编写好Hadoop程序后,打成jar包,以jar包的形式运行

bin/hadoop jar wc.jar WordCount /user/joe/wordcount/input /user/joe/wordcount/output

第二种就是在eclipse中运行,在这种方式下,要求提前安装好Hadoop的eclipse 插件,该插件需要根据Hadoop的版本编译,否则会出现版本不匹配错误(根据Hadoop版本,在网上搜索对应版本的插件即可,先不用耗费精力在编译插件上,我的资源:http://download.csdn.net/detail/tterminator/9133281)。

本文以第二种方式运行Hadoop程序,因为在eclipse中安装Hadoop插件后,有以下几点优势:

一、可以很方便的创建map/reduce工程

二、可以添加Hadoop location

三、可以方便的查看hdfs中的目录结构,并预览文件内容

运行环境:

Java version “1.7.0_80”

+

![]()

+

![]()

+

有了上面搭建的环境之后,就可以在eclipse中做运行Hadoop程序之前的配置工作了:

第零步:启动Hadoop:

sbin/start-all.sh确认Hadoop是否启动成功:

运行jps命令,查看是否有以下进程,缺一不可。

NameNode

SecondaryNameNode

DataNode

NodeManager

ResourceManager

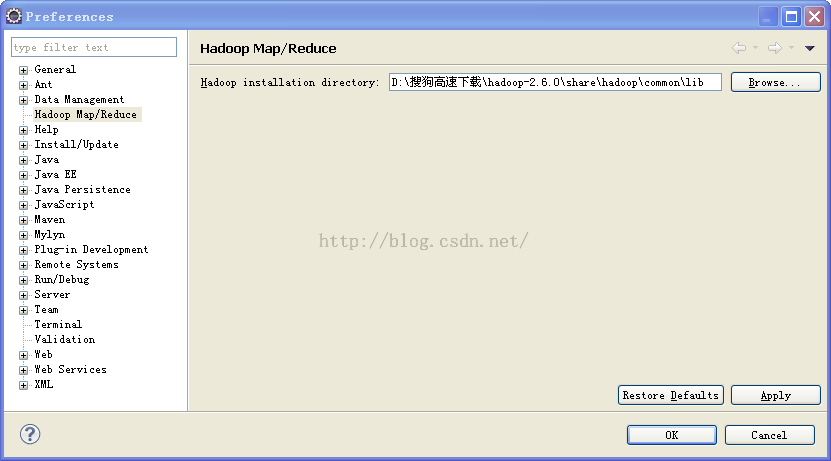

第一步:在eclipse中配置Hadoop install location(看网上配置老版本Hadoop时,只要配置到Hadoop安装目录就行,这里经过实践发现配置Hadoop2.6.0时,需要配置到Hadoop安装目录下的common/lib)

第二步:eclipse下window菜单中show view查找Map/Reduce Locations视图,在改视图中右键单击“New Hadoop loction...”

location name:任意填

map/reduce master内容和

dfs master内容根据配置文件

mapred-site.xml和

core-site.xml

中配置的内容填写(根据自身情况填写,不一定和上图中内容相同)。

第三步:新建map/reduce工程

安装完Hadoop的eclipse插件后,在新建工程时会出现Map/Reduce Project选项

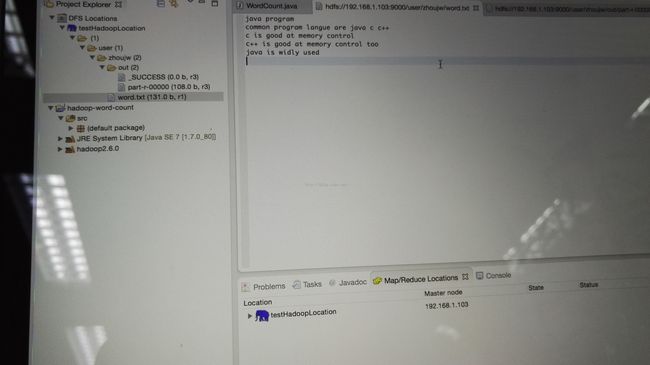

新建完工程后,如下图所示:

除了可以看到新建的工程,还可以看到一个DFS Location,里面就是我们在第二步中创建的位置,在这里不仅可以看到当前时刻下的hdfs目录结构,还可以通过双击的方式查看文件内容。要想看到不同时刻的hdfs状态,只需要右键单击“Reconnect”即可,需要注意的是“Refresh”但不到同样的效果。

第四步:在官网复制WordCount.java源码,并修改build path:

注意:这里修改build path(即引进Hadoop自带jar包)很重要,如果引入的jar包不全,可能会出现即使工程中源码没有错误,但在运行时会出现错误。其实,网上说的很多错误都是jar包引入不全引起的,最简单粗暴的方式就是把share目录下common、hdfs、mapreduce、yarn中的jar包全部引入。

import java.io.IOException;

import java.util.StringTokenizer;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.Mapper;

import org.apache.hadoop.mapreduce.Reducer;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

public class WordCount {

public static class TokenizerMapper

extends Mapper<Object, Text, Text, IntWritable>{

private final static IntWritable one = new IntWritable(1);

private Text word = new Text();

public void map(Object key, Text value, Context context

) throws IOException, InterruptedException {

StringTokenizer itr = new StringTokenizer(value.toString());

while (itr.hasMoreTokens()) {

word.set(itr.nextToken());

context.write(word, one);

}

}

}

public static class IntSumReducer

extends Reducer<Text,IntWritable,Text,IntWritable> {

private IntWritable result = new IntWritable();

public void reduce(Text key, Iterable<IntWritable> values,

Context context

) throws IOException, InterruptedException {

int sum = 0;

for (IntWritable val : values) {

sum += val.get();

}

result.set(sum);

context.write(key, result);

}

}

public static void main(String[] args) throws Exception {

Configuration conf = new Configuration();

Job job = Job.getInstance(conf, "word count");

job.setJarByClass(WordCount.class);

job.setMapperClass(TokenizerMapper.class);

job.setCombinerClass(IntSumReducer.class);

job.setReducerClass(IntSumReducer.class);

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(IntWritable.class);

FileInputFormat.addInputPath(job, new Path(args[0]));

FileOutputFormat.setOutputPath(job, new Path(args[1]));

System.exit(job.waitForCompletion(true) ? 0 : 1);

}

}

bin/hadoop fs -copyFromLocal /home/grid/word.txt /tmp/wordcount/word.txt

第六步:eclipse中配置run configuration(根据自己的配置文件设置运行参数),并运行程序

第七步:输入文件内容及运行结果:

输入文件内容:

运行结果内容:

附:

(1)datanode无法启动解决方法

症状:多次运行以下命令

$ bin/hdfs namenode -formatnamenode可以启动,datanode无法启动:

产生原因及解决方法:

执行文件系统格式化时,在/tmp/hadoop-zq/dfs/name/current/VERSION和/tmp/hadoop-zq/dfs/data/current/VERSION两个文件中保存有属性clusterID,当namenode多次格式化后,会导致上述两个文件中clusterID不同,把data下VERSION文件clusterID属性改为和name下的相同即可。

注意:/tmp/hadoop-zq/路径为在core-default.xml中没有配置hadoop.tmp.dir属性时的默认值/tmp/hadoop-${user.name}。

(2)namenode无法启动

namenode无法启动多半是因为运行Hadoop的主机IP地址发生改变,需要修改core-site.xml和mapred-site.xml配置文件中的IP地址,然后运行bin目录下的hdfs namenode -format命令,重新格式化Hadoop文件系统,再次运行sbin/start-all.sh时,即可启动namenode,若此时出现datanode无法启动参见(1)即可解决。