- 基于 LDA SS-NMF 的文本主题分析可视化分析系统 毕业设计 附完整代码

程序员奇奇

计算机毕设课程设计python人工智能LDA主题分析

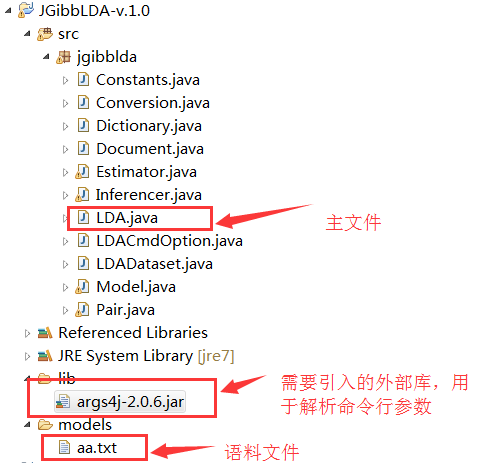

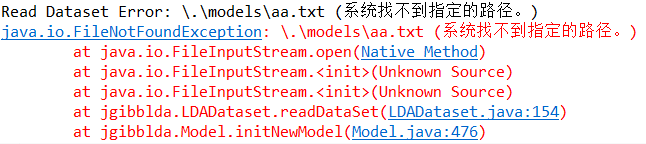

摘要在机器学习和自然语言处理领域中,主题模型(TopicModel)是在一系列文档中发现抽象主题的一种统计模型,并被广泛地应用于文本文档集合的分析。近年来,各种主题建模技术,特别是概率图建模技术,取得了显著的进展,其中隐含狄利克雷分布(LDA)等最先进的技术已经成功地应用于可视化文本分析。然而,大多数基于概率模型的方法在多次运行的一致性和经验收敛性方面存在缺陷。此外,由于公式和算法的复杂性,LDA

- 深入理解LDA主题模型及其在文本分析中的应用

小高要坚强

python信息可视化matplotlib算法分类

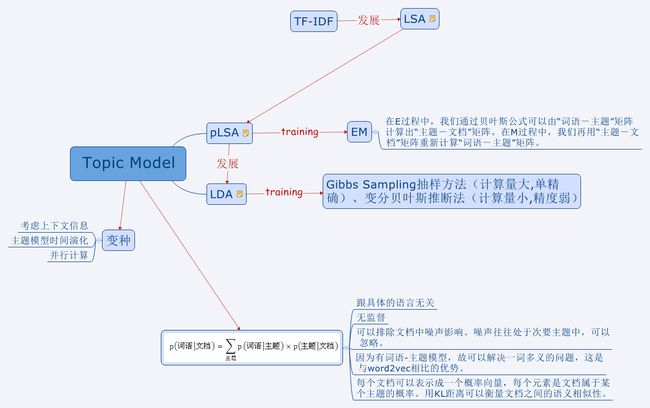

深入理解LDA主题模型及其在文本分析中的应用在自然语言处理领域,主题模型是一种强大的工具,能够自动发现文档集中的潜在主题。在大规模文本数据分析中,LatentDirichletAllocation(LDA)是最受欢迎的主题模型之一。LDA的核心目标是从文档集中提取不同的主题,并确定每篇文档属于这些主题的概率分布。本文将详细介绍LDA主题模型的原理、如何使用Python实现LDA,并演示如何将其应用

- LSA 主题模型

dreampai

1、原理通过对大量的文本集进行统计分析,从中提取出词语的上下文使用含义。技术上通过SVD分解等处理,消除了同义词、多义词的影响,提高了后续处理的精度。分析文档集合,建立词汇-文本矩阵。对词汇-文本矩阵进行奇异值分解。对SVD分解后的矩阵进行降维使用降维后的矩阵构建潜在语义空间image.png第一个小矩阵X是对词进行分类的一个结果,它的每一行表示一个词,每一列表示一个语义相近的词类,这一行中每个非

- 基于Python的微信聊天记录分析——可视化方法与主题模型构建

HHHenry2Hero

python数据分析数据挖掘自然语言处理中文分词数据可视化

本篇为《基于Python的微信聊天记录分析》系列的第三篇,主要讲解在Python环境下对聊天记录进行进一步的可视化,并对聊天内容进行初步挖掘,涉及聊天记录可视化方法、主题模型构建等内容。希望和大家多多交流,共同进步!一.聊天记录可视化在上一篇中,我们将聊天记录统计分析的结果进行了初步可视化,包括按日期统计聊天频次、按每天不同时段统计聊天频次、高频词汇统计战士等内容,总体来说,可视化的是一些数学统计

- nlp文本主题提取算法总结

mqdlff_python

自然语言处理人工智能

BERTopic:简介:基于预训练的语言模型BERT(BidirectionalEncoderRepresentationsfromTransformers)的主题模型,通过将文档嵌入到BERT空间中并进行聚类,实现主题提取。作者:出自Cherubin等人的研究(2021)。BigARTM(BigAdditiveRegularizationTopicModel):简介:BigARTM是一种多模态、

- PLSA 和 LDA 对比?

爱打网球的小哥哥一枚吖

信息检索人工智能机器学习

PLSA和LDA都是主题模型,但PLSA是基于最大似然估计的生成式模型,而LDA是基于贝叶斯推断的生成式模型。LDA具有更好的泛化性能和对稀疏数据的建模能力,但计算复杂度较高。在实际应用中,可以根据具体需求选择适合的模型。

- 文本挖掘之主题分析的详细介绍

亦旧sea

机器学习人工智能算法

文本挖掘的主题分析是什么文本挖掘的主题分析是指通过计算机自动处理文本数据,识别出文本中的主题和话题。主题指的是文本中的核心概念或议题,而话题则是具体的讨论点或事件。主题分析可以帮助人们快速了解大量文本数据中的内容和趋势,从而支持信息检索、舆情分析、情感分析、知识发现等应用。主题分析的主要方法包括文本聚类、主题模型、关键词提取等。文本挖掘的主题分析的特点是什么,优缺点是什么文本挖掘的主题分析是通过对

- 超详细EM算法举例及推导

老实人小李

聚类算法聚类

最好先学习一下极大似然EM(Expectation-Maximum)算法也称期望最大化算法,曾入选“数据挖掘十大算法”中,可见EM算法在机器学习、数据挖掘中的影响力。EM算法是最常见的隐变量估计方法,在机器学习中有极为广泛的用途,例如常被用来学习高斯混合模型(Gaussianmixturemodel,简称GMM)的参数;隐式马尔科夫算法(HMM)、LDA主题模型的变分推断等等。EM算法是一种迭代优

- RabbitMQ详细入门(让你从小白到大白)

JAVA贩卖机

java开发语言rabbitmqjava-rabbitmq搜索引擎

目录一、前言二、RabbitMQ的介绍什么是MQ?使用场景常见的MQ产品三、RabbitMQ入门四、五种消息模型Simple-简单模型代码生产者发送消息消费者获取消息消息确认机制(ACK)自动ACK存在的问题演示手动ACKWork-工作模型生产者消费者1消费者2能者多劳Fanout-广播模型生产者消费者1消费者2Direct-定向模型生产者消费者1消费者2Topic-主题模型生产者消费者1消费者2

- NLP学习(2)

Tang_Genie

关于NLP的词向量对比1.bag-of-wordsBOW是词袋模型,文本中各个词之间的顺序,语义,位置信息不予考虑,将文本看作若干个词的组合,这些词都是独立的,不依赖其他词,常用的有one-hot,tf-idf,textrank等。2.主题模型LSA(潜在语义分析模型,主要解决文档中的一词多义和一义多词问题,主要将高维空间映射到低维空间(也叫潜在语义空间),主要通过SVD(奇异值矩阵分解)。lat

- 【论文阅读】BERTopic:采用一个基于类的TF-IDF流程进行神经网络的主题建模

沐兮Krystal

NLP论文阅读神经网络聚类

摘要主题模型对于在文档的集合中发现潜在的主题非常有用。近期的研究已经展示了主题建模方法作为一个聚类任务的可行性。本文展示了BERTopic,它是一个话题模型,它通过对一个基于类的TF-IDF的变体的开发,抽取一致的话题表示。具体来说,BERTopic采用预训练的基于transformer的语言模型来产生文档的嵌入,对这些文档嵌入进行聚类,并最后利用基于类的TF-IDF过程来产生话题的表示。BERT

- 主题模型--BERTopic python解析

Andy_shenzl

NLP1024程序员节BERTopic

一、概念1.1主题模型主题模型(TopicModel)是自然语言处理中的一种常用模型,是一种无监督学习方法,它用于从大量文档中自动提取主题信息。主题模型的核心思想是,每篇文档都可以看作是多个主题的混合,而每个主题则由一组词构成。主题模型能够帮助我们理解文档集中的主题结构,有助于文档分类、聚类和信息检索。主题模型能够将高维的文本数据降维到低维的主题空间,便于后续的分析和处理。1.2BERTopicB

- 主题模型——总结

dreampai

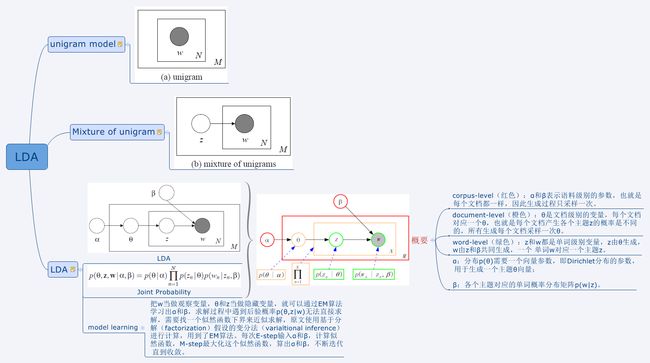

UnigramModel统计学下的UnigramModelimage.pngimage.png贝叶斯观点下的UnigramModelimage.pngDirichlet先验分布下的UnigramModelimage.pngimage.pngTopicModel⁄PLSAimage.pngimage.pngLDA建模image.pngimage.pngimage.pngimage.pngimage.

- 用通俗易懂的方式讲解:关键词提取方法总结及实现

深度学习算法与自然语言处理

机器学习人工智能python

文章目录一、关键词提取概述二、TF-IDF关键词提取算法及实现三、TextRank关键词提取算法实现四、LDA主题模型关键词提取算法及实现五、Word2Vec词聚类的关键词提取算法及实现六、信息增益关键词提取算法及实现七、互信息关键词提取算法及实现八、卡方检验关键词提取算法及实现九、基于树模型的关键词提取算法及实现十、总结NLP内容序列目录一、关键词提取概述关键词是能够表达文档中心内容的词语,常用

- 「NLP主题分析」LDA隐含狄利克雷分布(Latent Dirichlet Allocation)

Reese小朋友

MachineLearningStuffs自然语言处理人工智能

是基于贝叶斯思想的无监督的聚类算法,广泛用于文本聚类,文本分析,文本关键词等场景。LDA主题模型主要用于推测文档的主题分布,可以将文档集中每篇文档的主题以概率分布的形式给出根据主题进行主题聚类或文本分类。LDA主题模型不关心文档中单词的顺序,通常使用词袋特征(bag-of-wordfeature)来代表文档。-先了解LDA的生成模型,LDA认为一篇文章是怎么形成的呢?LDA模型认为主题可以由一个词

- 解决用pyLDAvis做可视化的时候报错:TerminatedWorkerError: A worker process managed by the executor was...

分毫析厘

pythonpipconda

最近在学LDA主题模型分析,前面文本预处理的代码都调试好了,最后用pyLDAvis进行可视化的时候一直报错:TerminatedWorkerError:Aworkerprocessmanagedbytheexecutorwasunexpectedlyterminated.Thiscouldbecausedbyasegmentationfaultwhilecallingthefunctionorby

- 如何基于gensim和Sklearn实现文本矢量化

一马平川的大草原

数据处理后端机器学习sklearnpython自然语言处理文本向量化

大家利用机器学习或深度学习开展文本分类或关联性分析之前,由于计算机只能分析数值型数据,而人类所熟悉的自然语言文字,机器学习算法是一窍不通的,因此需要将大类的文本及前后关系进行设计,并将其转换为数值化表示。一般来说,文本语言模型主要有词袋模型(BOW)、词向量模型和主题模型,目前比较常见是前两种,各种机器学习框架都有相应的word2vec的机制和支持模型,比如gensim和Scikit-learn(

- 转载 NLP之文本匹配及语义匹配应用介绍

chenxinvhai89

NLP

版权声明:本文为博主原创文章,遵循CC4.0BY-SA版权协议,转载请附上原文出处链接和本声明。本文链接:https://blog.csdn.net/ling620/article/details/95468908文章目录1、什么是文本匹配?2、文本匹配方法概述2-1传统文本匹配方法2-2主题模型2-3深度语义匹配模型表示型交互型3、语义匹配应用介绍3-1短文本-短文本语义匹配3-2短文本-长文本

- 基于主题模型的专利文本主题挖掘与应用研究- 专利文本主题挖掘方法

hannah_luo

基于分类需要认为提前设定好一定的分类标准,并需要规定好各个主题类别信息,它是一种有监督或者半监督的方法,对于一个新文本的归类过程也是对其文本主题信息解读的过程。基于聚类无监督通过对聚类各个类簇进行解读,从而发现文本的主题信息。三种流程基于分类号从分类角度识别专利技术主题信息专利文本通常都有IPC分类号,该分类号对解读文本技术主题信息具有重要作用。一个专利通常都有一个以上IPC分类号,第一个为主分类

- 手把手教程:构建基于内容的数据科学文章推荐器

「已注销」

AI热点文章数据科学文章推荐器python人工智能

全文共8100字,预计学习时长16分钟众所周知,在数据科学界十分流行写博客。这种方式也体现了数据科学开源共享的根源。数据科学家们找出某一问题的创新性解法后,最喜欢做的就是将其记录下来。在数据科学界,写博客是项双赢之举,编者可从中获取知名度,读者则可获取知识。本教程会借助主题建模来归纳数据科学有关文章的特点,然后用主题模型的输出结果来搭建基于内容的推荐器。我们将以Kaggle数据集媒体文章(含内容)

- Gensim

喝醉酒的小白

Python第三方库

Gensim从最原始的非结构化的文本中,无监督的学习到文本隐层的主题向量表达;支持包括LDATF-IDFLSAword2vec等主题模型算法。官网基本概念语料Corpus向量Vector稀疏向量SparseVector模型Model安装安装环境Ubuntu18.04Anaconda3-5.3.1!pipinstallgensim!condalist|grepgensimgensim3.8.3!pi

- Gensim库——文本处理和主题建模的强大工具

非著名程序员阿强

人工智能

在信息时代,海量的文本数据不断地涌现。如何从这如山如海的文本中提取有意义的信息,成为了一项关键任务。Python语言提供了许多优秀的库和工具来处理文本数据,其中一款备受推崇的工具就是Gensim库。Gensim是一个开源的Python库,它是构建主题模型和进行文本相似度计算的先进工具。本文将介绍Gensim库,解释其基本原理和功能,并通过实例演示如何使用Gensim库进行文本处理和主题建模。一、G

- RabbitMq

春雨燎原

中间件rabbitmq分布式

目录一、为什么要用到RabbitMq?二、RabbitMq有什么作用?1.解耦2.异步三、RabbitMq的模型1.helloword模型2.Work模型3.发布订阅模型4.路由键模型5.主题模型四、RabbitMq跟SpringBoot的整合1.导入依赖2.yml配置3.创建队列、创建交换机、将队列与交换机绑定并设置路由键4.生产者发送消息5.消费者消费消息五、ACK机制1.什么是消息确认机制?

- 基于LDA主题+协同过滤+矩阵分解算法的智能电影推荐系统——机器学习算法应用(含python、JavaScript工程源码)+MovieLens数据集(三)

小胡说人工智能

机器学习推荐系统学习路线机器学习pythonjavascripthtmldjango人工智能协同过滤

目录前言总体设计系统整体结构图系统流程图运行环境模块实现1.数据爬取及处理2.模型训练及保存1)协同过滤2)矩阵分解3)LDA主题模型3.接口实现1)流行电影推荐2)相邻用户推荐3)相似内容推荐相关其它博客工程源代码下载其它资料下载前言前段时间,博主分享过关于一篇使用协同过滤算法进行智能电影推荐系统的博文《基于TensorFlow+CNN+协同过滤算法的智能电影推荐系统——深度学习算法应用(含微信

- LDA模型参数设置,训练效果较好

喔就是哦噢喔

NLP中文数据处理深度学习机器学习人工智能

前言:写小论文用到lda主题模型,在网上找了一圈没有找到训练效果较好的模型参数示例。为了写出小论文做了很多次实验,达到了实验中最好的效果,故贴出代码:fromgensim.modelsimportLdaModellda=LdaModel(corpus=corpus,id2word=dictionary,num_topics=size_lda,alpha="auto",eta='auto',pass

- LDA模型,获取所有的文档-主题分布(即得到文档对于每个主题的概率分布)并保存

喔就是哦噢喔

NLP中文数据处理python自然语言处理

前言:写小论文用到lda主题模型,需要得到所有的文档-主题分布。现有的只是为文档输出前几个概率大的主题代码:importnumpyasnpfromgensim.modelsimportLdaModel#训练lda模型lda=LdaModel(corpus=corpus,id2word=dictionary,num_topics=size_lda,minimum_probability=0)"""s

- NLP-词向量-发展:词袋模型【onehot、tf-idf】 -> 主题模型【LSA、LDA】 -> 词向量静态表征【Word2vec、GloVe、FastText】 -> 词向量动态表征【Bert】

u013250861

#NLP/词向量_预训练模型word2vecbert自然语言处理

NLP-词向量-发展:词袋模型【onehot、tf-idf】主题模型【LSA、LDA】基于词向量的静态表征【Word2vec、GloVe、FastText】基于词向量的动态表征【Bert】一、词袋模型(Bag-Of-Words)1、One-Hot词向量的维数为整个词汇表的长度,对于每个词,将其对应词汇表中的位置置为1,其余维度都置为0。缺点是:维度非常高,编码过于稀疏,易出现维数灾难问题;不能体现

- 主题模型LDA教程:n-gram N元模型和nltk应用

Cachel wood

自然语言处理nlpeasyui前端javascriptLDAngramnltknlp

文章目录N-Gram模型原理概率估计nltk使用n-gramN-Gram模型N-Gram(N元模型)是自然语言处理中一个非常重要的概念。N-gram模型也是一种语言模型,是一种生成式模型。假定文本中的每个词wiw_{i}wi和前面N−1N-1N−1个词有关,而与更前面的词无关。这种假设被称为N-1阶马尔可夫假设,对应的语言模型称为N元模型。习惯上,1-gram叫unigram,2-gram称为bi

- 主题模型LDA教程:一致性得分coherence score方法对比(umass、c_v、uci)

Cachel wood

自然语言处理nlp机器学习人工智能numpynlpldaumassuci

文章目录主题建模潜在迪利克雷分配(LDA)一致性得分coherencescore1.CV一致性得分2.UMass一致性得分3.UCI一致性得分4.Word2vec一致性得分5.选择最佳一致性得分主题建模主题建模是一种机器学习和自然语言处理技术,用于确定文档中存在的主题。它能够确定单词或短语属于某个主题的概率,并根据它们的相似度或接近度对文档进行聚类。它通过分析文档中单词和短语的频率来实现这一目的。

- LDA主题模型中coherence(一致性)报错得出来为nan解决办法

Pluviophile_miao~

笔记python开发语言

参考链接:https://www.codenong.com/60246570/报错原因:D:\software\Anaconda\envs\LDA\lib\site-packages\gensim\topic_coherence\direct_confirmation_measure.py:204:RuntimeWarning:dividebyzeroencounteredindouble_sca

- 关于旗正规则引擎规则中的上传和下载问题

何必如此

文件下载压缩jsp文件上传

文件的上传下载都是数据流的输入输出,大致流程都是一样的。

一、文件打包下载

1.文件写入压缩包

string mainPath="D:\upload\"; 下载路径

string tmpfileName=jar.zip; &n

- 【Spark九十九】Spark Streaming的batch interval时间内的数据流转源码分析

bit1129

Stream

以如下代码为例(SocketInputDStream):

Spark Streaming从Socket读取数据的代码是在SocketReceiver的receive方法中,撇开异常情况不谈(Receiver有重连机制,restart方法,默认情况下在Receiver挂了之后,间隔两秒钟重新建立Socket连接),读取到的数据通过调用store(textRead)方法进行存储。数据

- spark master web ui 端口8080被占用解决方法

daizj

8080端口占用sparkmaster web ui

spark master web ui 默认端口为8080,当系统有其它程序也在使用该接口时,启动master时也不会报错,spark自己会改用其它端口,自动端口号加1,但为了可以控制到指定的端口,我们可以自行设置,修改方法:

1、cd SPARK_HOME/sbin

2、vi start-master.sh

3、定位到下面部分

- oracle_执行计划_谓词信息和数据获取

周凡杨

oracle执行计划

oracle_执行计划_谓词信息和数据获取(上)

一:简要说明

在查看执行计划的信息中,经常会看到两个谓词filter和access,它们的区别是什么,理解了这两个词对我们解读Oracle的执行计划信息会有所帮助。

简单说,执行计划如果显示是access,就表示这个谓词条件的值将会影响数据的访问路径(表还是索引),而filter表示谓词条件的值并不会影响数据访问路径,只起到

- spring中datasource配置

g21121

dataSource

datasource配置有很多种,我介绍的一种是采用c3p0的,它的百科地址是:

http://baike.baidu.com/view/920062.htm

<!-- spring加载资源文件 -->

<bean name="propertiesConfig"

class="org.springframework.b

- web报表工具FineReport使用中遇到的常见报错及解决办法(三)

老A不折腾

finereportFAQ报表软件

这里写点抛砖引玉,希望大家能把自己整理的问题及解决方法晾出来,Mark一下,利人利己。

出现问题先搜一下文档上有没有,再看看度娘有没有,再看看论坛有没有。有报错要看日志。下面简单罗列下常见的问题,大多文档上都有提到的。

1、repeated column width is largerthan paper width:

这个看这段话应该是很好理解的。比如做的模板页面宽度只能放

- mysql 用户管理

墙头上一根草

linuxmysqluser

1.新建用户 //登录MYSQL@>mysql -u root -p@>密码//创建用户mysql> insert into mysql.user(Host,User,Password) values(‘localhost’,'jeecn’,password(‘jeecn’));//刷新系统权限表mysql>flush privileges;这样就创建了一个名为:

- 关于使用Spring导致c3p0数据库死锁问题

aijuans

springSpring 入门Spring 实例Spring3Spring 教程

这个问题我实在是为整个 springsource 的员工蒙羞

如果大家使用 spring 控制事务,使用 Open Session In View 模式,

com.mchange.v2.resourcepool.TimeoutException: A client timed out while waiting to acquire a resource from com.mchange.

- 百度词库联想

annan211

百度

<!DOCTYPE html>

<html>

<head>

<meta http-equiv="Content-Type" content="text/html; charset=UTF-8">

<title>RunJS</title&g

- int数据与byte之间的相互转换实现代码

百合不是茶

位移int转bytebyte转int基本数据类型的实现

在BMP文件和文件压缩时需要用到的int与byte转换,现将理解的贴出来;

主要是要理解;位移等概念 http://baihe747.iteye.com/blog/2078029

int转byte;

byte转int;

/**

* 字节转成int,int转成字节

* @author Administrator

*

- 简单模拟实现数据库连接池

bijian1013

javathreadjava多线程简单模拟实现数据库连接池

简单模拟实现数据库连接池

实例1:

package com.bijian.thread;

public class DB {

//private static final int MAX_COUNT = 10;

private static final DB instance = new DB();

private int count = 0;

private i

- 一种基于Weblogic容器的鉴权设计

bijian1013

javaweblogic

服务器对请求的鉴权可以在请求头中加Authorization之类的key,将用户名、密码保存到此key对应的value中,当然对于用户名、密码这种高机密的信息,应该对其进行加砂加密等,最简单的方法如下:

String vuser_id = "weblogic";

String vuse

- 【RPC框架Hessian二】Hessian 对象序列化和反序列化

bit1129

hessian

任何一个对象从一个JVM传输到另一个JVM,都要经过序列化为二进制数据(或者字符串等其他格式,比如JSON),然后在反序列化为Java对象,这最后都是通过二进制的数据在不同的JVM之间传输(一般是通过Socket和二进制的数据传输),本文定义一个比较符合工作中。

1. 定义三个POJO

Person类

package com.tom.hes

- 【Hadoop十四】Hadoop提供的脚本的功能

bit1129

hadoop

1. hadoop-daemon.sh

1.1 启动HDFS

./hadoop-daemon.sh start namenode

./hadoop-daemon.sh start datanode

通过这种逐步启动的方式,比start-all.sh方式少了一个SecondaryNameNode进程,这不影响Hadoop的使用,其实在 Hadoop2.0中,SecondaryNa

- 中国互联网走在“灰度”上

ronin47

管理 灰度

中国互联网走在“灰度”上(转)

文/孕峰

第一次听说灰度这个词,是任正非说新型管理者所需要的素质。第二次听说是来自马化腾。似乎其他人包括马云也用不同的语言说过类似的意思。

灰度这个词所包含的意义和视野是广远的。要理解这个词,可能同样要用“灰度”的心态。灰度的反面,是规规矩矩,清清楚楚,泾渭分明,严谨条理,是决不妥协,不转弯,认死理。黑白分明不是灰度,像彩虹那样

- java-51-输入一个矩阵,按照从外向里以顺时针的顺序依次打印出每一个数字。

bylijinnan

java

public class PrintMatrixClockwisely {

/**

* Q51.输入一个矩阵,按照从外向里以顺时针的顺序依次打印出每一个数字。

例如:如果输入如下矩阵:

1 2 3 4

5 6 7 8

9

- mongoDB 用户管理

开窍的石头

mongoDB用户管理

1:添加用户

第一次设置用户需要进入admin数据库下设置超级用户(use admin)

db.addUsr({user:'useName',pwd:'111111',roles:[readWrite,dbAdmin]});

第一个参数用户的名字

第二个参数

- [游戏与生活]玩暗黑破坏神3的一些问题

comsci

生活

暗黑破坏神3是有史以来最让人激动的游戏。。。。但是有几个问题需要我们注意

玩这个游戏的时间,每天不要超过一个小时,且每次玩游戏最好在白天

结束游戏之后,最好在太阳下面来晒一下身上的暗黑气息,让自己恢复人的生气

&nb

- java 二维数组如何存入数据库

cuiyadll

java

using System;

using System.Linq;

using System.Text;

using System.Windows.Forms;

using System.Xml;

using System.Xml.Serialization;

using System.IO;

namespace WindowsFormsApplication1

{

- 本地事务和全局事务Local Transaction and Global Transaction(JTA)

darrenzhu

javaspringlocalglobaltransaction

Configuring Spring and JTA without full Java EE

http://spring.io/blog/2011/08/15/configuring-spring-and-jta-without-full-java-ee/

Spring doc -Transaction Management

http://docs.spring.io/spri

- Linux命令之alias - 设置命令的别名,让 Linux 命令更简练

dcj3sjt126com

linuxalias

用途说明

设置命令的别名。在linux系统中如果命令太长又不符合用户的习惯,那么我们可以为它指定一个别名。虽然可以为命令建立“链接”解决长文件名的问 题,但对于带命令行参数的命令,链接就无能为力了。而指定别名则可以解决此类所有问题【1】。常用别名来简化ssh登录【见示例三】,使长命令变短,使常 用的长命令行变短,强制执行命令时询问等。

常用参数

格式:alias

格式:ali

- yii2 restful web服务[格式响应]

dcj3sjt126com

PHPyii2

响应格式

当处理一个 RESTful API 请求时, 一个应用程序通常需要如下步骤 来处理响应格式:

确定可能影响响应格式的各种因素, 例如媒介类型, 语言, 版本, 等等。 这个过程也被称为 content negotiation。

资源对象转换为数组, 如在 Resources 部分中所描述的。 通过 [[yii\rest\Serializer]]

- MongoDB索引调优(2)——[十]

eksliang

mongodbMongoDB索引优化

转载请出自出处:http://eksliang.iteye.com/blog/2178555 一、概述

上一篇文档中也说明了,MongoDB的索引几乎与关系型数据库的索引一模一样,优化关系型数据库的技巧通用适合MongoDB,所有这里只讲MongoDB需要注意的地方 二、索引内嵌文档

可以在嵌套文档的键上建立索引,方式与正常

- 当滑动到顶部和底部时,实现Item的分离效果的ListView

gundumw100

android

拉动ListView,Item之间的间距会变大,释放后恢复原样;

package cn.tangdada.tangbang.widget;

import android.annotation.TargetApi;

import android.content.Context;

import android.content.res.TypedArray;

import andr

- 程序员用HTML5制作的爱心树表白动画

ini

JavaScriptjqueryWebhtml5css

体验效果:http://keleyi.com/keleyi/phtml/html5/31.htmHTML代码如下:

<!DOCTYPE html>

<html xmlns="http://www.w3.org/1999/xhtml"><head><meta charset="UTF-8" >

<ti

- 预装windows 8 系统GPT模式的ThinkPad T440改装64位 windows 7旗舰版

kakajw

ThinkPad预装改装windows 7windows 8

该教程具有普遍参考性,特别适用于联想的机器,其他品牌机器的处理过程也大同小异。

该教程是个人多次尝试和总结的结果,实用性强,推荐给需要的人!

缘由

小弟最近入手笔记本ThinkPad T440,但是特别不能习惯笔记本出厂预装的Windows 8系统,而且厂商自作聪明地预装了一堆没用的应用软件,消耗不少的系统资源(本本的内存为4G,系统启动完成时,物理内存占用比

- Nginx学习笔记

mcj8089

nginx

一、安装nginx 1、在nginx官方网站下载一个包,下载地址是:

http://nginx.org/download/nginx-1.4.2.tar.gz

2、WinSCP(ftp上传工

- mongodb 聚合查询每天论坛链接点击次数

qiaolevip

每天进步一点点学习永无止境mongodb纵观千象

/* 18 */

{

"_id" : ObjectId("5596414cbe4d73a327e50274"),

"msgType" : "text",

"sendTime" : ISODate("2015-07-03T08:01:16.000Z"

- java术语(PO/POJO/VO/BO/DAO/DTO)

Luob.

DAOPOJODTOpoVO BO

PO(persistant object) 持久对象

在o/r 映射的时候出现的概念,如果没有o/r映射,就没有这个概念存在了.通常对应数据模型(数据库),本身还有部分业务逻辑的处理.可以看成是与数据库中的表相映射的java对象.最简单的PO就是对应数据库中某个表中的一条记录,多个记录可以用PO的集合.PO中应该不包含任何对数据库的操作.

VO(value object) 值对象

通

- 算法复杂度

Wuaner

Algorithm

Time Complexity & Big-O:

http://stackoverflow.com/questions/487258/plain-english-explanation-of-big-o

http://bigocheatsheet.com/

http://www.sitepoint.com/time-complexity-algorithms/