统计QQ聊天记录进阶版(分词+统计关键字出现的次数+根据词频制作词云)

继上个博客统计关键字次数的进阶,将关键词的次数制作成词云保存到图片。之前说过的部分现在就不说了,这里主要讲根据词频制作词云。

1.安装wordcloud(这里要注意坑)

这个安装的过程比jieba复杂,因为直接用pip install wordcloud会安装失败,要先下载对应的python版本对应的wordcloud。这里因为我之前有单独装过python3.7所以第一次我是下载了python3.7对应的wordcloud,然后它提示平台不支持。后来我想起来我的Anaconda3用的不是python3.7,在Anaconda Navigator中查看python对应的版本为3.6下载如下

用pip install安装

2.文件配置

1.txt为聊天记录文件,SimHei.ttf为字体格式、r.jpg为图片样式

3.词云

词云的生成可以按照词频以及以通常的方式生成。

词频使用 .generate_from_frequencies(字典类型)

通常方法使用.generate(关键字字串)

可以设置词云的相关属性:

font_path : string //字体路径,需要展现什么字体就把该字体路径+后缀名写上,如:font_path = '黑体.ttf'

width : int (default=400) //输出的画布宽度,默认为400像素

height : int (default=200) //输出的画布高度,默认为200像素

prefer_horizontal : float (default=0.90) //词语水平方向排版出现的频率,默认 0.9 (所以词语垂直方向排版出现频率为 0.1 )

mask : nd-array or None (default=None) //如果参数为空,则使用二维遮罩绘制词云。如果 mask 非空,设置的宽高值将被忽略,遮罩形状被 mask 取代。除全白(#FFFFFF)的部分将不会绘制,其余部分会用于绘制词云。如:bg_pic = imread('读取一张图片.png'),背景图片的画布一定要设置为白色(#FFFFFF),然后显示的形状为不是白色的其他颜色。可以用ps工具将自己要显示的形状复制到一个纯白色的画布上再保存,就ok了。

scale : float (default=1) //按照比例进行放大画布,如设置为1.5,则长和宽都是原来画布的1.5倍。

min_font_size : int (default=4) //显示的最小的字体大小

font_step : int (default=1) //字体步长,如果步长大于1,会加快运算但是可能导致结果出现较大的误差。

max_words : number (default=200) //要显示的词的最大个数

stopwords : set of strings or None //设置需要屏蔽的词,如果为空,则使用内置的STOPWORDS

background_color : color value (default=”black”) //背景颜色,如background_color='white',背景颜色为白色。

max_font_size : int or None (default=None) //显示的最大的字体大小

mode : string (default=”RGB”) //当参数为“RGBA”并且background_color不为空时,背景为透明。

relative_scaling : float (default=.5) //词频和字体大小的关联性

color_func : callable, default=None //生成新颜色的函数,如果为空,则使用 self.color_func

regexp : string or None (optional) //使用正则表达式分隔输入的文本

collocations : bool, default=True //是否包括两个词的搭配

colormap : string or matplotlib colormap, default=”viridis” //给每个单词随机分配颜色,若指定color_func,则忽略该方法。

fit_words(frequencies) //根据词频生成词云

generate(text) //根据文本生成词云

generate_from_frequencies(frequencies[, ...]) //根据词频生成词云

generate_from_text(text) //根据文本生成词云

process_text(text) //将长文本分词并去除屏蔽词(此处指英语,中文分词还是需要自己用别的库先行实现,使用上面的 fit_words(frequencies) )

recolor([random_state, color_func, colormap]) //对现有输出重新着色。重新上色会比重新生成整个词云快很多。

to_array() //转化为 numpy array

to_file(filename) //输出到文件

my_wordcloud = WordCloud(

background_color='white', #设置背景颜色

max_words=200, #设置最大实现的字数

font_path=r'SimHei.ttf', #设置字体格式,如不设置显示不了中文

mask=imread('timg.jpg'), #设置图片样式

width=800,

height=800,

).generate_from_frequencies(data)

plt.figure()

plt.imshow(my_wordcloud)

plt.axis('off')

plt.show() # 展示词云

my_wordcloud.to_file('z.jpg')4.完整代码

import jieba

from wordcloud import WordCloud

from scipy.misc import imread

from collections import Counter

import matplotlib.pyplot as plt

def main():

fr=open('1.txt','r',encoding='utf-8')

frequencies=[]

s=""

data={}

for line in fr:

line=line.strip()

if len(line)==0:

continue

if line[0]=='2':

continue

for x in range(0,len(line)):

if line[x] in [' ','\t','\n','。',',','[', ']', '(', ')', ':', '-',

'?', '!', '《', '》', '、', ';', '“', '”', '……','0','1','2','3','4','5','6','7','8','9','=','~','…']:

continue

s+=str(line[x])

seg_list = jieba.cut(s, cut_all=False, HMM=True)

for word in seg_list:

if len(word)>=2:

if not data.__contains__(word):

data[word]=0

data[word]+=1

#data=sorted(data.items(),key=lambda d:d[1],reverse=True) 这里必须要注释,不然会报错

#print(data)

my_wordcloud = WordCloud(

background_color='white', #设置背景颜色

max_words=200, #设置最大实现的字数

font_path=r'SimHei.ttf', #设置字体格式,如不设置显示不了中文

mask=imread('r.jpg'), #设置图片样式

width=800,

height=800,

).generate_from_frequencies(data)

plt.figure()

plt.imshow(my_wordcloud)

plt.axis('off')

plt.show() # 展示词云

my_wordcloud.to_file('z.jpg')

fr.close()

main()5.实现结果

类似的统计十九大关键字 已上传github ,用jupyter Notebook

https://github.com/joyceyang999/19thCongressPY

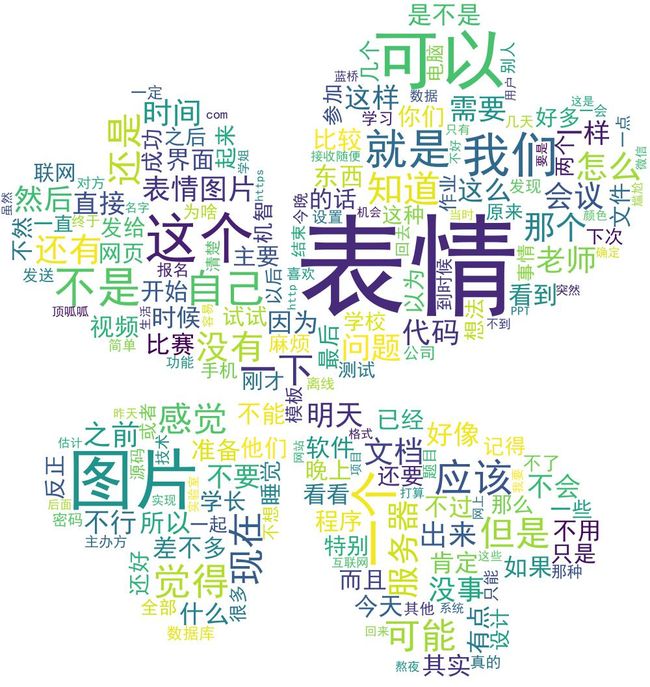

效果图: