ICML_2018学霸笔记2.1

2.1 深度学习的理论认识:

(主讲人:Sanjeev Arora)

专业术语:

- 深度网络参数

分布D的第ii次训练

分布D的第ii次训练 :损失函数

:损失函数- 目标:

![arg min_{\theta }E_{i}[l(\theta ,x_{i},y_{i})]](http://img.e-com-net.com/image/info8/2d3c7e8c04864555b59a4798ffef7ec5.gif)

- 梯度下降:

![]()

要点:优化概念形成了深度学习

理论目标:通过竞争直觉的排序的定理,形成新的观点和概念。新观点的数学基础。

演讲概述:

- 优化:什么时候/怎样找到下降方案。尤其是非凸问题。

- 过度参数化/泛化:当参数远大于训练样本时,还有效吗?为什么网络没有泛化能力?

- 深度的作用

- 非监督学习/GAN网络

- 更简单的方法来替代深度学习

2.1.1 优化

要点:优化的概念形成了深度学习

难点:大部分优化问题都是非凸的。所以,我们不希望有多项式时间算法。

优化的大概方向:

- 找到关键点

- 找到局部最优解:

是半正定的

是半正定的 - 找到全局最优解,

关于初始化的假设:

- 证明从所有起始点

都收敛

都收敛 - 证明随机初始化的点收敛

- 证明从特殊的初始化点收敛

注意:如果在实数域优化,然后你想要让运行时间poly(d,1/![]() ),

),![]() 是准确率。上街市exp(d/

是准确率。上街市exp(d/![]() )的指数。

)的指数。

维数灾难:在实数域,任意exp(d)平行角大于60度的方向。另外,任何exp(d/![]() )特别方向。所有方向都有角度,在大部分

)特别方向。所有方向都有角度,在大部分![]() (

(![]() 覆盖)中的一个。

覆盖)中的一个。

深度学习的黑箱分析。为什么只有损失方程,而不知道中间发生了什么。我们基本没有(x,y)数学特征,因为y只是一个关于x的复杂的函数(想想图像中分类对象:x是一张图片,y是“狗”)

替代地,我们能够使。使用这个黑箱分![]() 析,我们不能达到全局最优解。

析,我们不能达到全局最优解。

梯度下降:

所以,存在一个梯度方向

所以,存在一个梯度方向- 但是如果

很大的话,会导致

很大的话,会导致 剧烈震荡!

剧烈震荡! - 所以,为了确保下降,我们做了一个小小的平滑:

![]()

定义2.1:如果![]() ,我们就可以得到

,我们就可以得到![]() 与

与![]() 成正比。

成正比。

证明|:

但是,这里的解决方案是关键点,比较弱。一个优化方向是:避免鞍点,像Ge在PerturbedSGD中引述的。

那第二个优化呢?像牛顿法。所以我们这样思考:

![]()

这让我们以额外的计算作为代价,对于解决方案有了更好的保证。

非黑箱分析。很多ML问题,两个神经元网络的子类。

- 对网络结构,数据分布作假设

- 可能使用从SGD使用不同的算法

问题:矩阵完成。假设我们给一个秩为r的nxn的矩阵M,有一些缺失项:

![]()

目标是预测出那些缺失项->学习深度为2的线性网络子类!输入1-hot输入到未知网络;设置输出为一个随机输出节点。然后,学习网络!最近的工作:所有这个问题的局部最小值,(被19证明了,对于任意的起始点)

学习多层网络的定理?是的!但通常只针对线性网络。概括网络:矩阵转换的产物。一些萌芽的理论:

- 连接物理学:自然梯度/拉格朗日方法

- 对抗实例和努力对抗他们

- 对于无监督学习的优化

- 信息论的联系

2.1.2 过度参数化和泛化理论

引导性问题:为什么用VGG19(2千万个参数)训练CIFAR10是个好办法?

过量参数会帮助优化:民间实验。

- 通过输入随机输入向量到一个有n层隐藏网络的2层网络生成标签数据

- 使用这些标签数据相同数量的隐藏节点很难训练一个新的网络

- 但是:用更多的隐藏层更容易训练一个新的网络

- (仍然没有定理来解释这个)

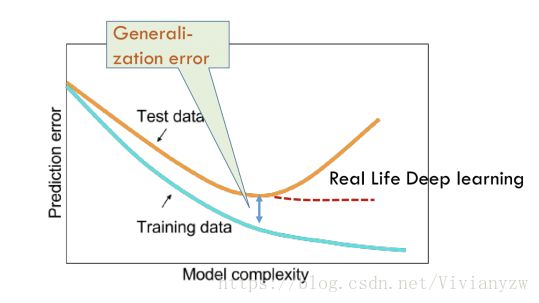

不过当然,课本上警告我们:大型网络容易过拟合:

但,最近工作闲时,超额容量网络仍然存在

希望:这些概念可以解释“训练好的网络”更好的观点

有效容量:粗略的,log(不同的鲜艳模型)。生成理论告诉我们

![]()

这里m是训练样本数量,N是参数量,VC维度,Rademacher复杂度

担忧,虽然:对于深度网络,N作主导是毫无意义的。理想的,通过草稿证明:

- 固定一个网络的参数

- 拿m个数据点,i,i,d维样本S”为例:

![]()

- 通过关注的界限,对于固定网络

,我们能得到一般注意力不等式:

,我们能得到一般注意力不等式:

![]()

Von Neumann:"可靠的机器和不可靠的元件。在人类和动物大脑中,我们有大量的和相对可靠的系统的例子,这些系统是由个体组成的,这些神经元看起来是不可靠的。在通信理论中,这可以通过适当引入的冗余来完成。"

新观点:基于压缩的方法对生成界限(引自Arora今年的ICML)这个界限粗略地表示为:

![]()

总结泛化性的一些观点:

- 最近的进展!但最后的方法还在写。

- 我们不知道为什么被训练的网络是噪声稳定的

- 定量界限太弱,很难解释为什么2千万个参数的网络泛化5万个数据的训练。

- 参数需要更多的训练算法或数据分布的属性

2.1.3 深度学习中深度的作用

理想的结果:显然自然学习问题不能实用深度d来解决,但可以用d+k个深度来解决。

关键是,我们讨论的是自然学习问题,它往往不具备好的数学化公式。最近的研究显示,非自然案例中确实是这样的。

问题:在深度学习中,更深的深度是好还是不好?

- 优点:更好的表示

- 缺点:更加难以优化

- 新的结果!Arora等证明更深的深度有时能够加速优化,包括经典的凸问题。

考虑回归问题,尤其,![]() 回归:

回归:

![]()

现在,我们用2层线性回归替换这个,所以,我们用w1w2来替换w(过参数化!):

![]()

为什么会这样?梯度下降可能采取的路径,可能更简单一点。梯度现在下降到:

2.1.4 生成模型和对抗网络的理论

无监督学习动机:“多种假设”

目标:使用大量的无标签数据,学习从图像到代码的映射。这里希望代码在分类任务上对于X是个好的下游替代品。

Generative Adversarial Nets(GANs)对抗生成网络

- 动机:避免可能的目标,这有利于输出模糊图像

- 替代log形式,用对抗学习的能力。项目新目标:

![]()

如果目标近似等于0,生成器获胜,之后的训练如果判别器没有奏效(到达均衡)

问题:什么会坏了GAN训练者的一天?答案是:模式崩溃!观点:自从判别器只从一小部分样本中学习,可能就不能教生成器来生成一个分布![]() 足够大的多样性。

足够大的多样性。

从理论上的新思路:问题不是训练样本个数,而是判别器的尺寸/容量!

定理2.2 Arora等提出:如果判别器 size=N,那么任意一个生成器产生的分布支持O(NlogN)的时间复杂度的输入,忍让反对所有可能的判别器。

主要观点:小的判别器本来就无法检测模式崩溃。GAN训练对象不保证避免模式崩溃。但是,这个真的会发生吗?答案是,是的!回想一下生日北仑。日过你在一个房间内放入大于23个人,那就有大于50%的机会,两个人是同一天升到额。注意![]() 。

。

另外,如果N个图片的分布,那么![]() 个样本的几率大于50%。

个样本的几率大于50%。

简单来讲:无监督学习需要新的方法

无监督学习动机:多种假设

可能的坑:对于学好的代码,然后p(X,Z)需要学习来达到非常高的准确率,因为你将把代码放入下游任务。但这个可能并不会发生。

所以:一般的故事都有点离题。

思考:

- 最大化log形式会导致数据的不稳定

- 怎样定义GANs的实用?

- 需要使用一个有效方法来定义无监督学习

2.1.5 无深度学习

考虑两个句子,这两个句子我们看起来很相似:

- 狮子统治丛林 A lion rules the jungle

- 老虎在森林里狩猎 The tiger hunts in the forest

问题:没有共同的单词。所以我们怎样抓住文本/句子的相似性呢?

通常的方法:文本嵌入

(Ben Recht?)线性原则:“在考虑深度模型前,先看看线性方法行不行”但是Sanjeev说,Ben并没说这是他的做法。

表示学习的要点就是找到数据的真实结构,分类就变得简单了。但是,下游的任务是无法提前知道的。所以,表示似乎就要抓住全部或大部分的信息(比如词包)

恢复算法:

![]()

但是,Calderbank等说线性分类压缩向量Ax和x表现得一样好。

连接RL:简单的线性模型在RL中可以打败最好的深度RL在一些简单的问题上。线性原则,可以用!看看Ben的论文(下节)

2.1.6 总结

如何工作:

- 使用物理/PDE的角度,比如变分计算(拉格朗日,哈密顿量)

- 看看无监督学习!是的,所有的东西都非常难而且新,但我们总要学会成长!

- 深度强化学习的理论。现在非常少!

- 比3更多一些,设计又去的语言学习和技巧的交互模型。理论和引用工作都缺少一些基本思路。

- “最好的理论是真实的数据和真正的深度网络训练涌现出来的。(非凸性和随之而来的复杂性会让那些脱离实际的理论看起来不那么美丽了)”

- Hilbert:“在数学上没有'无知'”