CDH版Hadoop云服务器的单节点和集群安装(附CDH自编译版本)

上一篇写过 Apache版的Hadoop安装,

https://blog.csdn.net/beishanyingluo/article/details/101938568

这里写一下 CDH版重新编译后的Hadoop版本的安装:

编译后版本 hadoop-2.6.0-cdh5.14.0-自己编译后的版本.tar.gz 连接:

链接:https://pan.baidu.com/s/1fyaL6XbveqGRrp_ZVBdKNw

提取码:yygz

1.下载文件上传到云服务器并解压:1.上传路径为:

/opt/hadoop/soft

解压:

tar -zxvf hadoop-2.6.0-cdh5.14.0-自己编译后的版本.tar.gz -C /opt/hadoop/servers/

2.查看hadoop支持的压缩方式以及本地库

cd /opt/hadoop/servers/hadoop-2.6.0-cdh5.14.0/

bin/hadoop checknative

出现openssl为false,那么机器在线安装openssl即可,执行以下命令,就可以在线进行安装了:

yum -y install openssl-devel

3.修改配置文件

不管是单节点还是集群,都在主服务器上进行以下文件的修改!!

进入下面的目录:

cd /opt/hadoop/servers/hadoop-2.6.0-cdh5.14.0/etc/hadoop/

3.1 core-site.xml

vim core-site.xml

编辑内容:

<configuration>

<property>

<name>fs.defaultFS</name>

<value>hdfs://localhost:8020</value>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>/opt/hadoop/servers/hadoop-2.6.0-cdh5.14.0/hadoopDatas/tempDatas</value>

</property>

<!-- 缓冲区大小,实际工作中根据服务器性能动态调整 -->

<property>

<name>io.file.buffer.size</name>

<value>4096</value>

</property>

<!-- 开启hdfs的垃圾桶机制,删除掉的数据可以从垃圾桶中回收,单位分钟 -->

<property>

<name>fs.trash.interval</name>

<value>10080</value>

</property>

</configuration>

如果为集群,将上面的loclhost换为第一个服务(主服务器)的ip或者hostname即可

3.2 hdfs-site.xml

vim hdfs-site.xml

编辑内容:

<configuration>

<!-- NameNode存储元数据信息的路径,实际工作中,一般先确定磁盘的挂载目录,然后多个目录用,进行分割 -->

<!-- 集群动态上下线

<property>

<name>dfs.hosts</name>

<value>/opt/hadoop/servers/hadoop-2.6.0-cdh5.14.0/etc/hadoop/accept_host</value>

</property>

<property>

<name>dfs.hosts.exclude</name>

<value>/opt/hadoop/servers/hadoop-2.6.0-cdh5.14.0/etc/hadoop/deny_host</value>

</property>

-->

<property>

<name>dfs.namenode.secondary.http-address</name>

<value>localhost:50090</value>

</property>

<property>

<name>dfs.namenode.http-address</name>

<value>localhost:50070</value>

</property>

<property>

<name>dfs.namenode.name.dir</name>

<value>file:///opt/hadoop/servers/hadoop-2.6.0-cdh5.14.0/hadoopDatas/namenodeDatas</value>

</property>

<!-- 定义dataNode数据存储的节点位置,实际工作中,一般先确定磁盘的挂载目录,然后多个目录用,进行分割 -->

<property>

<name>dfs.datanode.data.dir</name>

<value>file:///opt/hadoop/servers/hadoop-2.6.0-cdh5.14.0/hadoopDatas/datanodeDatas</value>

</property>

<property>

<name>dfs.namenode.edits.dir</name>

<value>file:///opt/hadoop/servers/hadoop-2.6.0-cdh5.14.0/hadoopDatas/dfs/nn/edits</value>

</property>

<property>

<name>dfs.namenode.checkpoint.dir</name>

<value>file:///opt/hadoop/servers/hadoop-2.6.0-cdh5.14.0/hadoopDatas/dfs/snn/name</value>

</property>

<property>

<name>dfs.namenode.checkpoint.edits.dir</name>

<value>file:///opt/hadoop/servers/hadoop-2.6.0-cdh5.14.0/hadoopDatas/dfs/nn/snn/edits</value>

</property>

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

<property>

<name>dfs.permissions</name>

<value>false</value>

</property>

<property>

<name>dfs.blocksize</name>

<value>134217728</value>

</property>

</configuration>

如果为集群,将上面的loclhost换为第一个服务(主服务器)的ip或者hostname即可

3.3 hadoop-env.sh

vim hadoop-env.sh

编辑内容:jdk安装路径

export JAVA_HOME=/opt/hadoop/servers/jdk1.8.0_221/

3.4 mapred-site.xml

将服务器上的 mapred-site.xml.template 修改为 mapred-site.xml

vim mapred-site.xml

编辑内容:

<configuration>

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

<property>

<name>mapreduce.job.ubertask.enable</name>

<value>true</value>

</property>

<property>

<name>mapreduce.jobhistory.address</name>

<value>localhost:10020</value>

</property>

<property>

<name>mapreduce.jobhistory.webapp.address</name>

<value>localhost:19888</value>

</property>

</configuration>

如果为集群,将上面的loclhost换为第一个服务(主服务器)的ip或者hostname即可

3.5 yarn-site.xml

vim yarn-site.xml

编辑内容:

<configuration>

<property>

<name>yarn.resourcemanager.hostname</name>

<value>localhost</value>

</property>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<property>

<name>yarn.log-aggregation-enable</name>

<value>true</value>

</property>

<property>

<name>yarn.log-aggregation.retain-seconds</name>

<value>604800</value>

</property>

</configuration>

如果为集群,将上面的loclhost换为第一个服务(主服务器)的ip或者hostname即可

3.6 slaves

vim slaves

如果是单节点:

localhost

如果为集群:集群中的服务器ip或者hostname

node01

node02

node03

4.创建文件存放目录

mkdir -p /opt/hadoop/servers/hadoop-2.6.0-cdh5.14.0/hadoopDatas/tempDatas

mkdir -p /opt/hadoop/servers/hadoop-2.6.0-cdh5.14.0/hadoopDatas/namenodeDatas

mkdir -p /opt/hadoop/servers/hadoop-2.6.0-cdh5.14.0/hadoopDatas/datanodeDatas

mkdir -p /opt/hadoop/servers/hadoop-2.6.0-cdh5.14.0/hadoopDatas/dfs/nn/edits

mkdir -p /opt/hadoop/servers/hadoop-2.6.0-cdh5.14.0/hadoopDatas/dfs/snn/name

mkdir -p /opt/hadoop/servers/hadoop-2.6.0-cdh5.14.0/hadoopDatas/dfs/nn/snn/edits

5.安装包的分发 (如果有多台服务,没有就忽略此步骤)

cd /opt/hadoop/servers/

scp -r hadoop-2.6.0-cdh5.14.0/ 192.168.1.1:$PWD

scp -r hadoop-2.6.0-cdh5.14.0/ 192.168.1.2:$PWD

6.配置hadoop的环境变量

如果有多台机器,每台机器都要配置:

vim /etc/profile

编辑:

export HADOOP_HOME=/opt/hadoop/servers/hadoop-2.6.0-cdh5.14.0

export PATH=:$HADOOP_HOME/bin:$PATH

export PATH=:$HADOOP_HOME/sbin:$PATH

或者:

export HADOOP_HOME=/opt/hadoop/servers/hadoop-2.6.0-cdh5.14.0

export PATH=:$HADOOP_HOME/bin:$HADOOP_HOME/sbin:$PATH

配置完成之后生效

source /etc/profile

7.单节点启动或集群启动

要启动 Hadoop 集群,需要启动 HDFS 和 YARN 两个集群。

注意:首次启动HDFS时,必须对其进行格式化操作。本质上是一些清理和准备工作,因为此时的 HDFS 在物理上还是不存在的。

bin/hdfs namenode -format

或者:

bin/hadoop namenode –format

单个节点逐一启动

在主节点上使用以下命令启动 HDFS NameNode:

hadoop-daemon.sh start namenode

在每个从节点上使用以下命令启动 HDFS DataNode:

hadoop-daemon.sh start datanode

在主节点上使用以下命令启动 YARN ResourceManager:

yarn-daemon.sh start resourcemanager

在每个从节点上使用以下命令启动 YARN nodemanager:

yarn-daemon.sh start nodemanager

历史

mr-jobhistory-daemon.sh start historyserver

以上脚本位于$HADOOP_PREFIX/sbin/目录下。如果想要停止某个节点上某个角色,只需要把命令中的start 改为stop 即可

脚本一键启动

如果配置了 etc/hadoop/slaves 和 ssh 免密登录,则可以使用程序脚本启动所有Hadoop 两个集群的相关进程,在主节点所设定的机器上执行。

启动集群

node01节点上执行以下命令

第一台机器执行以下命令

cd /export/servers/hadoop-2.6.0-cdh5.14.0/

sbin/start-dfs.sh

sbin/start-yarn.sh

sbin/mr-jobhistory-daemon.sh start historyserver

启动完,执行jps命令查看一下:

[root@VM_0_8_centos hadoop-2.6.0-cdh5.14.0]# jps

9137 DataNode

8980 NameNode

9288 ResourceManager

9771 Jps

9579 NodeManager

9740 JobHistoryServer

停止集群:没事儿不要去停止集群

sbin/stop-dfs.sh

sbin/stop-yarn.sh

sbin/mr-jobhistory-daemon.sh start historyserver

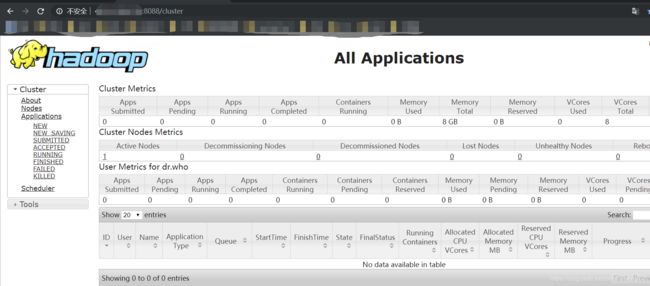

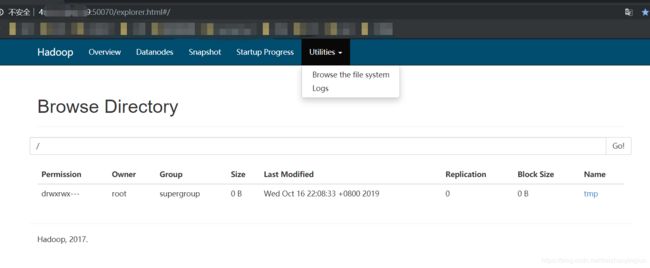

8.浏览器查看启动页面

hdfs集群访问地址

http://19.16.5.1:50070/dfshealth.html#tab-overview

yarn集群访问地址

http://19.16.5.1.100:8088/cluster

jobhistory访问地址:

完!!