- spark学习资料

Liam_ml

AdvancedApacheSpark-SameerFarooqui(Databricks)”(https://www.youtube.com/watch?v=7ooZ4S7Ay6Y)将几天的课程浓缩到了一天,质量非常好。Spark的文档:Overview-Spark1.6.1Documentation,这里面包含项目介绍,代码示例,配置,部署,调优等等,入门使用足够了。Sparkrepo:apa

- Hudi学习 6:Hudi使用

hzp666

Hudihudi数据湖湖仓一体湖仓融合实时数仓

准备工作:1.安装hdfshttps://mp.csdn.net/mp_blog/creation/editor/1096891432.安装sparkspark学习4:spark安装_hzp666的博客-CSDN博客3.安装ScalaHudi学习6:安装和基本操作_hzp666的博客-CSDN博客spark-shell写入和读取hudi2.模拟数据插入hudi使用spark写入数据

- spark学习4:spark安装

hzp666

sparkspark大数据

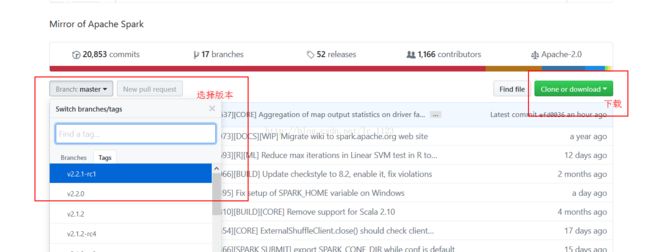

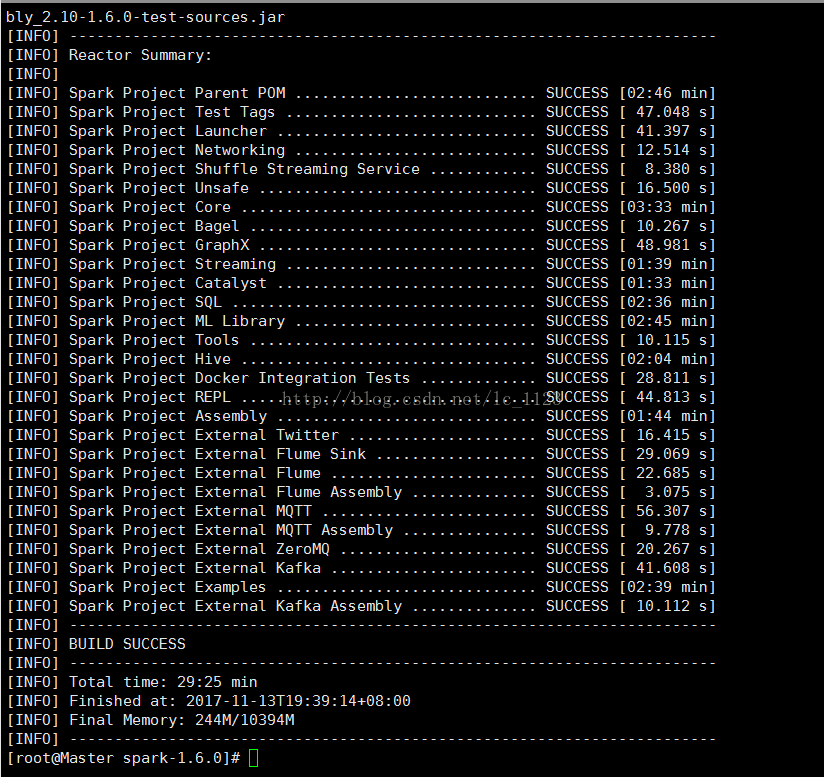

1.下载spark安装包2.配置环境1.cd/bigdata/spark-3.0.1-bin-hadoop3.2/conf/2.4.添加动态库在hadoop-3.2.2/bin目录下添加hadoop.dll和winutils.exe文件,可以从https://github.com/cdarlint/winutils和https://github.com/steveloughran/winutils

- pyspark学习-自定义udf

heiqizero

sparkspark

#demo1:frompyspark.sqlimportSparkSession,Rowif__name__=='__main__':spark=SparkSession.builder.getOrCreate()num=spark.sparkContext.parallelize([1,2,3,4,5]).map(lambdax:Row(num=x))numDF=spark.createData

- pyspark学习-spark.sql.functions normal函数

heiqizero

sparkspark

1.col#col(col)"""作用:返回一个基于已给列名的列信息场景:类似于dataframe格式中提取data["id"],能够进行计算参数: col:列名 返回: column:返回一个基于已给列名的列信息"""spark=SparkSession.builder.getOrCreate()data=spark.range(3)data.select(col("id").alias(

- [Spark] 如何设置Spark资源

LZhan

转自1.公众号[Spark学习技巧]如何设置Spark资源2.Spark性能优化篇一:资源调优Spark和YARN管理的两个主要资源:CPU和内存应用程序中每个SparkExecutor都具有相同的固定数量的核心和相同的固定堆大小。使用--executor-cores命令行参数或者通过设置spark.executor.cores属性指定核心数;使用--executor-memory命令行参数或者通

- pyspark学习-spark.sql.functions 聚合函数

heiqizero

sparkspark

https://spark.apache.org/docs/3.4.1/api/python/reference/pyspark.sql/functions.html1.approx_count_distinct和count_distinct#approx_count_distinct(col:ColumnOrName,rsd:Optionnal[float]=None)"""作用:返回列col的

- spark学习笔记:弹性分布式数据集RDD(Resilient Distributed Dataset)

黄道婆

bigdata

弹性分布式数据集RDD1.RDD概述1.1什么是RDDRDD(ResilientDistributedDataset)叫做弹性分布式数据集,是Spark中最基本的数据抽象,它代表一个不可变、可分区、里面的元素可并行计算的集合。RDD具有数据流模型的特点:自动容错、位置感知性调度和可伸缩性。RDD允许用户在执行多个查询时显式地将数据缓存在内存中,后续的查询能够重用这些数据,这极大地提升了查询速度。D

- pyspark学习_dataframe常用操作_02

heiqizero

sparkspark

#回顾01常用操作frompysparkimportSparkSession,DataFramespark=SparkSession.builder.getOrCreate()peopleDF=spark.read.json("people.json")peopleDF.printSchema()#显示DataFrame的模式信息peopleDF.show()#显示DataFrame的数据信息pe

- Spark学习笔记五:Spark资源调度和任务调度

开发者连小超

一、StageSpark任务会根据RDD之间的依赖关系,形成一个DAG有向无环图,DAG会提交给DAGScheduler,DAGScheduler会把DAG划分相互依赖的多个stage,划分stage的依据就是RDD之间的宽窄依赖。遇到宽依赖就划分stage,每个stage包含一个或多个task任务。然后将这些task以taskSet的形式提交给TaskScheduler运行。stage切割规则切

- pyspark学习_wordcount

heiqizero

sparksparkpython

#统计文件中每个字母出现次数#第一版rdd文件行类型:Aaron,OperatingSystem,100frompysparkimportSparkConf,SparkContextconf=SparkConf().setAppName("RddwordCount").setMaster("local[*]")sc=SparkContext(conf=conf)lines=sc.textFile(

- pyspark学习_RDD转为DataFrame

heiqizero

sparksparkpython

#方法1:反射机制推断RDD模式people.txtTom12Jack13Janny14frompyspark.sqlimportSparkSession,Rowspark=SparkSession.builder.getOrCreate()lines=spark.sparkContext.textFile("people.txt")people=lines.map(lambdax:x.split

- pyspark学习-RDD转换和动作

heiqizero

sparksparkpython

#RDD创建#1.parallelize方法:创建RDD,参数为list,返回RDDsc.parallelize(param:list)#demosc.parallelize(['tom','jack','black'])#2.textFile方法:读取文件,创建RDD,参数为hdfs文件地址或者本地文件地址,返回RDDsc.textFile(param:filepath)#demosc.text

- pyspark学习_dataframe常用操作_01

heiqizero

sparksparkpython

1.创建DataFrame本文使用DataFrame通过读取json文件获取数据,代码如下:frompyspark.sqlimportSparkSessionspark=SparkSeesion.builder.getOrCreate()#创建sparkSessionpeopleDF=spark.read.format("json").load("people.json")"""spark支持读取

- Spark学习(8)-SparkSQL的运行流程,Spark On Hive

技术闲聊DD

大数据hivespark学习

1.SparkSQL的运行流程1.1SparkRDD的执行流程回顾1.2SparkSQL的自动优化RDD的运行会完全按照开发者的代码执行,如果开发者水平有限,RDD的执行效率也会受到影响。而SparkSQL会对写完的代码,执行“自动优化”,以提升代码运行效率,避免开发者水平影响到代码执行效率。这是因为:RDD:内含数据类型不限格式和结构。DataFrame:100%是二维表结构,可以被针对Spar

- Apriori

BluthLeee

Apriori算法原理总结-刘建平FPTree算法原理总结-刘建平PrefixSpan算法原理总结-刘建平用Spark学习FPTree算法和PrefixSpan算法-刘建平

- Spark学习之Spark Core

John Stones

sparkbigdatascala

什么是Spark?(官网:http://spark.apache.org)https://www.cnblogs.com/lq0310/p/9841647.html

- 【大数据】Spark学习笔记

pass night

学习笔记javaspark大数据sql

初识SparkSpark和HadoopHadoopSpark起源时间20052009起源地MapReduceUniversityofCaliforniaBerkeley数据处理引擎BatchBatch编程模型MapReduceResilientdistributedDatesets内存管理DiskBasedJVMManaged延迟高中吞吐量中高优化机制手动手动APILowlevelhighleve

- spark学习之旅(2)之之RDD常用方法

浩哥的技术博客

sparkspark大数据

RDD(ResilientDistributedDataset)叫做弹性分布式数据集,是Spark中最基本的数据抽象,它代表一个不可变、可分区、里面的元素可并行计算的集合。这里的弹性指的是RDD可以根据当前情况自动进行内存和硬盘存储的转换简单点讲就是spark中对数据的一个封装,把数据封装进对象,容易操作在spark中所有的计算都是围绕着RDD操作的,每个RDD都被分为多个分区,这些分区运行在集群

- spark学习一-------------------Spark算子最详细介绍

创作者mateo

spark大数据专栏spark学习ajax

Spark学习–spark算子介绍1.基本概念spark算子:为了提供方便的数据处理和计算,spark提供了一系列的算子来进行数据处理。一般算子分为action(执行算子)算子Transformation(懒执行)算子。2.Transformation算子基本介绍简介:transformation被称为懒执行算子,如果没有action算子,则代码是不会执行的,一般分为:map算子:map算子是将r

- 2017.09.06 scala spark学习

RazorH

日记

2.scala没有静态的修饰符,但object下的成员都是静态的,若有同名的class,这其作为它的伴生类。在object中一般可以为伴生类做一些初始化等操作,如我们常常使用的valarray=Array(1,2,3)(ps:其使用了apply方法)scala里的object一般特指的是伴生对象,可以通过对象名直接调用其中的成员,类似Java中的static成员,如果不在当前作用域,需要impor

- spark学习笔记(十一)——sparkStreaming-概述/特点/构架/DStream入门程序wordcount

一个人的牛牛

spark学习sparkscala大数据

目录SparkStreamingsparkStreamingDStreamsparkStreaming特点sparkStreaming构架背压机制DStream入门SparkStreamingsparkStreamingSparkStreaming用于流式数据的处理。SparkStreaming支持的数据输入源很多:Kafka、Flume、Twitter、ZeroMQ和简单的TCP套接字等等。数据

- Spark学习——1.代表性大数据技术

楓尘林间

SparkSpark大数据学习

本篇博客是学习子雨大数据之Spark入门教程的学习笔记,仅作学习之用。1.代表性的大数据技术HadoopSparkFlinkBeam主要计算模式如图1-11.1HadoopHadoop的生态系统图如图1-2开源谷歌GFS,利用MapReduce分布式并行编程,MapReduce和HDFS是Hadoop的两大核心。HDFS分布式文件管理系统Hive数据仓库数据仓库,借助底层HDFS和HBase完成存

- Spark学习笔记一

孤独的偷学者

开发环境的搭建大数据spark

文章目录1Spark架构设计与原理思想1.1Spark初始1.2Spark架构核心1.3Spark的计算阶段1.4Spark执行流程1.4Spark核心模块2Spark运行环境2.1Local模式2.2Standalone模式2.2.1上传与解压Spark压缩包2.2.2默认配置文件的修改2.2.3启动集群2.2.4配置历史服务2.2.5配置高可用(HA)1Spark架构设计与原理思想1.1Spa

- 大数据Spark学习笔记—sparkcore

Int mian[]

大数据大数据sparkhadoopscala分布式

目录Spark概述核心模块Spark编程配置IDEA配置scala环境WordCount案例Spark-Standalone运行环境Local配置步骤集群分工解压文件修改配置启动集群配置历史服务器Spark-Yarn运行环境配置步骤配置历史服务器Windows运行环境配置步骤常用端口号Spark架构核心组件DriverExecutorMaster&WorkerApplicationMasterHa

- 20210127_spark学习笔记

yehaver

spark

一、部分理论spark:由Scala语言开发的快速、通用、可扩展的基于内存的大数据分析引擎。在mapreduce上进行了优化,但没mapreduce稳定。SparkCore是spark平台的基础通用执行引擎,所有其他功能都是基于。它在外部存储系统中提供内存计算和引用数据集。spark最基础的最核心的功能SparkSQL是SparkCore之上的一个组件,它引入了一个称为SchemaRDD的新数据抽

- 【Spark学习笔记】- 1Spark和Hadoop的区别

拉格朗日(Lagrange)

#Spark学习笔记spark学习笔记

目录标题Spark是什么SparkandHadoop首先从时间节点上来看:功能上来看:SparkorHadoopSpark是什么Spark是一种基于内存的快速、通用、可扩展的大数据分析计算引擎。SparkandHadoop在之前的学习中,Hadoop的MapReduce是大家广为熟知的计算框架,那为什么咱们还要学习新的计算框架Spark呢,这里就不得不提到Spark和Hadoop的关系。首先从时间

- Spark学习笔记【基础概念】

java路飞

大数据Sparkspark大数据java

文章目录前言Spark基础Spark是什么spark和hadoop区别Spark核心模块Spark运行模式Spark运行架构运行架构Executor与Core(核)并行度(Parallelism)有向无环图(DAG)spark的提交方式clientclusterSpark核心编程三大数据结构RDD什么是RDD执行原理RDDAPIRDD创建RDD转换算子Action行动算子统计操作RDD序列化RDD

- Spark学习笔记(3)——Spark运行架构

程光CS

#Spark学习笔记

本系列文章内容全部来自尚硅谷教学视频,仅作为个人的学习笔记一、运行架构Spark框架的核心是一个计算引擎,整体来说,它采用了标准master-slave的结构。如下图所示,它展示了一个Spark执行时的基本结构。图形中的Driver表示master,负责管理整个集群中的作业任务调度。图形中的Executor则是slave,负责实际执行任务。二、核心组件由上图可以看出,对于Spark框架有两个核心组

- 【Spark学习笔记】- 4运行架构&核心组件&核心概念

拉格朗日(Lagrange)

#Spark学习笔记spark学习笔记

目录标题1运行架构2核心组件2.1Driver2.2Executor2.3Master&Worker2.4ApplicationMaster3核心概念3.1Executor与Core3.2并行度(Parallelism)3.3有向无环图(DAG)4提交流程4.1YarnClient模式4.2YarnCluster模式5分布式计算模拟5.1Driver5.2Executor5.3Executor25

- Spring4.1新特性——综述

jinnianshilongnian

spring 4.1

目录

Spring4.1新特性——综述

Spring4.1新特性——Spring核心部分及其他

Spring4.1新特性——Spring缓存框架增强

Spring4.1新特性——异步调用和事件机制的异常处理

Spring4.1新特性——数据库集成测试脚本初始化

Spring4.1新特性——Spring MVC增强

Spring4.1新特性——页面自动化测试框架Spring MVC T

- Schema与数据类型优化

annan211

数据结构mysql

目前商城的数据库设计真是一塌糊涂,表堆叠让人不忍直视,无脑的架构师,说了也不听。

在数据库设计之初,就应该仔细揣摩可能会有哪些查询,有没有更复杂的查询,而不是仅仅突出

很表面的业务需求,这样做会让你的数据库性能成倍提高,当然,丑陋的架构师是不会这样去考虑问题的。

选择优化的数据类型

1 更小的通常更好

更小的数据类型通常更快,因为他们占用更少的磁盘、内存和cpu缓存,

- 第一节 HTML概要学习

chenke

htmlWebcss

第一节 HTML概要学习

1. 什么是HTML

HTML是英文Hyper Text Mark-up Language(超文本标记语言)的缩写,它规定了自己的语法规则,用来表示比“文本”更丰富的意义,比如图片,表格,链接等。浏览器(IE,FireFox等)软件知道HTML语言的语法,可以用来查看HTML文档。目前互联网上的绝大部分网页都是使用HTML编写的。

打开记事本 输入一下内

- MyEclipse里部分习惯的更改

Array_06

eclipse

继续补充中----------------------

1.更改自己合适快捷键windows-->prefences-->java-->editor-->Content Assist-->

Activation triggers for java的右侧“.”就可以改变常用的快捷键

选中 Text

- 近一个月的面试总结

cugfy

面试

本文是在学习中的总结,欢迎转载但请注明出处:http://blog.csdn.net/pistolove/article/details/46753275

前言

打算换个工作,近一个月面试了不少的公司,下面将一些面试经验和思考分享给大家。另外校招也快要开始了,为在校的学生提供一些经验供参考,希望都能找到满意的工作。

- HTML5一个小迷宫游戏

357029540

html5

通过《HTML5游戏开发》摘抄了一个小迷宫游戏,感觉还不错,可以画画,写字,把摘抄的代码放上来分享下,喜欢的同学可以拿来玩玩!

<html>

<head>

<title>创建运行迷宫</title>

<script type="text/javascript"

- 10步教你上传githib数据

张亚雄

git

官方的教学还有其他博客里教的都是给懂的人说得,对已我们这样对我大菜鸟只能这么来锻炼,下面先不玩什么深奥的,先暂时用着10步干净利索。等玩顺溜了再用其他的方法。

操作过程(查看本目录下有哪些文件NO.1)ls

(跳转到子目录NO.2)cd+空格+目录

(继续NO.3)ls

(匹配到子目录NO.4)cd+ 目录首写字母+tab键+(首写字母“直到你所用文件根就不再按TAB键了”)

(查看文件

- MongoDB常用操作命令大全

adminjun

mongodb操作命令

成功启动MongoDB后,再打开一个命令行窗口输入mongo,就可以进行数据库的一些操作。输入help可以看到基本操作命令,只是MongoDB没有创建数据库的命令,但有类似的命令 如:如果你想创建一个“myTest”的数据库,先运行use myTest命令,之后就做一些操作(如:db.createCollection('user')),这样就可以创建一个名叫“myTest”的数据库。

一

- bat调用jar包并传入多个参数

aijuans

下面的主程序是通过eclipse写的:

1.在Main函数接收bat文件传递的参数(String[] args)

如: String ip =args[0]; String user=args[1]; &nbs

- Java中对类的主动引用和被动引用

ayaoxinchao

java主动引用对类的引用被动引用类初始化

在Java代码中,有些类看上去初始化了,但其实没有。例如定义一定长度某一类型的数组,看上去数组中所有的元素已经被初始化,实际上一个都没有。对于类的初始化,虚拟机规范严格规定了只有对该类进行主动引用时,才会触发。而除此之外的所有引用方式称之为对类的被动引用,不会触发类的初始化。虚拟机规范严格地规定了有且仅有四种情况是对类的主动引用,即必须立即对类进行初始化。四种情况如下:1.遇到ne

- 导出数据库 提示 outfile disabled

BigBird2012

mysql

在windows控制台下,登陆mysql,备份数据库:

mysql>mysqldump -u root -p test test > D:\test.sql

使用命令 mysqldump 格式如下: mysqldump -u root -p *** DBNAME > E:\\test.sql。

注意:执行该命令的时候不要进入mysql的控制台再使用,这样会报

- Javascript 中的 && 和 ||

bijian1013

JavaScript&&||

准备两个对象用于下面的讨论

var alice = {

name: "alice",

toString: function () {

return this.name;

}

}

var smith = {

name: "smith",

- [Zookeeper学习笔记之四]Zookeeper Client Library会话重建

bit1129

zookeeper

为了说明问题,先来看个简单的示例代码:

package com.tom.zookeeper.book;

import com.tom.Host;

import org.apache.zookeeper.WatchedEvent;

import org.apache.zookeeper.ZooKeeper;

import org.apache.zookeeper.Wat

- 【Scala十一】Scala核心五:case模式匹配

bit1129

scala

package spark.examples.scala.grammars.caseclasses

object CaseClass_Test00 {

def simpleMatch(arg: Any) = arg match {

case v: Int => "This is an Int"

case v: (Int, String)

- 运维的一些面试题

yuxianhua

linux

1、Linux挂载Winodws共享文件夹

mount -t cifs //1.1.1.254/ok /var/tmp/share/ -o username=administrator,password=yourpass

或

mount -t cifs -o username=xxx,password=xxxx //1.1.1.1/a /win

- Java lang包-Boolean

BrokenDreams

boolean

Boolean类是Java中基本类型boolean的包装类。这个类比较简单,直接看源代码吧。

public final class Boolean implements java.io.Serializable,

- 读《研磨设计模式》-代码笔记-命令模式-Command

bylijinnan

java设计模式

声明: 本文只为方便我个人查阅和理解,详细的分析以及源代码请移步 原作者的博客http://chjavach.iteye.com/

import java.util.ArrayList;

import java.util.Collection;

import java.util.List;

/**

* GOF 在《设计模式》一书中阐述命令模式的意图:“将一个请求封装

- matlab下GPU编程笔记

cherishLC

matlab

不多说,直接上代码

gpuDevice % 查看系统中的gpu,,其中的DeviceSupported会给出matlab支持的GPU个数。

g=gpuDevice(1); %会清空 GPU 1中的所有数据,,将GPU1 设为当前GPU

reset(g) %也可以清空GPU中数据。

a=1;

a=gpuArray(a); %将a从CPU移到GPU中

onGP

- SVN安装过程

crabdave

SVN

SVN安装过程

subversion-1.6.12

./configure --prefix=/usr/local/subversion --with-apxs=/usr/local/apache2/bin/apxs --with-apr=/usr/local/apr --with-apr-util=/usr/local/apr --with-openssl=/

- sql 行列转换

daizj

sql行列转换行转列列转行

行转列的思想是通过case when 来实现

列转行的思想是通过union all 来实现

下面具体例子:

假设有张学生成绩表(tb)如下:

Name Subject Result

张三 语文 74

张三 数学 83

张三 物理 93

李四 语文 74

李四 数学 84

李四 物理 94

*/

/*

想变成

姓名 &

- MySQL--主从配置

dcj3sjt126com

mysql

linux下的mysql主从配置: 说明:由于MySQL不同版本之间的(二进制日志)binlog格式可能会不一样,因此最好的搭配组合是Master的MySQL版本和Slave的版本相同或者更低, Master的版本肯定不能高于Slave版本。(版本向下兼容)

mysql1 : 192.168.100.1 //master mysq

- 关于yii 数据库添加新字段之后model类的修改

dcj3sjt126com

Model

rules:

array('新字段','safe','on'=>'search')

1、array('新字段', 'safe')//这个如果是要用户输入的话,要加一下,

2、array('新字段', 'numerical'),//如果是数字的话

3、array('新字段', 'length', 'max'=>100),//如果是文本

1、2、3适当的最少要加一条,新字段才会被

- sublime text3 中文乱码解决

dyy_gusi

Sublime Text

sublime text3中文乱码解决

原因:缺少转换为UTF-8的插件

目的:安装ConvertToUTF8插件包

第一步:安装能自动安装插件的插件,百度“Codecs33”,然后按照步骤可以得到以下一段代码:

import urllib.request,os,hashlib; h = 'eb2297e1a458f27d836c04bb0cbaf282' + 'd0e7a30980927

- 概念了解:CGI,FastCGI,PHP-CGI与PHP-FPM

geeksun

PHP

CGI

CGI全称是“公共网关接口”(Common Gateway Interface),HTTP服务器与你的或其它机器上的程序进行“交谈”的一种工具,其程序须运行在网络服务器上。

CGI可以用任何一种语言编写,只要这种语言具有标准输入、输出和环境变量。如php,perl,tcl等。 FastCGI

FastCGI像是一个常驻(long-live)型的CGI,它可以一直执行着,只要激活后,不

- Git push 报错 "error: failed to push some refs to " 解决

hongtoushizi

git

Git push 报错 "error: failed to push some refs to " .

此问题出现的原因是:由于远程仓库中代码版本与本地不一致冲突导致的。

由于我在第一次git pull --rebase 代码后,准备push的时候,有别人往线上又提交了代码。所以出现此问题。

解决方案:

1: git pull

2:

- 第四章 Lua模块开发

jinnianshilongnian

nginxlua

在实际开发中,不可能把所有代码写到一个大而全的lua文件中,需要进行分模块开发;而且模块化是高性能Lua应用的关键。使用require第一次导入模块后,所有Nginx 进程全局共享模块的数据和代码,每个Worker进程需要时会得到此模块的一个副本(Copy-On-Write),即模块可以认为是每Worker进程共享而不是每Nginx Server共享;另外注意之前我们使用init_by_lua中初

- java.lang.reflect.Proxy

liyonghui160com

1.简介

Proxy 提供用于创建动态代理类和实例的静态方法

(1)动态代理类的属性

代理类是公共的、最终的,而不是抽象的

未指定代理类的非限定名称。但是,以字符串 "$Proxy" 开头的类名空间应该为代理类保留

代理类扩展 java.lang.reflect.Proxy

代理类会按同一顺序准确地实现其创建时指定的接口

- Java中getResourceAsStream的用法

pda158

java

1.Java中的getResourceAsStream有以下几种: 1. Class.getResourceAsStream(String path) : path 不以’/'开头时默认是从此类所在的包下取资源,以’/'开头则是从ClassPath根下获取。其只是通过path构造一个绝对路径,最终还是由ClassLoader获取资源。 2. Class.getClassLoader.get

- spring 包官方下载地址(非maven)

sinnk

spring

SPRING官方网站改版后,建议都是通过 Maven和Gradle下载,对不使用Maven和Gradle开发项目的,下载就非常麻烦,下给出Spring Framework jar官方直接下载路径:

http://repo.springsource.org/libs-release-local/org/springframework/spring/

s

- Oracle学习笔记(7) 开发PLSQL子程序和包

vipbooks

oraclesql编程

哈哈,清明节放假回去了一下,真是太好了,回家的感觉真好啊!现在又开始出差之旅了,又好久没有来了,今天继续Oracle的学习!

这是第七章的学习笔记,学习完第六章的动态SQL之后,开始要学习子程序和包的使用了……,希望大家能多给俺一些支持啊!

编程时使用的工具是PLSQL