flume多节点集群搭建

概览

1.Flume流程简介

2.规划

3.配置

4.启动测试

5.注意

准备

操作系统:CentOS 7

搭建好hadoop集群

Flume版本:1.8.0

jdk版本:1.8.0_141

工具:Xshell 5,Xftp 5,VMware Workstation Pro

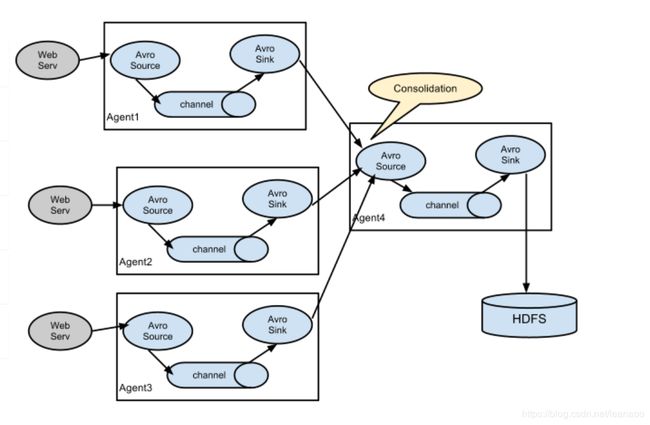

1.Flume流程简介

Flume NG是一个分布式、可靠、可用的系统,它能够将不同数据源的海量日志数据进行高效收集、聚合,最后存储到一个中心化数据存储系统中,方便进行数据分析。事实上flume也可以收集其他信息,不仅限于日志。由原来的Flume OG到现在的Flume NG,进行了架构重构,并且现在NG版本完全不兼容原来的OG版本。相比较而言,flume NG更简单更易于管理操作。

Flume OG:Flume original generation 即Flume 0.9.x版本

Flume NG:Flume next generation 即Flume 1.x版本。

Flume NG用户参考手册:http://flume.apache.org/FlumeUserGuide.html#

简单比较一下两者的区别:

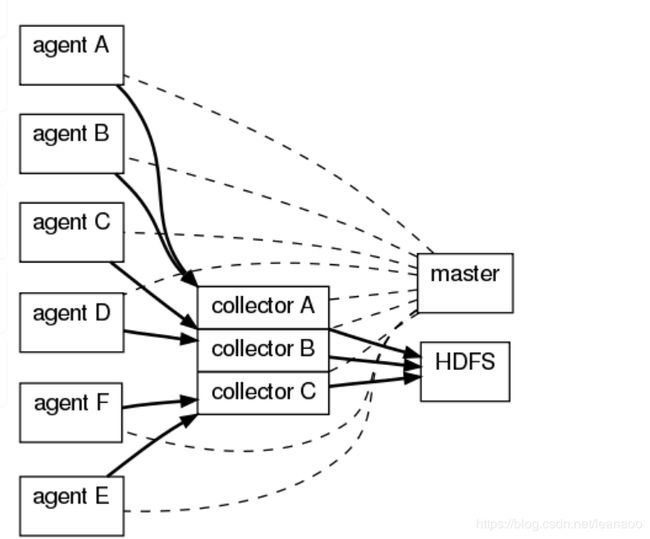

OG有三个组件agent、collector、master,agent主要负责收集各个日志服务器上的日志,将日志聚合到collector,可设置多个collector,master主要负责管理agent和collector,最后由collector把收集的日志写的HDFS中,当然也可以写到本地、给storm、给Hbase。

NG最大的改动就是不再有分工角色设置,所有的都是agent,可以彼此之间相连,多个agent连到一个agent,此agent也就相当于collector了,NG也支持负载均衡.

2.规划

三台主机的主机名分别为master,slave1,slave2(防火墙已关闭)

由slave1和slave2收集日志信息,传给master,再由master上传到hdfs上

3.配置

3.1上传解压

在slave1上的usr文件夹下新建个flume文件夹,用作安装路径

[root@slave1 usr]# mkdir flume

[root@slave1 usr]# ls

bin etc flume games hadoop hbase include java lib lib64 libexec local sbin share sqoop src tmp zookeeper

[root@slave1 usr]# cd flume/

利用Xftp工具将flume压缩包上传到usr/flume文件夹下,解压

[root@slave1 flume]# ls

apache-flume-1.8.0-bin.tar.gz

[root@slave1 flume]# tar -zxf apache-flume-1.8.0-bin.tar.gz

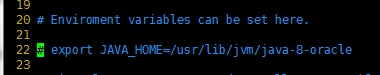

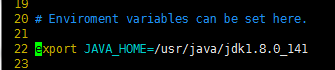

3.2 .配置flume-env.sh文件

# 进入到conf文件夹下

[root@slave1 flume]# cd apache-flume-1.8.0-bin/conf/

[root@slave1 conf]# ls

flume-conf.properties.template flume-env.ps1.template flume-env.sh.template log4j.properties

# 拷贝出来一个flume-env.sh文件

[root@slave1 conf]# cp flume-env.sh.template flume-env.sh

[root@slave1 conf]# ls

flume-conf.properties.template flume-env.ps1.template flume-env.sh flume-env.sh.template log4j.properties

# 修改flume-env.sh文件

[root@slave1 conf]# vim flume-env.sh

将java的安装路径修改为自己的

我的是/usr/java/jdk1.8.0_141

3.3 配置slave.conf文件

在conf下创建一个新的slave.conf文件

#创建

[root@slave1 conf]# touch slave.conf

#修改

[root@slave1 conf]# vim slave.conf

写入配置内容

# 主要作用是监听目录中的新增数据,采集到数据之后,输出到avro (输出到agent)

# 注意:Flume agent的运行,主要就是配置source channel sink

# 下面的a1就是agent的代号,source叫r1 channel叫c1 sink叫k1

a1.sources = r1

a1.sinks = k1

a1.channels = c1

#具体定义source

a1.sources.r1.type = spooldir

#先创建此目录,保证里面空的

a1.sources.r1.spoolDir = /logs

#对于sink的配置描述 使用avro日志做数据的消费

a1.sinks.k1.type = avro

# hostname是最终传给的主机名称或者ip地址

a1.sinks.k1.hostname = master

a1.sinks.k1.port = 44444

#对于channel的配置描述 使用文件做数据的临时缓存 这种的安全性要高

a1.channels.c1.type = file

a1.channels.c1.checkpointDir = /home/uplooking/data/flume/checkpoint

a1.channels.c1.dataDirs = /home/uplooking/data/flume/data

#通过channel c1将source r1和sink k1关联起来

a1.sources.r1.channels = c1

a1.sinks.k1.channel = c1

保存退出

3.4 将flume发送到其他主机

[root@slave1 conf]# scp -r /usr/flume/ root@slave2:/usr/

[root@slave1 conf]# scp -r /usr/flume/ root@master:/usr/

3.5 修改master中flume的配置

在master的flume的conf文件夹下创建一个master.conf文件

[root@master conf]# vim master.conf

写入配置信息

# 获取slave1,2上的数据,聚合起来,传到hdfs上面

# 注意:Flume agent的运行,主要就是配置source channel sink

# 下面的a1就是agent的代号,source叫r1 channel叫c1 sink叫k1

a1.sources = r1

a1.sinks = k1

a1.channels = c1

#对于source的配置描述 监听avro

a1.sources.r1.type = avro

# hostname是最终传给的主机名称或者ip地址

a1.sources.r1.bind = master

a1.sources.r1.port = 44444

#定义拦截器,为消息添加时间戳

a1.sources.r1.interceptors = i1

a1.sources.r1.interceptors.i1.type = org.apache.flume.interceptor.TimestampInterceptor$Builder

#对于sink的配置描述 传递到hdfs上面

a1.sinks.k1.type = hdfs

#集群的nameservers名字

#单节点的直接写:hdfs://主机名(ip):9000/xxx

#ns是hadoop集群名称

a1.sinks.k1.hdfs.path = hdfs://ns/flume/%Y%m%d

a1.sinks.k1.hdfs.filePrefix = events-

a1.sinks.k1.hdfs.fileType = DataStream

#不按照条数生成文件

a1.sinks.k1.hdfs.rollCount = 0

#HDFS上的文件达到128M时生成一个文件

a1.sinks.k1.hdfs.rollSize = 134217728

#HDFS上的文件达到60秒生成一个文件

a1.sinks.k1.hdfs.rollInterval = 60

#对于channel的配置描述 使用内存缓冲区域做数据的临时缓存

a1.channels.c1.type = memory

a1.channels.c1.capacity = 1000

a1.channels.c1.transactionCapacity = 100

#通过channel c1将source r1和sink k1关联起来

a1.sources.r1.channels = c1

a1.sinks.k1.channel = c1

保存退出

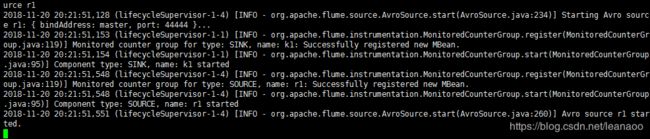

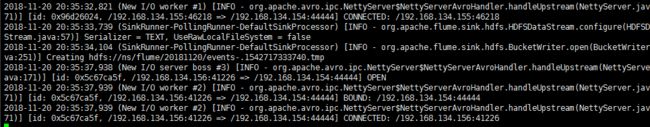

4.启动测试

确认防火墙关闭

首先启动Zookeeper和hadoop集群,参考hadoop集群搭建中的启动

然后先启动master上的flume(如果先启动slave上的会导致拒绝连接)

在apache-flume-1.8.0-bin目录下启动(因为没有配置环境变量)

[root@master apache-flume-1.8.0-bin]# bin/flume-ng agent -n a1 -c conf -f conf/master.conf -Dflume.root.logger=INFO,console

如此便是启动成功

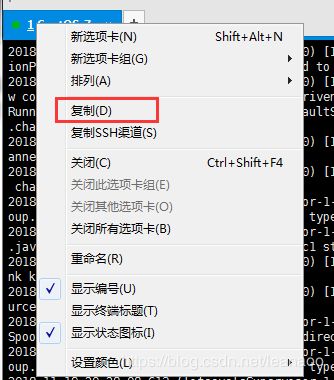

如果想后台启动(这样可以不用另开窗口操作)

# 命令后加&

[root@master apache-flume-1.8.0-bin]# bin/flume-ng agent -n a1 -c conf -f conf/master.conf -Dflume.root.logger=INFO,console &

再启动slave1,2上的flume

首先在slave1,2的根目录创建logs目录

[root@slave1 apache-flume-1.8.0-bin]# cd /

[root@slave1 /]# mkdir logs

不然会报错

[ERROR - org.apache.flume.lifecycle.LifecycleSupervisor$MonitorRunnable.run(LifecycleSupervisor.java:251)] Unable to start EventDrivenSourceRunner: { source:Spool Directory source r1: { spoolDir: /logs } } - Exception follows.

java.lang.IllegalStateException: Directory does not exist: /logs

at com.google.common.base.Preconditions.checkState(Preconditions.java:145)

at org.apache.flume.client.avro.ReliableSpoolingFileEventReader.(ReliableSpoolingFileEventReader.java:159)

at org.apache.flume.client.avro.ReliableSpoolingFileEventReader.(ReliableSpoolingFileEventReader.java:85)

at org.apache.flume.client.avro.ReliableSpoolingFileEventReader$Builder.build(ReliableSpoolingFileEventReader.java:777)

at org.apache.flume.source.SpoolDirectorySource.start(SpoolDirectorySource.java:107)

at org.apache.flume.source.EventDrivenSourceRunner.start(EventDrivenSourceRunner.java:44)

at org.apache.flume.lifecycle.LifecycleSupervisor$MonitorRunnable.run(LifecycleSupervisor.java:249)

at java.util.concurrent.Executors$RunnableAdapter.call(Executors.java:511)

at java.util.concurrent.FutureTask.runAndReset(FutureTask.java:308)

at java.util.concurrent.ScheduledThreadPoolExecutor$ScheduledFutureTask.access$301(ScheduledThreadPoolExecutor.java:180)

at java.util.concurrent.ScheduledThreadPoolExecutor$ScheduledFutureTask.run(ScheduledThreadPoolExecutor.java:294)

at java.util.concurrent.ThreadPoolExecutor.runWorker(ThreadPoolExecutor.java:1149)

at java.util.concurrent.ThreadPoolExecutor$Worker.run(ThreadPoolExecutor.java:624)

at java.lang.Thread.run(Thread.java:748)

#slave1

[root@slave1 /]# cd /usr/flume/apache-flume-1.8.0-bin

[root@slave1 apache-flume-1.8.0-bin]# bin/flume-ng agent -n a1 -c conf -f conf/slave.conf -Dflume.root.logger=INFO,console

#slave2

[root@slave2 /]# cd /usr/flume/apache-flume-1.8.0-bin

[root@slave2 apache-flume-1.8.0-bin]# bin/flume-ng agent -n a1 -c conf -f conf/slave.conf -Dflume.root.logger=INFO,console

测试

在slave1的usr/tmp文件夹下新建个test文件

[root@slave1 tmp]# vim test

随便写入一些内容

helloworld

test

保存退出

将其复制到logs文件夹下

[root@slave1 tmp]# cp test /logs/

查看master

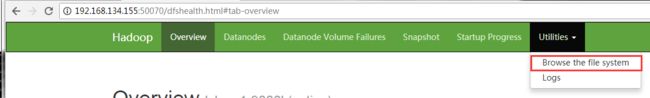

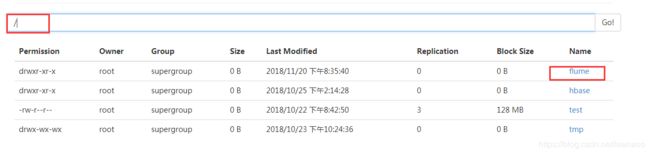

登录http://(hadoop中active状态的namenode节点IP):50070/explorer.html#

如此便是flume多节点集群搭建完成

5.注意

登录查看需要是active的节点地址,具体参考hadoop集群搭建中的测试

在启动slave上的flume前要先建立logs文件夹,也就是flume安装路径/conf下的slave.conf文件中的

![]()