大数据学习第二天

2. 部署spark 和 hadoop

Hadoop2.9.2+Spark2.4.0完全分布式集群搭建过程

主要参考了这一篇https://blog.csdn.net/guoyu931206/article/details/84795385?tdsourcetag=s_pcqq_aiomsg

1.选取三台服务器(CentOS系统64位)

192.168.3.21 Master

192.168.3.21 Slave1

192.168.3.224 Slave2

192.168.3.226 Slave3

之后的操作如果是用普通用户操作的话也必须知道root用户的密码,因为有些操作是得用root用户操作。如果是用root用户操作的话就不存在以上问题。

我是用root用户操作的。

2.修改hosts文件

修改三台服务器的hosts文件。

vi /etc/hosts

在原文件的基础最后面加上:

192.168.3.21 Master

192.168.3.21 Slave1

192.168.3.224 Slave2

192.168.3.226 Slave3 修改完成后,默认已经保存。可以执行如下命令确认。

ping Master3.ssh无密码验证配置

3.1 安装和启动ssh协议

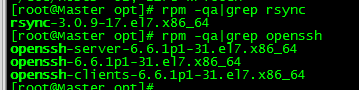

我们需要两个服务:ssh和rsync。

可以通过下面命令查看是否已经安装:

rpm -qa|grep openssh

rpm -qa|grep rsyncyum install ssh (安装ssh协议)

yum install rsync (rsync是一个远程数据同步工具,可通过LAN/WAN快速同步多台主机间的文件)

service sshd restart (启动服务)

3.2 配置Master无密码登录所有Salve

配置Master节点,以下是在Master节点的配置操作。

1)在Master节点上生成密码对,在Master节点上执行以下命令:

ssh-keygen -t rsa -P ''生成的密钥对:id_rsa和id_rsa.pub,默认存储在"/root/.ssh"目录下。

解释:

ssh-keygen -t rsa -P ''

-P表示密码,-P '' 就表示空密码,也可以不用-P参数,这样就要三次回车,用-P就一次回车。

该命令将在/root/.ssh目录下面产生一对密钥id_rsa和id_rsa.pub。一般采用的ssh的rsa密钥:

id_rsa 私钥

id_rsa.pub 公钥

下述命令产生不同类型的密钥

ssh-keygen -t dsa

ssh-keygen -t rsa

ssh-keygen -t rsa1

2)接着在Master节点上做如下配置,把id_rsa.pub追加到授权的key里面去。

cat ~/.ssh/id_rsa.pub >> ~/.ssh/authorized_keys 3)修改ssh配置文件"/etc/ssh/sshd_config"的下列内容,将以下内容的注释去掉:(使用/RAS查找)

RSAAuthentication yes # 启用 RSA 认证

PubkeyAuthentication yes # 启用公钥私钥配对认证方式

AuthorizedKeysFile .ssh/authorized_keys # 公钥文件路径(和上面生成的文件同)

在服务器上更改权限

chmod 700 ~/.ssh

chmod 600 ~/.ssh/authorized_keys 4)重启ssh服务,才能使刚才设置有效。

service sshd restart

5)验证无密码登录本机是否成功。

ssh localhost

6)接下来的就是把公钥复制到所有的Slave机器上。使用下面的命令进行复制公钥:(slave1为本机的不需要)

scp ~/.ssh/id_rsa.pub root@Slave1:/root/

scp ~/.ssh/id_rsa.pub root@Slave2:/root/

scp ~/.ssh/id_rsa.pub root@Slave3:/root/

接着配置Slave节点,以下是在Slave1节点的配置操作。

1)在"/root/“下创建”.ssh"文件夹,如果已经存在就不需要创建了。

mkdir /root/.ssh

2)将Master的公钥追加到Slave1的授权文件"authorized_keys"中去。

cat /root/id_rsa.pub >> /root/.ssh/authorized_keys

3)修改" vim /etc/ssh/sshd_config",具体步骤参考前面Master设置的第3步和第4步。

4)用Master使用ssh无密码登录Slave1

ssh Slave1

5)把"/root/“目录下的"id_rsa.pub"文件删除掉。

rm –f /root/id_rsa.pub

重复上面的5个步骤把Slave2服务器进行相同的配置。

3.3 配置所有Slave无密码登录Master

以下是在Slave1节点的配置操作。

1)创建"Slave1"自己的公钥和私钥,并把自己的公钥追加到"authorized_keys"文件中,执行下面命令:

ssh-keygen -t rsa -P ''

cat /root/.ssh/id_rsa.pub >> /root/.ssh/authorized_keys

2)将Slave1节点的公钥"id_rsa.pub"复制到Master节点的”/root/"目录下。

scp /root/.ssh/id_rsa.pub root@Master:/root/

以下是在Master节点的配置操作。

1)将Slave1的公钥追加到Master的授权文件"authorized_keys"中去。

cat ~/id_rsa.pub >> ~/.ssh/authorized_keys

2)删除Slave1复制过来的"id_rsa.pub"文件。

rm –f /root/id_rsa.pub

配置完成后测试从Slave1到Master无密码登录。

ssh Master

按照上面的步骤把Slave2和Master之间建立起无密码登录。这样,Master能无密码验证登录每个Slave,每个Slave也能无密码验证登录到Master。

若已经配好了免密登录,直接从下面开始:

---------------------

4.安装基础环境(JAVA和SCALA环境)

4.1 Java1.8环境搭建

(1)下载 jdk-8u191-linux-x64.tar.gz

官网下载需要的Java版本,例如我需要将服务器内的jdk1.7版本升到1.8

下载完之后上传至服务器:(SCP或者RZ)

上传至默认的路径:/usr/java

(2)安装

tar -zxvf jdk-* -C /usr/local/java

查看java的安装路径:

执行which java

查看java的指向的链接:(修改后的)

如果指定的链接不是你想升级的java版本,那么重新定位。

rm -f /usr/bin/java && ln -s /usr/local/java/jdk1.8.0_191/bin/java /usr/bin/java

(3)配置环境变量

[root@node1 ~]# vim /etc/profile.d/custom.sh

[root@node1 ~]# cat /etc/profile.d/custom.sh

#!/bin/bash

#java path

export JAVA_HOME=/usr/local/java/jdk1.8.0_191

export PATH=$PATH:$JAVA_HOME/bin

export CLASSPATH=.:$CLASSPATH:$JAVA_HOME/lib

(也可以用这两个)

vim ~/.bashrc

vim /etc/profile

(需要把java环境变量的配置放置到/etc/profile文件的最末尾。)

(4)环境变量生效

source /etc/profile.d/custom.sh

source ~/.bashrc

(5)查看JDK版本

[root@node1 ~]# java -version

java version "1.8.0_112"

Java(TM) SE Runtime Environment (build 1.8.0_112-b15)

Java HotSpot(TM) 64-Bit Server VM (build 25.112-b15, mixed mode)

--疑难问题

存在环境差异。上面的操作没有起作用请添加如下操作

/usr/sbin/alternatives --install /usr/bin/java java /usr/local/java/jdk1.8.0_191/bin/java 180191

/usr/sbin/alternatives --install /usr/bin/javac javac /usr/local/java/jdk1.8.0_191/bin/javac 180191

上面两行命令的中最后面的数字表示优先级,建议根据版本号修改,如我的JDK版本为1.7.0_79,则为17079

查看可用的版本信息

/usr/sbin/alternatives --display java

更改版本信息

/usr/sbin/alternatives --config java

/usr/sbin/alternatives --config javac

---------------------

通过文件设置 Linux 环境变量

首先是设置全局环境变量,对所有用户都会生效:

etc/profile: 此文件为系统的每个用户设置环境信息。当用户登录时,该文件被执行一次,并从 /etc/profile.d 目录的配置文件中搜集shell 的设置。一般用于设置所有用户使用的全局变量。

/etc/bashrc: 当 bash shell 被打开时,该文件被读取。也就是说,每次新打开一个终端 shell,该文件就会被读取。

接着是与上述两个文件对应,但只对单个用户生效:

~/.bash_profile 或 ~/.profile: 只对单个用户生效,当用户登录时该文件仅执行一次。用户可使用该文件添加自己使用的 shell 变量信息。另外在不同的LINUX操作系统下,这个文件可能是不同的,可能是 ~/.bash_profile, ~/.bash_login 或 ~/.profile 其中的一种或几种,如果存在几种的话,那么执行的顺序便是:~/.bash_profile、 ~/.bash_login、 ~/.profile。比如 Ubuntu 系统一般是 ~/.profile 文件。

~/.bashrc: 只对单个用户生效,当登录以及每次打开新的 shell 时,该文件被读取。

此外,修改 /etc/environment 这个文件也能实现环境变量的设置。/etc/environment 设置的也是全局变量,从文件本身的作用上来说, /etc/environment 设置的是整个系统的环境,而/etc/profile是设置所有用户的环境。有几点需注意:

系统先读取 etc/profile 再读取 /etc/environment(还是反过来?)

/etc/environment 中不能包含命令,即直接通过 VAR="..." 的方式设置,不使用 export 。

使用 source /etc/environment 可以使变量设置在当前窗口立即生效,需注销/重启之后,才能对每个新终端窗口都生效。

4.2 Scala2.12.8 环境搭建

tar -zxvf scala-2.12.8.tgz

mv scala-2.12.8 /usr/share

vim /etc/profile.d/custom.sh

export SCALA_HOME=/usr/share/scala-2.12.8

export PATH=$SCALA_HOME/bin:$PATH

source /etc/profile.d/custom.sh

5.Hadoop2.9.2完全分布式搭建

以下是在Master节点操作:

1)下载二进制包hadoop-2.9.2.tar.gz

2)解压并移动到相应目录,我习惯将软件放到/opt目录下,命令如下:

tar -zxvf hadoop-2.9.2.tar.gz

mv hadoop-2.9.2 /opt

3)修改相应的配置文件。

修改vim /etc/profile.d/custom.sh,增加如下内容:

export HADOOP_HOME=/opt/hadoop-2.9.2/

export PATH=$PATH:$HADOOP_HOME/bin

export PATH=$PATH:$HADOOP_HOME/sbin

export HADOOP_MAPRED_HOME=$HADOOP_HOME

export HADOOP_COMMON_HOME=$HADOOP_HOME

export HADOOP_HDFS_HOME=$HADOOP_HOME

export YARN_HOME=$HADOOP_HOME

export HADOOP_ROOT_LOGGER=INFO,console

export HADOOP_COMMON_LIB_NATIVE_DIR=$HADOOP_HOME/lib/native

export HADOOP_OPTS="-Djava.library.path=$HADOOP_HOME/lib"

修改完成后执行:

source /etc/profile.d/custom.sh

修改$HADOOP_HOME/etc/hadoop/hadoop-env.sh,修改JAVA_HOME 如下:(必须修改)

export JAVA_HOME=/usr/local/java/jdk1.8.0_191

修改$HADOOP_HOME/etc/hadoop/slaves,将原来的localhost删除,改成如下内容:

Slave1

Slave2修改$HADOOP_HOME/etc/hadoop/core-site.xml

fs.defaultFS

hdfs://Master:9000

io.file.buffer.size

131072

hadoop.tmp.dir

/opt/hadoop-2.9.2/tmp

修改$HADOOP_HOME/etc/hadoop/hdfs-site.xml

dfs.namenode.secondary.http-address

Master:50090

dfs.replication

2

dfs.namenode.name.dir

file:/opt/hadoop-2.9.2/hdfs/name

dfs.datanode.data.dir

file:/opt/hadoop-2.9.2/hdfs/data

复制template,生成xml,命令如下:

cp mapred-site.xml.template mapred-site.xml

修改$HADOOP_HOME/etc/hadoop/mapred-site.xml

mapreduce.framework.name

yarn

mapreduce.jobhistory.address

Master:10020

mapreduce.jobhistory.address

Master:19888

修改$HADOOP_HOME/etc/hadoop/yarn-site.xml

yarn.nodemanager.aux-services

mapreduce_shuffle

yarn.resourcemanager.address

Master:8032

yarn.resourcemanager.scheduler.address

Master:8030

yarn.resourcemanager.resource-tracker.address

Master:8031

yarn.resourcemanager.admin.address

Master:8033

yarn.resourcemanager.webapp.address

Master:8088

4)复制Master节点的hadoop文件夹到Slave1和Slave2上。

scp -r /opt/hadoop-2.9.2 root@Slave1:/opt

scp -r /opt/hadoop-2.9.2 root@Slave2:/opt

5)在Slave1和Slave2上分别修改/etc/profile.d/custom.sh,过程同Master一样。

6)在Master节点启动集群,启动之前格式化一下namenode:

hadoop namenode -format

启动:

/opt/hadoop-2.9.2/sbin/start-all.sh

至此hadoop的完全分布式环境搭建完毕。

7)查看集群是否启动成功:

jps

Master显示:

SecondaryNameNode

ResourceManager

NameNode

Slave显示:

NodeManager

DataNode

---------------------

6.Spark2.4.0完全分布式环境搭建(standalone mode)

以下操作都在Master节点进行。

1)下载二进制包spark-2.4.0-bin-hadoop2.7.tgz

2)解压并移动到相应目录,命令如下:

tar -zxvf spark-2.4.0-bin-hadoop2.7.tgz

mv spark-2.4.0-bin-hadoop2.7 /opt

3)修改相应的配置文件。

修改/etc/profie,增加如下内容:

export SPARK_HOME=/opt/spark-2.4.0-bin-hadoop2.7/

export PATH=$PATH:$SPARK_HOME/bin

export CLASSPATH=.:$CLASSPATH:$JAVA_HOME/lib:$JAVA_HOME/jre/lib

进入/opt/spark-2.4.0-bin-hadoop2.7/conf

复制 spark-env.sh.template 成 spark-env.sh

cp spark-env.sh.template spark-env.sh

修改$SPARK_HOME/conf/spark-env.sh,添加如下内容:

export JAVA_HOME=/usr/local/java/jdk1.8.0_191

export SCALA_HOME=/usr/share/scala-2.12.8/

export HADOOP_HOME=/opt/hadoop-2.9.2

export HADOOP_CONF_DIR=/opt/hadoop-2.9.2/etc/hadoop

export YARN_CONF_DIR=/opt/hadoop-2.9.2/etc/hadoop

export SPARK_MASTER_IP=10.33.79.6

export SPARK_MASTER_HOST=10.33.79.6

export SPARK_LOCAL_IP=10.33.79.6

export SPARK_WORKER_MEMORY=1g

export SPARK_WORKER_CORES=2

export SPARK_HOME=/opt/spark-2.4.0-bin-hadoop2.7

export SPARK_DIST_CLASSPATH=$(/opt/hadoop-2.9.2/bin/hadoop classpath)复制slaves.template成slaves

cp slaves.template slaves

修改$SPARK_HOME/conf/slaves,将原来的localhost删除,如下内容:

Master

Slave1

Slave24)将配置好的spark文件复制到Slave1和Slave2节点。

scp /opt/spark-2.4.0-bin-hadoop2.7 root@Slave1:/opt

scp /opt/spark-2.4.0-bin-hadoop2.7 root@Slave2:/opt

5)修改Slave1和Slave2配置。

在Slave1和Slave2上分别修改 /etc/profile.d/custom.sh,增加Spark的配置,过程同Master一样。

在Slave1和Slave2修改$SPARK_HOME/conf/spark-env.sh,将export SPARK_LOCAL_IP=114.55.246.88改成Slave1和Slave2对应节点的IP。

6)在Master节点启动集群。

/opt/spark-2.4.0-bin-hadoop2.7/sbin/start-all.sh

7)查看集群是否启动成功:

jps

Master在Hadoop的基础上新增了:

Master

Slave在Hadoop的基础上新增了:

Worker

-------------------