- 数据分析-24-时间序列预测之基于keras的VMD-LSTM和VMD-CNN-LSTM预测风速

皮皮冰燃

数据分析数据分析

文章目录1普通的LSTM模型1.1数据重采样1.2数据标准化1.3切分窗口1.4划分数据集1.5建立模型1.6预测效果2VMD-LSTM模型2.1VMD分解时间序列2.2对每一个IMF建立LSTM模型2.2.1IMF1—LSTM2.2.2IMF2-LSTM2.2.3统一代码2.3评估效果3CNN-LSTM模型3.1数据预处理3.2建立模型3.3效果预测4VMD-CNN-LSTM模型4.1VMD分解

- 【NLP5-RNN模型、LSTM模型和GRU模型】

一蓑烟雨紫洛

nlprnnlstmgrunlp

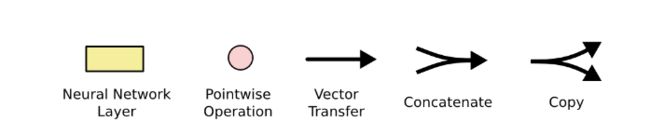

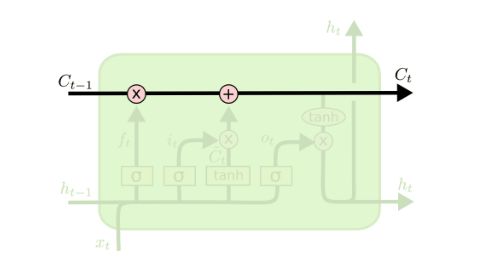

RNN模型、LSTM模型和GRU模型1、什么是RNN模型RNN(RecurrentNeuralNetwork)中文称为循环神经网络,它一般以序列数据为输入,通过网络内部的结构设计有效捕捉序列之间的关系特征,一般也是以序列形式进行输出RNN的循环机制使模型隐层上一时间步产生的结果,能够作为当下时间步输入的一部分(当下时间步的输入除了正常的输入外还包括上一步的隐层输出)对当下时间步的输出产生影响2、R

- 探索深度学习的奥秘:从理论到实践的奇幻之旅

小周不想卷

深度学习

目录引言:穿越智能的迷雾一、深度学习的奇幻起源:从感知机到神经网络1.1感知机的启蒙1.2神经网络的诞生与演进1.3深度学习的崛起二、深度学习的核心魔法:神经网络架构2.1前馈神经网络(FeedforwardNeuralNetwork,FNN)2.2卷积神经网络(CNN)2.3循环神经网络(RNN)及其变体(LSTM,GRU)2.4生成对抗网络(GAN)三、深度学习的魔法秘籍:算法与训练3.1损失

- 一维数组 list 呢 ,怎么转换成 (批次 句子长度 特征值 )三维向量 python pytorch lstm 编程 人工智能

zhangfeng1133

pythonpytorch人工智能数据挖掘

一、介绍对于一维数组,如果你想将其转换成适合深度学习模型(如LSTM)输入的格式,你需要考虑将其扩展为三维张量。这通常涉及到批次大小(batchsize)、序列长度(sequencelength)和特征数量(numberoffeatures)的维度。以下是如何将一维数组转换为这种格式的步骤:###1.确定维度-**批次大小(BatchSize)**:这是你一次处理的样本数量。-**序列长度(Seq

- 使用LSTM(长短期记忆网络)模型预测股票价格的实例分析

eeee~~

深度学习lstm人工智能rnn金融python神经网络

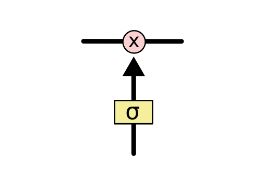

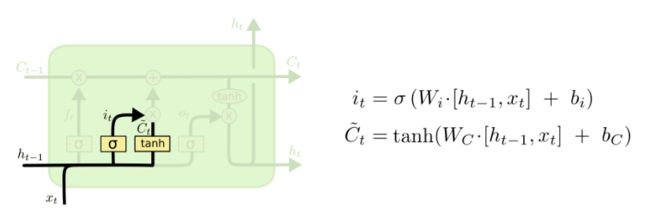

一:LSTM与RNN的区别LSTM(LongShort-TermMemory)是一种特殊的循环神经网络(RNN)架构。LSTM是为了解决传统RNN在处理长序列数据时遇到的梯度消失或梯度爆炸问题而设计的。在传统的RNN中,信息通过隐藏状态在时间步之间传递,但由于权重的重复应用,随着时间的推移,梯度可能会迅速减小或增大,导致网络难以学习长期依赖关系。LSTM通过引入了一种称为“门”(gates)的机制

- 《自然语言处理 Transformer 模型详解》

黑色叉腰丶大魔王

自然语言处理transformer人工智能

一、引言在自然语言处理领域,Transformer模型的出现是一个重大的突破。它摒弃了传统的循环神经网络(RNN)和卷积神经网络(CNN)架构,完全基于注意力机制,在机器翻译、文本生成、问答系统等众多任务中取得了卓越的性能。本文将深入讲解Transformer模型的原理、结构和应用。二、Transformer模型的背景在Transformer出现之前,RNN及其变体(如LSTM和GRU)是自然语言

- 深度学习特征提取魔改版太强了!发文香饽饽!

深度之眼

深度学习干货人工智能干货人工智能深度学习机器学习论文特征提取

要说CV领域经久不衰的研究热点,特征提取可以占一席,毕竟SLAM、三维重建等重要应用的底层都离不开它。再加上近几年深度学习兴起,用深度学习做特征提取逐渐成了主流,比传统算法无论是性能、准确性还是效率都更胜一筹。目前比较常见的深度学习特征提取方法有基于transformer、基于CNN、基于LSTM以及基于GAN,都发展的比较成熟。但为了追求更快速、准确、鲁棒的特征点提取,研究者们开始致力于改进深度

- 预训练语言模型的前世今生 - 从Word Embedding到BERT

脚步的影子

语言模型embeddingbert

目录一、预训练1.1图像领域的预训练1.2预训练的思想二、语言模型2.1统计语言模型2.2神经网络语言模型三、词向量3.1独热(Onehot)编码3.2WordEmbedding四、Word2Vec模型五、自然语言处理的预训练模型六、RNN和LSTM6.1RNN6.2RNN的梯度消失问题6.3LSTM6.4LSTM解决RNN的梯度消失问题七、ELMo模型7.1ELMo的预训练7.2ELMo的Fea

- 第R3周:天气预测

Jessica2017lj

python

本文为[365天深度学习训练营]中的学习记录博客参考文章:第R3周:LSTM-火灾温度预测(训练营内部可读)作者:[K同学啊]任务说明:该数据集提供了来自澳大利亚许多地点的大约10年的每日天气观测数据。你需要做的是根据这些数据对RainTomorrow进行一个预测,这次任务任务与以往的不同,我增加了探索式数据分析(EDA),希望这部分内容可以帮助到大家。我的环境:●语言环境:Python3.8●编

- Python知识点:如何使用Python进行时间序列预测

杰哥在此

Python系列python开发语言编程面试

使用Python进行时间序列预测是一个非常常见的任务,可以应用于各种领域,如金融市场预测、销售量预测、天气预报等。时间序列预测的方法有很多,包括统计方法(如ARIMA模型)、机器学习方法(如支持向量机、决策树)、以及深度学习方法(如LSTM网络)。下面是一个简单的时间序列预测流程示例,使用Python和pandas、numpy、以及statsmodels库来实现ARIMA模型的时间序列预测。1.导

- 深度学习基础之循环神经网络

Ctrl+CV九段手

机器学习和深度学习rnn深度学习神经网络人工智能机器学习学习

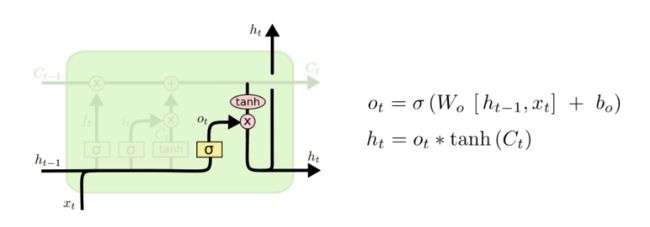

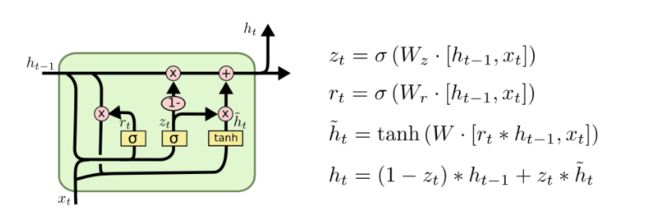

目录基本概念与特点定义与工作原理结构组成应用领域自然语言处理语音识别时间序列分析优缺点优点缺点改进方法总结循环神经网络在自然语言处理中的最新应用和研究进展是什么?长短期记忆网络(LSTM)与门控循环单元(GRU)在解决梯度消失和爆炸问题上的具体差异和优势是什么?LSTM的结构与优势GRU的结构与优势具体差异门的数量:计算复杂度:性能对比:总结双向循环神经网络如何增强模型的上下文捕捉能力,与单向RN

- 02 使用 LSTM 进行时间序列预测

柒 魅。

时间序列预测lstm人工智能rnn

深度学习入门:使用LSTM进行时间序列预测引言深度学习在时间序列预测中展现出了强大的能力,尤其是长短期记忆(LSTM)网络。本文将为深度学习初学者介绍如何使用LSTM网络进行时间序列预测。我们将从基础知识讲起,提供代码示例,并解释每一步的技术细节。希望通过本文,大家能对LSTM有一个初步的了解,并能够在自己的项目中应用。1.什么是LSTM?LSTM(长短期记忆网络)是一种特殊的递归神经网络(RNN

- 计算机毕业设计hadoop+spark知识图谱房源推荐系统 房价预测系统 房源数据分析 房源可视化 房源大数据大屏 大数据毕业设计 机器学习

计算机毕业设计大全

创新点:1.支付宝沙箱支付2.支付邮箱通知(JavaMail)3.短信验证码修改密码4.知识图谱5.四种推荐算法(协同过滤基于用户、物品、SVD混合神经网络、MLP深度学习模型)6.线性回归算法预测房价7.Python爬虫采集链家数据8.AI短信识别9.百度地图API10.lstm情感分析11.spark大屏可视化开发技术:springbootvue.jspythonechartssparkmys

- Python深度学习(使用 LSTM 生成文本)--学习笔记(十八)

呆萌的小透明

深度学习神经网络深度学习

第8章生成式深度学习人工智能模拟人类思维过程的可能性,并不局限于被动性任务(比如目标识别)和大多数反应性任务(比如驾驶汽车),它还包括创造性活动。的确,到目前为止,我们见到的人工智能艺术作品的水平还很低。人工智能还远远比不上人类编剧、画家和作曲家。但是,替代人类始终都不是我们要谈论的主题,人工智能不会替代我们自己的智能,而是会为我们的生活和工作带来更多的智能,即另一种类型的智能。在许多领域,特别是

- LSTM与文本生成

Jiang_Immortals

人工智能lstm人工智能rnn

当使用Python和Keras构建LSTM模型时,可以按照以下步骤进行简单的文本生成:准备数据集:首先,将文本数据集进行预处理,例如分词、去除标点符号、将文本转换为小写等。创建一个词汇表,将每个唯一的单词映射到一个整数值,以便进行向量化。将文本序列划分为输入序列和目标序列。例如,对于句子“IloveAI”,输入序列是“Ilove”,目标序列是“AI”。构建LSTM模型:导入必要的库,如Keras和

- 【没发表过的创新点】基于BiTCN-LSTM的风电功率预测研究(Matlab代码实现)

荔枝科研社

lstmmatlab人工智能

欢迎来到本博客❤️❤️博主优势:博客内容尽量做到思维缜密,逻辑清晰,为了方便读者。⛳️座右铭:行百里者,半于九十。本文目录如下:目录⛳️赠与读者1概述一、研究背景与意义二、BiTCN-LSTM模型概述三、基于BiTCN-LSTM的风电功率预测模型构建四、研究优势与挑战优势:挑战:五、未来展望2运行结果3参考文献4Matlab代码、数据⛳️赠与读者做科研,涉及到一个深在的思想系统,需要科研者逻辑缜

- 自然语言处理--Keras 实现LSTM生成文本

糯米君_

自然语言处理python深度学习nlplstm生成文本

令人兴奋的是,基于上一篇《keras实现LSTM字符级建模》的原理,使用LSTM我们可以根据之前文档出现过的字符来预测下一个字符,并且根据训练数据文本的特定的“风格”或“看法”生成新的文本。这很有趣,但我们将选择一个风格独特的人——威廉·莎士比亚(WilliamShakespeare),现根据他现有的作品来生成乍一看都有点儿像莎士比亚的作品的文本。fromnltk.corpusimportgute

- CNN+LSTM小目标物体追踪检测实现 完整代码数据可直接运行

计算机毕设论文

计算机毕设实战100例cnn人工智能深度学习小目标物体追踪追踪检测

视频讲解:CNN+LSTM小目标物体追踪检测实现_哔哩哔哩_bilibili项目效果:完整代码:importnumpyasnpimporttensorflowastffromtensorflow.keras.layersimportConv2D,MaxPooling2D,Flatten,LSTM,D

- 时间旅行者:LSTM算法的奥秘大揭秘!

风清扬雨

lstm算法人工智能

Hey小伙伴们,今天给大家带来一个超级有趣的主题——LSTM算法的基本结构和公式推导!项目背景你知道吗?在时间序列预测中,传统的神经网络很难处理长距离的依赖关系。但是,有一种神奇的神经网络叫做LSTM(LongShort-TermMemory),它就像是时间旅行者一样,可以记住很久以前的信息!时间旅行听起来很酷吧?那我们就来一起探索一下LSTM的世界吧!原理解析1️⃣什么是LSTM?LSTM是一种

- 【LSTM分类】基于贝叶斯优化卷积神经网络结合长短时记忆BO-CNN-LSTM实现柴油机故障诊断含Matlab源码

matlab科研助手

lstm分类cnn

✅作者简介:热爱科研的Matlab仿真开发者,修心和技术同步精进,代码获取、论文复现及科研仿真合作可私信。个人主页:Matlab科研工作室个人信条:格物致知。更多Matlab完整代码及仿真定制内容点击智能优化算法神经网络预测雷达通信无线传感器电力系统信号处理图像处理路径规划元胞自动机无人机物理应用机器学习内容介绍柴油机作为重要的动力设备,其运行状态的可靠性直接影响着生产效率和安全。及时准确地诊断柴

- 《BERT基础教程:Transformer大模型实战》读书笔记

johnny233

读书笔记人工智能

概念BERT,BidirectionalEncoderRepresentationsfromTransformers,多Transformer的双向编码器表示法。RNN,recurrentneuralnetwork,循环神经网络。LSTM,longshort-termmemory,长短期记忆网络。NLI,Naturallanguageinference,自然语言推理。知识蒸馏(knowledged

- EI级 | Matlab实现TCN-LSTM-MATT、TCN-LSTM、TCN、LSTM多变量时间序列预测对比

天天Matlab代码科研顾问

matlablstm开发语言

✅作者简介:热爱科研的Matlab仿真开发者,修心和技术同步精进,代码获取、论文复现及科研仿真合作可私信。个人主页:Matlab科研工作室个人信条:格物致知。更多Matlab完整代码及仿真定制内容点击智能优化算法神经网络预测雷达通信无线传感器电力系统信号处理图像处理路径规划元胞自动机无人机内容介绍风电作为一种清洁、可再生能源,近年来得到了快速发展。准确预测风电功率输出对于提高风电场运行效率,优化电

- 自己设计一个Transformer模型

郑不凡

transformer自然语言处理机器翻译

Transformer模型在2017年被Google提出,直接基于self-attention结构,不再依赖于RNN、LSTM或者CNN,是一种Seg2Seg模型。近些年提出了许多基于Transformer的模型,有学者甚至将这一类模型称为基础模型。该模型的原始论文为AttentionIsAllYouNeed。0.如何设计Transformer阅读该部分需要有Attention基础Transfor

- 基于CNN-BiLSTM-Adaboost风电功率预测研究(Matlab代码实现)

创新优化代码学习

cnnmatlab人工智能

欢迎来到本博客❤️❤️博主优势:博客内容尽量做到思维缜密,逻辑清晰,为了方便读者。⛳️座右铭:行百里者,半于九十。本文目录如下:目录⛳️赠与读者1概述一、研究背景与意义二、研究方法1.数据准备与预处理2.CNN特征提取3.BiLSTM序列建模4.Adaboost集成学习5.模型训练与评估三、研究优势四、未来展望2运行结果3参考文献4Matlab代码、数据⛳️赠与读者做科研,涉及到一个深在的思想系

- 【ShuQiHere】用类来实现LSTM:让你的模型拥有更强的记忆力

ShuQiHere

代码武士的机器学习秘传lstm人工智能

【ShuQiHere】欢迎回到ShuQiHere!今天我们要来聊一聊LSTM(LongShort-TermMemory),一种非常流行的循环神经网络(RNN)变种。LSTM以其卓越的记忆能力和处理长序列数据的强大性能而闻名。今天,我们将用类的方式来实现LSTM,并将其应用于手写数字识别任务中。1.什么是LSTM?LSTM是一种特殊的RNN,它通过引入“门”的机制,能够更好地捕捉长时间跨度的依赖关系

- Kesci:Tensorflow 实现 LSTM——时间序列预测

萧居士

TensorflowLSTM时间序列预测

LSTMhttps://www.kesci.com/home/project/5a38a9c00e1fc52691fd9c72这篇文章将讲解如何使用lstm进行时间序列方面的预测,重点讲lstm的应用,原理部分可参考以下两篇文章:UnderstandingLSTMNetworksLSTM学习笔记编程环境:python3.7,tensorflow1.14本文所用的数据集来自于kesci平台,由云脑机

- 【LSTM回归预测】遗传算法优化注意力机制的长短时记忆神经网络GA-attention-LSTM数据回归预测【含Matlab源码 3738期】

Matlab领域

matlab

⛄一、遗传算法优化注意力机制的长短时记忆神经网络GA-attention-LSTM数据回归预测风力发电是一种清洁能源,越来越受到人们的关注和重视。然而,由于风力发电的不稳定性和不可控性,风电预测成为了一个至关重要的问题。为了更精准地预测风电发电量,许多研究者开始尝试利用深度学习技术来进行风电预测。在本文中,我们将介绍一种基于遗传优化注意力机制的长短时记忆神经网络(GA-attention-LSTM

- 回归预测|基于鲸鱼优化WOA-Transformer-BiLSTM组合模型的数据回归预测Matlab程序多特征输入单输出

机器不会学习CL

时间序列预测智能优化算法回归transformermatlab

回归预测|基于鲸鱼优化WOA-Transformer-BiLSTM组合模型的数据回归预测Matlab程序多特征输入单输出文章目录前言时序预测|基于鲸鱼优化WOA-Transformer-BiLSTM组合模型的数据时序预测Matlab程序多特征输入单输出一、WOA-Transformer-BiLSTM模型1.鲸鱼优化算法(WOA)2.Transformer3.双向长短期记忆网络(BiLSTM)4.模

- 时序预测|基于变分模态分解-时域卷积-双向长短期记忆-注意力机制多变量时间序列预测VMD-TCN-BiLSTM-Attention

机器不会学习CL

时间序列预测智能优化算法深度学习人工智能机器学习

时序预测|基于变分模态分解-时域卷积-双向长短期记忆-注意力机制多变量时间序列预测VMD-TCN-BiLSTM-Attention文章目录前言时序预测|基于变分模态分解-时域卷积-双向长短期记忆-注意力机制多变量时间序列预测VMD-TCN-BiLSTM-Attention一、VMD-TCN-BiLSTM-Attention模型VMD-TCN-BiLSTM-Attention模型的详细原理和流程1.

- 计算机毕业设计Hadoop+Spark知识图谱体育赛事推荐系统 体育赛事热度预测系统 体育赛事数据分析 体育赛事可视化 体育赛事大数据 机器学习 大数据毕业设计 大数据毕设 机器学习 人工智能

计算机毕业设计大全

开发技术前端:vue.js、element-ui、echarts后端:springboot、mybatis大数据:spark、hadoop数据库:mysql关系型数据库、neo4j图数据库算法:协同过滤推荐算法、MLP深度学习模型、SVD神经网络混合推荐算法、lstm模型、KNN、CNN、Sklearn、K-Means第三方平台:百度AI、阿里云短信、支付宝沙箱支付爬虫:Pythonchrome-

- mondb入手

木zi_鸣

mongodb

windows 启动mongodb 编写bat文件,

mongod --dbpath D:\software\MongoDBDATA

mongod --help 查询各种配置

配置在mongob

打开批处理,即可启动,27017原生端口,shell操作监控端口 扩展28017,web端操作端口

启动配置文件配置,

数据更灵活

- 大型高并发高负载网站的系统架构

bijian1013

高并发负载均衡

扩展Web应用程序

一.概念

简单的来说,如果一个系统可扩展,那么你可以通过扩展来提供系统的性能。这代表着系统能够容纳更高的负载、更大的数据集,并且系统是可维护的。扩展和语言、某项具体的技术都是无关的。扩展可以分为两种:

1.

- DISPLAY变量和xhost(原创)

czmmiao

display

DISPLAY

在Linux/Unix类操作系统上, DISPLAY用来设置将图形显示到何处. 直接登陆图形界面或者登陆命令行界面后使用startx启动图形, DISPLAY环境变量将自动设置为:0:0, 此时可以打开终端, 输出图形程序的名称(比如xclock)来启动程序, 图形将显示在本地窗口上, 在终端上输入printenv查看当前环境变量, 输出结果中有如下内容:DISPLAY=:0.0

- 获取B/S客户端IP

周凡杨

java编程jspWeb浏览器

最近想写个B/S架构的聊天系统,因为以前做过C/S架构的QQ聊天系统,所以对于Socket通信编程只是一个巩固。对于C/S架构的聊天系统,由于存在客户端Java应用,所以直接在代码中获取客户端的IP,应用的方法为:

String ip = InetAddress.getLocalHost().getHostAddress();

然而对于WEB

- 浅谈类和对象

朱辉辉33

编程

类是对一类事物的总称,对象是描述一个物体的特征,类是对象的抽象。简单来说,类是抽象的,不占用内存,对象是具体的,

占用存储空间。

类是由属性和方法构成的,基本格式是public class 类名{

//定义属性

private/public 数据类型 属性名;

//定义方法

publ

- android activity与viewpager+fragment的生命周期问题

肆无忌惮_

viewpager

有一个Activity里面是ViewPager,ViewPager里面放了两个Fragment。

第一次进入这个Activity。开启了服务,并在onResume方法中绑定服务后,对Service进行了一定的初始化,其中调用了Fragment中的一个属性。

super.onResume();

bindService(intent, conn, BIND_AUTO_CREATE);

- base64Encode对图片进行编码

843977358

base64图片encoder

/**

* 对图片进行base64encoder编码

*

* @author mrZhang

* @param path

* @return

*/

public static String encodeImage(String path) {

BASE64Encoder encoder = null;

byte[] b = null;

I

- Request Header简介

aigo

servlet

当一个客户端(通常是浏览器)向Web服务器发送一个请求是,它要发送一个请求的命令行,一般是GET或POST命令,当发送POST命令时,它还必须向服务器发送一个叫“Content-Length”的请求头(Request Header) 用以指明请求数据的长度,除了Content-Length之外,它还可以向服务器发送其它一些Headers,如:

- HttpClient4.3 创建SSL协议的HttpClient对象

alleni123

httpclient爬虫ssl

public class HttpClientUtils

{

public static CloseableHttpClient createSSLClientDefault(CookieStore cookies){

SSLContext sslContext=null;

try

{

sslContext=new SSLContextBuilder().l

- java取反 -右移-左移-无符号右移的探讨

百合不是茶

位运算符 位移

取反:

在二进制中第一位,1表示符数,0表示正数

byte a = -1;

原码:10000001

反码:11111110

补码:11111111

//异或: 00000000

byte b = -2;

原码:10000010

反码:11111101

补码:11111110

//异或: 00000001

- java多线程join的作用与用法

bijian1013

java多线程

对于JAVA的join,JDK 是这样说的:join public final void join (long millis )throws InterruptedException Waits at most millis milliseconds for this thread to die. A timeout of 0 means t

- Java发送http请求(get 与post方法请求)

bijian1013

javaspring

PostRequest.java

package com.bijian.study;

import java.io.BufferedReader;

import java.io.DataOutputStream;

import java.io.IOException;

import java.io.InputStreamReader;

import java.net.HttpURL

- 【Struts2二】struts.xml中package下的action配置项默认值

bit1129

struts.xml

在第一部份,定义了struts.xml文件,如下所示:

<!DOCTYPE struts PUBLIC

"-//Apache Software Foundation//DTD Struts Configuration 2.3//EN"

"http://struts.apache.org/dtds/struts

- 【Kafka十三】Kafka Simple Consumer

bit1129

simple

代码中关于Host和Port是割裂开的,这会导致单机环境下的伪分布式Kafka集群环境下,这个例子没法运行。

实际情况是需要将host和port绑定到一起,

package kafka.examples.lowlevel;

import kafka.api.FetchRequest;

import kafka.api.FetchRequestBuilder;

impo

- nodejs学习api

ronin47

nodejs api

NodeJS基础 什么是NodeJS

JS是脚本语言,脚本语言都需要一个解析器才能运行。对于写在HTML页面里的JS,浏览器充当了解析器的角色。而对于需要独立运行的JS,NodeJS就是一个解析器。

每一种解析器都是一个运行环境,不但允许JS定义各种数据结构,进行各种计算,还允许JS使用运行环境提供的内置对象和方法做一些事情。例如运行在浏览器中的JS的用途是操作DOM,浏览器就提供了docum

- java-64.寻找第N个丑数

bylijinnan

java

public class UglyNumber {

/**

* 64.查找第N个丑数

具体思路可参考 [url] http://zhedahht.blog.163.com/blog/static/2541117420094245366965/[/url]

*

题目:我们把只包含因子

2、3和5的数称作丑数(Ugly Number)。例如6、8都是丑数,但14

- 二维数组(矩阵)对角线输出

bylijinnan

二维数组

/**

二维数组 对角线输出 两个方向

例如对于数组:

{ 1, 2, 3, 4 },

{ 5, 6, 7, 8 },

{ 9, 10, 11, 12 },

{ 13, 14, 15, 16 },

slash方向输出:

1

5 2

9 6 3

13 10 7 4

14 11 8

15 12

16

backslash输出:

4

3

- [JWFD开源工作流设计]工作流跳跃模式开发关键点(今日更新)

comsci

工作流

既然是做开源软件的,我们的宗旨就是给大家分享设计和代码,那么现在我就用很简单扼要的语言来透露这个跳跃模式的设计原理

大家如果用过JWFD的ARC-自动运行控制器,或者看过代码,应该知道在ARC算法模块中有一个函数叫做SAN(),这个函数就是ARC的核心控制器,要实现跳跃模式,在SAN函数中一定要对LN链表数据结构进行操作,首先写一段代码,把

- redis常见使用

cuityang

redis常见使用

redis 通常被认为是一个数据结构服务器,主要是因为其有着丰富的数据结构 strings、map、 list、sets、 sorted sets

引入jar包 jedis-2.1.0.jar (本文下方提供下载)

package redistest;

import redis.clients.jedis.Jedis;

public class Listtest

- 配置多个redis

dalan_123

redis

配置多个redis客户端

<?xml version="1.0" encoding="UTF-8"?><beans xmlns="http://www.springframework.org/schema/beans" xmlns:xsi=&quo

- attrib命令

dcj3sjt126com

attr

attrib指令用于修改文件的属性.文件的常见属性有:只读.存档.隐藏和系统.

只读属性是指文件只可以做读的操作.不能对文件进行写的操作.就是文件的写保护.

存档属性是用来标记文件改动的.即在上一次备份后文件有所改动.一些备份软件在备份的时候会只去备份带有存档属性的文件.

- Yii使用公共函数

dcj3sjt126com

yii

在网站项目中,没必要把公用的函数写成一个工具类,有时候面向过程其实更方便。 在入口文件index.php里添加 require_once('protected/function.php'); 即可对其引用,成为公用的函数集合。 function.php如下:

<?php /** * This is the shortcut to D

- linux 系统资源的查看(free、uname、uptime、netstat)

eksliang

netstatlinux unamelinux uptimelinux free

linux 系统资源的查看

转载请出自出处:http://eksliang.iteye.com/blog/2167081

http://eksliang.iteye.com 一、free查看内存的使用情况

语法如下:

free [-b][-k][-m][-g] [-t]

参数含义

-b:直接输入free时,显示的单位是kb我们可以使用b(bytes),m

- JAVA的位操作符

greemranqq

位运算JAVA位移<<>>>

最近几种进制,加上各种位操作符,发现都比较模糊,不能完全掌握,这里就再熟悉熟悉。

1.按位操作符 :

按位操作符是用来操作基本数据类型中的单个bit,即二进制位,会对两个参数执行布尔代数运算,获得结果。

与(&)运算:

1&1 = 1, 1&0 = 0, 0&0 &

- Web前段学习网站

ihuning

Web

Web前段学习网站

菜鸟学习:http://www.w3cschool.cc/

JQuery中文网:http://www.jquerycn.cn/

内存溢出:http://outofmemory.cn/#csdn.blog

http://www.icoolxue.com/

http://www.jikexue

- 强强联合:FluxBB 作者加盟 Flarum

justjavac

r

原文:FluxBB Joins Forces With Flarum作者:Toby Zerner译文:强强联合:FluxBB 作者加盟 Flarum译者:justjavac

FluxBB 是一个快速、轻量级论坛软件,它的开发者是一名德国的 PHP 天才 Franz Liedke。FluxBB 的下一个版本(2.0)将被完全重写,并已经开发了一段时间。FluxBB 看起来非常有前途的,

- java统计在线人数(session存储信息的)

macroli

javaWeb

这篇日志是我写的第三次了 前两次都发布失败!郁闷极了!

由于在web开发中常常用到这一部分所以在此记录一下,呵呵,就到备忘录了!

我对于登录信息时使用session存储的,所以我这里是通过实现HttpSessionAttributeListener这个接口完成的。

1、实现接口类,在web.xml文件中配置监听类,从而可以使该类完成其工作。

public class Ses

- bootstrp carousel初体验 快速构建图片播放

qiaolevip

每天进步一点点学习永无止境bootstrap纵观千象

img{

border: 1px solid white;

box-shadow: 2px 2px 12px #333;

_width: expression(this.width > 600 ? "600px" : this.width + "px");

_height: expression(this.width &

- SparkSQL读取HBase数据,通过自定义外部数据源

superlxw1234

sparksparksqlsparksql读取hbasesparksql外部数据源

关键字:SparkSQL读取HBase、SparkSQL自定义外部数据源

前面文章介绍了SparSQL通过Hive操作HBase表。

SparkSQL从1.2开始支持自定义外部数据源(External DataSource),这样就可以通过API接口来实现自己的外部数据源。这里基于Spark1.4.0,简单介绍SparkSQL自定义外部数据源,访

- Spring Boot 1.3.0.M1发布

wiselyman

spring boot

Spring Boot 1.3.0.M1于6.12日发布,现在可以从Spring milestone repository下载。这个版本是基于Spring Framework 4.2.0.RC1,并在Spring Boot 1.2之上提供了大量的新特性improvements and new features。主要包含以下:

1.提供一个新的sprin