为了让AI像人一样思考,DeepMind这次又干了什么?

通向AGI(通用人工智能)的道路上,始终有一道巨大的鸿沟横亘在研究者的面前,那就是人工智能对于因果关系的理解。因果关系的推断,首先对于人类本身就是一个极为复杂的问题。无论是必然性推理还是或然性推理,人类总能在复杂的事物关系中建立精妙地因果推论。且无论对错,这种能力都让人类能力超群,成为站在生物链顶端的那颗孤星。

想象一下,假如你带着女儿去参加一个夏令营,在那里你遇到一个成年女人带着一个小女孩。你很可能会断定那个女人是小女孩的母亲。过了几个星期,你又在你住的附近的一家咖啡店里,你再次看到这个小女孩,但这次她是由一个成年男人带着。基于这两段观察到的事实,你基本可以推断,这个男人和女人有一定的关系。但是否是夫妻关系或者别的关系,就会涉及到更多信息,诸如男人和女人的年龄、衣着品味和小孩子的亲密程度等等信息。

在这一场景中,我们可以基于在较大跨度的时间、地点中的发生的事实关系进行相关的因果推论。我们把这种在复杂的事物关系中的这种推论称为“长距离推理”。

AI能否掌握这一能力?对于目前熟知的一些AI技术,通过数据库对他们进行人脸识别很容易;如果再给定他们相关身份的知识图谱,AI也可以认出他们。但如果仅给出以上事实场景(对于AI来说是单独的图像),而不提供任何其他信息,AI能否从图像描述的事实中建立起因果推理么?

这一次,DeepMind的最新研究中为AI进行 “长距离推理”提出了一种解决方案。近日,DeepMind公开发表了一篇为ICLR 2020会议提交的论文《MEMO:一种用于情景记忆灵活组合的深度网络》。论文主要提出了一种可以增强现有深度神经网络架构的推理能力的新架构——MEMO。MEMO具有长距离推理的能力,即能够发现在记忆中的多个事实之间的长距离的关系。

那么MEMO的实际表现如何?MEMO这一新的深度神经网络对于AI发展的意义是什么?这些问题仍然需要我们思考和解答。

为什么长距离推理如此重要?

为了讨论长距离推理的重要性,首先我们需要知道感知、记忆、命名、事实、判断以及推理、行动的内涵和关系。历史学家尤瓦尔·赫拉利在《人类简史》中提到的“人的虚构能力”也就是“人可以想象不存在事物的能力”成为智人战胜其他物种的决定因素。但他仍然把复杂问题的解释简单化了。

只要你认真审视自己的日活生活,我们几乎都在按照上述认知能力在思考和行动。我们通过感官认知外界形成感知,这时只是一些时空中的感性要素;然后由我们大脑区分后对其中特别注意的要素(其他大量信息沦为认识的背景)进行命名,从而形成一个事实;再通过大脑的联接能力,把命名通过逻辑词连接起来形成判断;然后,通过过去经验的总结和对未来的想象,我们形成相应的推理,最后据此形成计划和实施步骤,最后形成行动。当然,这一系列过程都几乎发生在认知的短暂瞬间,以致于很多人忽视认知的复杂性。

我们可以举一个形象的例子。就在写作此文的同时,笔者的二岁半的女儿已经在客厅拿着塑料的喷壶和铲子对着空气做出舀水、喷水的动作,同时还喊出“水、湿了、擦擦”的单词。两岁半的女儿就如同人类的童年时代,她学会观察和区分了身边的物品,然后又学会给不同的事物命名(杯子、鞋、壶),然后又能理解事物之间的关系做出因果推断(壶可以用来盛水、铲子可以用来搬运东西);并且最厉害的是,她还能虚构眼前不存在的事物,就如同孩子在想象用铲子给喷壶舀“水”,又把“水”从喷壶里倒了出来,弄“湿了”地面或者她的鞋子。甚至于她还能“条件反射”地想起大人们曾反复强调“弄湿了东西要擦干净”的训诫,试图去找东西来擦拭根本不存在的“水”。

如果说许多动物能够制作和使用工具,而且使用起来比二岁小孩还熟练,但他们仍然无法完成人类小孩对于并未实际发生事情的想象的推理和计划能力。这份独属于人类的天赋怎能不令我们惊奇和骄傲。

借用图灵奖得主朱迪亚·珀尔在《为什么:关于因果关系的新科学》对于人的三种不同层级的认知能力的区分:观察、行动和想象(seeing、doing、imagining),我们再深入探讨下当前人工智能可以做哪些或者说还不能做哪些?

第一层是观察能力,即观察到事实A与事实B,随后建立起事实A与事实B的判断X,基于判断X,会影响我们得出另外一个结论Y。比如哲学上经典的三段论:我们观察到一个人(事实A),人们都把他称作苏格拉底(事实B),我们得到“苏格拉底是人”(判断X);我们还掌握了一条颠扑不破的真理:凡人皆有一死(判断Y);最后,我们得出:苏格拉底会死(结论Z)。请不要小看这一能力,我们正是依靠强大的判断能力形成经验,让人类从严酷的自然选择中获得胜利。

第二层是干预能力,即实施干预X或Y,会造成怎样的结果Z。以上例子继续假设,如果我们对“苏格拉底是人”进行干预,比如,当时的人们将苏格拉底神圣化为像耶稣一样的人物,即使他确实是喝下毒药而身亡,但因为已经“从人变成了神”,所以,我们就可以得出“苏格拉底没有死”的结论。这一假设看似荒诞,正是由于这些能力,我们可以进行育种、畜牧、开采,建立宗教、城邦和帝国组织等,人类文明短短几百年对自然的干预已经超过之前数百万年的影响。

第三层是反事实的能力,涉及到人类的想象和反思能力。即如果判断X或Y引起了结论Z,那么,如果X、Y没有发生,那么结论Z也会变化。再假设,人类发明了时间机器且发明了长生不死的药物,那我们回到古希腊雅典的监狱,将毒药换成了长生不死药喂给了苏格拉底,判断Y被推翻,同样改变了结论Z。正是这些更为夸张的想象,让人类提出科学假说、建立像相对论、量子力学等等的知识系统,进行文学艺术创造等非凡能力。

那么,目前人工智能处在模仿人类智能的哪个层级。如果你对人工智能有多少乐观,那结论就会有多失望。目前即使是成果斐然的深度学习算法,仍然处在这三层认知能力的第一层,其智慧的难度跟猫头鹰观察老鼠出没与否的能力不相上下。

尽管机器学习尤其是深度学习算法在比如图像识别、语音识别、无人驾驶、棋牌游戏对战等众多领域可以超过人类,但其模式仍然是“由一系列观察结果驱动,致力于拟合出一个函数……深度神经网络只是为拟合函数的复杂性增加了更多的层次,但其拟合过程仍然由原始数据驱动……处于因果关系之梯的任何运行系统都不可避免地缺乏这种灵活性和适应性。”

这意味着,机器学习及深度神经网络的算法,只是利用对于输入数据的相关性关系的拟合,而不理解因果关系,那么人工智能就不能从第一层认知上升到第二层级,无法回答有关干预的种种问题。

以上作为理解背景稍显冗长。但MEMO所完成的长距离推理能力,在我们所述的三个认知层次上有了一个显著性的位置。MEMO成为深度神经网络开始具备长距离因果推理能力的一次成功尝试,也许可以视作人工智能从第一层级向第二层级的跃迁上搭建了一个更好的阶梯。

MEMO算法的创新之处

首先,MEMO参考了神经科学中的“联想推理”的能力,他们从最新的对海马体的研究中获得了方法灵感。海马体通过一种被称为“模式分离”的过程中进行独立地记忆储存,以最大限度地减少记忆之间的干扰;同时最新的研究又指出,这些被独立存储记忆通过循环机制进行检索以实现整合,从而支持众多单个经验的灵活组合,以推断其未曾观察过的关系。最终由此而形成推理。

DeepMind 研究人员称,他们正是从这一神经科学模型的研究中获得启发,来研究和增强机器学习模型中的推理能力。

MEMO 相较于之前的推理系统,引入了两个新的组件:第一它引入了存储在外部记忆中的事实与构成外部记忆中这些事实的项之间的分离;第二个它利用自适应检索机制,在产生答案之前允许有一些可变数量的“记忆跃点”。

进一步解释下。第一个组件:MEMO采取了基于EMN(End-to-End Memory Networks,端到端记忆网络)的呈现外部记忆表征的基本结构,但其新结构中加入了通过参照海马体机制设计的新的任务PAI(Paired Associative Inference,联想配对推理),它允许对记忆中的单个元素进行灵活的加权,以增强推理的能力。

第二个组件:在运行中,还需要解决计算时间过长的问题。在标准的神经网络中,计算量是基于输入的函数的大小而增长,而MEMO更希望让计算时长跟任务的复杂度相关。为此,它从人类联想记忆的模式中引入了一种被称为“REMERGE(重现)”的模型。在该模型中,从记忆中检索到的内容作为新的查询被重新循环,然后利用在重新循环过程中的不同时间步骤检索到的内容之间的差异来计算网络是否适应在固定点上。MEMO可以采用一种“终止策略”,通过网络输出一个动作(在强化学习的意义上),表示它是否希望继续计算和查询其记忆,或者它是否能够回答给定的任务。并在强化学习中引入一个新项——二进制停止随机变量(the binary halting random variable),以最小化预期的计算步骤。

基于这两个新组件的加入,MEMO在下面三个经验性结果的任务测试中取得显著的优势成绩,从而也证明了这两个组件的有效性。

三组结果验证:MEMO与另外两种内存增强架构:EMN和DNC(the Differential Neural Computer,微分神经网络)以及UT(Universal Transformer,普遍转换器,bAbI任务套件中的最新模型)进行了比较。

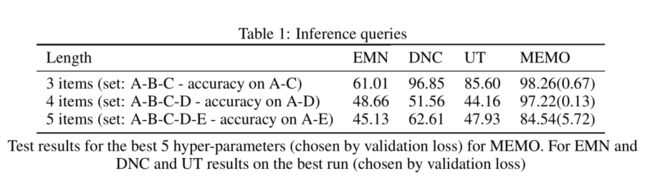

1、关于联想配对推理:在较小集合的推理查询上,MEMO可以和DNC一样达到最高的准确度,而EMN即使有4或10跳,也不能达到相同的准确度,而且UT也不能准确地解决这个推理测试。而对于较长的序列结合(即下面的长度4和5),MEMO是唯一成功地回答最复杂推理查询的架构。

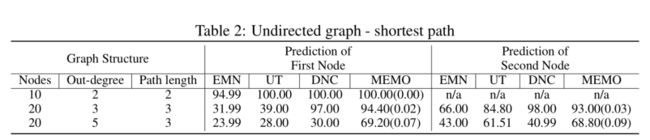

2、对于随机生成图形的最短路径的测试:表 2 显示与查找最短的两个节点之间的路径。在只有10个Nodes的短路径上,DNC、UT和MEMO具有完美的预测时中间最短路径节点的准确性。在20个Nodes的长路径上,MEMO 在具有高度连通性的更复杂的图形中优于 DNC,在最短路径中预测两个节点时,效果更超过 20%。

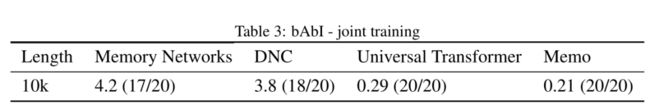

3、关于BABI任务的问答测试上:在10k训练集中,将 MEMO 与两个基准模型以及UT模型进行了比较,结果显示,MEMO唯一能够在较长的序列上成功回答最复杂的推理查询的体系结构。

显然,MEMO在基于记忆表征的长距离推理的改进非常明显,而其创新之处在于它采用了神经科学所应用于测试推理的联想配对推理方法的新型结构。这也从反面证实了神经科学中关于记忆推理的假设:记忆中事实元素的分离储存与强大的注意力机制组合,在通过对记忆存储中的单个元素的灵活组合来实现推理。

MEMO:通往AGI的正途?

从一开始,AGI就是DeepMind诞生之初的目标。DeepMind创始人德米斯·哈萨比斯很早就采用了神经科学的方法来研究AGI。

早在2010年8月,DeepMind创立前的三个月,哈萨比斯经在当年的奇点峰会上发表了一个题为“一种通过系统神经科学方法构建AGI” (A Systems Neurosciences Approach To Building AGI)的演讲。

在演讲中,他回应了之前两种接近AGI的方向:一是通过象征性AI,即通过描述和编程体系来构造人类大脑的思考体系,其失败之处就是操作难度太大,难以真实描述大脑的结构。二是通过数字形式复制大脑的物理网络结构,这一方法很有意义,但这一任务重点放在还原大脑的物理功能却不能解释人类智慧的运行规则。

经过比较,哈萨比斯采取了折中路线:AGI应该从大脑处理信息的宏观方法中得到启发,而不是从其物理结构或者说大脑的特定脑区功能去寻找方法。简言之,AGI应专注于理解人脑的软件功能,而非硬件功能。通过磁共振成像(FMRI)等新技术,使得人们可以观察人类各种思维活动时大脑内部的活动,从而可以理解其运作机制。而AI研究应当效仿人类的大脑系统。

这奠定了DeepMind的研究思路,人工智能就应该像人一样学习和思考。这意味着,DeepMind坚信,神经科学研究所找到的“大脑算法”可以被神经网络所参照和使用。反过来,这套机制在神经网络机制上的成功实践,又反过来促进神经科学的发展。

显然,从MEMO的效果而言,模拟人脑神经网络机制的方法似乎可以作为通向AGI的一条通路,但这条路也绝不是坦途,比如眼前这道“因果关系推理”的巨大鸿沟。MEMO的提出,仅仅是在为跨越这道沟壑搭建出的一步重要的阶梯。

在通向AGI的征途里,深度学习等技术还将持续进化,它需要先沿着“因果关系”的这道鸿沟向下,深入到人类因果性认知的各个低谷,比如跳跃式联想、条件干预的因果预测、反事实推理等等,才有可能重新向上跨越鸿沟。

道阻且长,AGI的黎明不会很快到来。但正因为DeepMind这样的AI研究机构的努力,才能让暗夜中探索的人们始终心怀火种。

![]()