百篇最值得一读的“认知图谱”经典论文

当你站在人脸识别门禁闸口,扫脸,绿灯亮通过,就可以任意进出宿舍楼、图书馆、教学区等各种校内场所,你也许会想:机器认识我吗?

实际并非如此。当前的AI识别能做的只是比对,它缺少信息进入大脑之后的加工、理解、思考步骤,因此仅仅停留在感知阶段,而并非“认知”。而这种以感知智能技术为主的人工智能,无论是在智能理解能力还是安全性方面,与人类智能都相去甚远。

想要让人工智能有类似大脑的活动,走到认知阶段,需要让它掌握知识、进行推理。机器必须要掌握大量的知识,特别是常识知识才能实现真正类人的智能。所以,“理解”与“解释”是AI需要攻克的下一个挑战,而认识图谱为“可解释的AI”提供了全新的视角和机遇。

“Knowing yourself is the beginning of all wisdom.”亚里士多德的这句话,正是认知图谱使命最好的概括。

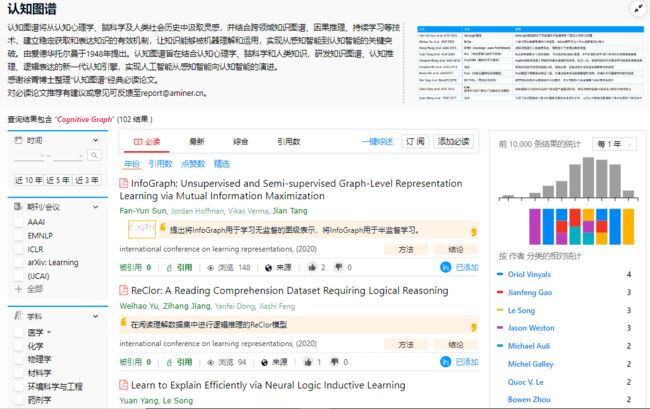

那么,想深入学习和研究认知图谱,研读该领域的经典论文,对于研究者和从业者都必不可缺。经过我们对人工智能领域国际顶会/期刊中“认知图谱”相关关键词论文的计算,以及热心读者徐菁博士的整理,AMiner推出了100篇认知图谱经典必读论文。这些论文可以说基本都是经典中的经典,他们多是领域大佬+顶级会议的组合,读完它们,相信你对认知图谱的认认识肯定会有质的飞越。

此外,AMiner还为你特别准备了“一键综述”服务,一键批量生成“论文综述”,另有“论文精读”加持,如此周到细致,还不赶紧来体验下。

地址奉上:https://www.aminer.cn/search/pub?q=Cognitive%20Graph&from=csdn

(在使用体验过程若有任何意见,请在文末留言或邮件至[email protected])

该List除了整合了认知图谱领域的100篇经典论文,小脉还对这些论文进行了简要分析。

先来看看它们都出自哪些会议?根据对论文出处的分析,它们大多选自NeurIPS、ICLR、ACL、EMNLP、IJCAI、AAAI等机器学习与自然语言处理领域的国际顶会。

根据对这些经典论文发表年份的统计,近十年这些论文主要发表在2016-2019这四年间,占比达60%;在2014-2016年间也有不少经典论文发表。

再来看看入选作者,有一位大佬有4篇论文入选,他正是DeepMind的研究科学家Oriol Vinyals,在今年被评为AI 2000机器学习全球最具影响力学者之一。还有三位作者有3篇论文入选,他们分别是微软研究院合伙人研究经理高剑峰,佐治亚理工大学机器学习中心的教授宋乐,Facebook研究科学家、纽约大学客座教授Jason Weston,他们都是机器学习领域的大牛。另有21位作者都有2篇入选。

我们按照这100篇经典论文的被引量,挑选了其中的TOP10作简单评述,供大家学习参考。

我们近期还会推出《认知图谱研究报告》,欢迎关注。

《Neural Machine Translation by Jointly Learning to Align and Translate》(ICLR 2015)

作者:Dzmitry Bahdanau,Kyunghyun Cho,Yoshua Bengio

单位:Jacobs University Bremen,Université de Montréal

引用量:9818

地址:https://www.aminer.cn/pub/5550411c45ce0a409eb3897f/neural-machine-translation-by-jointly-learning-to-align-and-translate

推荐理由:这篇论文的一作正是Yoshua Bengio的博士生Dzmitry Bahdanau。文中首次提出在神经网络机器翻译(NMT) 中使用Attention的机制,可以使模型自动确定源句子中和目标词语最相关的部分,相比于基本encoder-decoder方法提高了翻译效果。该文提出的方法优化了神经机器翻译模型,其效果的提升对于长句子的翻译尤其明显。

《Sequence to Sequence Learning with Neural Networks》(NeurIPS2014)

作者:Ilya Sutskever,Oriol Vinyals,Quoc V. Le

单位:Google

引用量:8846

地址:https://www.aminer.cn/pub/5550410f45ce0a409eb384f8/sequence-to-sequence-learning-with-neural-networks

推荐理由:该文是谷歌发表于2014年NeurIPS的一篇神作,现已被广泛使用的Sequence to Sequence模型论文。文中基于多层的长短期记忆网络(LSTM),提出了一种对序列结构做最小假设的一般端到端序列学习方法,在长短句翻译方面均表现优异。

《BERT: Pre-training of Deep Bidirectional Transformers for Language Understanding》(NAACL-HLT 2019)

作者:Jacob Devlin,Ming-Wei Chang,Kenton Lee,Kristina Toutanova

单位:Google

引用量:2952

地址:https://www.aminer.cn/pub/5bdc31b417c44a1f58a0b8c2/bert-pre-training-of-deep-bidirectional-transformers-for-language-understanding

推荐理由:该论文提出的BERT模型被各地学者、媒体美誉为NLP新一代大杀器。文中提出了一种语言表达模型BERT,即Transformer的双向编码表示,它通过考虑所有层整个上下文对为标注过的文本进行深度双向表达的预训练。实验结果证明,使用预训练过的BERT模型,仅仅在后面再包一层输出层,并对其进行微调训练,就可以取得不错的效果。BERT在机器阅读理解顶级水平测试SQuAD1.1中表现出惊人成绩:全部两个衡量指标上全面超越人类,并且还在11种不同NLP测试中创出最佳成绩。

《Ontology Learning for the Semantic Web》(IEEE 2001)

作者:Alexander D. Maedche,Steffen Staab

单位:University of Karlsruhe

引用量:2932

地址:https://www.aminer.cn/pub/53e9aeddb7602d970390969d/ontology-learning-for-the-semantic-web

推荐理由:本文提出了一种利用半自动本体构建工具,扩展典型本体工程环境的本体学习框架。该框架包括本体的导入、提取、裁剪、细化和评价。实验结果表明,利用语义网和本体,该方法能够实现全面的、可移植的机器理解。

《Effective Approaches to Attention-based Neural Machine Translation》(EMNLP 2015)

作者:Thang Luong,Hieu Pham,Christopher D. Manning

单位:Stanford University

引用量:2866

地址:https://www.aminer.cn/pub/5736974d6e3b12023e638ae7/effective-approaches-to-attention-based-neural-machine-translation

推荐理由:该文是NLP大牛Christopher D. Manning与他的博士生Thang Luong等人的佳作。也是继Bahdanau等人提出Attention用于NLP的后续工作,作者提出了相对于之前工作的两种新的但却有效的注意力机制,全局注意力(global)和局部注意力(local)。其中,局部注意力机制的运用使得神经机器翻译模型远胜于非注意力机制模型(5个BLEU点)。在融合了各个注意力机制模型之后,它在英文翻译到德文的多项任务中取得了SOTA的结果。

《Attention Is All You Need》(NeurIPS2017)

作者:Ashish Vaswani,Noam Shazeer,Niki Parmar,Jakob Uszkoreit,Llion Jones,Aidan N. Gomez,Lukasz Kaiser,Illia Polosukhin

单位:Google,University of Toronto

引用量:2706

地址:https://www.aminer.cn/pub/599c7987601a182cd2648373/attention-is-all-you-need

推荐理由:本篇文章的创新点在于抛弃了之前传统的encoder-decoder模型必须结合CNN或者RNN的固有模式,只用Attention。文章提出一种基于注意机制的transformer模型,目的在于减少计算量和提高并行效率的同时不损害最终的实验结果。结果表明,它能更好地完成机器翻译任务,在质量上更优同时可并行化,所需的训练时间明显更少。

《Translating Embeddings for Modeling Multi-relational Data》 (NeurIPS2013)

作者:Antoine Bordes,Nicolas Usunier,Alberto García-Durán,Jason Weston,Oksana Yakhnenko

单位:Universite de Technologie de Compi` egne (UTC),Google

引用量:1660

地址:https://www.aminer.cn/pub/53e9a7ddb7602d970311b83d/translating-embeddings-for-modeling-multi-relational-data

推荐理由:本文提出了TransE,一种通过将关系解释为在实体的低维嵌入上操作的转换来建模关系的方法。尽管它很简单,但是这种假设被证明是强大的,因为大量的实验表明在两个知识库连接预测方面,TransE明显优于目前最新的方法。它解决了多关系数据在低维向量空间中的嵌入问题,且模型易于训练,包含较少的参数,可以扩展到非常大的数据库。

《Ontology Based Context Modeling and Reasoning using OWL》(PerCom 2004)

作者:Xiaohang Wang,Daqing Zhang,Tao Gu,Hung Keng Pung

单位:National University of Singapore

引用量:1460

推荐理由:https://www.aminer.cn/pub/53e9ba45b7602d97046580ad/ontology-based-context-modeling-and-reasoning-using-owl

简评:该文使用了OWL的基于本体的上下文建模和推理方法,在普适计算环境中建模上下文,并支持基于逻辑的上下文推理。

《A Neural Attention Model for Abstractive Sentence Summarization》 (EMNLP 2015)

作者:Alexander M. Rush,Sumit Chopra,Jason Weston

单位:Facebook

引用量:1229

地址:https://www.aminer.cn/pub/5736974d6e3b12023e63866b/a-neural-attention-model-for-abstractive-sentence-summarization

推荐理由:该文是神经网络用于生成式模型的开篇之作,作者提出了利用Gigaword构建大量平行句对的方法,使得利用神经网络训练成为可能,之后多篇工作都使用了该方法构建训练数据。实验结果表明,该方法使得文本文摘的性能提升,容易进行端到端训练,并可扩展到大量的训练数据。

《Reasoning With Neural Tensor Networks for Knowledge Base Completion》(NeurIPS2013)

作者:Richard Socher,Danqi Chen,Christopher D. Manning,Andrew Y. Ng

单位:Stanford University

引用量:1043

地址:https://www.aminer.cn/pub/53e9bafbb7602d970473538a/reasoning-with-neural-tensor-networks-for-knowledge-base-completion

推荐理由:这篇论文是是吴恩达与曼宁团队的佳作。这篇论文主要创新点表现在,相比前人在知识库里使用实体去预测关系,作者引入了一个损失函数为双线性的三层神经网络(NTN)模型,并且对于实体向量初始化的处理采用非监督模型训练得到的词向量的平均值,大大提高了系统的准确率。

看完了以上佳作,更多经典论文请进入“认知图谱”专题页查看:

http://www.aminer.cn/search/pub?q=Cognitive%20Graph&from=csdn

人工智能领域 100 个主题的经典必读论文:https://www.aminer.cn/topic

“一键综述”、论文结构化解剖(速览/精读/相关论文检索)、支持 “赞”、“踩”、“添加必读”、“认领topic”等。