三维重建(一)-------------------3D reconstruction 较为实用的算法资料整理(传统方式)

本文结合一些pape并且将资源进行整合,以便于后期的学习。博客将这些资源一下,这里不得提到大名鼎鼎的KinectFusion以及他后面的一系列工作。KinectFusion单篇论文引用都已经超过3000次了,可以称得上是具有划时代意义的一篇巨著,如果只想看现阶段效果最好的三维重建算法,请拉到文章最后(如有更好的算法,还请各位留言告知,以便于笔者及时更新,还望告知)

一、KinectFusion(2011)

帝国理工的Newcombe等人在2011年提出的KinectFusion,可在不需要RGB图而只用深度图的情况下就能实时地建立三维模型。KinectFusion算法首次实现了基于廉价消费类相机的实时刚体重建,在当时是非常有影响力的工作,它极大的推动了实时稠密三维重建的商业化进程。

在他们的论文中没有开源代码,最初的代码是由PCL团队实现的:https://link.zhihu.com/?target=http%3A//pointclouds.org/news/kinectfusion-open-source.html

KinectFusion之后,陆续出现了Kintinuous,ElasticFusion ElasticReconstruction,DynamicFusion,InfiniTAM,BundleFusion等非常优秀的工作。其中2017年斯坦福大学提出的BundleFusion算法,据说是目前基于RGB-D相机进行稠密三维重建效果最好的方法。

二、Kintinuous和ElasticFusion

这两个工作都是同一个人做出来的,这个人就是Thomas Whelan。这两个工作应该算KinectFusion之后影响力比较大的。

Kintinuous GitHub代码:https://github.com/mp3guy/Kintinuous

ElasticFusion GitHub代码:https://github.com/mp3guy/ElasticFusion

Kintinuous2.0重建效果:

ElasticFusion 重建效果:

三、ElasticReconstruction

项目官网:http://qianyi.info/scene.html

GitHub代码:https://github.com/qianyizh/ElasticReconstruction

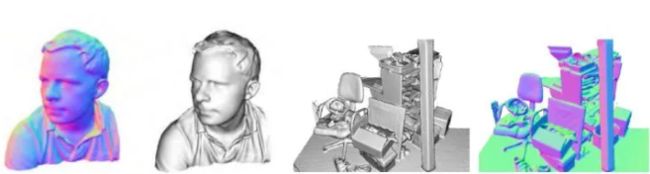

重建效果:

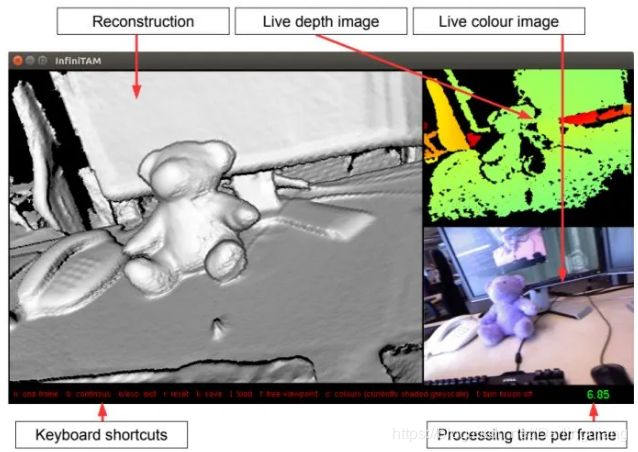

四、InfiniTAM

InfiniTAM提供Linux,iOS,Android平台版本,CPU可以实时重建。

官网:http://www.robots.ox.ac.uk/~victor/infinitam/

GitHub代码:https://github.com/victorprad/InfiniTAM

重建效果:

五、DynamicFusion

官网:https://grail.cs.washington.edu/projects/dynamicfusion/

代码:https://github.com/mihaibujanca/dynamicfusion

重建效果:

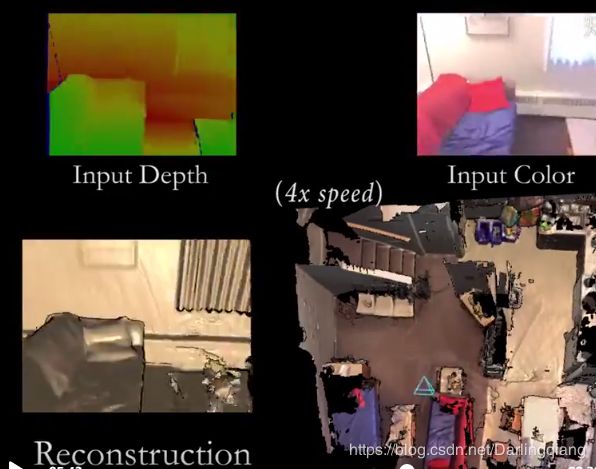

六、BundleFusion

官网:http://graphics.stanford.edu/projects/bundlefusion/

论文:https://arxiv.org/pdf/1604.01093.pdf

代码:https://github.com/niessner/BundleFusion

重建效果:

参考文献:

【1】CMVS/PMVS: http://www.di.ens.fr/cmvs/

【2】https://www.zhihu.com/question/29885222/answer/918009389

【3】https://www.zhihu.com/question/29885222

【4】https://www.zhihu.com/question/29885222/answer/48940748

【5】https://mp.weixin.qq.com/s/NUFr_Jz98HM93Xm-6jDICw

基于图像的大规模场景三维重建(上):https://www.leiphone.com/news/201711/9dxX6g30dlEoqvPZ.html

基于图像的大规模场景三维重建(下):https://www.leiphone.com/news/201711/s6CHNAyjurPPyKiz.html

3D点云目标检测算法