BERT-BiLSTM-CRF基于BERT预训练的中文命名实体识别TensorFlow实现

![]()

向AI转型的程序员都关注了这个号????????????

机器学习AI算法工程 公众号:datayx

Tensorflow solution of NER task Using BiLSTM-CRF model with Google BERT Fine-tuning

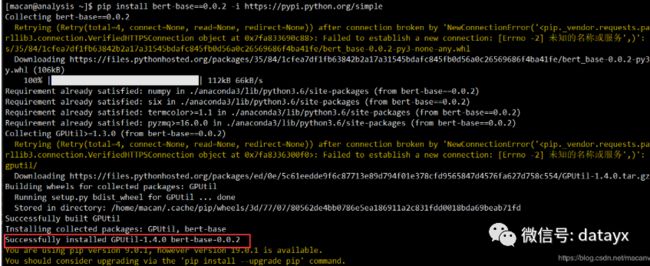

现在可以使用下面的命令下载软件包了:

pip install bert-base==0.0.7 -i https://pypi.python.org/simple

或者使用基于源代码的安装:

git clone https://github.com/macanv/BERT-BiLSTM-CRF-NER

cd BERT-BiLSTM-CRF-NER/

python3 setup.py install

如果没啥问题,你将会看到这个:

笔者在windows10/ Linux/ Mac OSX上都测试过,安装没有问题。

软件包现在支持的功能

命名实体识别的训练

命名实体识别的服务C/S

继承优秀开源软件:bert_as_service(hanxiao)的BERT所有服务

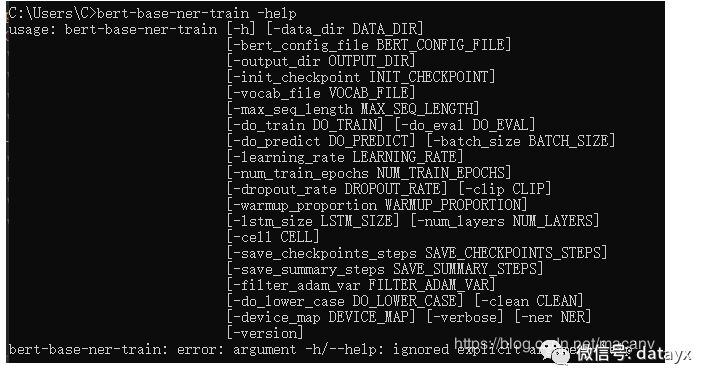

基于bert命名行训练命名实体识别模型:

安装完bert-base后,会生成两个基于命名行的工具,其中bert-base-ner-train支持命名实体识别模型的训练,你只需要指定训练数据的目录,BERT相关参数的目录即可。可以使用下面的命令查看帮助

bert-base-ner-train -help

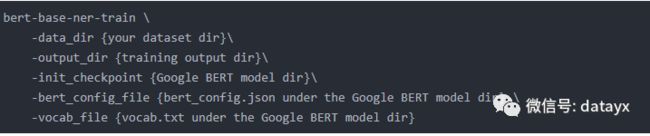

训练命名实体识别的例子如下:

参数说明

其中data_dir是你的数据所在的目录,训练数据,验证数据和测试数据命名格式为:train.txt, dev.txt,test.txt,请按照这个格式命名文件,否则会报错。

训练数据的格式如下:

每行得第一个是字,第二个是它的标签,使用空格’ '分隔,请一定要使用空格。句与句之间使用空行划分。程序会自动读取你的数据。

output_dir:训练模型输出的文件路径,模型的checkpoint以及一些标签映射表都会存储在这里,这个路径在作为服务的时候,可以指定为-ner_model_dir

init_checkpoint: 下载的谷歌BERT模型

bert_config_file :谷歌BERT模型下面的bert_config.json

vocab_file:谷歌BERT模型下面的vocab.txt

训练完成后,你可以在你指定的output_dir中查看训练结果。

将命名实体识别任务进行服务部署

作为服务的很多代码都来自优秀的开源项目: bert as service of hanxiao

https://github.com/hanxiao/bert-as-service

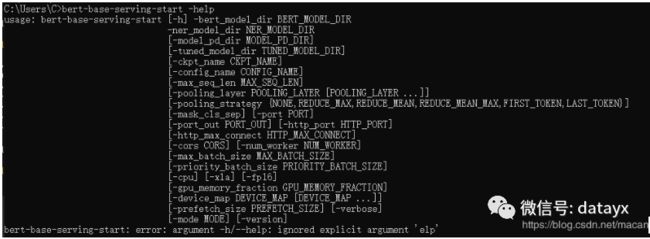

作为服务的命名是:bert-base-serving-start,同样的,你可以先使用-help查看相关帮助

bert-base-serving-start -help

作为命名实体识别任务的服务,这两个目录是你必须指定的:ner_model_dir, bert_model_dir

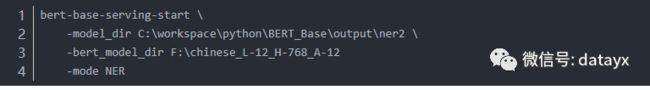

然后你就可以使用下面的命令启动了:

参数解释

bert_model_dir: 谷歌BERT模型的解压路径,可以在这里下载 https://github.com/google-research/bert

model_dir: 训练好的NER模型或者文本分类模型的路径,对于上面的output_dir

model_pd_dir: 运行模型优化代码后, 经过模型压缩后的存储路径,例如运行上面的命令后改路径下会产生 ner_model.pb 这个二进制文件

mode:NER 或者是BERT这两个模式,类型是字符串,如果是NER,那么就会启动NER的服务,如果是BERT,那么具体参数将和[bert as service] 项目中得一样。

我提供了命名实体识别pb模型下载:

https://pan.baidu.com/s/1m9VcueQ5gF-TJc00sFD88w,

提取码: guqq

文本分类模型:https://pan.baidu.com/s/1oFPsOUh1n5AM2HjDIo2XCw, 提取码: bbu8

文本分类使用的是bert中的demo:run_classxxx.py,在运行的时候使用Pickle序列化了label_list和id2label折两个变量。

将 ner_mode.pb/classification_model.pb 文件放到 model_pd_dir目录下,将命名识别的label_list.pkl和id2map.pkl不同的模型不同的文件夹,因为他们同名,但是内容不一样,需要区分开来

命名实体识别模型只支持人名,地名,住址机构名的识别,在我的测试数据上有95.6%的F1值(实体级别的得分)

文本分类模型数据来自清华大学的文本分类数据:http://thuctc.thunlp.org/ , 在测试数据上准确率为98%~99%的准确率

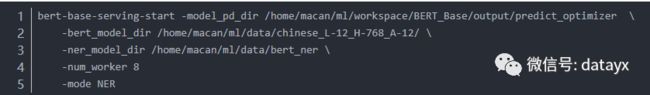

如果使用的下载的模型,你可以使用下面的命令启动,替换你自己的路径即可:

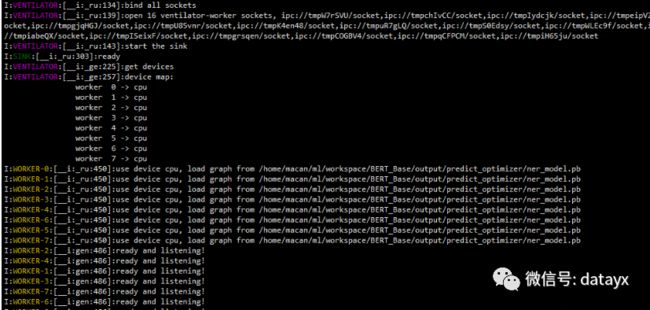

你将会看到下面的启动信息(启动log有点多,分两张图截):

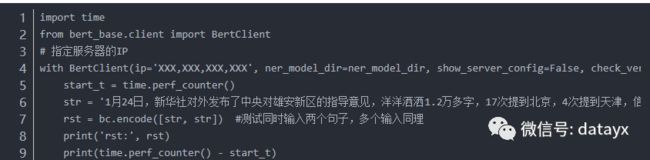

在本地连接服务端进行命名实体识别的测试

你可以使用下面的代码进行服务的连接,在本地进行NER测试,客户端代码如下:

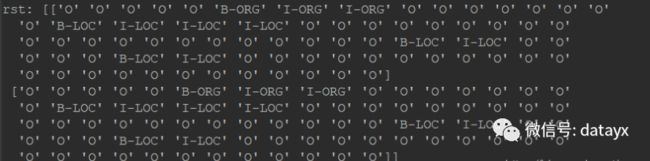

运行后,会输出下面的信息:

结果说明:

返回的结果就是序列标注的结果

到此,基于命令行的用法已经讲完,不明白的地方请评论或者在GitHub上提交issue,觉得有用。

原文地址

https://blog.csdn.net/macanv/article/details/85684284

阅读过本文的人还看了以下文章:

【全套视频课】最全的目标检测算法系列讲解,通俗易懂!

《美团机器学习实践》_美团算法团队.pdf

《深度学习入门:基于Python的理论与实现》高清中文PDF+源码

python就业班学习视频,从入门到实战项目

2019最新《PyTorch自然语言处理》英、中文版PDF+源码

《21个项目玩转深度学习:基于TensorFlow的实践详解》完整版PDF+附书代码

《深度学习之pytorch》pdf+附书源码

PyTorch深度学习快速实战入门《pytorch-handbook》

【下载】豆瓣评分8.1,《机器学习实战:基于Scikit-Learn和TensorFlow》

《Python数据分析与挖掘实战》PDF+完整源码

汽车行业完整知识图谱项目实战视频(全23课)

李沐大神开源《动手学深度学习》,加州伯克利深度学习(2019春)教材

笔记、代码清晰易懂!李航《统计学习方法》最新资源全套!

《神经网络与深度学习》最新2018版中英PDF+源码

将机器学习模型部署为REST API

FashionAI服装属性标签图像识别Top1-5方案分享

重要开源!CNN-RNN-CTC 实现手写汉字识别

yolo3 检测出图像中的不规则汉字

同样是机器学习算法工程师,你的面试为什么过不了?

前海征信大数据算法:风险概率预测

【Keras】完整实现‘交通标志’分类、‘票据’分类两个项目,让你掌握深度学习图像分类

VGG16迁移学习,实现医学图像识别分类工程项目

特征工程(一)

特征工程(二) :文本数据的展开、过滤和分块

特征工程(三):特征缩放,从词袋到 TF-IDF

特征工程(四): 类别特征

特征工程(五): PCA 降维

特征工程(六): 非线性特征提取和模型堆叠

特征工程(七):图像特征提取和深度学习

如何利用全新的决策树集成级联结构gcForest做特征工程并打分?

Machine Learning Yearning 中文翻译稿

蚂蚁金服2018秋招-算法工程师(共四面)通过

全球AI挑战-场景分类的比赛源码(多模型融合)

斯坦福CS230官方指南:CNN、RNN及使用技巧速查(打印收藏)

python+flask搭建CNN在线识别手写中文网站

中科院Kaggle全球文本匹配竞赛华人第1名团队-深度学习与特征工程

不断更新资源

深度学习、机器学习、数据分析、python

搜索公众号添加: datayx

![]()

QQ群

333972581

![]()