一 环境准备

1.1 基础环境

ntp配置:略 #建议配置ntp服务,保证时间一致性

etcd版本:v3.3.9

防火墙及SELinux:关闭防火墙和SELinux

1 # hostnamectl set-hostname etcd1.example.com 2 # hostnamectl set-hostname docker01.example.com 3 # hostnamectl set-hostname docker02.example.com

提示:主机名非必须。

1.2 docker环境

以上所有节点均安装docker,具体方式见《002.docker版本及安装》。

二 etcd节点部署

提示:本环境全部采用docker化,即etcd服务也以docker形式存在。

2.1 etcd基础配置

1 # mkdir -p /var/log/etcd/ #建议创建etcd日志保存目录 2 # mkdir -p /data/etcd #建议创建单独的etcd数据目录 3 # export HOST_1=172.24.8.71 #设置etcd节点的IP 4 # export DATA_DIR=/data/etcd #设置集群etcd数据节点 5 # REGISTRY=quay.io/coreos/etcd #建议使用此仓库 6 # ETCD_VERSION=latest #设置etcd版本 7 # export NAME_1=etcd1 #设置etcd节点的name 8 # docker volume create --name etcd-data

提示:以上所有操作需要在所有节点操作。

2.3 启动docker etcd集群

1 [root@etcd1 ~]# docker run \ 2 -p 2379:2379 \ 3 -p 2380:2380 \ 4 --volume=${DATA_DIR}:/etcd-data \ 5 --name etcd ${REGISTRY}:${ETCD_VERSION} \ 6 /usr/local/bin/etcd \ 7 --data-dir=/etcd-data --name ${NAME_1} \ 8 --initial-advertise-peer-urls http://${HOST_1}:2380 --listen-peer-urls http://0.0.0.0:2380 \ 9 --advertise-client-urls http://${HOST_1}:2379 --listen-client-urls http://0.0.0.0:2379 \ 10 --initial-cluster ${NAME_1}=http://${HOST_1}:2380

提示:quay.io/coreos/etcd镜像国内可能无法pull,可在国外节点pull,然后scp至集群节点。

2.4 确认验证

1 [root@etcd1 ~]# docker ps

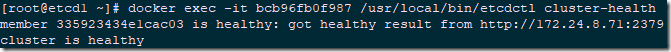

1 [root@etcd1 ~]# docker exec -it bcb96fb0f987 /usr/local/bin/etcdctl cluster-health

1 [root@etcd1 ~]# docker exec -it bcb96fb0f987 /usr/local/bin/etcdctl --endpoints=http://${HOST_1}:2379 member list

三 docker宿主机节点配置

3.1 docker01配置

1 [root@docker01 ~]# vi /etc/sysconfig/docker 2 OPTIONS='--cluster-store=etcd://172.24.8.71:2379 --cluster-advertise=172.24.8.72:2379' 3 [root@docker01 ~]# systemctl restart docker

3.2 docker02配置

1 [root@docker02 ~]# vi /etc/sysconfig/docker 2 OPTIONS='--cluster-store=etcd://172.24.8.71:2379 --cluster-advertise=172.24.8.73:2379' 3 [root@docker02 ~]# systemctl restart docker

3.3 创建overlay网络

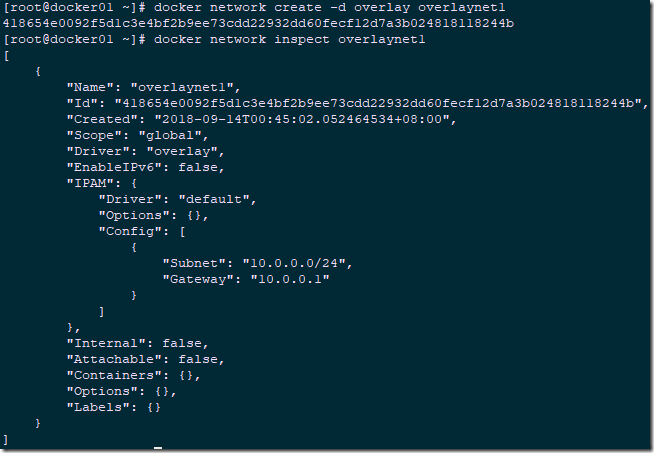

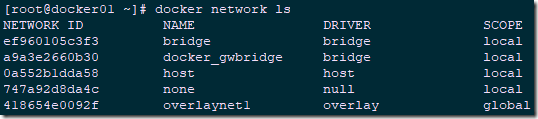

1 [root@docker01 ~]# docker network create -d overlay overlaynet1 2 418654e0092f5d1c3e4bf2b9ee73cdd22932dd60fecf12d7a3b024818118244b 3 [root@docker01 ~]# docker network inspect overlaynet1

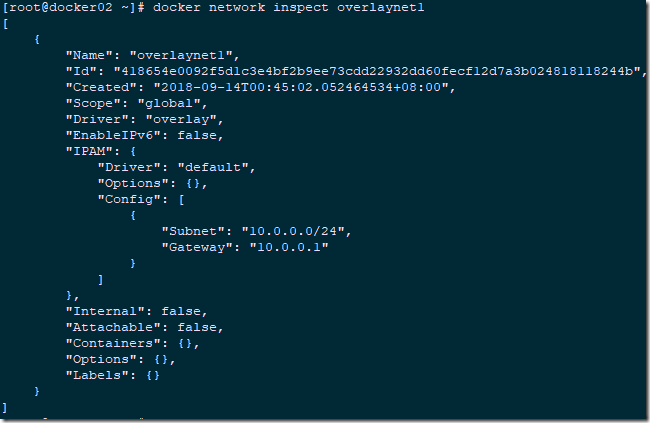

1 [root@docker02 ~]# docker network inspect overlaynet1

提示:分别在docker01和docker02宿主机查看在docker01上创建的overlay网络,若都存在则表示通过 etcd,网络数据是分布式而不是本地的了。

3.4 测试网络

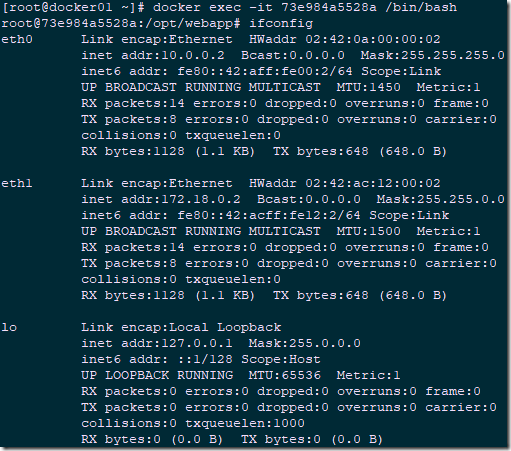

1 [root@docker01 ~]# docker run -d --name Container01 --network overlaynet1 training/webapp python app.py 2 [root@docker02 ~]# docker run -d --name Container02 --network overlaynet1 training/webapp python app.py 3 [root@docker01 ~]# docker exec -it 73e984a5528a /bin/bash 4 root@73e984a5528a:/opt/webapp# ifconfig

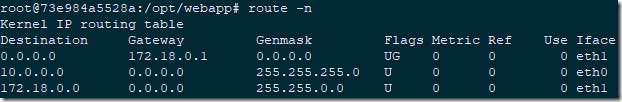

1 root@73e984a5528a:/opt/webapp# route -n

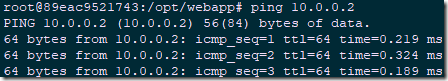

1 [root@docker02 ~]# docker exec -it 89eac9521743 /bin/bash 2 root@89eac9521743:/opt/webapp# ifconfig

说明:

- 所有容器对会存在两个网卡,eth0和eth1;

- 其中 eth1 的网络是一个内部的网段,即普通的 NAT 模式;

- 其中 eth0 是 overlay 网段上分配的IP地址,即 overlay 网络,且 MTU 是 1450 而不是 1500;

- 只有同一个 overlay 网络中的容器之间的通信才会通过 eth0,其它所有通信还是经过 eth1。

1 [root@docker01 ~]# brctl show

1 [root@docker01 ~]# docker network ls

其他引用:

- Docker 在每个节点上创建了两个 linux bridge,一个用于 overlay 网络,一个用于非 overlay 的 NAT 网络(docker_gwbridge);

- 容器内的到overlay 网络的其它容器的网络流量走容器的 overlay 网卡(eth0),其它网络流量走容器的 NAT 网卡(eth1);

- 当前 Docker 创建 vxlan 隧道的ID范围为 256~1000,因而最多可以创建745个网络,因此,本例中的这个 vxlan 隧道使用的 ID 是 256;

- Docker vxlan 驱动使用 4789 UDP 端口;

- overlay网络模型底层需要类似 consul 或 etcd 的 KV 存储系统进行消息同步;

- Docker overlay 不使用多播;

- Overlay 网络中的容器处于一个虚拟的大二层网络中,

参考链接:https://www.cnblogs.com/allcloud/p/7150564.html