Pix2Pose开源:用于6D姿势估计的对象的像素坐标回归的算法

作者

介绍

本文主要解决了遮挡、对称和无纹理的问题,提出了一种新的姿态估计方法pix2pose,它可以在无纹理模型的情况下预测每个目标像素的三维坐标,并设计了一个自动编码器来估计每个像素的三维坐标和期望误差。利用像素级预测生成2D-3D之间的对应关系,利用RANSAC迭代PnP算法直接计算姿态。该方法利用生成性对抗训练对遮挡部位进行精确覆盖,从而达到对遮挡的鲁棒性。同时,提出了一种新的损耗函数变压器损耗,用于将预测的姿态引导到最近的对称姿态来处理对称目标。

虽然深度图可以提供精确的三维像素坐标,但获得深度图并不容易。大量的姿态估计依赖于物体的纹理三维模型,这就需要使用三维扫描设备来生成模型。但是,它不适用于没有纹理三维模型的场。

以前处理对称对象的工作:在渲染训练图像时限制姿势的范围,或者对于带注释的真实图像,将范围外的姿势转换为范围内的对称姿势。这种方法适用于单轴对称的物体,只需忽略绕轴的旋转。

然而,BB8指出,当只有有限数量的对称姿势时,很难确定视图边界附近的姿势。

如果包围盒相对于轴具有对称角度π,并且视图在0和π之间,则π+α(α≈0;α>0)处的姿势必须转换为α处的对称姿势,即使α足够小,使得外观非常接近π位置的姿势。

pix2pose通过隐式估计被遮挡像素的3D坐标来实现鲁棒性。使用无纹理三维模型从RGB图像返回像素级三维坐标。新的损失函数处理具有有限模糊视图的对称对象。

缺点

-

利用CNN方法直接预测投影点的三维包、视点和四元数变换。这些方法是直接计算的。其缺点是缺少相应的关系,无法生成多个姿态假设,用于遮挡目标的鲁棒估计。对称对象通常限制视点的范围,这将增加额外的处理。例如,BB8对视图范围进行分类。PoseCNN计算模型与估计姿势和标记姿势中最近点之间的平均距离。但是,找到最近的三维点是很耗时的。

-

特征匹配方法:AAE只使用RGB图像无监督训练姿势的隐式表示。隐式表示可以接近任何对称视图。但是,如果给定一个好的旋转估计值,则很难使用渲染模板指定三维平移。二维边界框的大小用于计算三维平移的z分量。一旦二维边界框出现小错误,将影响三维平移。

-

预测物体空间中像素或局部形状的三维位置。通过将三维坐标返回到每个像素并预测类别。这种方法比较慢。作者使用一个独立的二维检测网络来提供目标的感兴趣区域。

-

四.使用自编码生成模型以对模型进行去噪并恢复图像中丢失的部分。作者用GAN训练了一个自编码网络,该网络能准确地将彩色图像转换为图像到图像转换等坐标值,并能恢复图像绘制等被遮挡部分。

创新点

-

提出了一种新的框架:pix2pose,它使用无像素的三维模型从RGB返回像素级的三维坐标。

-

提出了一种新的损耗函数:transformer loss,用于处理具有有限模糊视图的对称对象。

-

在LineMOD、LineMOD Occlusion和T-Less上,即使遇到遮挡和对称问题,效果也很差。

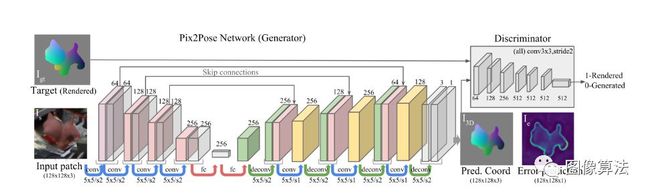

网络结构

网络输入裁剪后的图像为,输出为目标坐标系中每个像素的归一化三维坐标I3D和每个预测的估计误差Ie。Ie使用每个像素作为置信水平,在进行姿态计算之前直接确定内点和外点像素。

图2. Pix2Pose的网络结构和训练管道的概述

目标输出包括被遮挡部分的坐标的预测。由于坐标由三个值组成,并且与RGB值相似,因此可以将输出视为彩色图像。通过在地面真值位姿中绘制颜色坐标模型,可以得到地面真值。输出如下所示:

图3.将3D模型转换为颜色坐标模型的示例。

即将每个顶点的归一化坐标直接映射到颜色空间中的红、绿、蓝值,建立每个像素的2D-3D对应关系,不需要特征匹配。

卷积核和前四个卷积层的大小与AAE相同。

为了保证底层特征映射的细节,将前三层的半通道输出复制到解码器的相应对称层,以增加剩余连接。使边界附近的像素估计更精确。

每个卷积层和反卷积层的卷积核大小固定在5×5。编码器和解码器之间有两个完全连接的层。除了最后一层批处理和激活leakyReLU函数外,所有中间层的输出都是标准化的。

在最后一层,三个通道的输出和激活函数tanh生成三维坐标图像,单通道和激活函数sigmoid的输出估计期望误差Ie。

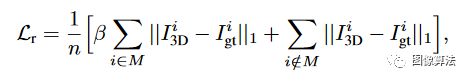

损失函数

利用三维坐标回归方法重建目标图像时,采用每个像素的L1平均距离。由于对象的像素比背景更重要,因此对象遮罩的误差乘以β因子乘以遮罩中的权重误差。基本重建损失:

其中n为像素数,Igt为目标图像的第i个像素,M为目标图像中完全可见对象的遮罩,遮罩还包含遮挡部分,用于预测遮挡对象的不可见部分的值,从而对遮挡对象进行稳健估计。

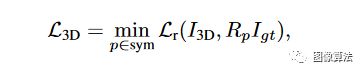

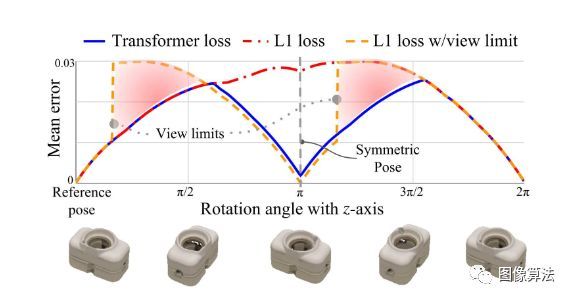

上述损失不能处理对称对象,因为它惩罚了三维空间中距离较大的像素,并且没有对称的先验知识。将三维变换矩阵与目标图像相乘,可以将每个像素的三维坐标变换为对称姿态。使用候选对称姿势中误差最小的姿势计算损耗函数,transformer loss:

Rp是从一个姿势到一个对称姿势的变换。该损失函数适用于对称姿态数目有限的目标。

transformer loss的效果如下:

图4.使用T-Less中的obj-05的对称对象相对于z轴旋转的重建损耗的变化

从图中可以看出,L1损耗在π附近产生较大误差;变压器损耗在0~π范围内产生最小值,预计obj-05的对称角为π。

预测误差计算预测图像与目标图像之间的差,误差预测损失:

GAN网络可以利用来自另一个场的图像在目标场中生成更精确和真实的图像。本文将RGB图像转换成三维坐标图,利用GAN网络实现。鉴别器网络可以区分三维坐标图像是由模型渲染的还是估计的。GAN网络的损耗函数为:

其中D是认证网络。

总损失函数为:

λ1和λ2用于平衡不同的任务。后面提到了λ1=100和λ2=50。

姿态预测

首先使用每个边框的中心、宽度和高度裁剪感兴趣的区域,将输入大小调整为128×128px,然后乘以1.5,以防止裁剪区域包含遮挡部分。本文的姿态预测分为两个阶段,如下图所示:

图6.姿势估计过程的示例。

第一阶段:由于二维目标检测方法的不同,可以对目标进行平移,使边界框与目标中心对齐,消除背景和不确定像素。

预测的坐标图像I3D通过获取非零值像素来指定包括遮挡部分的对象像素。如果像素的误差预测大于外点阈值θo,则利用预测误差去除不确定像素。目标的有效遮罩由非零像素单位和误差小于θo的像素计算,包围盒的新中心由有效遮罩的质心确定。

第一阶段的输出是经过优化的输入,它只包含从新边界框裁剪的有效遮罩的像素。当误差预测小于外点阈值θo时,细化后的输入可以包括遮挡部分,这意味着尽管遮挡,这些像素的坐标仍然容易预测。外点阈值θo由三个值决定,目的是包含更多的可见像素,并使用人工遮挡训练图去除噪声像素。

第二阶段:利用第一阶段的细化图像预测最终的姿态和期望误差。当预测误差大于内点阈值θi时,三维坐标样本中的黑色像素指示该点被移除,即使该点具有非零坐标值。换言之,使用坐标值非零且误差预测小于阈值θi的像素来构造2D-3D对应。

图像中的每一个像素都已经有了物体坐标中三维点的值,所以二维图像坐标与预测的三维坐标直接对应。然后,利用RANSAC的PnP算法,通过最大化内点个数迭代计算最终姿态。内点的二维投影误差小于阈值θre。

pix2pose对T-LESS数据集的评价具有显著的优势,因为T-LESS提供了一个无纹理的CAD模型,而且大多数对象是对称的,这在工业领域更为常见。

作者从真实图像中提取物体的图像,并将其粘贴到COCO数据集中。对图像进行颜色增强后,对目标与背景之间的边界进行模糊处理,使边界平滑。背景图像用于替换部分对象区域以模拟遮挡。最后,对增强后的彩色图像和目标坐标图像进行随机旋转。

利用Resnet-101的快速R-CNN和Resnet-50的Retinanet对检测到的目标类别进行预测,并利用COCO数据集的预训练权值对网络进行初始化。

实验和结果

在LineMOD数据集上的结果如下图:

在不使用求精的方法中,作者的方法最适用于对称对象。

LineMOD Occlusion数据集的结果如下:

pix2pose的效果明显优于yolo-6d,在8种物体中有3种效果sota。

T-LESS数据集的结果如下:

可以作者的方法优于现有的RGB和RGB-D方法。

结论

本文提出了一种新颖的架构Pix2Pose,用于从RGB图像进行6D对象姿态估计。Pix2Pose解决了姿势估计过程中出现的一些实际问题:难以生成具有高质量纹理的真实世界3D模型以及对被遮挡和对称对象进行可靠的姿势估计。通过对三个具有挑战性的基准数据集进行的评估表明,Pix2Pose在解决上述问题时明显优于最新方法。我们的结果表明,许多失败案例与训练图像或增强过程未充分覆盖的看不见的姿势有关。因此,未来的工作将研究改善数据增强的策略,以使用阶次真实图像来改善估计性能,从而更广泛地覆盖姿势变化。

论文地址:

https://arxiv.org/abs/1908.07433

源码地址:

https://github.com/kirumang/Pix2Pose

更多论文地址源码地址:关注“图像算法”微信公众号

![]()