大数据-HADOOP高可用、联邦机制- 学习笔记 -BH4

HADOOP高可用、联邦机制

正式引入HA机制是从hadoop2.0开始,之前的版本中没有HA机制

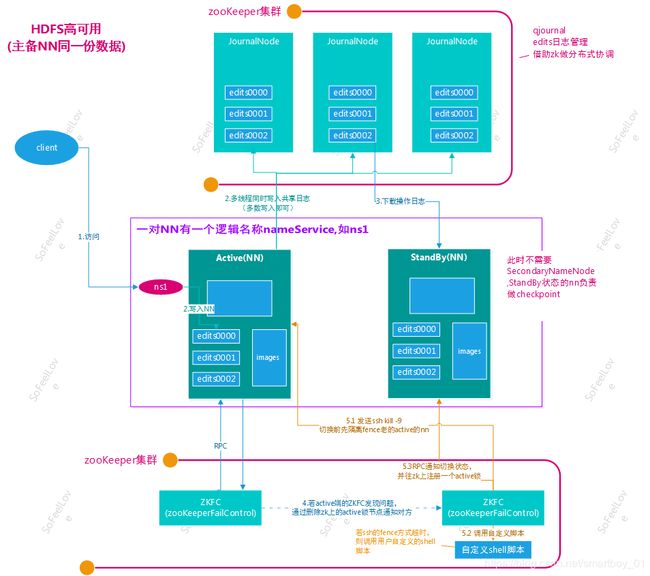

HA的运作机制

-

hadoop-HA集群运作机制介绍

所谓HA,即高可用(7*24小时不中断服务),实现高可用最关键的是消除单点故障

hadoop-ha严格来说应该分成各个组件的HA机制——HDFS的HA、YARN的HA -

HDFS的HA机制详解

通过双namenode消除单点故障,双namenode协调工作的要点:- A、元数据管理方式需要改变:

- 内存中各自保存一份元数据

Edits日志只能有一份,只有Active状态的namenode节点可以做写操作- 两个

namenode都可以读取edits, 共享的edits放在一个共享存储中管理(qjournal和NFS两个主流实现)

- B、需要一个状态管理功能模块

- 实现了一个

zkfailover,常驻在每一个namenode所在的节点 - 每一个

zkfailover负责监控自己所在namenode节点,利用zk进行状态标识 - 当需要进行状态切换时,由

zkfailover来负责切换, 切换时需要防止brain split现象的发生

HDFS-HA图解

HA集群的安装部署

前期准备

- 修改Linux主机名

- 修改IP

- 修改主机名

/etc/sysconfig/networks和IP的映射关系/etc/hosts如果你们公司是租用的服务器或是使用的云主机(如华为用主机、阿里云主机等)

/etc/hosts里面要配置的是内网IP地址和主机名的映射关系 - 关闭防火墙

ssh免登陆- 安装

JDK,配置环境变量等

集群规划

| 主机名 | IP | 安装的软件 | 运行的进程 |

|---|---|---|---|

| mini1 | 192.168.1.200 | jdk、hadoop | NameNode、DFSZKFailoverController(zkfc) |

| mini2 | 192.168.1.201 | jdk、hadoop | NameNode、DFSZKFailoverController(zkfc) |

| mini3 | 192.168.1.202 | jdk、hadoop | ResourceManager |

| mini4 | 192.168.1.203 | jdk、hadoop | ResourceManager |

| mini5 | 192.168.1.205 | jdk、hadoop、zookeeper | DataNode、NodeManager、JournalNode、QuorumPeerMain |

| mini6 | 192.168.1.206 | jdk、hadoop、zookeeper | DataNode、NodeManager、JournalNode、QuorumPeerMain |

| mini7 | 192.168.1.207 | jdk、hadoop、zookeeper | DataNode、NodeManager、JournalNode、QuorumPeerMain |

说明:

- 在

hadoop2.0中通常由两个NameNode组成,一个处于active状态,另一个处于standby状态。Active NameNode对外提供服务,而Standby NameNode则不对外提供服务,仅同步active namenode的状态,以便能够在它失败时快速进行切换。 hadoop2.0官方提供了两种HDFS HA的解决方案,一种是NFS,另一种是QJM。这里我们使用简单的QJM。在该方案中,主备NameNode之间通过一组JournalNode同步元数据信息,一条数据只要成功写入多数JournalNode即认为写入成功。通常配置奇数个JournalNode- 这里还配置了一个

zookeeper集群,用于ZKFC(DFSZKFailoverController)故障转移,当Active NameNode挂掉了,会自动切换Standby NameNode为standby状态 hadoop-2.2.0中依然存在一个问题,就是ResourceManager只有一个,存在单点故障,hadoop-2.6.4解决了这个问题,有两个ResourceManager,一个是Active,一个是Standby,状态由zookeeper进行协调,两个ResourceManager是为了配置yarn的高可用

安装步骤

安装配置zooekeeper集群(在mini5上)

- 解压

tar -zxvf zookeeper-3.4.5.tar.gz -C /home/hadoop/bigdata/ - 修改配置

cd /home/hadoop/bigdata/zookeeper/conf/ cp zoo_sample.cfg zoo.cfg vim zoo.cfg # 修改:dataDir=/home/hadoop/bigdata/data/zkdata # 在最后添加: server.1=mini5:2888:3888 server.2=mini6:2888:3888 server.3=mini7:2888:3888 # 保存退出 # 然后创建一个/data/zkdata文件夹 mkdir /home/hadoop/bigdata/data/zkdata echo 1 > /home/hadoop/bigdata/data/zkdata/myid - 将配置好的

zookeeper拷贝到其他节点(首先分别在mini6、mini7根目录下创建一个hadoop目录:mkdir /hadoop)# cd /home/hadoop/bigdata/ # 可以使用scp -r zookeeper/ mini6:$PWD scp -r /home/hadoop/bigdata/zookeeper/ mini6:/home/hadoop/bigdata/ scp -r /home/hadoop/bigdata/zookeeper/ mini7:/home/hadoop/bigdata/ # 注意:修改mini6、mini7对应/home/hadoop/bigdata/data/zkdata/myid内容 # mini6: echo 2 > /home/hadoop/bigdata/data/zkdata/myid # mini7: echo 3 > /home/hadoop/bigdata/data/zkdata/myid # zkServer.sh start # zkServer.sh status- 添加环境变量

sudo vim /etc/profile export ZK_HOME=/home/hadoop/bigdata/zookeeper export PATH=$PATH:${JAVA_HOME}/bin:${HADOOP_HOME}/bin:${HADOOP_HOME}/sbin:${ZK_HOME}/bin- 分发到

mini6、mini7 source /etc/profile使修改立即生效

安装配置hadoop集群(在mini1上操作)

- 解压

tar -zxvf hadoop-2.6.4.tar.gz -C /home/hadoop/bigdata/ - 配置

HDFS(hadoop2.0所有的配置文件都在$HADOOP_HOME/etc/hadoop目录下)#将hadoop添加到环境变量中 vim /etc/profile export JAVA_HOME=/usr/java/jdk1.7.0_55 export HADOOP_HOME=/hadoop/hadoop-2.6.4 export PATH=$PATH:$JAVA_HOME/bin:$HADOOP_HOME/bin #hadoop2.0的配置文件全部在$HADOOP_HOME/etc/hadoop下 cd /home/hadoop/bigdata/hadoop-2.6.4/etc/hadoop # 修改hadoo-env.sh export JAVA_HOME=/home/hadoop/bigdata/jdk1.7.0_55

修改core-site.xml

<configuration>

<!-- 指定hdfs的nameservice为ns1 -->

<property>

<name>fs.defaultFS</name>

<value>hdfs://bi/</value>

</property>

<!-- 指定hadoop临时目录 -->

<property>

<name>hadoop.tmp.dir</name>

<value>/home/hadoop/bigdata/hdpdata/</value>

</property>

<!-- 指定zookeeper地址 -->

<property>

<name>ha.zookeeper.quorum</name>

<value>mini5:2181,mini6:2181,mini7:2181</value>

</property>

</configuration>

修改hdfs-site.xml

<configuration>

<!--指定hdfs的nameservice为bi(名称空间)下有两个namenode,需要和core-site.xml中的保持一致 -->

<property>

<name>dfs.nameservices</name>

<!--有多个的话,可以配多个bi、spark-->

<value>bi</value>

</property>

<!-- bi下面有两个NameNode,分别是nn1,nn2 -->

<property>

<name>dfs.ha.namenodes.bi</name>

<value>nn1,nn2</value>

</property>

<!-- nn1的RPC通信地址 -->

<property>

<name>dfs.namenode.rpc-address.bi.nn1</name>

<value>mini1:9000</value>

</property>

<!-- nn1的http通信地址 -->

<property>

<name>dfs.namenode.http-address.bi.nn1</name>

<value>mini1:50070</value>

</property>

<!-- nn2的RPC通信地址 -->

<property>

<name>dfs.namenode.rpc-address.bi.nn2</name>

<value>mini2:9000</value>

</property>

<!-- nn2的http通信地址 -->

<property>

<name>dfs.namenode.http-address.bi.nn2</name>

<value>mini2:50070</value>

</property>

<!-- 指定NameNode的edits元数据在JournalNode上的存放位置 -->

<property>

<name>dfs.namenode.shared.edits.dir</name>

<value>qjournal://mini5:8485;mini6:8485;mini7:8485/bi</value>

</property>

<!-- 指定JournalNode在本地磁盘存放数据的位置 -->

<property>

<name>dfs.journalnode.edits.dir</name>

<value>/home/hadoop/journaldata</value>

</property>

<!-- 开启NameNode失败自动切换 -->

<property>

<name>dfs.ha.automatic-failover.enabled</name>

<value>true</value>

</property>

<!-- 配置失败自动切换实现方式 -->

<property>

<name>dfs.client.failover.proxy.provider.bi</name>

<value>org.apache.hadoop.hdfs.server.namenode.ha.ConfiguredFailoverProxyProvider</value>

</property>

<!-- 配置隔离机制方法,多个机制用换行分割,即每个机制暂用一行-->

<property>

<name>dfs.ha.fencing.methods</name>

<value>

sshfence

<!-- shell方式直接调用/bin/true返回真-->

shell(/bin/true)

</value>

</property>

<!-- 使用sshfence隔离机制时需要ssh免登陆 -->

<property>

<name>dfs.ha.fencing.ssh.private-key-files</name>

<value>/home/hadoop/.ssh/id_rsa</value>

</property>

<!-- 配置sshfence隔离机制超时时间 -->

<property>

<name>dfs.ha.fencing.ssh.connect-timeout</name>

<value>30000</value>

</property>

</configuration>

修改mapred-site.xml

<configuration>

<!-- 指定mr框架为yarn方式 -->

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

</configuration>

修改yarn-site.xml

<configuration>

<!-- 开启RM高可用 -->

<property>

<name>yarn.resourcemanager.ha.enabled</name>

<value>true</value>

</property>

<!-- 指定RM的cluster id -->

<property>

<name>yarn.resourcemanager.cluster-id</name>

<value>yrc</value>

</property>

<!-- 指定RM的名字 -->

<property>

<name>yarn.resourcemanager.ha.rm-ids</name>

<value>rm1,rm2</value>

</property>

<!-- 分别指定RM的地址 -->

<property>

<name>yarn.resourcemanager.hostname.rm1</name>

<value>mini3</value>

</property>

<property>

<name>yarn.resourcemanager.hostname.rm2</name>

<value>mini4</value>

</property>

<!-- 指定zk集群地址 -->

<property>

<name>yarn.resourcemanager.zk-address</name>

<value>mini5:2181,mini6:2181,mini7:2181</value>

</property>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

</configuration>

修改slaves

(slaves是指定子节点的位置,因为要在min1上启动HDFS、在mini3,mini4启动yarn,所以mini1上的slaves文件指定的是datanode的位置,mini3,mini4上的slaves文件指定的是nodemanager的位置)

mini5

mini6

mini7

配置免密码登陆

#首先要配置mini1到mini1、mini2、mini3、mini4、mini5、mini6、mini7的免密码登陆

#在mini1上生产一对钥匙

ssh-keygen -t rsa

#将公钥拷贝到其他节点,包括自己

ssh-coyp-id mini1

ssh-coyp-id mini1

ssh-coyp-id mini2

ssh-coyp-id mini3

ssh-coyp-id mini4

ssh-coyp-id mini5

ssh-coyp-id mini6

ssh-coyp-id mini7

#配置mini3到mini4、mini5、mini6、mini7的免密码登陆,启动yarn

#在mini3上生产一对钥匙

ssh-keygen -t rsa

#将公钥拷贝到其他节点

ssh-coyp-id mini4

ssh-coyp-id mini5

ssh-coyp-id mini6

ssh-coyp-id mini7

#注意:两个namenode之间要配置ssh免密码登陆,别忘了配置mini1到mini2的免登陆

#在mini1上生产一对钥匙

ssh-keygen -t rsa

ssh-coyp-id -i mini1

将配置好的hadoop拷贝到其他节点

scp -r /hadoop/ mini2:/

scp -r /hadoop/ mini3:/

scp -r /hadoop/hadoop-2.6.4/ hadoop@mini4:/hadoop/

scp -r /hadoop/hadoop-2.6.4/ hadoop@mini5:/hadoop/

scp -r /hadoop/hadoop-2.6.4/ hadoop@mini6:/hadoop/

scp -r /hadoop/hadoop-2.6.4/ hadoop@mini7:/hadoop/

启动:严格按照下面的步骤

启动zookeeper集群(分别在mini5、mini6、mini7上启动zk)

cd /hadoop/zookeeper/bin/

./zkServer.sh start

#查看状态:一个leader,两个follower

./zkServer.sh status

启动journalnode(分别在mini5、mini6、mini7上执行)

cd /hadoop/hadoop-2.6.4

sbin/hadoop-daemon.sh start journalnode

#运行jps命令检验,mini5、mini6、mini7上多了JournalNode进程

格式化HDFS

#在mini1上执行命令:

hdfs namenode -format

#格式化后会在根据core-site.xml中的hadoop.tmp.dir配置生成个文件,这里我配置的是/hadoop/hadoop-2.6.4/tmp,然后将/hadoop/hadoop-2.6.4/tmp拷贝到mini2的/hadoop/hadoop-2.6.4/下。

scp -r tmp/ mini2:/home/hadoop/bigdata/hadoop-2.6.4/

##也可以这样,建议hdfs namenode -bootstrapStandby

格式化ZKFC(在mini1上执行一次即可)

hdfs zkfc -formatZK

启动HDFS(在mini1上执行)

sbin/start-dfs.sh

启动YARN

在mini3上执行start-yarn.sh,把namenode和resourcemanager分开是因为性能问题,因为他们都要占用大量资源,所以把他们分开了,他们分开了就要分别在不同的机器上启动

sbin/start-yarn.sh

#mini4上yarn若不自己启动:使用yarn-daeman.sh start resourcemanager

#启动两个resourcemanager

配置完毕,验证

浏览器访问

http://mini1:50070

NameNode 'mini1:9000' (active)

http://mini1:50070

NameNode 'mini2:9000' (standby)

验证HDFS HA

# 首先向hdfs上传一个文件

hadoop fs -put /etc/profile /profile

hadoop fs -ls /

# 然后再kill掉active的NameNode

kill -9 <pid of NN>

# 通过浏览器访问:http://192.168.1.202:50070

NameNode 'mini2:9000' (active)

# 这个时候mini2上的NameNode变成了active

# 在执行命令:

hadoop fs -ls /

-rw-r--r-- 3 root supergroup 1926 2014-02-06 15:36 /profile

# 刚才上传的文件依然存在!!!

# 手动启动那个挂掉的NameNode

sbin/hadoop-daemon.sh start namenode

# 通过浏览器访问:http://192.168.1.201:50070

NameNode 'mini1:9000' (standby)

验证YARN

#运行一下hadoop提供的demo中的WordCount程序:

hadoop jar share/hadoop/mapreduce/hadoop-mapreduce-examples-2.4.1.jar wordcount /profile /out

通过以上操作,完成整个配置。

集群运维测试

Datanode动态上下线

Datanode动态上下线很简单,步骤如下:

- 备一台服务器,设置好环境

- 部署

hadoop的安装包,并同步集群配置 - 联网上线,新

datanode会自动加入集群 - 如果是一次增加大批

datanode,还应该做集群负载重均衡

Namenode状态切换管理

使用的命令上hdfs haadmin

可用 hdfs haadmin –help查看所有帮助信息

可以看到,状态操作的命令示例:

-

查看

namenode工作状态

hdfs haadmin -getServiceState nn1 -

将s

tandby状态namenode切换到active

hdfs haadmin –transitionToActive nn1 -

将

active状态namenode切换到standby

hdfs haadmin –transitionToStandby nn2

测试集群工作状态的一些指令 :

bin/hdfs dfsadmin -report #查看hdfs的各节点状态信息

bin/hdfs haadmin -getServiceState nn1 # 获取一个namenode节点的HA状态

sbin/hadoop-daemon.sh start namenode # 单独启动一个namenode进程

./hadoop-daemon.sh start zkfc #单独启动一个zkfc进程

数据块的balance

启动balancer的命令:start-balancer.sh -threshold 8

运行之后,会有Balancer进程出现:

jps

32987 Balancer

上述命令设置了Threshold为8%,那么执行balancer命令的时候,首先统计所有DataNode的磁盘利用率的均值,然后判断如果某一个DataNode的磁盘利用率超过这个均值Threshold,那么将会把这个DataNode的block转移到磁盘利用率低的DataNode,这对于新节点的加入来说十分有用。Threshold的值为1到100之间,不显示的进行参数设置的话,默认是10。

HA下hdfs-api变化

客户端需要nameservice的配置信息,其他不变

/**

* 如果访问的是一个ha机制的集群

* 则一定要把core-site.xml和hdfs-site.xml、yarn-site.xml、mapred-site.xml配置文件放在客户端程序的classpath下

* 以让客户端能够理解hdfs://ns1/中 “ns1”是一个ha机制中的namenode对——nameservice

* 以及知道ns1下具体的namenode通信地址

* @author

*

*/

public class UploadFile {

public static void main(String[] args) throws Exception {

Configuration conf = new Configuration();

conf.set("fs.defaultFS", "hdfs://ns1/");

FileSystem fs = FileSystem.get(new URI("hdfs://ns1/"),conf,"hadoop");

fs.copyFromLocalFile(new Path("g:/eclipse-jee-luna-SR1-linux-gtk.tar.gz"), new Path("hdfs://ns1/"));

fs.close();

}

}

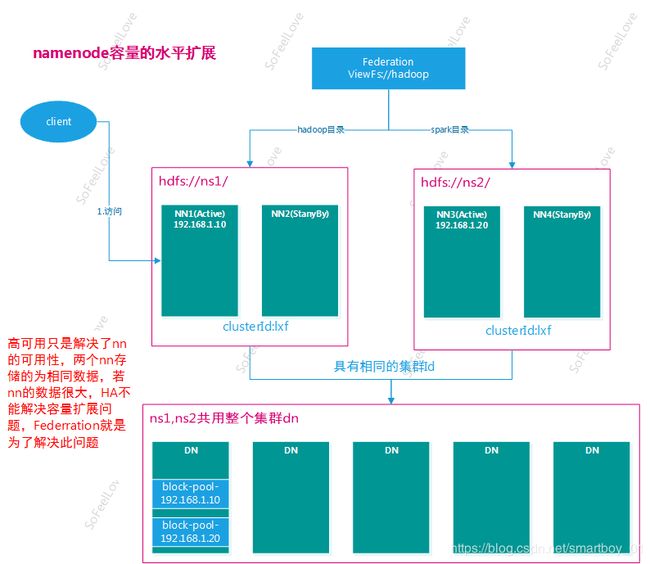

Federation机制

集群规划

| 主机名 | IP | 安装的软件 | 运行的进程 |

|---|---|---|---|

| mini1 | 192.168.1.200 | jdk、hadoop | NameNode、DFSZKFailoverController(zkfc) |

| mini2 | 192.168.1.201 | jdk、hadoop | NameNode、DFSZKFailoverController(zkfc) |

| mini3 | 192.168.1.202 | jdk、hadoop | ResourceManager 、NameNode、Zkfc |

| mini4 | 192.168.1.203 | jdk、hadoop | ResourceManager、NameNode、Zkfc |

| mini5 | 192.168.1.205 | jdk、hadoop、zookeeper | DataNode、NodeManager、JournalNode、QuorumPeerMain |

| mini6 | 192.168.1.206 | jdk、hadoop、zookeeper | DataNode、NodeManager、JournalNode、QuorumPeerMain |

| mini7 | 192.168.1.207 | jdk、hadoop、zookeeper | DataNode、NodeManager、JournalNode、QuorumPeerMain |

- mini1/mini2为一组高可用nn,名称空间为bi

- mini3/mini4为一组高可用nn,名称空间为dt

安装步骤

安装zookeeper集群

如HA集群的安装部署中的安装配置zookeeper集群

修改core-site.xml

<configuration>

<property>

<name>fs.defaultFS</name>

<value>viewfs:///</value>

</property>

<!--指定名称空间bi-->

<property>

<name>fs.viewfs.mounttable.default.link./bi</name>

<value>hdfs://bi/</value>

</property>

<!--指定名称空间dt-->

<property>

<name>fs.viewfs.mounttable.default.link./dt</name>

<value>hdfs://dt/</value>

</property>

<!-- 指定hadoop临时目录 -->

<property>

<name>hadoop.tmp.dir</name>

<value>/home/hadoop/bigdata/hdpdata/</value>

</property>

<!-- 指定zookeeper地址 -->

<property>

<name>ha.zookeeper.quorum</name>

<value>mini5:2181,mini6:2181,mini7:2181</value>

</property>

</configuration>

修改hdfs-site.xml

<configuration>

<!--指定hdfs的nameservice为bi,需要和core-site.xml中的保持一致 -->

<property>

<name>dfs.nameservices</name>

<value>bi,dt</value>

</property>

<!-- bi下面有两个NameNode,分别是nn1,nn2 -->

<property>

<name>dfs.ha.namenodes.bi</name>

<value>nn1,nn2</value>

</property>

<!-- dt下面有两个NameNode,分别是nn3,nn4 -->

<property>

<name>dfs.ha.namenodes.dt</name>

<value>nn3,nn4</value>

</property>

<!-- bi的RPC通信地址 -->

<property>

<name>dfs.namenode.rpc-address.bi.nn1</name>

<value>mini1:9000</value>

</property>

<!-- nn1的http通信地址 -->

<property>

<name>dfs.namenode.http-address.bi.nn1</name>

<value>mini1:50070</value>

</property>

<!-- nn2的RPC通信地址 -->

<property>

<name>dfs.namenode.rpc-address.bi.nn2</name>

<value>mini2:9000</value>

</property>

<!-- nn2的http通信地址 -->

<property>

<name>dfs.namenode.http-address.bi.nn2</name>

<value>mini2:50070</value>

</property>

<!-- dt的RPC通信地址 -->

<property>

<name>dfs.namenode.rpc-address.dt.nn3</name>

<value>mini3:9000</value>

</property>

<!-- nn3的http通信地址 -->

<property>

<name>dfs.namenode.http-address.dt.nn3</name>

<value>mini3:50070</value>

</property>

<!-- nn4的RPC通信地址 -->

<property>

<name>dfs.namenode.rpc-address.dt.nn4</name>

<value>mini4:9000</value>

</property>

<!-- nn4的http通信地址 -->

<property>

<name>dfs.namenode.http-address.dt.nn4</name>

<value>mini4:50070</value>

</property>

<!-- 指定NameNode的edits元数据在JournalNode上的存放位置 -->

<!--一下property项的配置,不能都配 -->

<!-- 在bi名称空间的两个namenode中用如下配置 -->

<property>

<name>dfs.namenode.shared.edits.dir</name>

<value>qjournal://mini5:8485;mini6:8485;mini7:8485/bi</value>

</property>

<!-- 在dt名称空间的两个namenode中,用如下配置-->

<property>

<name>dfs.namenode.shared.edits.dir</name>

<value>qjournal://mini5:8485;mini6:8485;mini7:8485/dt</value>

</property>

<!-- 指定JournalNode在本地磁盘存放数据的位置 -->

<property>

<name>dfs.journalnode.edits.dir</name>

<value>/home/hadoop/bigdata/hdpdata/journaldata</value>

</property>

<!-- 开启NameNode失败自动切换 -->

<property>

<name>dfs.ha.automatic-failover.enabled</name>

<value>true</value>

</property>

<!-- 配置失败自动切换实现方式 -->

<property>

<name>dfs.client.failover.proxy.provider.bi</name>

<value>org.apache.hadoop.hdfs.server.namenode.ha.ConfiguredFailoverProxyProvider</value>

</property>

<property>

<name>dfs.client.failover.proxy.provider.dt</name>

<value>org.apache.hadoop.hdfs.server.namenode.ha.ConfiguredFailoverProxyProvider</value>

</property>

<!-- 配置隔离机制方法,多个机制用换行分割,即每个机制暂用一行-->

<property>

<name>dfs.ha.fencing.methods</name>

<value>

sshfence

shell(/bin/true)

</value>

</property>

<!-- 使用sshfence隔离机制时需要ssh免登陆 -->

<property>

<name>dfs.ha.fencing.ssh.private-key-files</name>

<value>/home/hadoop/.ssh/id_rsa</value>

</property>

<!-- 配置sshfence隔离机制超时时间 -->

<property>

<name>dfs.ha.fencing.ssh.connect-timeout</name>

<value>30000</value>

</property>

</configuration>

修改mapred-site.xml

<configuration>

<!-- 指定mr框架为yarn方式 -->

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

</configuration>

修改yarn-site.xml

<configuration>

<!-- 开启RM高可用 -->

<property>

<name>yarn.resourcemanager.ha.enabled</name>

<value>true</value>

</property>

<!-- 指定RM的cluster id -->

<property>

<name>yarn.resourcemanager.cluster-id</name>

<value>yrc</value>

</property>

<!-- 指定RM的名字 -->

<property>

<name>yarn.resourcemanager.ha.rm-ids</name>

<value>rm1,rm2</value>

</property>

<!-- 分别指定RM的地址 -->

<property>

<name>yarn.resourcemanager.hostname.rm1</name>

<value>mini3</value>

</property>

<property>

<name>yarn.resourcemanager.hostname.rm2</name>

<value>mini4</value>

</property>

<!-- 指定zk集群地址 -->

<property>

<name>yarn.resourcemanager.zk-address</name>

<value>mini5:2181,mini6:2181,mini7:2181</value>

</property>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

</configuration>

修改slaves

(slaves是指定子节点的位置,方便hadoop脚本自动启动子节点(dataNode),因为要在min1上启动HDFS、在mini3,mini4启动yarn,所以mini1上的slaves文件指定的是datanode的位置,mini3,mini4上的slaves文件指定的是nodemanager的位置,bi,dtdataNode共用,所以可以仅在mini1上启动)

mini5

mini6

mini7

将配置好的hadoop拷贝到其他节点

scp -r /hadoop/ mini2:/

scp -r /hadoop/ mini3:/

scp -r /hadoop/hadoop-2.6.4/ hadoop@mini4:/hadoop/

scp -r /hadoop/hadoop-2.6.4/ hadoop@mini5:/hadoop/

scp -r /hadoop/hadoop-2.6.4/ hadoop@mini6:/hadoop/

scp -r /hadoop/hadoop-2.6.4/ hadoop@mini7:/hadoop/

启动:按如下顺序

-

先启动

zookeeper集群,再在5/6/7上启动journalnode

hadoop-daemon.sh start journalnode -

在

bi下nn1上hdfs namenode -format –clusterID itcast hdfs zkfc -formatZK #拷贝元数据目录到standby(nn2) -

在

dt下nn3上hdfs namenode -format –clusterID itcast ###clusterID必须与bi的相同 hdfs zkfc -formatZK # 拷贝元数据目录到standby(nn4) -

在

bi下nn1上sbin/start-dfs.sh -

在

resoucemanager配置的主机上启动yarnsbin/start-yarn.sh

Federation下mr程序运行的staging提交目录问题

<property>

<name>yarn.app.mapreduce.am.staging-dir</name>

<value>/bi/tmp/hadoop-yarn/staging</value>

<description>The staging dir used while submitting jobs.</description>

</property>