- OC语言多界面传值五大方式

Magnetic_h

iosui学习objective-c开发语言

前言在完成暑假仿写项目时,遇到了许多需要用到多界面传值的地方,这篇博客来总结一下比较常用的五种多界面传值的方式。属性传值属性传值一般用前一个界面向后一个界面传值,简单地说就是通过访问后一个视图控制器的属性来为它赋值,通过这个属性来做到从前一个界面向后一个界面传值。首先在后一个界面中定义属性@interfaceBViewController:UIViewController@propertyNSSt

- 《策划经理回忆录之二》

路基雅虎

话说三年变六年,飘了,飘了……眨眼,2013年5月,老吴回到了他的家乡——油城从新开启他的工作幻想症生涯。很庆幸,这是一家很有追求,同时敢于尝试的,且实力不容低调的新星房企——金源置业(前身泰源置业)更值得庆幸的是第一个盘就是油城十路的标杆之一:金源盛世。2013年5月,到2015年11月,两年的陪伴,迎来了一场大爆发。2000个筹,5万/筹,直接回笼1个亿!!!这……让我开始认真审视这座看似五线

- 每日一题——第八十四题

互联网打工人no1

C语言程序设计每日一练c语言

题目:编写函数1、输入10个职工的姓名和职工号2、按照职工由大到小顺序排列,姓名顺序也随之调整3、要求输入一个职工号,用折半查找法找出该职工的姓名#define_CRT_SECURE_NO_WARNINGS#include#include#defineMAX_EMPLOYEES10typedefstruct{intid;charname[50];}Empolyee;voidinputEmploye

- 《人世间》

南询yi

今日分享十点推文,《人世间》有感苏格拉底说:“天地只有三尺,而人在五尺开外,所以人人都要懂得低头。”深以为然。懂得低头,不是认输。而是于人世间找寻温存的成熟,于困境中寻觅柳暗花明的智慧,于争执中展示屈伸自如的格局。正如仰头不是骄傲,是要看见自己的天空;低头也不是认输,而是要看清自己的路。成大事者,不仅要抬头挺胸,还得低头看路。懂得低头,进退有度,不是认输,而是竭尽全力过好这一生。宫崎骏说过:“所有

- DIV+CSS+JavaScript技术制作网页(旅游主题网页设计与制作)云南大理

STU学生网页设计

网页设计期末网页作业html静态网页html5期末大作业网页设计web大作业

️精彩专栏推荐作者主页:【进入主页—获取更多源码】web前端期末大作业:【HTML5网页期末作业(1000套)】程序员有趣的告白方式:【HTML七夕情人节表白网页制作(110套)】文章目录二、网站介绍三、网站效果▶️1.视频演示2.图片演示四、网站代码HTML结构代码CSS样式代码五、更多源码二、网站介绍网站布局方面:计划采用目前主流的、能兼容各大主流浏览器、显示效果稳定的浮动网页布局结构。网站程

- 东南林氏之九牧林候选父系

祖缘树TheYtree

渊源介绍东晋初年晋安林始祖林禄公入闽,传十世隋右丞林茂,由晋安迁居莆田北螺村。又五世而至林万宠,唐开元间任高平太守,生三子:韬、披、昌。韬公之孙攒,唐德宗立双阙以旌表其孝,时号"阙下林家"。昌公字茂吉,乃万宠公第三子,官兵部司马,配宋氏,生一子名萍。萍于唐贞元间明经及第,官沣洲司马(后追赠中宪大夫)。唐太和年间归隐后,迁居仙游游洋,世称“游洋林”;其后裔居游洋后迁移漳州漳浦路下,由路下林第四房平和

- 春季养肝正当时

dxn悟

重温快乐2023年2月4日立春。春天来了,春暖花开,小鸟欢唱,那在这样的季节我们如何养肝呢?自然界的春季对应中医五行的木,人体五脏肝属木,“木曰曲直”,是以树干曲曲直直地向上、向外伸长舒展的生发姿态,来形容具有生长、升发、条达、舒畅等特征的食物及现象。根据中医天人相应的理念,肝五行属木,喜条达,主疏泄,与春天相应,所以春天最适合养肝。养肝首先要少生气,因为肝喜条达恶抑郁。人体五志肝为怒,生气发怒最

- ARM中断处理过程

落汤老狗

嵌入式linux

一、前言本文主要以ARM体系结构下的中断处理为例,讲述整个中断处理过程中的硬件行为和软件动作。具体整个处理过程分成三个步骤来描述:1、第二章描述了中断处理的准备过程2、第三章描述了当发生中的时候,ARM硬件的行为3、第四章描述了ARM的中断进入过程4、第五章描述了ARM的中断退出过程本文涉及的代码来自3.14内核。另外,本文注意描述ARM指令集的内容,有些sourcecode为了简短一些,删除了T

- 怎么做淘客赚钱(2022最新免费淘客盈利的方法)

高省_飞智666600

很多人都不知道什么是淘宝客,今天小编为大家解答一下吧。淘宝客,现在简称淘客,是时下比较流行的一个词语,特质为淘宝店推广商品获取提成的人,这些人没有自己的产品,只是在淘宝里面选择适合自己的产品,在自己比较熟悉的领域推广,把产品卖出去之后,会从淘宝店家那里获得百分之五到百分之五十左右的佣金。淘宝客付出的是什么呢?时间。你需要花时间去选适合自己推广的产品,需要花时间去选自己的推广方法,如果你打算自己做个

- Python爬虫解析工具之xpath使用详解

eqa11

python爬虫开发语言

文章目录Python爬虫解析工具之xpath使用详解一、引言二、环境准备1、插件安装2、依赖库安装三、xpath语法详解1、路径表达式2、通配符3、谓语4、常用函数四、xpath在Python代码中的使用1、文档树的创建2、使用xpath表达式3、获取元素内容和属性五、总结Python爬虫解析工具之xpath使用详解一、引言在Python爬虫开发中,数据提取是一个至关重要的环节。xpath作为一门

- 【穿过丛林看见你】2015年在《诗歌报》读诗日记(一)

快快_ce70

写完《三月的领土》和《手握一把锄头,在翻动诗歌的春天》之后,安稳的睡了个好觉,这是从2013年的五月之后,第一次睡的如此安稳和香甜。其实这对于我来说,也没有什么特别的意义和变故,就像我现在的生活在人人忙着踏青、写生、拍照的春天。在我脚下,没有领土的完整,也没有加剧的破碎。我曾经和现在都是个辛勤的“蜂农”,在这样一个角色里,尽管有人盗走了我所有的蜜,但不妨碍我对甜蜜的不懈追求和喜爱。翻开最近的阅读笔

- 《在战“疫”中成长致敬生活》观后感

梅子刘的刀

(作者:周晨)今天上午,我看了“我是接班人”网络大课堂《在战役中成长致敬生活》。有很多人拿出自己攒下的钱,默默地捐给了武汉,有几千块钱的、有几万块钱的,也有十几万块钱的。连小朋友也把自己的压岁钱捐给了武汉。有名环卫工人把自己五年的积蓄全部捐给了武汉。有名外卖小哥为医护人员买鞋子送吃的。还有已经治愈出院的新型肺炎病人捐了400毫升的血浆。还有位叫大树的叔叔,虽然他没有钱,但是他地里有蔬菜,捐了几大卡

- 【华为OD技术面试真题 - 技术面】- python八股文真题题库(1)

算法大师

华为od面试python

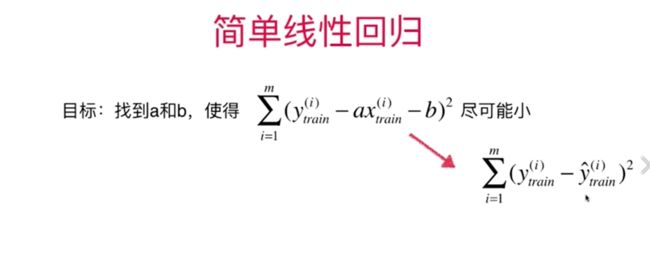

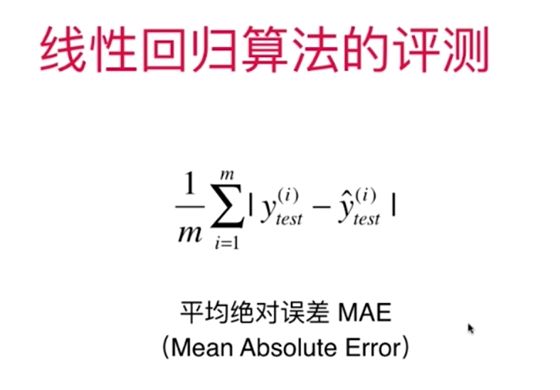

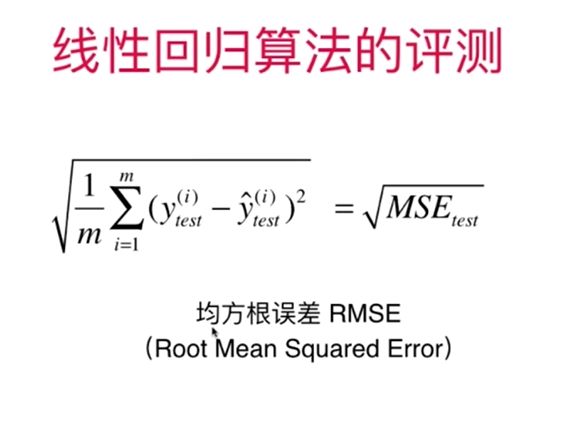

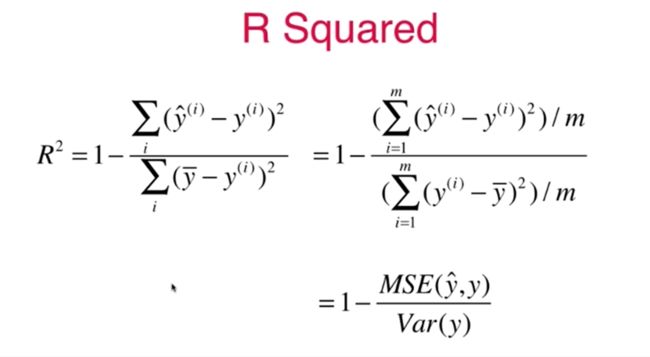

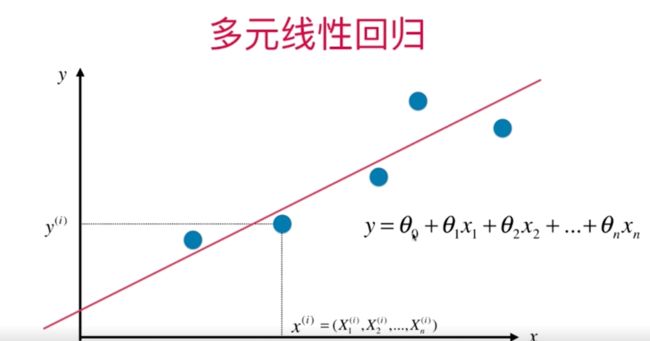

华为OD面试真题精选专栏:华为OD面试真题精选目录:2024华为OD面试手撕代码真题目录以及八股文真题目录文章目录华为OD面试真题精选1.数据预处理流程数据预处理的主要步骤工具和库2.介绍线性回归、逻辑回归模型线性回归(LinearRegression)模型形式:关键点:逻辑回归(LogisticRegression)模型形式:关键点:参数估计与评估:3.python浅拷贝及深拷贝浅拷贝(Shal

- 王东伟,中原焦点秦皇岛站第五期,每日分享第181天

Vivian_c8c7

《解码青春期》让孩子懂得承担责任,学会道歉。英国诗人亚历山大•蒲柏有句名言:凡人难免犯错宽恕方显神性。学会如何请求对方宽恕对于保持健康的关系至关重要。当青少年把事情搞砸的时候,他们需要从关心他们的成年人那里获得帮助。家长的目标是要培养一个能为自己的行为承担责任的青少年,培养一个敢于诚恳的承认错误,愿意真心悔改的青少年。青少年只关注自己如何委屈,而且会竭尽全力为自己的行为辩解。所以,家长得小心地拆除

- 《Python数据分析实战终极指南》

xjt921122

python数据分析开发语言

对于分析师来说,大家在学习Python数据分析的路上,多多少少都遇到过很多大坑**,有关于技能和思维的**:Excel已经没办法处理现有的数据量了,应该学Python吗?找了一大堆Python和Pandas的资料来学习,为什么自己动手就懵了?跟着比赛类公开数据分析案例练了很久,为什么当自己面对数据需求还是只会数据处理而没有分析思路?学了对比、细分、聚类分析,也会用PEST、波特五力这类分析法,为啥

- 渝婧感恩日记第68天

梁渝婧lydia

1.哇!我真是太幸福啦!感恩奇迹感恩训练营毕业典礼,让我能共振到同学们的喜悦和能量,感谢!感谢!感谢!2.哇!我真是太幸福啦!感恩每天早起,运动3公里!这个星期又做到连续三天,不间断!感谢亲爱的渝婧!你真的是非常的棒!加油,继续坚持!感谢!感谢!感谢!3.哇!我真是太幸福啦!感恩曾正波班主任给我们分享的艾宾浩斯的记忆曲线255学习法,让我蠢蠢欲试,感谢!感谢!感谢!4.哇!我真是太幸福啦!感恩胜利

- 209. 长度最小的子数组(滑动窗口法)

清榎

leetcode刷题c++leetcode算法

209.长度最小的子数组题目描述:给定一个含有n个正整数的数组和一个正整数target。找出该数组中满足其和≥target的长度最小的连续子数组[numsl,numsl+1,...,numsr-1,numsr],并返回其长度。如果不存在符合条件的子数组,返回0。解答:法一:直接使用暴力法。两重循环,对每一个元素向后进行寻找,若找到一个子数组≥target,比较其长度和result的大小,如果其长度

- 不要偷走他人的声音

天天_27d6

朱会利焦点讲师班五期洛阳坚持分享第634天《来访者才是主角》2018.08.02今天的中级班课堂上,老师再一次给我们强调了咨询目标的建立过程中,作为咨询师一定要明白,我们只是在协助来访者解决他自身的问题,所以一切以来访者为主,他想解决的问题才是咨询的目标。所以如果在谈话的过程中,出现了我们感觉不是我们想要的答案的时候,我们不是再极力去引导来访者按照我们的思路走,而是觉察自己的预设并且进行调整,谨言

- 上班的路

毛毛虫小姑娘

七点半起床,拉开窗帘,天公不作美今儿是个阴雨天,天灰蒙蒙的,毛毛雨细细密密洒落下来。脑海里的两个小人开始斗争了,一个说:“毛毛雨啦,穿着风衣打着伞穿行在雨中,是一道亮丽的风景,说不定能遇见帅哥呢!”一个说:“不要不要,走到公司衣服鞋子都潮呼呼的,趴在身上很不舒服,外面湿气这么重,对身体不好!”我思索片刻,慢吞吞为自己冲了杯五谷粉,悠哉悠哉喝完去坐班车了。

- 《如不承诺天长地久,怎会相遇细水长流》文/苏暖人

北京大数据苏焕之

《如不承诺天长地久,怎会相遇细水长流》文/苏暖人原创——莫转载粘贴有人选择昙花一现,如大理的花海,有人选择细水长流,如雨夜的浪漫。都说,五分喜欢的人恨不得将他挂在嘴边,十分喜欢的人却只舍得放在心里边了,在爱情眼里,对方说的每一句话都在乎你的感受,TA的眼里也只有你,我想也是这样!说起我的爱情,我也喜欢过一个忧郁的女孩,她喜欢的男孩不喜欢她,于是我成了她倾诉的朋友+备胎,一年来我们互相推荐伤感的歌曲

- 继续《时光音乐会》

湘梅子

平安夜,与我无关。晚饭后陪孙子玩,直到他入睡。回家,看期待的周五《时光音乐会》。今天的庄主是郁可唯。出道十多年,竟然为影视唱了八十多首歌。她的歌声很温暖,有时还很空灵,声音处理很细腻,听起来很享受。原来《知否,知否》是她原唱,当时电视剧很火,歌我也学会了。我也喜欢她的《路过人间》歌友们谈笑风生,我这个观众也不时会心笑着。每次看完这个节目,总是意犹未尽。也只有这个节目,我先生有兴趣跟我一起看完,还总

- 一文掌握python常用的list(列表)操作

程序员neil

pythonpython开发语言

目录一、创建列表1.直接创建列表:2.使用list()构造器3.使用列表推导式4.创建空列表二、访问列表元素1.列表支持通过索引访问元素,索引从0开始:2.还可以使用切片操作访问列表的一部分:三、修改列表元素四、添加元素1.append():在末尾添加元素2.insert():在指定位置插入元素五、删除元素1.del:删除指定位置的元素2.remove():删除指定值的第一个匹配项3.pop():

- Python实现简单的机器学习算法

master_chenchengg

pythonpython办公效率python开发IT

Python实现简单的机器学习算法开篇:初探机器学习的奇妙之旅搭建环境:一切从安装开始必备工具箱第一步:安装Anaconda和JupyterNotebook小贴士:如何配置Python环境变量算法初体验:从零开始的Python机器学习线性回归:让数据说话数据准备:从哪里找数据编码实战:Python实现线性回归模型评估:如何判断模型好坏逻辑回归:从分类开始理论入门:什么是逻辑回归代码实现:使用skl

- 《度五行》生活报报甲午62:不通痛苦,太通也痛苦,要健康快乐,需要通体舒畅。

YangduSam2021

220809壬寅戊申甲午,《度.生活五行》:天干土克水,水生木,木克土。地支寅申冲,寅午合。20220809,周二,兴大上海六班2512天,西交大2013上海班3212天,后TA15332天,度生活619天,今天拜访了一家有趣且当红产业的新创公司AK。AK一开始从事深海新能源储存与供电设备的研发生产制造,2年前开始做移动与家庭储能设备的研发生产制造。觉得有趣是因为这是笔者认知里用科技做降维打击的公

- 生命如花

坦释空

每个人的心中都有一株妙莲花。这是禅家语。禅家总是站在理性的高处,以超越红尘的洒脱来参悟人生和自省生命。那么,凡俗中人呢?生如夏花之绚丽,死如秋叶之静美。这是诗人语。多少人在赞美:姑娘好像花一样!又有多少人在咏歌:花儿与少年。的确,人生如花。花一样的生命,理应自诞生之日起,就一瓣一瓣地绽放她的美丽与清香,使这个原本死寂荒凉的世界五彩缤纷,充满快乐。事实上,人类自诞生起,就一代一代地做着这方面的努力,

- linux 发展史

种树的猴子

内核java操作系统linux大数据

linux发展史说明此前对linux认识模糊一知半解,近期通过学习将自己对于linux的发展总结一下方便大家日后的学习。那Linux是目前一款非常火热的开源操作系统,可是linux是什么时候出现的,又是因为什么样的原因被开发出来的呢。以下将对linux的发展历程进行详细的讲解。目录一、Linux发展背景二、UINIX的诞生三、UNIX的重要分支-BSD的诞生四、Minix的诞生五、GNU与Free

- 随记│开学49日

Silence的小茶馆

开学四十九天哇,今天还是上了一上午课啦,然后有丢丢升温啦(嘿嘿少穿一件哇,不错不错)然后就是好像可以休息了哈(毕竟到周五了)结果周日还是得上课哇。下午还是就休息哈,想着说学习一会儿,但其实是没有想好究竟是要做啥的,所以就还是有在玩诶,主要也是睡了挺久哇(我的过,我的错)所以明天能改正嘛?然后看完综艺第二季啦,就找到第一季看看哇,很不错啦!但还是得学习啊,毕竟作为学生捏,学习还是最重要哒!恩,今天就

- 晓盈的感恩日记第5天

fanny晓

2021年2月5日周五晴天今天是特别的一天,在家里参加完公司线上的职工大会,下午跑到妈妈家去户外劳作了。我感恩家公早上为我准备早餐,今天早读后回笼觉起晚了,又赶上开线上会议,爷爷帮我准备了早餐。我感恩儿子,早晨醒来发现我在早读,还愿意陪伴我早读,一直陪伴我半个小时。我感恩儿子和侄子,下午去户外劳作时来帮助我,一个帮我捡土豆,一个帮忙浇水,很难得的田园生活让孩子们体验到了,一直以来都想让孩子来体验,

- 2020-8-19晨间日记:看过的电影

盐大虾

今天是周三起床:6点半就寝:11点天气:晴心情:正常纪念日:周三任务清单今日完成的任务,最重要的三件事:1.整理写过的文档2.电影《电灯泡》3.这就是街舞第三季第五期改进:早睡早起习惯养成:早睡早起,看书周目标·完成进度两篇文章学习·信息·阅读电影艺术发展史相关教材健康·饮食·锻炼吃了挺多零食,还喝了果粒橙,还是得少吃,多锻炼,不然会慢慢死掉的。人际·家人·朋友淡定交流,不放在心上。工作·思考专心

- 2019考研 | 西交大软件工程

笔者阿蓉

本科背景:某北京211学校电子信息工程互联网开发工作两年录取结果:全日制软件工程学院分数:初试350+复试笔试80+面试85+总排名:100+从五月份开始脱产学习,我主要说一下专业课和复试还有我对非全的一些看法。【数学100+】张宇,张宇,张宇。跟着张宇学习,入门视频刷一遍,真题刷两遍,错题刷三遍。书刷N多遍。从视频开始学习,是最快的学习方法。5-7月份把主要是数学学好,8-9月份开始给自己每个周

- 书其实只有三类

西蜀石兰

类

一个人一辈子其实只读三种书,知识类、技能类、修心类。

知识类的书可以让我们活得更明白。类似十万个为什么这种书籍,我一直不太乐意去读,因为单纯的知识是没法做事的,就像知道地球转速是多少一样(我肯定不知道),这种所谓的知识,除非用到,普通人掌握了完全是一种负担,维基百科能找到的东西,为什么去记忆?

知识类的书,每个方面都涉及些,让自己显得不那么没文化,仅此而已。社会认为的学识渊博,肯定不是站在

- 《TCP/IP 详解,卷1:协议》学习笔记、吐槽及其他

bylijinnan

tcp

《TCP/IP 详解,卷1:协议》是经典,但不适合初学者。它更像是一本字典,适合学过网络的人温习和查阅一些记不清的概念。

这本书,我看的版本是机械工业出版社、范建华等译的。这本书在我看来,翻译得一般,甚至有明显的错误。如果英文熟练,看原版更好:

http://pcvr.nl/tcpip/

下面是我的一些笔记,包括我看书时有疑问的地方,也有对该书的吐槽,有不对的地方请指正:

1.

- Linux—— 静态IP跟动态IP设置

eksliang

linuxIP

一.在终端输入

vi /etc/sysconfig/network-scripts/ifcfg-eth0

静态ip模板如下:

DEVICE="eth0" #网卡名称

BOOTPROTO="static" #静态IP(必须)

HWADDR="00:0C:29:B5:65:CA" #网卡mac地址

IPV6INIT=&q

- Informatica update strategy transformation

18289753290

更新策略组件: 标记你的数据进入target里面做什么操作,一般会和lookup配合使用,有时候用0,1,1代表 forward rejected rows被选中,rejected row是输出在错误文件里,不想看到reject输出,将错误输出到文件,因为有时候数据库原因导致某些column不能update,reject就会output到错误文件里面供查看,在workflow的

- 使用Scrapy时出现虽然队列里有很多Request但是却不下载,造成假死状态

酷的飞上天空

request

现象就是:

程序运行一段时间,可能是几十分钟或者几个小时,然后后台日志里面就不出现下载页面的信息,一直显示上一分钟抓取了0个网页的信息。

刚开始已经猜到是某些下载线程没有正常执行回调方法引起程序一直以为线程还未下载完成,但是水平有限研究源码未果。

经过不停的google终于发现一个有价值的信息,是给twisted提出的一个bugfix

连接地址如下http://twistedmatrix.

- 利用预测分析技术来进行辅助医疗

蓝儿唯美

医疗

2014年,克利夫兰诊所(Cleveland Clinic)想要更有效地控制其手术中心做膝关节置换手术的费用。整个系统每年大约进行2600例此类手术,所以,即使降低很少一部分成本,都可以为诊 所和病人节约大量的资金。为了找到适合的解决方案,供应商将视野投向了预测分析技术和工具,但其分析团队还必须花时间向医生解释基于数据的治疗方案意味着 什么。

克利夫兰诊所负责企业信息管理和分析的医疗

- java 线程(一):基础篇

DavidIsOK

java多线程线程

&nbs

- Tomcat服务器框架之Servlet开发分析

aijuans

servlet

最近使用Tomcat做web服务器,使用Servlet技术做开发时,对Tomcat的框架的简易分析:

疑问: 为什么我们在继承HttpServlet类之后,覆盖doGet(HttpServletRequest req, HttpServetResponse rep)方法后,该方法会自动被Tomcat服务器调用,doGet方法的参数有谁传递过来?怎样传递?

分析之我见: doGet方法的

- 揭秘玖富的粉丝营销之谜 与小米粉丝社区类似

aoyouzi

揭秘玖富的粉丝营销之谜

玖富旗下悟空理财凭借着一个微信公众号上线当天成交量即破百万,第七天成交量单日破了1000万;第23天时,累计成交量超1个亿……至今成立不到10个月,粉丝已经超过500万,月交易额突破10亿,而玖富平台目前的总用户数也已经超过了1800万,位居P2P平台第一位。很多互联网金融创业者慕名前来学习效仿,但是却鲜有成功者,玖富的粉丝营销对外至今仍然是个谜。

近日,一直坚持微信粉丝营销

- Java web的会话跟踪技术

百合不是茶

url会话Cookie会话Seession会话Java Web隐藏域会话

会话跟踪主要是用在用户页面点击不同的页面时,需要用到的技术点

会话:多次请求与响应的过程

1,url地址传递参数,实现页面跟踪技术

格式:传一个参数的

url?名=值

传两个参数的

url?名=值 &名=值

关键代码

- web.xml之Servlet配置

bijian1013

javaweb.xmlServlet配置

定义:

<servlet>

<servlet-name>myservlet</servlet-name>

<servlet-class>com.myapp.controller.MyFirstServlet</servlet-class>

<init-param>

<param-name>

- 利用svnsync实现SVN同步备份

sunjing

SVN同步E000022svnsync镜像

1. 在备份SVN服务器上建立版本库

svnadmin create test

2. 创建pre-revprop-change文件

cd test/hooks/

cp pre-revprop-change.tmpl pre-revprop-change

3. 修改pre-revprop-

- 【分布式数据一致性三】MongoDB读写一致性

bit1129

mongodb

本系列文章结合MongoDB,探讨分布式数据库的数据一致性,这个系列文章包括:

数据一致性概述与CAP

最终一致性(Eventually Consistency)

网络分裂(Network Partition)问题

多数据中心(Multi Data Center)

多个写者(Multi Writer)最终一致性

一致性图表(Consistency Chart)

数据

- Anychart图表组件-Flash图转IMG普通图的方法

白糖_

Flash

问题背景:项目使用的是Anychart图表组件,渲染出来的图是Flash的,往往一个页面有时候会有多个flash图,而需求是让我们做一个打印预览和打印功能,让多个Flash图在一个页面上打印出来。

那么我们打印预览的思路是获取页面的body元素,然后在打印预览界面通过$("body").append(html)的形式显示预览效果,结果让人大跌眼镜:Flash是

- Window 80端口被占用 WHY?

bozch

端口占用window

平时在启动一些可能使用80端口软件的时候,会提示80端口已经被其他软件占用,那一般又会有那些软件占用这些端口呢?

下面坐下总结:

1、web服务器是最经常见的占用80端口的,例如:tomcat , apache , IIS , Php等等;

2

- 编程之美-数组的最大值和最小值-分治法(两种形式)

bylijinnan

编程之美

import java.util.Arrays;

public class MinMaxInArray {

/**

* 编程之美 数组的最大值和最小值 分治法

* 两种形式

*/

public static void main(String[] args) {

int[] t={11,23,34,4,6,7,8,1,2,23};

int[]

- Perl正则表达式

chenbowen00

正则表达式perl

首先我们应该知道 Perl 程序中,正则表达式有三种存在形式,他们分别是:

匹配:m/<regexp>;/ (还可以简写为 /<regexp>;/ ,略去 m)

替换:s/<pattern>;/<replacement>;/

转化:tr/<pattern>;/<replacemnt>;

- [宇宙与天文]行星议会是否具有本行星大气层以外的权力呢?

comsci

举个例子: 地球,地球上由200多个国家选举出一个代表地球联合体的议会,那么现在地球联合体遇到一个问题,地球这颗星球上面的矿产资源快要采掘完了....那么地球议会全体投票,一致通过一项带有法律性质的议案,既批准地球上的国家用各种技术手段在地球以外开采矿产资源和其它资源........

&

- Oracle Profile 使用详解

daizj

oracleprofile资源限制

Oracle Profile 使用详解 转

一、目的:

Oracle系统中的profile可以用来对用户所能使用的数据库资源进行限制,使用Create Profile命令创建一个Profile,用它来实现对数据库资源的限制使用,如果把该profile分配给用户,则该用户所能使用的数据库资源都在该profile的限制之内。

二、条件:

创建profile必须要有CREATE PROFIL

- How HipChat Stores And Indexes Billions Of Messages Using ElasticSearch & Redis

dengkane

elasticsearchLucene

This article is from an interview with Zuhaib Siddique, a production engineer at HipChat, makers of group chat and IM for teams.

HipChat started in an unusual space, one you might not

- 循环小示例,菲波拉契序列,循环解一元二次方程以及switch示例程序

dcj3sjt126com

c算法

# include <stdio.h>

int main(void)

{

int n;

int i;

int f1, f2, f3;

f1 = 1;

f2 = 1;

printf("请输入您需要求的想的序列:");

scanf("%d", &n);

for (i=3; i<n; i

- macbook的lamp环境

dcj3sjt126com

lamp

sudo vim /etc/apache2/httpd.conf

/Library/WebServer/Documents

是默认的网站根目录

重启Mac上的Apache服务

这个命令很早以前就查过了,但是每次使用的时候还是要在网上查:

停止服务:sudo /usr/sbin/apachectl stop

开启服务:s

- java ArrayList源码 下

shuizhaosi888

ArrayList源码

版本 jdk-7u71-windows-x64

JavaSE7 ArrayList源码上:http://flyouwith.iteye.com/blog/2166890

/**

* 从这个列表中移除所有c中包含元素

*/

public boolean removeAll(Collection<?> c) {

- Spring Security(08)——intercept-url配置

234390216

Spring Securityintercept-url访问权限访问协议请求方法

intercept-url配置

目录

1.1 指定拦截的url

1.2 指定访问权限

1.3 指定访问协议

1.4 指定请求方法

1.1 &n

- Linux环境下的oracle安装

jayung

oracle

linux系统下的oracle安装

本文档是Linux(redhat6.x、centos6.x、redhat7.x) 64位操作系统安装Oracle 11g(Oracle Database 11g Enterprise Edition Release 11.2.0.4.0 - 64bit Production),本文基于各种网络资料精心整理而成,共享给有需要的朋友。如有问题可联系:QQ:52-7

- hotspot虚拟机

leichenlei

javaHotSpotjvm虚拟机文档

JVM参数

http://docs.oracle.com/javase/6/docs/technotes/guides/vm/index.html

JVM工具

http://docs.oracle.com/javase/6/docs/technotes/tools/index.html

JVM垃圾回收

http://www.oracle.com

- 读《Node.js项目实践:构建可扩展的Web应用》 ——引编程慢慢变成系统化的“砌砖活”

noaighost

Webnode.js

读《Node.js项目实践:构建可扩展的Web应用》

——引编程慢慢变成系统化的“砌砖活”

眼里的Node.JS

初初接触node是一年前的事,那时候年少不更事。还在纠结什么语言可以编写出牛逼的程序,想必每个码农都会经历这个月经性的问题:微信用什么语言写的?facebook为什么推荐系统这么智能,用什么语言写的?dota2的外挂这么牛逼,用什么语言写的?……用什么语言写这句话,困扰人也是阻碍

- 快速开发Android应用

rensanning

android

Android应用开发过程中,经常会遇到很多常见的类似问题,解决这些问题需要花时间,其实很多问题已经有了成熟的解决方案,比如很多第三方的开源lib,参考

Android Libraries 和

Android UI/UX Libraries。

编码越少,Bug越少,效率自然会高。

但可能由于 根本没听说过、听说过但没用过、特殊原因不能用、自己已经有了解决方案等等原因,这些成熟的解决

- 理解Java中的弱引用

tomcat_oracle

java工作面试

不久之前,我

面试了一些求职Java高级开发工程师的应聘者。我常常会面试他们说,“你能给我介绍一些Java中得弱引用吗?”,如果面试者这样说,“嗯,是不是垃圾回收有关的?”,我就会基本满意了,我并不期待回答是一篇诘究本末的论文描述。 然而事与愿违,我很吃惊的发现,在将近20多个有着平均5年开发经验和高学历背景的应聘者中,居然只有两个人知道弱引用的存在,但是在这两个人之中只有一个人真正了

- 标签输出html标签" target="_blank">关于标签输出html标签

xshdch

jsp

http://back-888888.iteye.com/blog/1181202

关于<c:out value=""/>标签的使用,其中有一个属性是escapeXml默认是true(将html标签当做转移字符,直接显示不在浏览器上面进行解析),当设置escapeXml属性值为false的时候就是不过滤xml,这样就能在浏览器上解析html标签,

&nb