Tensorflow的应用(四)

这一节主要介绍Tensorflow的可视化工具Tensorboard,主要还是通过代码进行解释。

1、绘制神经网络训练的过程图graph,绘制每次迭代后的预测准确率、损失率,及每次迭代的权重的均值、标准差、最大最小值、直方图,偏移量的均值、标准差、最大最小值、直方图。以下是代码,依然是前面识别手写体的数据,代码有注释,就不一一再重复解释了。

import tensorflow as tf

from tensorflow.examples.tutorials.mnist import input_data

#载入数据集

mnist = input_data.read_data_sets("MNIST_data",one_hot=True)

#每个批次的大小

batch_size = 100

#计算一共有多少个批次

n_batch = mnist.train.num_examples // batch_size

#参数概要,tf.summary.scalar的作用主要是存储变量,并赋予变量名,tf.name_scope主要是给表达式命名

def variable_summaries(var):

with tf.name_scope('summaries'):

mean = tf.reduce_mean(var)

tf.summary.scalar('mean', mean)#平均值

with tf.name_scope('stddev'):

stddev = tf.sqrt(tf.reduce_mean(tf.square(var - mean)))

tf.summary.scalar('stddev', stddev)#标准差

tf.summary.scalar('max', tf.reduce_max(var))#最大值

tf.summary.scalar('min', tf.reduce_min(var))#最小值

tf.summary.histogram('histogram', var)#直方图

#命名空间

with tf.name_scope('input'):

#定义两个placeholder

x = tf.placeholder(tf.float32,[None,784],name='x-input')

y = tf.placeholder(tf.float32,[None,10],name='y-input')

with tf.name_scope('layer'):

#创建一个简单的神经网络

with tf.name_scope('wights'):

W = tf.Variable(tf.zeros([784,10]),name='W')

variable_summaries(W)#将w权重传入variable_summaries这个过程,求权重的最大值、最小值、平均值、标准差、画出直方图

with tf.name_scope('biases'):

b = tf.Variable(tf.zeros([10]),name='b')

variable_summaries(b)#将b传入variable_summaries这个过程,求偏移量的最大值、最小值、平均值、标准差、画出直方图

with tf.name_scope('wx_plus_b'):

wx_plus_b = tf.matmul(x,W) + b

with tf.name_scope('softmax'):

prediction = tf.nn.softmax(wx_plus_b)

#二次代价函数

# loss = tf.reduce_mean(tf.square(y-prediction))

with tf.name_scope('loss'):

loss = tf.reduce_mean(tf.nn.softmax_cross_entropy_with_logits(labels=y,logits=prediction))

tf.summary.scalar('loss',loss)

with tf.name_scope('train'):

#使用梯度下降法

train_step = tf.train.GradientDescentOptimizer(0.2).minimize(loss)

#初始化变量

init = tf.global_variables_initializer()

with tf.name_scope('accuracy'):

with tf.name_scope('correct_prediction'):

#结果存放在一个布尔型列表中

correct_prediction = tf.equal(tf.argmax(y,1),tf.argmax(prediction,1))#argmax返回一维张量中最大的值所在的位置

with tf.name_scope('accuracy'):

#求准确率

accuracy = tf.reduce_mean(tf.cast(correct_prediction,tf.float32))

tf.summary.scalar('accuracy',accuracy)

#合并所有的summary

merged = tf.summary.merge_all()

with tf.Session() as sess:

sess.run(init)

writer = tf.summary.FileWriter('F:/tensorflow/logs/',sess.graph)#画出会话执行过程图,并将图存储到F:/tensorflow/logs/

for epoch in range(51):

for batch in range(n_batch):

batch_xs,batch_ys = mnist.train.next_batch(batch_size)

summary,_ = sess.run([merged,train_step],feed_dict={x:batch_xs,y:batch_ys})#执行所有的summary

writer.add_summary(summary,epoch)#每迭代一次就会执行一次summary

acc = sess.run(accuracy,feed_dict={x:mnist.test.images,y:mnist.test.labels})

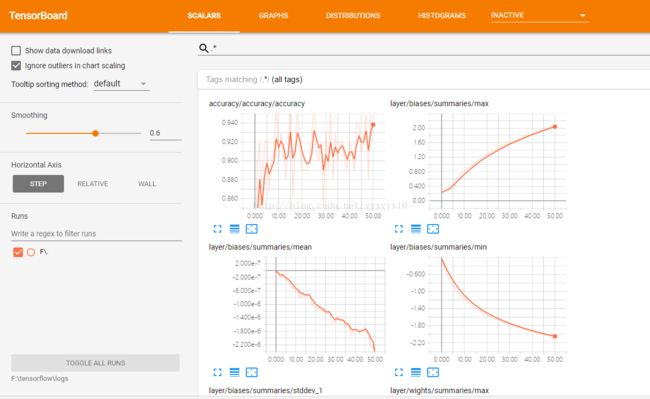

print("Iter " + str(epoch) + ",Testing Accuracy " + str(acc))从图中应该可以比较清晰地看出,左上角是准确率,震荡比较厉害,可以通过调节学习率和迭代次数解决,因为本次只是为了展示tensorboard的使用,所以没进行调参。右上角是每次迭代偏移量最大值的变化,左下角是偏移量均值的变化,右下角是偏移量最小值的变化,其他依次类推,就不一一截图了。

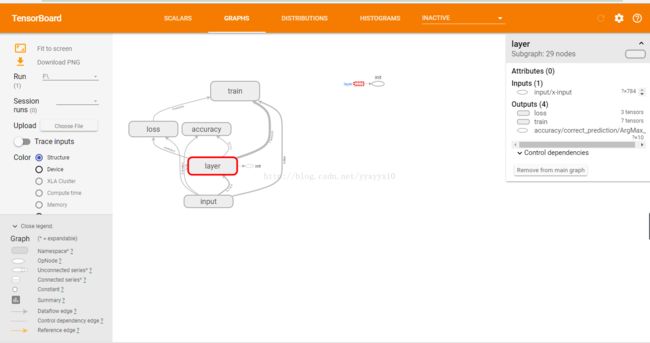

这幅图是算法训练的过程图,点击里面的每个节点都可以展开,左边还有相应符号的说明。

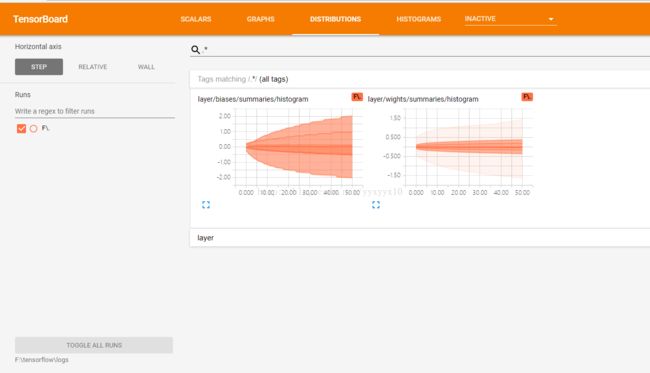

这幅图是权重和偏移量的分布图

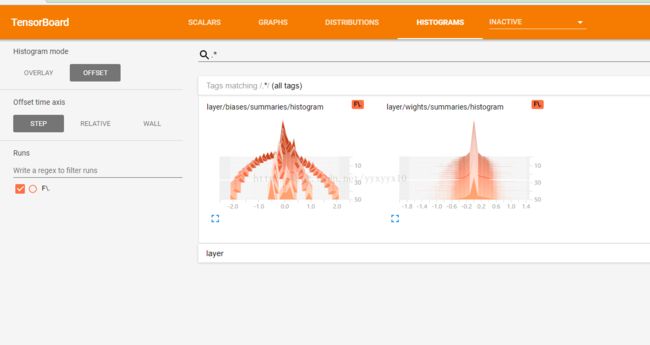

这幅图是偏移量和权重的直方图

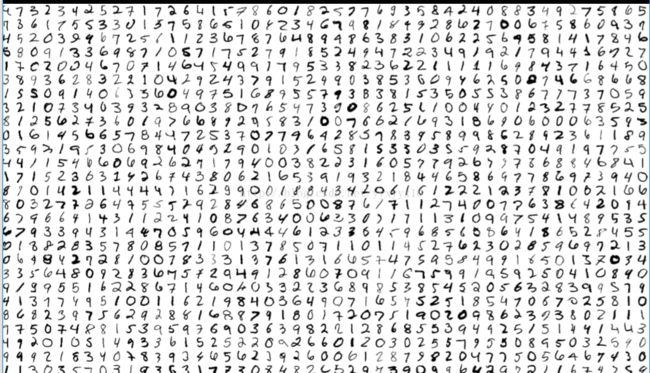

2、这部分主要对一张10000*10000的图进行分类,每个像素就是一个图,这些图都是一些手写数字,0-9的数字,需要进行分类。需要训练和预测的图片样本如下图所示:

这是10000*10000d 图片放大以后截取的部分图片,现在 的任务就是把每个数字进行分割,得到一张张图,应该是有10000*10000张图片,并进行分类。

以下是实现的程序,关于这部分代码有另一篇博客介绍得更加详细一些,这篇:http://blog.csdn.net/aliceyangxi1987/article/details/71079387#reply

import tensorflow as tf

from tensorflow.examples.tutorials.mnist import input_data

from tensorflow.contrib.tensorboard.plugins import projector

#载入数据集

mnist = input_data.read_data_sets("MNIST_data/",one_hot=True)

#运行次数

max_steps = 1001

#图片数量

image_num = 3000

#文件路径

DIR = "F:/tensorflow/"

#定义会话

sess = tf.Session()

#载入图片,前3000张作为测试集

embedding = tf.Variable(tf.stack(mnist.test.images[:image_num]), trainable=False, name='embedding')

#参数概要

def variable_summaries(var):

with tf.name_scope('summaries'):

mean = tf.reduce_mean(var)

tf.summary.scalar('mean', mean)#平均值

with tf.name_scope('stddev'):

stddev = tf.sqrt(tf.reduce_mean(tf.square(var - mean)))

tf.summary.scalar('stddev', stddev)#标准差

tf.summary.scalar('max', tf.reduce_max(var))#最大值

tf.summary.scalar('min', tf.reduce_min(var))#最小值

tf.summary.histogram('histogram', var)#直方图

#命名空间

with tf.name_scope('input'):

#这里的none表示第一个维度可以是任意的长度

x = tf.placeholder(tf.float32,[None,784],name='x-input')

#正确的标签

y = tf.placeholder(tf.float32,[None,10],name='y-input')

#显示图片

with tf.name_scope('input_reshape'):

image_shaped_input = tf.reshape(x, [-1, 28, 28, 1])#-1表示任意维度,图片大小为28*28=784

tf.summary.image('input', image_shaped_input, 10)

with tf.name_scope('layer'):

#创建一个简单神经网络

with tf.name_scope('weights'):

W = tf.Variable(tf.zeros([784,10]),name='W')

variable_summaries(W)

with tf.name_scope('biases'):

b = tf.Variable(tf.zeros([10]),name='b')

variable_summaries(b)

with tf.name_scope('wx_plus_b'):

wx_plus_b = tf.matmul(x,W) + b

with tf.name_scope('softmax'):

prediction = tf.nn.softmax(wx_plus_b)

with tf.name_scope('loss'):

#交叉熵代价函数

loss = tf.reduce_mean(tf.nn.softmax_cross_entropy_with_logits(labels=y,logits=prediction))

tf.summary.scalar('loss',loss)

with tf.name_scope('train'):

#使用梯度下降法

train_step = tf.train.GradientDescentOptimizer(0.5).minimize(loss)

#初始化变量

sess.run(tf.global_variables_initializer())

with tf.name_scope('accuracy'):

with tf.name_scope('correct_prediction'):

#结果存放在一个布尔型列表中

correct_prediction = tf.equal(tf.argmax(y,1),tf.argmax(prediction,1))#argmax返回一维张量中最大的值所在的位置

with tf.name_scope('accuracy'):

#求准确率

accuracy = tf.reduce_mean(tf.cast(correct_prediction,tf.float32))#把correct_prediction变为float32类型

tf.summary.scalar('accuracy',accuracy)

#产生metadata文件,这是固定的形式

if tf.gfile.Exists(DIR + 'projector/projector/metadata.tsv'):

tf.gfile.DeleteRecursively(DIR + 'projector/projector/metadata.tsv')

with open(DIR + 'projector/projector/metadata.tsv', 'w') as f:

labels = sess.run(tf.argmax(mnist.test.labels[:],1))

for i in range(image_num):

f.write(str(labels[i]) + '\n')

#合并所有的summary

merged = tf.summary.merge_all()

projector_writer = tf.summary.FileWriter(DIR + 'projector/projector',sess.graph)

saver = tf.train.Saver()

config = projector.ProjectorConfig()

embed = config.embeddings.add()

embed.tensor_name = embedding.name

embed.metadata_path = DIR + 'projector/projector/metadata.tsv'

embed.sprite.image_path = DIR + 'projector/data/mnist_10k_sprite.png'

embed.sprite.single_image_dim.extend([28,28])

projector.visualize_embeddings(projector_writer,config)

for i in range(max_steps):

#每个批次100个样本

batch_xs,batch_ys = mnist.train.next_batch(100)

run_options = tf.RunOptions(trace_level=tf.RunOptions.FULL_TRACE)

run_metadata = tf.RunMetadata()

summary,_ = sess.run([merged,train_step],feed_dict={x:batch_xs,y:batch_ys},options=run_options,run_metadata=run_metadata)

projector_writer.add_run_metadata(run_metadata, 'step%03d' % i)

projector_writer.add_summary(summary, i)

if i%100 == 0:

acc = sess.run(accuracy,feed_dict={x:mnist.test.images,y:mnist.test.labels})

print ("Iter " + str(i) + ", Testing Accuracy= " + str(acc))

saver.save(sess, DIR + 'projector/projector/a_model.ckpt', g