神经元模型

神经网络是由具有适应性的 简单单元组成的广泛并行互连的网络,它的组织能够模拟生物神经系统对真实 世界物体所作出的交互反应

神经元接受其他神经带权重的信号当,当输入总值超过了一个阈值,就会兴奋,通过激活函数进行信号输出。

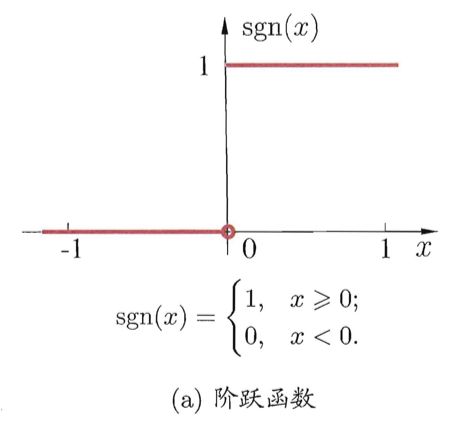

理想激活函数:输出值为简单的0,1

但具有不连续不光滑等性质

Sigmoid 函数:输出值在(0,1) 也称为 挤压函数

将一个神经 网络视为包含了许多参数的数学模型,这 个模型是若干个函数相互代入而得

感知机与多层网络

感知机 由两层神经元组成 接受多个外界信号x后通过包含连权值和阈值的函数递给输出层(阈值逻辑单元

)

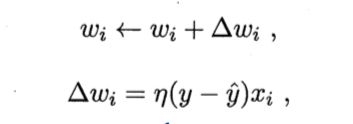

权重的调整方法:

只有一层的功能神经元学习能力有限,所以考虑使用多层功能神经元,隐含层 和输出层神经元都是拥 有激活函数 的功 能神经元.

学习过程即确定连权值和阈值的过程(根据训练数据调整)

误差逆传播算法(一个根据误差来循环调整两层神经元之间参数(算参数调整幅度)的算法)

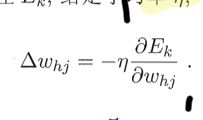

BP 算法基于梯度下降策略, 以目标的负梯度方向 对参数进行调整

BP 算法的目标是要最小化训练集 D 上的累积误差,以此得到参数的调整幅度,最终得到最合适的神经网络。(误差为零的时候计算出的参数的调整幅度即为零)

算法推导过程:

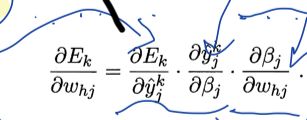

根据连权值对误差的影响一次经过下一层神经元的输入值,输出值,误差和激活函数的性质可推导出要得到参数变动幅度

需依次计算出当前样本的输出,输出层神经元的梯度项(隐层神经元输出值对误差的影响),隐层神经元的梯度项

算法流程:

初始化计算得到输出值及误差,再返回对参数进行循环调整,直到达到某些停止条件。

只需二个包含足够多神经元的隐层,多层前馈网 络就能以任意精度逼近任意复杂度的连续函数,用试错法调整隐层神经元的个数

缓解BP 网络的过拟合两种策略

早停:将数据分成训练集和验证集,训练、集用 来计算梯度、更新连接权和阔值。验证集用来估计误差,若训练集误差降低但 验证集误差升高,则停止训练,同时返回具有最小验证集误差的连接权和阈值.

正则化:其 基本思想是在误差目标函数中增加一个用于描述网络复杂度的部分,例如连接权与阈值的平方和。

参数寻优

E (关于权重和阈值的函数)表示神经网络在训练集上的误差

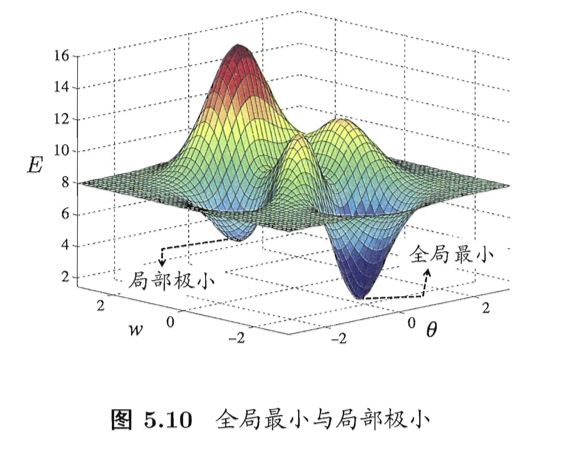

神经网络的训练过程可看作一个参数寻优过程(找到全局最小)

局部最小(极小值)存在一组权重值和阈值使误差比这组权重值和误差大,那这组就是局部最小

就是他们造成的误差不是最大的就可以是局部最小

全局最小(最小值) 在整个参数空间中造成的误差最小

直观地看,局 部极小解是参数空间中的某个点?其邻域点的误差函数值均不小于该点的函数 值;全局最小解则是指参数空间中所有点的误差函数值均不小于该点的误差函 数值

从 某些初始解出发,沿着函数值下降最快的梯度方向进行搜索,直到当前点的梯度为零,则为局部极小,如果误差函数具有多 个局部极小 则不能保证找到的解 是全局最小

"跳出"局部极小的三个方法(大多是 启发式,理论上尚缺乏保障.)

1.以多组参数值确定多个初始值,得到多个局部极小,再确定更接近全局最小的结果。

2.模拟退火在每一步都 以一定的 概率接受 比当前解更差的结果,有助于跳出局部极小。

3.使用随机梯度下 降,即便陷入局 部极小点,计算出 的梯度仍可能不为零, 这样就有机会跳出局部极小继续搜索.

总结

神经元模型是一个模仿生物神经元的由输入值得到输出值的模型

感知机包含输入层,若干隐层和输出层,每层由上一层的输入值通过一个包含权重和阈值的函数得到,并通过激活函数输出

学习过程:根据训练集和输出值的差对权重进行调整

调整算法:BP算法 一个目标为训练集误差最小化的 根据误差(神经元梯度值)来循环调整参数的算法

参数寻优过程 :在参数空间集内沿着误差值下降的梯度方向寻找全局最小