3D/VR/AR简易技术原理介绍

3D/VR/AR简易技术原理介绍

3D模型的生成流程

1.信息的采集

物体图片的采集,同一平面上需要360度全方位角度采集

找到图片的特征点,作为物体的识别参考,如下图所示:

参考算法:SIFT

3.生成点云图

通过特征点计算相机矩阵,再衍生出360度点云图,如下图:

点云图制作中有一个重要的步骤,就是,去除噪点,所谓噪点,就是干扰点,一般也就是与主体点集合较远的点。

开源的图像处理库,OpenCV

4.生成三角网格

通过点云图生成三角网格,即把相邻的点连接起来并且能通过三角计算来得到物体景深。

常用的算法:Delaunay 三角剖分算法 开源工具实现 OpenCV

5.纹理贴图

有了三角网格,即可将图片信息中对应的纹理按照对应比例切割并贴在点云图表面。

整个流程即是:

图片获取特征点>形成点云图>连接三角网格>纹理贴图>生成3D模型

VR核心技术

VR设备简易结构原理图

VR设备主要做三件事情:

1.视野的扩大。

通过凸透镜扩大人眼视觉范围。目前VR眼镜一般将用户的视野范围扩大到90-120度之间。这个视野范围足够让用户产生身临其境的感觉,即创造沉浸式的视觉环境。因为人两只眼重合的最大视角大概在120度左右

2.头部转动的感应。

通过陀螺仪感知用户头部转动。根据用户头部的转动角度和方向,实时刷新画面,从而使用户产生360度的三维空间感。

3.图像立体感的生成。

人的双眼看到同一个物体时,因为角度问题得到的图像是略有不同的,这两个图像经过大脑的信息整合,就会形成一个关于观察物的一个立体信息,包括距离远近和物体的层次。

VR即是利用了人眼这一工作原理,一般情况下,VR设备为用户双眼分别显示一个图形,通过同一物体的不同图像经过用户的大脑处理后产生了立体视觉效果。

做好以上三点就能满足VR核心需求,即沉浸式的用户视觉体验。

除此之外,为了提高用户体验,VR领域还在视觉体验的基础上研究虚拟物品与用户的交互作用,如动作,手势,语言等人类自然的表达方式。目前主要借助于更多的传感器相关外设。

AR技术原理

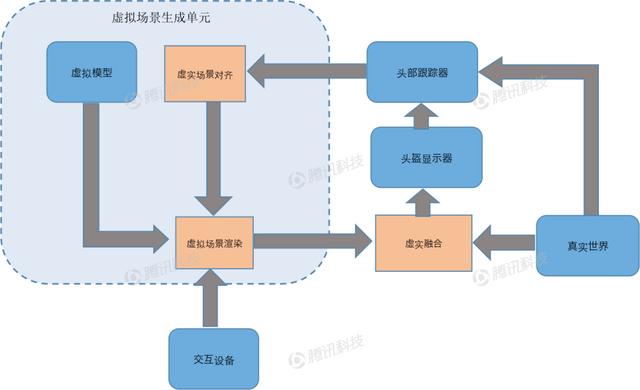

一个典型的AR系统结构:

典型的AR系统结构由虚拟场景生成单元、透射式头盔显示器、头部跟踪设备和交互设备构成。其中虚拟场景生成单元负责虚拟场景的建模、管理、绘制和其它外设的管理;透射式头盔显示器负责显示虚拟和现实融合后的信号;头部跟踪设备跟踪用户视线变化;交互设备用于实现感官信号及环境控制操作信号的输入输出。

AR系统结构主要分四部分:

1.虚拟场景生成模单元

2.用户视觉跟踪单元,一般情况下即头盔显示器

3.虚实融合处理单元,这也是AR/VR核心区别所在。

4.交互设备单元

整个运行流程是:

首先透射式头盔显示器采集真实场景的视频或者图像,传入后台的处理单元对其进行分析和重构,并结合头部跟踪设备的数据来分析虚拟场景和真实场景的相对位置,实现坐标系的对齐并进行虚拟场景的融合计算;交互设备采集外部控制信号,实现对虚实结合场景的交互操作。系统融合后的信息会实时地显示在头盔显示器中,展现在人的视野中。

AR的关键技术为两方面:

1.对显示场景的理解和重构,即解决辨别输入的图像“是什么”的问题。

对目标物的识别,分为两个方向:

方向一是按照类别识别。即从分类和检测的角度,先通过机器学习算法训练得到某一类对象的一般性特征,生成数据模型。如车辆,人脸,生物等。适用于不强调未知的应用场景。

方向二是从具体图像特征出发,将具体图像的具体详细特征点解析存储,在实际应用中,通过特征点找到最相关的图片。适用于特定环境的精确识别。

2.跟踪定位问题,即解决“在哪里”的问题,也就是要对场景结构进行分析,实现跟踪定位和场景重构。

跟踪定位方法分为基于硬件和基于视觉算法两大类:

基于硬件,是通过使用特殊的测量仪器,如电磁跟踪器,惯性跟踪器,光学跟踪器等实现三维跟踪和定位。精度取决于硬件性能,算法扩展较差,成本较高。

基于视觉算法则依赖于优话算法来解决跟踪精度问题。也就是分析运算输入信息源的数据,是一种非接触式的,低成本的解决方法,但其精确度高低依赖于输入源本身尺寸,光照,角度的影响。

为了弥补不同跟踪技术的缺点,许多研究者采用硬件和视觉混合跟踪的方法来取长补短,以满足增强现实系统高精度跟踪定位的要求。