图神经网络前沿工作:结合域适应的跨网络嵌入

![]()

©PaperWeekly · 作者|沈笑

单位|香港理工大学博士后研究员

研究方向|图神经网络、网络迁移学习等

近些年来,域适应和迁移学习已经广泛应用于计算机视觉(CV)和自然语言处理(NLP)领域。然而,在网络结构数据上运用域适应算法以解决跨网络预测问题并未受到广泛关注。

一方面,传统的域适应算法假设域内实体是独立同分布的(iid),它们无法有效捕获网络内不同实体间错综复杂的关系。另一方面,当前的网络嵌入(图神经网络)算法大多是基于单一网络的,它们不可学到具有网络可迁移性的低维特征表示。因此,当前的域适应算法和当前的网络嵌入(图神经网络)算法都不可直接解决跨网络预测问题。

接下来,本文将介绍两个近期的新工作,通过有效结合域适应和深度网络嵌入(图神经网络)以学到具有网络可迁移性的低维特征表示以有效解决跨网络节点分类问题。这两个工作分别发表于 IEEE Transactions on Neural Networks and Learning Systems 期刊和 AAAI 2020 会议。

![]()

跨网络节点分类(Cross-network Node Classification)

在跨网络节点分类问题中,我们有一个具有丰富节点标签的源网络(source network)和一个缺乏节点标签的目标网络(target network),我们需要迁移从丰富标签的源网络中学到的知识以帮助目标网络进行节点分类。在每个网络中,每个节点有关联的网络拓扑结构(network connection)信息、节点属性(node attribute)信息和节点标签(node label)信息。

其中,源网络和目标网络共享相同类别的节点属性和相同类别的节点标签。但是,源网络和目标网络具有不同的数据分布,这些分布差异(distribution discrepancy)会阻碍将源网络中学到的模型直接运用到目标网络上。

为了有效解决跨网络节点分类问题,以下的两个工作提出了跨网络嵌入(Cross-network Embedding)算法,通过结合深度网络嵌入和域适应以学习具有网络可迁移性的低维特征表示。

一方面,通过深度网络嵌入(图神经网络)学习具有类别可鉴别性(label-discriminative)的低维特征以保留原始网络的拓扑结构、节点属性和节点标签信息。另一方面,通过域适应算法减少源网络和目标网络间的分布差异以学到具有网络不变性(network-invariant)的低维特征表示。

接下来,我们将分别简介两个跨网络嵌入工作,具体细节大家可以参照原文。

![]()

CDNE

论文标题:Network Together: Node Classification via Cross-Network Deep Network Embedding

论文链接:https://ieeexplore.ieee.org/document/9108549

这个工作近期发表于 IEEE Transactions on Neural Networks and Learning Systems 期刊。在这篇论文中,作者提出了一个跨网络深度嵌入算法 Cross-network Deep Network Embedding (CDNE),通过结合域适应和深度网络嵌入以学到具有类别可鉴别性和网络不变性的低维节点特征表示。

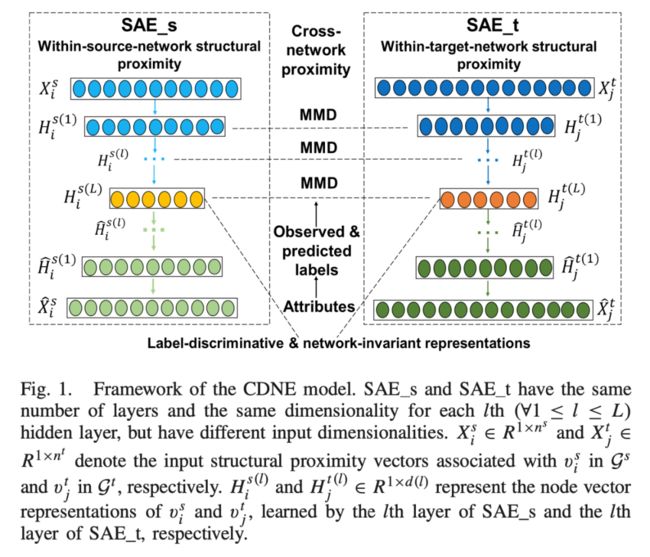

CDNE 的模型框架如 Fig.1 所示,它采用两个 stacked autoencoder (SAE),即 SAE_s 和 SAE_t,来分别重构源网络和目标网络各自的 PPMI (Positive pointwise mutual information) matrix,从而分别为源网络和目标网络学习各自的低维特征表示以保留单一网络内的拓扑结构特性(with-network proximities)。

另一方面,它使用节点属性和节点标签信息来捕获源网络和目标网络间的相似性(cross-network proximities)。具体地说,基于源网络的节点属性和节点标签信息,它训练了一个 Logistic regression 分类器,然后利用这个分类器为目标网络的无标签的节点推测模糊标签(fuzzy label)。

基于源网络的已知标签和目标网络的模糊标签,通过最小化 Conditional Maximum Mean Discrepancy (Conditional MMD) 来减少不同网络同一类别的节点的低维特征表示差异:

计算了目标网络中属于类别 c 的节点的均值特征表示, 计算了源网络中属于类别 c 的节点的均值特征表示。通过最小化 Conditional MMD, 来自不同网络的同一类别的节点将具有相似的低维特征表示,从而有益于跨网络节点分类任务。

对于 CDNE 的训练,该算法首先采用 stochastic gradient descent (SGD) 来优化 SAE_s 的 loss function。当 SAE_s 达到 maximum training iteration 后,SAE_s 将被固定,然后 SAE_s 学到的低维特征表示将作为 SAE_t 的部分 input 来继续优化 SAE_t,直到将 SAE_t 的低维特征表示可对齐到 SAE_s 的低维特征表示。

![]()

ACDNE

论文标题:Adversarial Deep Network Embedding for Cross-network Node Classification

论文链接:https://www.aaai.org/Papers/AAAI/2020GB/AAAI-ShenX.1703.pdf

这个工作发表于 AAAI 2020 会议。该论文提出了对抗跨网络深度嵌入算法 adversarial cross-network deep network embedding (ACDNE) model,通过结合对抗域适应和深度网络嵌入(图神经网络)以学习具有类别可鉴别性和网络不变性的低维节点特征表示。

与 CDNE 相似的是,ACDNE 同样结合了域适应和深度网络嵌入两个模块。不同的是,CDNE 采用的是基于 MMD 的域适应方法,而 ACDNE 是采用了更先进的对抗域适应(adversarial domain adaptation)方法;此外,CDNE 和 ACDNE 的深度网络嵌入模块也大不相同。

下图展示了 ACDNE 的基础框架模型,它主要由 3 大部分构成,即深度网络嵌入模块(deep network embedding)、节点分类器(node classifier)、和域鉴别器(domain discriminator)。

在深度网络嵌入模块中,它采用了两个feature extractor(FE),FE1 和 FE2 来学习低维特征表示。其中,FE1 使用每个节点各自的节点属性作为 input 来学习 latent node attribute representation,而 FE2 使用每个节点的邻接节点(neighbors)加权平均后的节点属性作为 input 来学习 latent neighbor attribute representation。

接下来,通过 concatenate 由 FE1 学到的 latent node attribute representation 和由 FE2 学到的 latent neighbor attribute representation 作为 concatenation layer(一个全连接层)的 input,来学习最终的低维特征表示,从而同时保留网络拓扑结构特性和节点属性。对于深度网络嵌入模块,源网络和目标网络使用了共享的可训练参数。

一方面,由深度网络嵌入模块学到的低维特征表示将作为 node classifier 的 input,运用源网络的已知标签来优化 cross-entropy 目标函数,从而学到具有类别可鉴别性的低维特征表示。

另一方面,由深度网络嵌入模块学到的低维特征表示还会作为 domain discriminator 的 input。Domain discriminator 和 deep network embedding 将进行对抗训练,一方面,domain discriminator 需要准确区分一个节点是来自源网络还是目标网络;另一方面,deep network embedding 需要学到网络不可区分的特征表示以欺骗 domain discriminator。当对抗训练达到平衡后,deep network embedding 将可输出具有网络不变性的低维特征表示。

![]()

实验结果

CDNE 和 ACDNE 在两个 Blog networks 进行了 2 组跨网络节点分类任务测试和三个 citation networks 上进行了 6 组跨网络节点分类任务测试。

CDNE 和 ACDNE 与多个 state-of-the-art 网络嵌入、图神经网络、域适应算法进行了丰富的实验对比。得出的主要结论如下:

1. 节点属性比网络拓扑结构更具有网络通用性(more generalized across networks)。因此,单纯考虑网络拓扑结构的早期网络嵌入算法(如 DeepWalk、DNE-APP)不适用于跨网络节点分类问题。共同考虑网络拓扑结构、节点属性和节点标签信息的图神经网络更适用于解决跨网络节点分类问题。

2. 单独的域适应算法(如 TCA、MMD、DANN)由于缺乏考虑复杂的网络拓扑结构,无法取得良好的跨网络节点分类效果。

3. 基于单一网络的网络嵌入、图神经网络算法(如 ANRL、LANE、SEANO、GCN、GraphSAGE)由于缺乏考虑不同网络间的分布差异,也无法取得良好的跨网络节点分类效果。

4. CDNE 和 ACDNE 有效结合了深度网络嵌入和域适应算法,因此在所有跨网络节点分类任务上大幅度领先了 baselines 算法。

5. ACDNE 比 CDNE 取得了更好的结果,主要原因是: 一方面,对抗域适应比 MMD 域适应更有效地减少域间分布差异;另一方面,ACDNE 的深度网络嵌入模块比 CDNE 的深度网络嵌入模块更好地捕获网络结构特性和节点属性。

![]()

总结

本文介绍了两个跨网络嵌入算法——CDNE 和 ACDNE,它们通过结合深度网络嵌入(图神经网络)和域适应以学习具有类别可鉴别性又具有网络不变性的低维特征表示以有效解决跨网络节点分类问题。

更多阅读

![]()

#投 稿 通 道#

让你的论文被更多人看到

如何才能让更多的优质内容以更短路径到达读者群体,缩短读者寻找优质内容的成本呢?答案就是:你不认识的人。

总有一些你不认识的人,知道你想知道的东西。PaperWeekly 或许可以成为一座桥梁,促使不同背景、不同方向的学者和学术灵感相互碰撞,迸发出更多的可能性。

PaperWeekly 鼓励高校实验室或个人,在我们的平台上分享各类优质内容,可以是最新论文解读,也可以是学习心得或技术干货。我们的目的只有一个,让知识真正流动起来。

???? 来稿标准:

• 稿件确系个人原创作品,来稿需注明作者个人信息(姓名+学校/工作单位+学历/职位+研究方向)

• 如果文章并非首发,请在投稿时提醒并附上所有已发布链接

• PaperWeekly 默认每篇文章都是首发,均会添加“原创”标志

???? 投稿邮箱:

• 投稿邮箱:[email protected]

• 所有文章配图,请单独在附件中发送

• 请留下即时联系方式(微信或手机),以便我们在编辑发布时和作者沟通

????

现在,在「知乎」也能找到我们了

进入知乎首页搜索「PaperWeekly」

点击「关注」订阅我们的专栏吧

关于PaperWeekly

PaperWeekly 是一个推荐、解读、讨论、报道人工智能前沿论文成果的学术平台。如果你研究或从事 AI 领域,欢迎在公众号后台点击「交流群」,小助手将把你带入 PaperWeekly 的交流群里。

![]()