Spark-SparkSql中利用ConfigFactory获取配置文件详解

版权声明:本文为博主原创文章,未经博主允许不得转载!!

欢迎访问:https://blog.csdn.net/qq_21439395/article/details/80678524

交流QQ: 824203453

1. 获取配置文件中的配置

1.1. 简述

在实际的开发中,工程中的一些配置会放在classpath下的配置文件中,然后在程序代码中,会对配置文件进行加载使用。

这里提供两种实现方式:直接利用类加载器;利用Typesafe的Config库(ConfigFactory)实现。

1.2. 实现方式一:利用类加载器获取到指定的配置文件

// 通过类的加载器获取到对应的配置文件

val stream = getClass.getClassLoader.getResourceAsStream("application.conf")

val prop = new Properties()

prop.load(stream)

val sqlUrl = prop.getProperty("db.url")

println(sqlUrl)1.3. 实现方式二:利用Typesafe的Config库。

Typesafe的Config库,是代码精简、功能灵活、API友好。它也是Akka的配置管理库。

这里利用config库下的ConfigFactory类来加载配置文件。

1.3.1. 必须导入jar包

(下面两个jar包任选其一即可):

直接导入config的jar包

com.typesafe

config

1.3.0

com.typesafe.akka

akka-actor_2.11

2.4.17

两个jar包的区别:

第一个jar包是第二个jar包的依赖jar包。

1.3.2. 测试代码实现:

ConfigFactory.load() 默认加载classpath下的配置文件:

加载顺序为:application.conf ---> application.sjon ----> application.properties

// 方式二:通过ConfigFactory来获取到配置文件

// 默认加载配置文件的顺序是:application.conf --> application.json --> application.properties

val config = ConfigFactory.load()

val user = config.getString("db.user")

println(user)1.3.3. 各种配置文件实现

maven工程中,配置文件的位置在resources资源目录下:

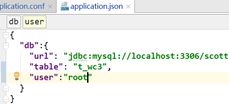

其中,application.conf中的配置文件格式如下:

application.json配置文件的格式如下:

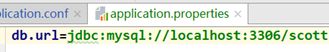

application.properties配置文件的格式如下:

1.4. 综合案例:

通过读取配置文件中的mysql配置,把数据写入到mysql中:

val session = SparkSession.builder().getOrCreate()

import session.implicits._

val data: Dataset[String] = session.createDataset(List("zs 18 90"))

// 指定schema信息

val df = data.map(_.split(" ")).map(t => (t(0), t(1).toInt, t(2).toInt))

.toDF("name", "age", "fv")

// 获取mysql的配置参数

val url = config.getString("db.url")

val table = config.getString("db.table")

val conn = new Properties()

conn.setProperty("user", config.getString("db.user"))

conn.setProperty("password", config.getString("db.password"))

conn.setProperty("driver", config.getString("db.driver"))

// 写入数据到指定的数据库

df.write.mode(SaveMode.Append).jdbc(url, table, conn)1.5. 提交spark任务到集群注意事项

当把程序提交到集群运行时,需要注意,添加mysql和configFactory所在的jar包:

| spark-submit --master spark://hdp-01:7077 --jars config-1.3.0.jar,mysql-connector-java-5.1.38.jar --class cn.huge.spark.ConfigFactoryDemo sparksql-huge-1.0-SNAPSHOT.jar |

提交任务的基本套路:

spark-submit –master 集群模式 --jars 依赖jar包 --class 主类 maven工程jar包

版权声明:本文为博主原创文章,未经博主允许不得转载!!

欢迎访问:https://blog.csdn.net/qq_21439395/article/details/80678524

交流QQ: 824203453