最近看了mapreduce的InputFormat总结一下!!!

看一下InputFormat的用法

Public abstract class InputFormat

public abstract List

public abstract RecordReader

}

客户端调用getSplit把输入文件分片,计算分片值,提交给JobTracker;

TaskTracker调用CreatRecordReader为这个分片返回一个读取记录的类;

看一下mapper的run方法

public void run(Context context) throws IOException, InterruptedException {

setup(context);

while (context.nextKeyValue()) {

map(context.getCurrentKey(), context.getCurrentValue(), context);

}

cleanup(context);

}

首先是setup 初始化的一些工作,然后是while循环把split的每一个k,v送到map函数中,context中的方法其实就是调用了RecordReader中相应的方法。如果想对于分片中的记录自己定义,只需要写一个RecordReader就行。

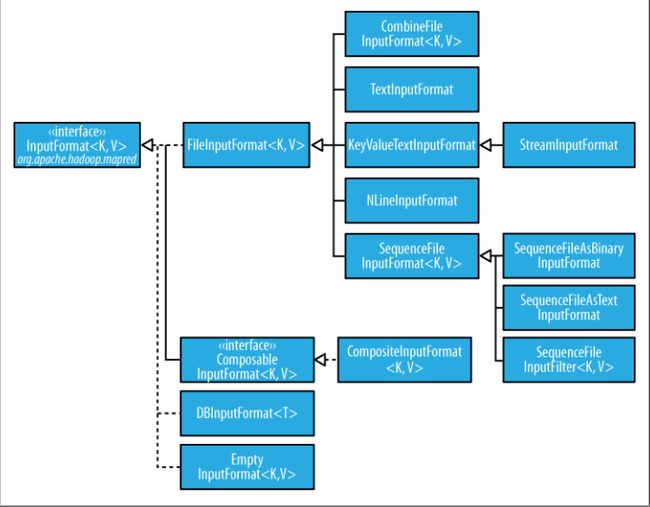

首mapreduce的输入格式很多,最基本的是File,还有数据库等!

看一下这个图

FileInputFormat

FileInputFormat是所有处理文件输入的父类

它有一个方法 addInputPath(Job job,Path path)用于设置输入路径。

这个方法还有其他的重载版本!

mapreduce 最常处理的是文本文件!处理文本用的是TextInputFormat

TextInputFormat是InputFormat默认的处理方式,即key是每一行相对于整个文件的偏移量封装在LongWritable中,value是该行的文本内容封装在Text中。

在TextInputFormat中的value一般没什么用,而在一些文件中,文件本身的内容就是一些key value ,例如 mapreduce的输出文件,这时候我们可以用KeyValueTextInputFormat来把文件分开 默认的把Tab作为分隔符,可以用mapreduce.input.keyvaluelinerecordreader.key.value.separator来设置!

NLineInputFormat

如果你不想只把一行作为一条记录,你可以用NLineInputFormat,通过mapduce.input.lineinputformat.linespermap来设置N 这样一条记录中就会用N行!

二进制文件

SequenceFileInputFormat 可以用来处理SequenceFile

数据库

可应用JDBC

推荐使用Sqoop