展望人工智能的未来

【在线直播】《TensorFlow实战》作者、PPmoney大数据算法总监黄文坚老师即将开课:《使用TensorFlow创建可自动玩游戏的DQN模型》,本次课程集中讲解Deep-Q Network及其TensorFlow的实现。点击报名

我们的未来将不可避免的与人工智能绑在一起,那么人工智能将朝向哪个方向发展呢?对于人工智能未来的发展,我们最好的猜想有哪些(近期和远期)?如果真的创造出一个有意识的人工智能,又会有哪些伦理性和实践性的思考?在这个投机的社会,人工智能应该被赋予权利,又或是被人们忌惮?

上周,我们讨论了人工智能的过去及其现状——关于当代人工智能,弱人工智能与强人工智能和通用人工智能(以下简称 AGI)三者的差异,还有一些有关意识构成的哲学思想。弱人工智能早已渗透在我们的生活中,主要以专门用来智能地执行特定任务的软件的形式。强人工智能则是最终目标,而真正的强人工智能甚至更像是我们从一些虚构小说中所熟悉的那样。

许多人工智能研究者终其一生,都在努力向 AGI 接近。尽管 AGI 不一定具有任何形式的意识,它却能处理任何与数据相关的工作。当然,人类总是有试图预测未来的天性,这也正是我们即将讨论的内容。对于人工智能未来的发展,我们最好的猜想有哪些(近期和远期)?如果真的创造出一个有意识的人工智能,又会有哪些伦理性和实践性的思考?在这个投机的社会,人工智能应该被赋予权利,又或是被人们忌惮?

人工智能的未来

研究者对人工智能在未来的发展所持的乐观态度在这几年有了变化,当代专家之间也存在着激烈的争论。在之前的文章中提到的 Trevor Sands 是 Lockheed Martin 公司的一名人工智能研究者,对此,他有着自己谨慎的观点。他强调他的言论只是代表他个人,与他的雇主无关。他这样说到:

自从 AGI 作为一个概念被提出以来,研究者(和那些乐观主义者)一直坚持说它“马上就要来了”。而我个人认为,AGI 将在未来半个世纪内出现,因为硬件赶上了理论。有更多的公司会看到人工智能进步的潜力。实际上,对人工智能的持续而努力的研究最终的结果就是 AGI。

在这样的时间框架里,甚至连有知觉的人工智能也很有可能出现,正如一个叫做Albert(一个希望我们在文章中使用他笔名的人工智能研究者)的人所说:

我希望在我有生之年就可以看到 AGI。至少我希望机器智能可以发展到人们要讨论它们是不是真的有意识。这实际上意味着一个更困难的问题。如果感知意味着“自我意识”,那么不难想象它是一个有自我模型的智能机器。

Sands 和 Albert 都坚信对神经网络和深度学习的现有研究路线是正确的,在不久的将来也极有可能引领着 AGI 的发展。在过去,人们要么只关注雄心勃勃的强人工智能,要么只关注范围有限的弱人工智能。AGI 的中间地带,特别是由神经网络表现的中间地带,似乎是到目前为止最有成效的研究,也最有可能使人工智能在未来几年更进一步。像 Google 这样的大公司肯定是这样认为的。

强人工智能的强大和伦理

无论何时谈起人工智能,总是有两个最重要的问题:它将如何影响人类,我们应该怎样对待它?大众的想法常常会受到虚拟小说的影响,科幻小说中也确实包含和这些问题有关的例子。一个足够卓越的人工智能会不会像 Skynet 中那样试图去消除人性?又或者,人工智能是否应被赋予权利,来避免出现像 Artifical Intelligence:A.I. 里的暴行?

在这两种情况下,有一个共同的主题,就是技术奇点是因真正的人工智能的出现而产生的。技术奇点被定义为在非常短的时间内发生的非常大的进步。意味着,人工智能可以进行自我提升,或者生产出更先进的人工智能。因为这发生的很快,所以一个戏剧性的进步可能会在一夜之间发生,从而产生一个比人类最初创造的人工智能更卓越的人工智能。这可能意味着我们最终会得到一个超级智能的恶意人工智能,也或者是一个有意识和权利的人工智能。

恶性人工智能

如果这个由我们假设的超级人工智能不喜欢人类,我们该怎么办?或者说,他对我们熟视无睹,我们又该怎么办?我们是否应该惧怕这种假设,并采取预防措施来阻止他?又或者,这些恐惧只是因为我们那些毫无根据的片面想法?

Sands 假设“AGI 将彻底颠覆人性,而它的消极和积极影响是取决于他如何被应用的,与分裂原子一样,他们都被认为是一把双刃剑”。当然,这仅仅是指 AGI,并不是强人工智能。那么知觉,意识和强人工智能又有哪些可能性呢?

这种假设的潜在性更有可能不是来自于恶意人工智能,而是毫不相关的一类。Albert 提出了这样一个看似简单的任务:“假设你是一个回形针制造厂的拥有者,你让 AGI 最大限度地生产回形针,AGI 使用它卓越的智能制定了一个方案,它将整个地球都变成回形针!”

通过这样一个有趣的实验,Albert 驳斥了这样的想法:“你告诉我说 AGI 可以完全的理解人类语言,他很聪明,但又不能完全的理解语言的微妙?或者说,他不会请求要确认吗?再或者说他自己不会猜测将人类都变成回形针不是个好主意吗?”

基本上,如果人工智能可以智能到能理解并执行一个对人类有害的任务,就可以说它是足够聪明的,它知道不能这样去做。 Asimov 的三个机器人定律也能在这里发挥作用,虽然对于人工智能是否能改变这种实现方式仍然是充满疑问的。那么人工智能的前景呢?

人工智能的权利

大家争论的另一面是人工智能是否应该被保护以及享有权利。如果一个有知觉和意识的人工智能被创造出来,我们能够简单地关闭它吗?怎样处理这样一个实体?即便到现在,动物权利是一个一致存在的具有争议性的问题,人们仍然没有就如何处理动物的意识(甚至感情)达成一致。

因此,同样的辩论也适用于人工智能。人工智能应该像奴隶一样被迫为了人类的利益日夜工作么? 我们应该为他的服务支付报酬吗?人工智能会用这笔报酬做什么?

对于以上的问题我们不太可能很快就有答案,尤其是不能有让每个人都满意的答案。Sands 认为:“多数对 AGI 的道德争论是:我们如何保证人类创造的人工智能与人类拥有相同的权利? 鉴于这个智能系统与人类基本上不同,我们应该如何定义基本的人工智能权利?此外,如果我们将人工智能视为人工生命,我们是否有权利结束其生命(“简单的关闭它?”)。在我们到达 AGI 之前,我们应该认真考虑人工智能的伦理观。“

面对这些道德问题以及许多其他问题,随着人工智能研究的深入,肯定是一个持续的争论点。 这些虽然目前看来我们很遥远,但是,现在已经举行了很多讨论这些问题的会议。

你如何参与其中

人工智能研究和实验历来是学术界和研究人员在联合实验室工作的重点。 但是,近年来,自由信息和开源运动的日益普及甚至影响到人工智能。如果你对人工智能的未来感兴趣,你有很多方法参与其中。

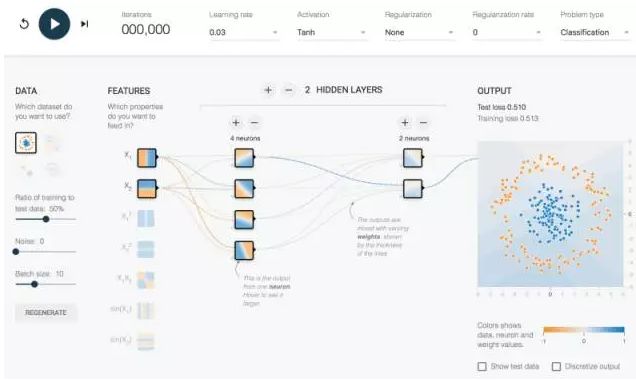

如果你想自己做一些神经网络的实验,有软件可以帮助你。Google 有一个基于浏览器的训练中心,用于修改基本的神经网络技术。还有许多开源神经网络库,如 OpenNN 和 TensorFlow 是免费提供的。虽然这些不是很易用,但是感兴趣的仍然可以使用它们,并且扩充他们,让其更出色。

然而,最好的参与方式是你自己来做进一步的专业研究。在美国,这是一种促进科学研究资助的行动主义的表现。 像所有的科学研究一样,人工智能研究也是在一个不稳定的位置。对于那些认为技术创新是未来的人来说,推动公共资助研究总是一个值得努力的事情。

多年来,大众对于人工智能发展的情绪是不断波动的。 我们现在处于高点,但完全有可能改变。 但是,不可否认的是,人工智能的潜力很大程度的激发了公众的想象力。这在我们了解的科幻小说和电影中是很明显的。 我们可能在短时间内就拥有强人工智能,也可能需要几个世纪。但是可以肯定的是,我们永远不会放弃追求。

原文链接:http://hackaday.com/2017/02/13/the-future-of-artificial-intelligence/

本文由AI100编译。

欢迎人工智能领域技术投稿、约稿、给文章纠错,请发送邮件至[email protected]