大数据总结【第三章:HDFS】

简答题

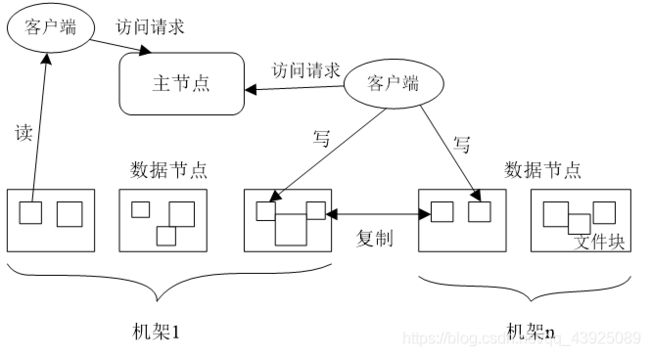

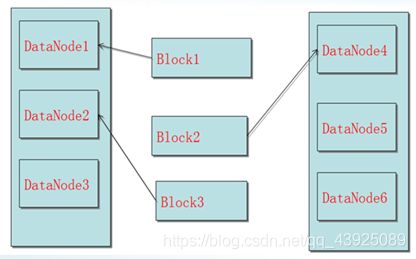

分布式文件系统的结构

结构图

主从结构,多副本存储

分布式文件系统在物理结构上是由计算机集群中的多个节点构成的,这些节点分为两类,一类叫“主节点”(Master Node)或者也被称为“名称结点”(NameNode),另一类叫“从节点”(Slave Node)或者也被称为“数据节点”(DataNode)

HDFS的实现目标

●兼容廉价的硬件设备

●流数据读写

●大数据集

●简单的文件模型

●强大的跨平台兼容性

HDFS特殊的设计,在实现上述优良特性的同时,也使得自身具有一些应用局限性,主要包括以下几个方面:

●不适合低延迟数据访问

●无法高效存储大量小文件

●不支持多用户写入及任意修改文件

HDFS相关概念

块

HDFS默认一个块64MB,一个文件被分成多个块,以块作为存储单位,块的大小远远大于普通文件系统,可以最小化寻址开销

块和普通文件系统中的块的区别

在传统的文件系统中,为了提高磁盘读写效率,-一般以数据块为单位,而不是以字节为单位。HDFS中的块,默认一一个块大小为64MB,而HDFS中的文件会被拆分成多个块,每个块作为独立的单元进行存储。HDFS在块的大小的设计上明显要大于普通文件系统。

HDFS采用抽象的块概念可以带来以下几个明显的好处

● 支持大规模文件存储:文件以块为单位进行存储,一个大规模文件可以被分拆成若干个文件块,不同的文件块可以被分发到不同的节点上,因此,一个文件的大小不会受到单个节点的存储容量的限制,可以远远大于网络中任意节点的存储容量

● 简化系统设计:首先,大大简化了存储管理,因为文件块大小是固定的,这样就可以很容易计算出一个节点可以存储多少文件块;其次,方便了元数据的管理,元数据不需要和文件块一起存储,可以由其他系统负责管理元数据

● 适合数据备份:每个文件块都可以冗余存储到多个节点上,大大提高了系统的容错性和可用性

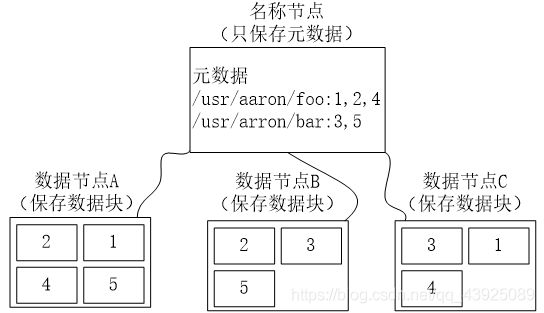

HDFS中的名称节点和数据节点的具体功能

- 名称节点负责管理分布式文件系统系统的命名空间,记录分布式文件系统中的每个文件中各个块所在的数据节点的位置信息;

- 数据节点是分布式文件系统HDFS的工作节点,负责数据的存储和读取,会根据客户端或者是名称节点的调度来进行数据的存储和检索,并向名称节点定期发送自己所存储的块的列表。

第二名称节点的作用

第二名称节点 辅助NameNode,分担其工作量;定期合并镜像文件(fsimage) 和编辑日志文件(fsedits) ,并推送给NameNode;在紧急情况下,可辅助恢复NameNode节点。

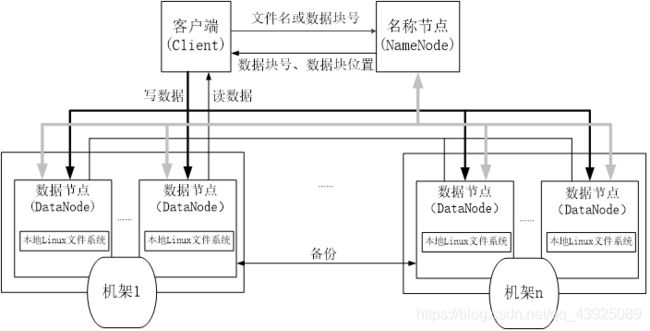

hdfs的体系结构

HDFS采用了主从(Master/Slave)结构模型,一个HDFS集群包括一个名称节点(NameNode)和若干个数据节点(DataNode)。名称节点作为中心服务器,负责管理文件系统的命名空间及客户端对文件的访问。集群中的数据节点一般是一个节点运行一个数据节点进程,负责处理文件系统客户端的读/写请求,在名称节点的统一调度下进行数据块的创建、删除和复制等操作。每个数据节点的数据实际上是保存在本地Linux文件系统中的

命名空间

- HDFS的命名空间包含目录、文件和块

- 在HDFS1.0体系结构中,在整个HDFS集群中只有一个命名空间,并且只有唯一一个名称节点,该节点负责对这个命名空间进行管理

- HDFS使用的是传统的分级文件体系,因此,用户可以像使用普通文件系统一样,创建、删除目录和文件,在目录间转移文件,重命名文件等

通信协议

- HDFS是一个部署在集群上的分布式文件系统,因此,很多数据需要通过网络进行传输

- 所有的HDFS通信协议都是构建在TCP/IP协议基础之上的

- 客户端通过一个可配置的端口向名称节点主动发起TCP连接,并使用客户端协议与名称节点进行交互

- 名称节点和数据节点之间则使用数据节点协议进行交互

- 客户端与数据节点的交互是通过RPC(Remote Procedure Call)来实现的。在设计上,名称节点不会主动发起RPC,而是响应来自客户端和数据节点的RPC请求

客户端

- 客户端是用户操作HDFS最常用的方式,HDFS在部署时都提供了客户端

- HDFS客户端是一个库,暴露了HDFS文件系统接口,这些接口隐藏了HDFS实现中的大部分复杂性

- 严格来说,客户端并不算是HDFS的一部分

- 客户端可以支持打开、读取、写入等常见的操作,并且提供了类似Shell的命令行方式来访问HDFS中的数据

- 此外,HDFS也提供了Java API,作为应用程序访问文件系统的客户端编程接口

hdfs的体系结构局限性具体体现在哪些方面

HDFS只设置唯一一个名称节点,在简化系统设计的同时也带来了一些明显的局限性

- 命名空间的局限性:名称节点是保存在内存中的,因此名称节点能够容纳对象(文件、块)的个数会受到内存空间大小的限制。

- 性能的瓶颈:整个分布式文件系统的吞吐量受限于单个名称节点的吞吐量。

- 隔离问题:由于集群中只有一个名称节点,只有一个命名空间,因此无法对不同应用程序进行隔离。

- 集群的可用性:一旦这个唯一的名称节点发生故障,会导致整个集群变得不可用。

存储原理

冗余数据保存

作为一个分布式文件系统,为了保证系统的容错性和可用性,HDFS采用了多副本方式对数据进行冗余存储,通常一个数据块的多个副本会被分布到不同的数据节点上,如图3-5所示,数据块1被分别存放到数据节点A和C上,数据块2被存放在数据节点A和B上。这种多副本方式具有以下几个优点:

(1)加快数据传输速度

(2)容易检查数据错误

(3)保证数据可靠性

数据存取策略

- 数据存放

- 第一个副本:放置在上传文件的数据节点;如果是集群外提交,则随机挑选一台磁盘不太满、CPU不太忙的节点

- 第二个副本:放置在与第一个副本不同的机架的节点上

- 第三个副本:与第一个副本相同机架的其他节点上

- 更多副本:随机节点

- 数据读取

- HDFS提供了一个API可以确定一个数据节点所属的机架ID,客户端也可以调用API获取自己所属的机架ID

- 当客户端读取数据时,从名称节点获得数据块不同副本的存放位置列表,列表中包含了副本所在的数据节点,可以调用API来确定客户端和这些数据节点所属的机架ID,当发现某个数据块副本对应的机架ID和客户端对应的机架ID相同时,就优先选择该副本读取数据,如果没有发现,就随机选择一个副本读取数据

数据错误与恢复

HDFS具有较高的容错性,可以兼容廉价的硬件,它把硬件出错看作一种常态,而不是异常,并设计了相应的机制检测数据错误和进行自动恢复,主要包括以下几种情形:名称节点出错、数据节点出错和数据出错。

- 名称节点出错

名称节点保存了所有的元数据信息,其中,最核心的两大数据结构是FsImage和Editlog,如果这两个文件发生损坏,那么整个HDFS实例将失效。因此,HDFS设置了备份机制,把这些核心文件同步复制到备份服务器SecondaryNameNode上。当名称节点出错时,就可以根据备份服务器SecondaryNameNode中的FsImage和Editlog数据进行恢复。 - 数据节点出错

- 每个数据节点会定期向名称节点发送“心跳”信息,向名称节点报告自己的状态

- 当数据节点发生故障,或者网络发生断网时,名称节点就无法收到来自一些数据节点的心跳信息,这时,这些数据节点就会被标记为“宕机”,节点上面的所有数据都会被标记为“不可读”,名称节点不会再给它们发送任何I/O请求

- 这时,有可能出现一种情形,即由于一些数据节点的不可用,会导致一些数据块的副本数量小于冗余因子

- 名称节点会定期检查这种情况,一旦发现某个数据块的副本数量小于冗余因子,就会启动数据冗余复制,为它生成新的副本

- HDFS和其它分布式文件系统的最大区别就是可以调整冗余数据的位置

- 数据出错

- 网络传输和磁盘错误等因素,都会造成数据错误

- 客户端在读取到数据后,会采用md5和sha1对数据块进行校验,以确定读取到正确的数据

- 在文件被创建时,客户端就会对每一个文件块进行信息摘录,并把这些信息写入到同一个路径的隐藏文件里面

- 当客户端读取文件的时候,会先读取该信息文件,然后,利用该信息文件对每个读取的数据块进行校验,如果校验出错,客户端就会请求到另外一个数据节点读取该文件块,并且向名称节点报告这个文件块有错误,名称节点会定期检查并且重新复制这个块

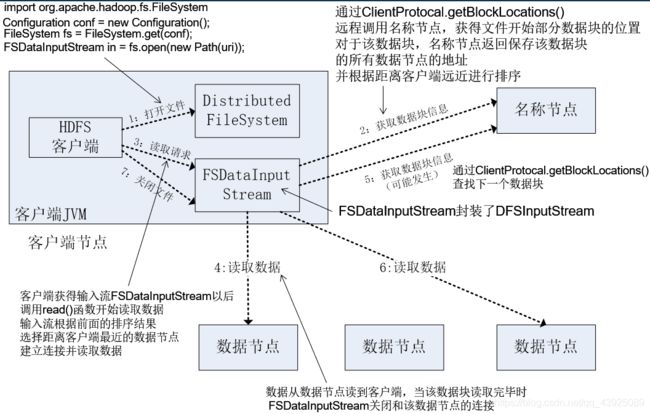

读写过程

读入文件的过程

import java.io.BufferedReader;

import java.io.InputStreamReader;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.fs.FSDataInputStream;

public class Chapter3 {

public static void main(String[] args) {

try {

Configuration conf = new Configuration();

conf.set("fs.defaultFS","hdfs://localhost:9000");

conf.set("fs.hdfs.impl","org.apache.hadoop.hdfs.DistributedFileSystem");

FileSystem fs = FileSystem.get(conf);

Path file = new Path("test");

FSDataInputStream getIt = fs.open(file);

BufferedReader d = new BufferedReader(new InputStreamReader(getIt));

String content = d.readLine(); //读取文件一行

System.out.println(content);

d.close(); //关闭文件

fs.close(); //关闭hdfs

} catch (Exception e) {

e.printStackTrace();

}

}

}

①跟 namenode通信查询元数据( block所在的 datanode节点),找到文件块所在的datanode服务器

②挑选一台 datanode(就近原则,然后随机)服务器,请求建立 socket流

③datanode开始发送数据(从磁盘里面读取数据放入流,以 packet为单位来做校验)

④客户端以 packet为单位接收,先在本地缓存,然后写入目标文件,后面的bock块就相当于是 append到前面的bock块最后合成最终需要的文件。

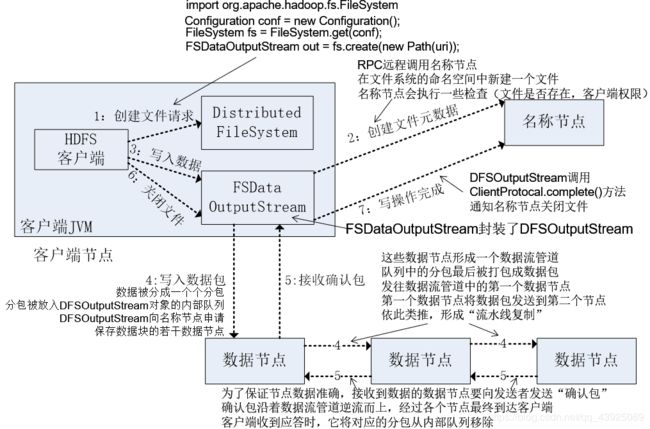

写数据过程

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.FSDataOutputStream;

import org.apache.hadoop.fs.Path;

public class Chapter3 {

public static void main(String[] args) {

try {

Configuration conf = new Configuration();

conf.set("fs.defaultFS","hdfs://localhost:9000");

conf.set("fs.hdfs.impl","org.apache.hadoop.hdfs.DistributedFileSystem");

FileSystem fs = FileSystem.get(conf);

byte[] buff = "Hello world".getBytes(); // 要写入的内容

String filename = "test"; //要写入的文件名

FSDataOutputStream os = fs.create(new Path(filename));

os.write(buff,0,buff.length);

System.out.println("Create:"+ filename);

os.close();

fs.close();

} catch (Exception e) {

e.printStackTrace();

}

}

}

编程:shell命令的简单使用

Hdfs dfs –ls :查看Hadoop的本目录下所有文件

Hdfs dfs –mkdir –p user/hadoop:递归创建user/hadoop子文件夹

Hdfs dfs –put abc.txt:复制abc.txt到文件系统

Hdfs dfs –get readme.txt rm.txt 复制文件系统的readme.txt到本地rm.txt

Hdfs dfs –rm abc.txt:清除指定文件

Hdfs dfs –setrep 3 ./tmp :改变/tmp指定的文件副本系数,3递归改变目录下所有文件的副本系数

Hdfs dfs –cat hello.txt:将指定文件的内容输出

Hdfs dfs –cp abc.txt abc01.txt:将文件从abc复制到abc01

填空

1、HDFS的存储原理_________,________,________

【解析:数据的冗余存储 数据的存储策略 数据错误与恢复】

2、分布式文件系统在物理结构上是由计算机集群中的多个节点构成的。这些节点分为_____________和_____________。

【解析:名称节点、数据节点。】

3、HDFS是构建在_____________协议基础之上的。

【解析:TCP/IP】

4、Hdfs中的块大小默认为64MB

5、Hdfs的数据存储方式是冗余存储。

6、HDFS采用了主从结构模型,名称节点负责管理分布式文件系统的命名空间,数据节点是分布式文件系统HDFS的工作节点,负责数据的存储与读取。

7、 名称节点发生故障时,可以用(第二名称节点)中记录的元数据信息进行系统恢复。

8、名称节点和数据节点之间使用(数据节点协议)进行交互。

9、 对文件重命名需要输入的命令为mv

10、针对按步骤进行安装HDFS的使用者,第一次要对其进行名称节点格式化,所用到的命令为:

/bin/hadoop namenode –format ,但只能格式化一次。

11、启动分布式文件系统所使用的为: ./sbin/start-dfs.sh 。

12、将指定的文件内容输出到标准输出命令:Hadoop fs -cat

13、多副本方式的三个优点:加快数据传输速度、容易检查数据错误、保证数据的可靠性

选择

1、HDFS的命名空间不包含(C)

A.目录 B.块 C.字节 D.文件

2、对HDFS通信协议的理解错误的是(D)

A.客户端通过一个可配置的端口向名称节点主动发起TCP连接,并使用客户端协议与名称节点进行交互

B.客户端与数据节点的交互是通过RPC(Remote Procedure Call)来实现的

C.名称节点和数据节点之间则使用数据节点协议进行交互

D.HDFS通信协议都是构建在IoT协议基础之上的

3、采用多副本冗余存储的优势不包含(D)

A.容易检查数据错误 B.加快数据传输速度 C.保证数据可靠性 D.节约存储空间

4、假设已经配置好环境变量,启动Hadoop和关闭Hadoop的命令分别是(B)

A.start-dfs.sh,stop-hdfs.sh B.start-dfs.sh,stop-dfs.sh

C.start-hdfs.sh,stop-dfs.sh D.start-hdfs.sh,stop-hdfs.sh

5、分布式文件系统HDFS采用了主从结构模型,由计算机集群中的多个节点构成的,这些节点分为两类,一类存储元数据叫 _____ ,另一类存储具体数据叫 _____(B)

A.从节点,主节点 B.名称节点,数据节点

C.数据节点,名称节点 D.名称节点,主节点

6、下面关于分布式文件系统HDFS的描述正确的是:(A)

A.分布式文件系统HDFS是谷歌分布式文件系统GFS(Google File System)的一种开源实现

B.分布式文件系统HDFS是一种关系型数据库

C.分布式文件系统HDFS是Google Bigtable的一种开源实现

D.分布式文件系统HDFS比较适合存储大量零碎的小文件

7、下面( C )程序负责HDFS数据存储

A.NameNode B.Jobtracker C.Datanode D.secondaryNameNode

8、下列程序中( D )通常与 NameNode在一个节点启动

A. SecondaryName Node B. DataNode

C. TaskTracker D. Jobtracker

9、HDFS 中的 block 默认保存几个备份。( A )

A. 3 份 B. 2 份 C. 1 份 D. 不确定

10、HDFS1.0 默认 Block Size大小是多少。( B )

A. 32MB B. 64MB 128MB D. 256MB

11、Client 端上传文件的时候下列哪项正确? ( B )

A. 数据经过 NameNode 传递给 DataNode

B. Client 端将文件切分为 Block,依次上传

C. Client 只上传数据到一台 DataNode,然后由 NameNode 负责 Block 复制工作

D. 以上都不正确

12、在实验集群的master节点使用jps命令查看进程时,终端出现以下哪项能说明Hadoop主节点启动成功? ( D )

A. Namenode,Datanode, TaskTracker

B. Namenode,Datanode, secondaryNameNode

C. Namenode,Datanode, HMaster

D. Namenode,JobTracker, secondaryNameNode

13、HDFS是基于流数据模式访问和处理超大文件的需求而开发的,具有高容错、高可靠性、高可扩展性、高吞吐率等特征,适合的读写任务是 ______。 (D)

A.一次写入,少次读 B.多次写入,少次读 C.多次写入,多次读 D.一次写入,多次读