深入理解协方差

1.协方差

1.1 均值、标准差、方差

均值: X ˉ = E ( X ) = 1 n ∑ i = 1 n X i \bar{X} = E(X) = \frac{1}{n}\sum_{i=1}^{n}X_i Xˉ=E(X)=n1∑i=1nXi

方差: s 2 = D ( X ) = 1 n − 1 ∑ i = 1 n ( X i − X ˉ ) 2 s^2=D(X)=\frac{1}{n-1}\sum_{i=1}^{n}(X_i-\bar{X})^2 s2=D(X)=n−11∑i=1n(Xi−Xˉ)2

标准差: s = D ( X ) = 1 n − 1 ∑ i = 1 n ( X i − X ˉ ) 2 s=\sqrt{D(X)}=\sqrt{ \frac{1}{n-1}\sum_{i=1}^{n}(X_i-\bar{X})^2} s=D(X)=n−11∑i=1n(Xi−Xˉ)2

均值描述样本集合的中间点,标准差描述样本集合的各个样本点到均值的距离之平均。

除以n-1而不是除以n,是因为这样能使我们以较小的样本集更好的逼近总体的标准差,即“无偏估计”。

1.2 协方差

标准差和方差一般是用来描述一维数据的,协方差是用来度量两个随机变量关系的统计量。

协方差: c o v ( X , Y ) = 1 n − 1 ∑ i = 1 n ( X − X i ˉ ) ( Y − Y i ˉ ) cov(X,Y)=\frac{1}{n-1}\sum_{i=1}^{n}(X-\bar{X_i})(Y-\bar{Y_i}) cov(X,Y)=n−11∑i=1n(X−Xiˉ)(Y−Yiˉ)

上式是求 ( X − X i ˉ ) ( Y − Y i ˉ ) (X-\bar{X_i})(Y-\bar{Y_i}) (X−Xiˉ)(Y−Yiˉ)的均值,所以还可以写做:

c o v ( X , Y ) = E [ ( X − E ( X ) ) ( Y − E ( Y ) ) ] = E ( X Y ) − E ( X ) E ( Y ) cov(X,Y)=E[(X-E(X))(Y-E(Y))]=E(XY)-E(X)E(Y) cov(X,Y)=E[(X−E(X))(Y−E(Y))]=E(XY)−E(X)E(Y)

协方差的性质:

- c o v ( X , X ) = v a r ( X ) cov(X,X)=var(X) cov(X,X)=var(X)

- c o v ( X , Y ) = c o v ( Y , X ) cov(X,Y)=cov(Y,X) cov(X,Y)=cov(Y,X)

- c o v ( X , Y ) = c o v ( Y , X ) cov(X,Y)=cov(Y,X) cov(X,Y)=cov(Y,X)

- c o v ( A X + C , B Y ) = A B c o v ( X , Y ) cov(AX+C,BY)=ABcov(X,Y) cov(AX+C,BY)=ABcov(X,Y)

- c o v ( X + Y , Z ) = c o v ( X , Z ) + c o v ( Y , Z ) cov(X+Y,Z)=cov(X,Z)+cov(Y,Z) cov(X+Y,Z)=cov(X,Z)+cov(Y,Z)

2 协方差矩阵

2.1 协方差矩阵的定义

协方差是处理二维问题,那维数多了自然就需要计算多个协方差,用矩阵来组织这些数据,该矩阵叫做协方差矩阵。

给出协方差矩阵的定义:

设 X = ( X 1 , X 2 , . . . , X n ) X=(X_1,X_2,...,X_n) X=(X1,X2,...,Xn)为 n n n维随机变量,称矩阵:

为 n n n维随机变量, X X X的协方差矩阵(covariance matrix),也记为 D ( X ) D(X) D(X),其中

c i j = c o v ( X i , X j ) , i , j = 1 , 2 , . . . , n c_{ij}=cov(X_i, X_j),i,j=1,2,...,n cij=cov(Xi,Xj),i,j=1,2,...,n

因为 c i j = c j i c_{ij}=c_{ji} cij=cji,所以协方差矩阵都是对称阵。

例如,二维随机变量 ( X , Y ) (X,Y) (X,Y)的协方差矩阵为:

C = ( c i j ) 2 ∗ 2 = ( c 11 c 12 c 21 c 22 ) = ( E [ X − E ( X ) ] 2 E [ ( X − E ( X ) ) ( Y − E ( Y ) ) ] E [ ( Y − E ( Y ) ) ( X − E ( X ) ) ] E [ Y − E ( Y ) ] 2 ) C=(c_{ij})_{2*2}=\begin{pmatrix} c_{11} & c_{12} \\ c_{21} & c_{22} \end{pmatrix}=\begin{pmatrix} E[X-E(X)]^2 & E[(X-E(X))(Y-E(Y))]\\ E[(Y-E(Y))(X-E(X))] & E[Y-E(Y)]^2 \end{pmatrix} C=(cij)2∗2=(c11c21c12c22)=(E[X−E(X)]2E[(Y−E(Y))(X−E(X))]E[(X−E(X))(Y−E(Y))]E[Y−E(Y)]2)

>> x=[[2,4,8,10],[3,5,1,7]]

>> np.cov(x)

array([[13.33333333, 2.66666667],

[ 2.66666667, 6.66666667]])

三维随机变量 ( X , Y , Z ) (X,Y,Z) (X,Y,Z)的协方差矩阵:

C = ( c o v ( X , X ) c o v ( X , Y ) c o v ( X , Z ) c o v ( Y , X ) c o v ( Y , Y ) c o v ( Y , Z ) c o v ( Z , X ) c o v ( Z , Y ) c o v ( Z , Z ) ) C=\begin{pmatrix} cov(X,X) & cov(X,Y) & cov(X,Z) \\ cov(Y,X) & cov(Y,Y) & cov(Y,Z) \\ cov(Z,X) & cov(Z,Y) & cov(Z,Z) \end{pmatrix} C=⎝⎛cov(X,X)cov(Y,X)cov(Z,X)cov(X,Y)cov(Y,Y)cov(Z,Y)cov(X,Z)cov(Y,Z)cov(Z,Z)⎠⎞

2.2 总结

理解协方差矩阵的关键就在于牢记它计算的是不同维度之间的协方差,而不是不同样本之间(但是,要求每个协方差项,则要使用各个样本来计算: 1 n − 1 ∑ i = 1 n ( x i − μ x ) ( y i − μ y ) \frac{1}{n-1}\sum_{i=1}^{n}(x_i-\mu_x)(y_i-\mu_y) n−11∑i=1n(xi−μx)(yi−μy)),拿到一个样本矩阵,我们最先要明确的就是一行是一个样本还是一个维度,心中明确这个整个计算过程就会顺流而下。

3. 协方差和皮尔森相关系数

用协方差表示 X X X和 Y Y Y之间的关系时会受 X X X与 Y Y Y量纲的影响。所以再计算X与Y的协方差之前,先对X与Y进行标准化处理,即对于随机变量 ( X , Y ) (X, Y) (X,Y):

X ∗ = X − E ( X ) D ( X ) , Y ∗ = Y − E ( Y ) D ( Y ) X^*=\frac{X-E(X)}{\sqrt{D(X)}}, Y^*=\frac{Y-E(Y)}{\sqrt{D(Y)}} X∗=D(X)X−E(X),Y∗=D(Y)Y−E(Y)

由协方差的性质可得:

c o v ( X ∗ , Y ∗ ) = c o v ( X − E ( X ) D ( X ) , Y − E ( Y ) D ( Y ) ) = c o v ( X , Y ) D ( X ) D ( Y ) cov(X^*,Y^*)=cov(\frac{X-E(X)}{\sqrt{D(X)}},\frac{Y-E(Y)}{\sqrt{D(Y)}})=\frac{cov(X,Y)}{\sqrt{D(X)}\sqrt{D(Y)}} cov(X∗,Y∗)=cov(D(X)X−E(X),D(Y)Y−E(Y))=D(X)D(Y)cov(X,Y)

c o v ( X ∗ , Y ∗ ) cov(X^*,Y^*) cov(X∗,Y∗)是无量纲的量,这样就消除了量纲对相关性的影响,其实 c o v ( X ∗ , Y ∗ ) cov(X^*,Y^*) cov(X∗,Y∗)就是相关系数,用 ρ X Y \rho _{XY} ρXY表示。

ρ X Y > 0 \rho _{XY} > 0 ρXY>0表示两个变量正相关,且相关系数越大,正相关性越高;

ρ X Y < 0 \rho _{XY} < 0 ρXY<0表示两个变量负相关,且相关系数越小,负相关性越高;

ρ X Y = 0 \rho _{XY} = 0 ρXY=0表示两个变量不相关。

3. 协方差的意义

协方差为什么能表示两个随机变量的相关性,下面从两个方面解释:

3.1 从协方差公式

在概率论中,两个随机变量 X X X与 Y Y Y之间相互关系,大致有下列3种情况:

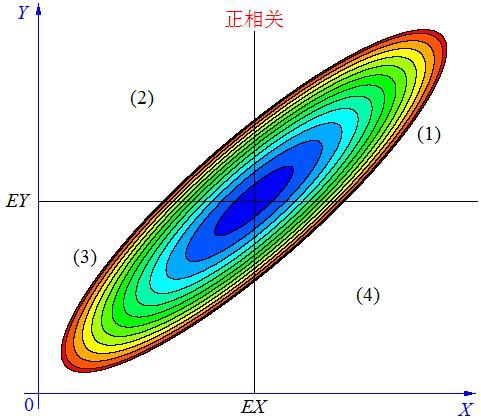

当 X X X, Y Y Y的联合分布像上图那样时,我们可以看出,大致上有: X X X越大 Y Y Y也越大, X X X越小 Y Y Y也越小,这种情况,我们称为“正相关”。

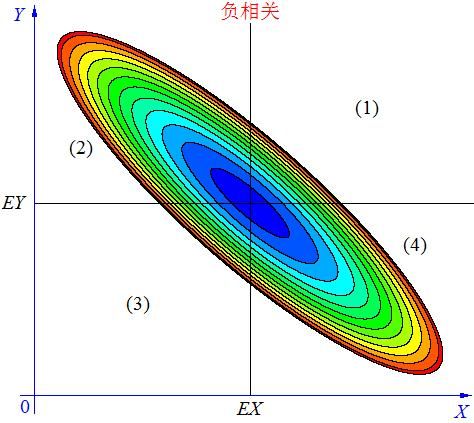

当 X X X, Y Y Y的联合分布像上图那样时,我们可以看出,大致上有: X X X越大 Y Y Y反而越小, X X X越小 Y Y Y反而越大,这种情况,我们称为“负相关”。

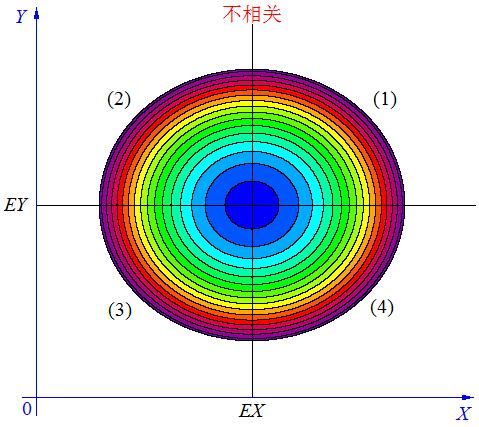

当 X X X, Y Y Y的联合分布像上图那样时,我们可以看出:既不是 X X X越大 Y Y Y也越大,也不是 X X X越大 Y Y Y反而越小,这种情况我们称为“不相关”。

怎样将这3种相关情况,用一个简单的数字表达出来呢?

在图中的区域(1)中,有 X > E X , Y − E Y > 0 X>EX ,Y-EY>0 X>EX,Y−EY>0,所以 ( X − E X ) ( Y − E Y ) > 0 (X-EX)(Y-EY)>0 (X−EX)(Y−EY)>0;

在图中的区域(2)中,有 X < E X , Y − E Y > 0 X

在图中的区域(3)中,有 X < E X , Y − E Y < 0 X

在图中的区域(4)中,有 X > E X , Y − E Y < 0 X>EX ,Y-EY<0 X>EX,Y−EY<0,所以 ( X − E X ) ( Y − E Y ) < 0 (X-EX)(Y-EY)<0 (X−EX)(Y−EY)<0。

当 X X X与 Y Y Y正相关时,它们的分布大部分在区域(1)和(3)中,小部分在区域(2)和(4)中,所以平均来说,有 E ( X − E X ) ( Y − E Y ) > 0 E(X-EX)(Y-EY)>0 E(X−EX)(Y−EY)>0。

当 X X X与 Y Y Y负相关时,它们的分布大部分在区域(2)和(4)中,小部分在区域(1)和(3)中,所以平均来说,有 ( X − E X ) ( Y − E Y ) < 0 (X-EX)(Y-EY)<0 (X−EX)(Y−EY)<0。

当 X X X与 Y Y Y不相关时,它们在区域(1)和(3)中的分布,与在区域(2)和(4)中的分布几乎一样多,所以平均来说,有 ( X − E X ) ( Y − E Y ) = 0 (X-EX)(Y-EY)=0 (X−EX)(Y−EY)=0。

所以,我们可以定义一个表示 X X X, Y Y Y相互关系的数字特征,也就是协方差: c o v ( X , Y ) = E ( X − E X ) ( Y − E Y ) cov(X, Y) = E(X-EX)(Y-EY) cov(X,Y)=E(X−EX)(Y−EY)。

当 c o v ( X , Y ) > 0 cov(X, Y)>0 cov(X,Y)>0时,表明 X X X与 Y Y Y正相关;

当 c o v ( X , Y ) < 0 cov(X, Y)<0 cov(X,Y)<0时,表明 X X X与 Y Y Y负相关;

当 c o v ( X , Y ) = 0 cov(X, Y)=0 cov(X,Y)=0时,表明 X X X与 Y Y Y不相关。

3.2 从向量的角度

对于两个随机变量 X = ( x 1 , x 2 , . . . , x n ) X=(x_1, x_2, ..., x_n) X=(x1,x2,...,xn)和 Y = ( y 1 , y 2 , . . . , y n ) Y=(y_1, y_2, ..., y_n) Y=(y1,y2,...,yn),表示空间中的两个向量,讲两个向量做去均值处理得到 X ∗ = X − E ( X ) X^*=X-E(X) X∗=X−E(X), Y ∗ = Y − Y ( Y ) Y^*=Y-Y(Y) Y∗=Y−Y(Y),对于空间中的两个向量,可以从向量的角度衡量两个向量的相关性:如果两个向量角度为90度,说明两个向量不相关(即变化趋势一点不同),如果两个向量角度为0度,说明两个向量极度相关,变化趋势一致,如果两个向量角度为180度,说明两个向量变化趋势相反。根据余弦公式:

c o s ( θ ) = X ∗ Y ∗ ∣ X ∗ ∣ ∣ Y ∗ ∣ = ∑ i = 1 n ( X i − E ( X ) ) ( Y i − E ( Y ) ) ∑ i = 1 n ( X i − E ( X ) ) 2 ∑ i = 1 n ( Y i − E ( Y ) ) 2 = c o v ( X , Y ) D ( X ) D ( Y ) = ρ X Y cos(\theta)=\frac{X^*Y^*}{|X^*||Y^*|}=\frac{\sum_{i=1}^{n}(X_i-E(X))(Y_i-E(Y))}{\sqrt{\sum_{i=1}^{n}(X_i-E(X))^2}\sqrt{\sum_{i=1}^{n}(Y_i-E(Y))^2}}=\frac{cov(X,Y)}{\sqrt{D(X)}\sqrt{D(Y)}}=\rho _{XY} cos(θ)=∣X∗∣∣Y∗∣X∗Y∗=∑i=1n(Xi−E(X))2∑i=1n(Yi−E(Y))2∑i=1n(Xi−E(X))(Yi−E(Y))=D(X)D(Y)cov(X,Y)=ρXY

参考

- https://blog.csdn.net/goodshot/article/details/50961720

- https://blog.csdn.net/GoodShot/article/details/79940438