逻辑斯谛回归(Logistic Regression,LR)及python实现

1. 为什么LR是线性模型

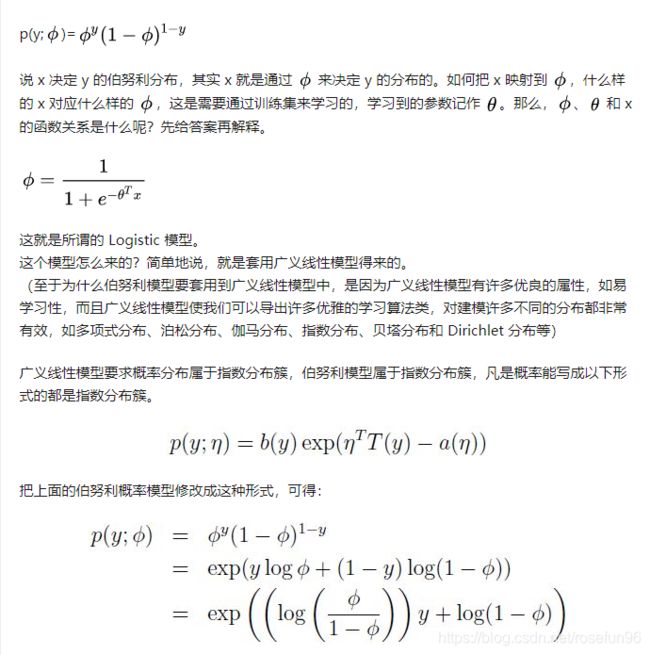

逻辑斯蒂回归是假设因变量服从伯努利分布。

也就是说,经过sigmoid函数,将 x 映射为 ϕ \phi ϕ 后,x与y的概率分布仍然是指数分布簇,即模型仍是广义线性模型。

逻辑斯谛回归与线性回归的区别

逻辑斯谛回归是线性回归在分类问题的推广,使用sigmoid函数作为 link 函数。线性回归使用最小二乘法进行参数估计,逻辑斯谛回归使用极大似然法,最大化预测属于实际的概率。

2. LR模型定义

LR模型定义:

线性二分类模型:

f ( x ) = θ T x f(x)=\theta^{T} x f(x)=θTx

其中, f ( x ) = 0 f(x)=0 f(x)=0是决策平面。

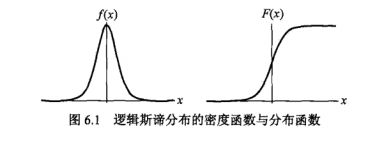

逻辑回归决策函数是将此线性二分类嵌套一个sigmoid函数:

h θ ( x ) = sigmoid ( f ( x ) ) = 1 1 + e − θ T x h_{\theta}(x)=\operatorname{sigmoid}(f(x))=\frac{1}{1+e^{-\theta^{T} x}} hθ(x)=sigmoid(f(x))=1+e−θTx1

该式子取值在0~1,它的含义是,二分类中,类别y 为正类(即1)的概率。

(为什么 h θ ( x ) h_{\theta}(x) hθ(x)可以看做是正类的概率?

因为,在线性二分类中, θ T x > 0 \theta^{T} x>0 θTx>0属于正类,因此,这里 h θ ( x ) > 0.5 h_{\theta}(x)>0.5 hθ(x)>0.5属于正类。 h θ ( x ) h_{\theta}(x) hθ(x)取值又在0~1之间,因此,在二分类中,把 h θ ( x ) h_{\theta}(x) hθ(x)当作正类的概率没问题。

这里,有点本末倒置,因为构建LogisticRegression时,就是引入概率 p 来解释 y,通过 log[ p/(1-p)]=y来进行连接 p 和 y 的关系。

)

因此,在二分类中,

P ( Y = 1 ∣ x ) = exp ( θ T x ) 1 + exp ( θ T x ) P ( Y = 0 ∣ x ) = 1 1 + exp ( θ T x ) P(Y=1 | x)=\frac{\exp (\theta^{T} x)}{1+\exp (\theta^{T} x)}\\ P(Y=0 | x)=\frac{1}{1+\exp (\theta^{T} x)} P(Y=1∣x)=1+exp(θTx)exp(θTx)P(Y=0∣x)=1+exp(θTx)1

其中, θ T x = w ⋅ x + b \theta^{T} x = w \cdot x+b θTx=w⋅x+b

此外, 如果取Y的取值为{+1, -1 }; 最终梯度计算会不一样。

最大似然函数:

L ( θ ) = p ( y ^ ∣ X ; θ ) = ∏ i = 1 m p ( y ( i ) ∣ x ( i ) ; θ ) = ∏ i = 1 m ( h θ ( x ( i ) ) ) y ( i ) ( 1 − h θ ( x ( i ) ) ) ( 1 − y ( i ) ) \begin{aligned} L(\theta)=& p(\hat{y} | X ; \theta)=\prod_{i=1}^{m} p\left(y^{(i)} | x^{(i)} ; \theta\right) \\ &=\prod_{i=1}^{m}\left(h_{\theta}\left(x^{(i)}\right)\right)^{y^{(i)}}\left(1-h_{\theta}\left(x^{(i)}\right)\right)^{\left(1-y^{(i)}\right)} \end{aligned} L(θ)=p(y^∣X;θ)=i=1∏mp(y(i)∣x(i);θ)=i=1∏m(hθ(x(i)))y(i)(1−hθ(x(i)))(1−y(i))

(这里也体现了LR满足伯努利分布。)

令损失函数为负对数似然函数:

loss ( θ ) = − log ( L ( θ ) ) = − { ∑ i = 1 m y ( i ) log ( h ( x ( i ) ) ) + ( 1 − y ( i ) ) log ( 1 − h ( x ( i ) ) ) } \operatorname{loss}(\theta)=-\log (L(\theta))=- \left\{ \sum_{i=1}^{m} y^{(i)} \log \left(h\left(x^{(i)}\right)\right) + \left(1-y^{(i)}\right) \log \left(1-h\left(x^{(i)}\right)\right) \right\} loss(θ)=−log(L(θ))=−{i=1∑my(i)log(h(x(i)))+(1−y(i))log(1−h(x(i)))}

化简得到:

l o s s ( θ ) = − ∑ i = 1 m [ ( y − 1 ) θ T x − l o g ( 1 + e − θ T x ) ] = − ∑ i = 1 m [ y θ T x − l o g ( 1 + e θ T x ) ] loss(\theta) = - \sum_{i=1}^{m} [ (y-1)\theta^Tx - log(1+e^{-\theta^Tx})]\\ = - \sum_{i=1}^{m} [ y\theta^Tx - log(1+e^{\theta^Tx})] loss(θ)=−i=1∑m[(y−1)θTx−log(1+e−θTx)]=−i=1∑m[yθTx−log(1+eθTx)]

对 l o s s ( θ ) loss(\theta) loss(θ) 求极小值。

∂ ∂ θ J ( θ ) = − ∑ i = 1 m ( y ( i ) − h θ ( x ( i ) ) ) ⋅ x i \frac{\partial}{\partial \theta} J(\theta) = -\sum_{i=1}^{m}\left(y^{(i) }-h_{\theta}\left(x^{(i)}\right)\right) \cdot x_{i} ∂θ∂J(θ)=−i=1∑m(y(i)−hθ(x(i)))⋅xi

这也是梯度下降法计算的参数梯度。

参数更新:

沿着负梯度方向进行更新。

w ← w − α ⋅ ∂ ∂ θ J ( θ ) w \leftarrow w-\alpha \cdot \frac{\partial}{\partial \theta} J(\theta) w←w−α⋅∂θ∂J(θ)

3. 多分类LR

假如有y 有K类。

p ( x = k ) = e w k ⋅ x ∑ i = 1 K e w k ⋅ x p(x = k) = \frac{e^{w_k\cdot x} } {\sum_{i = 1}^{K}{e^{w_k\cdot x}}} p(x=k)=∑i=1Kewk⋅xewk⋅x

损失函数:

L o s s ( w ) = ∑ i = 1 N ∑ j = 1 k [ s i g n ( y i = c ) l o g ( P ( Y = c ∣ x ) ] Loss( w ) = \sum\limits_{i = 1}^{N} \sum\limits_{j = 1}^{k} [ sign(y_i = c) log(P(Y = c | x) ] Loss(w)=i=1∑Nj=1∑k[sign(yi=c)log(P(Y=c∣x)]

或者采用 one-vs-rest 方法,构建 K-1 个逻辑斯蒂回归模型。

4. 防止过拟合方法

1.减少特征数量;

2.正则化

损失函数:

L o s s ( w ) = − 1 N ∑ i = 1 N [ y i l o g ( P ( Y = 1 ∣ x ) + ( 1 − y i ) l o g ( P ( Y = 0 ∣ x ) ] + λ 2 ∗ N ∑ j = 1 N θ j 2 = − 1 N ∑ i = 1 N [ y i ( w x + b ) − l o g ( 1 + l o g ( 1 + e w x + b ) ] + λ 2 ∗ N ∑ j = 1 N θ j 2 Loss( w ) = -\frac{1}{N}\sum\limits_{i = 1}^{N} [y_i log(P(Y = 1 | x) + (1 - y_i) log( P( Y = 0 | x )] + \frac{\lambda}{2*N}\sum_{j = 1}^{N} {\theta_j^2 }\\ = -\frac{1}{N} \sum\limits_{i = 1}^{N} [y_i (wx + b) - log(1 + log( 1 + e ^{wx + b})] + \frac{\lambda}{2*N}\sum_{j = 1}^{N} {\theta_j^2 } Loss(w)=−N1i=1∑N[yilog(P(Y=1∣x)+(1−yi)log(P(Y=0∣x)]+2∗Nλj=1∑Nθj2=−N1i=1∑N[yi(wx+b)−log(1+log(1+ewx+b)]+2∗Nλj=1∑Nθj2

λ \lambda λ为正则化系数。

model.LogisticRegression(penalty=‘l2’, *, dual=False, tol=0.0001, C=1.0, fit_intercept=True, intercept_scaling=1, class_weight=None, random_state=None, solver=‘lbfgs’, max_iter=100, multi_class=‘auto’, verbose=0, warm_start=False, n_jobs=None, l1_ratio=None)

在sklearn 中, 可以设置 超参数C(正则项惩罚系数的倒数)

L1,L2惩罚项的区别

L1容易使得LR系数 w 更加稀疏;

L2 相当于weight decay,目标函数变为凸函数,梯度下降法和L-BFGS都能收敛到全局最优解。正则化项实际上是给了模型一个先验知识,L2正则相当于添加了一个均值为0,协方差为 1/λ 的高斯分布先验。

5. 实践

LogisticRegression二分类的python实现,由于LogisticRegression没有解释解,使用梯度下降法进行求解。

import sklearn.datasets as datasets

import numpy as np

from sklearn.linear_model import LogisticRegression as LR

class LogisticRegression():

def __init__(self,alpha=0.01,epochs=3):

self.W = None

self.b = None

self.alpha = alpha

self.epochs = epochs

def fit(self,X,y):

# 设定种子

np.random.seed(10)

self.W = np.random.normal(size=(X.shape[1]))

self.b = 0

for epoch in range(self.epochs):

if epoch%50 == 0:

print("epoch",epoch)

w_derivate = np.zeros_like(self.W)

b_derivate = 0

for i in range(len(y)):

# 这里是加上负梯度

w_derivate += (y[i] - 1/(1+np.exp(-np.dot(X[i],self.W.T)-self.b)))*X[i]

b_derivate += (y[i] - 1/(1+np.exp(-np.dot(X[i],self.W.T)-self.b)))

self.W = self.W + self.alpha*np.mean(w_derivate,axis=0)

self.b = self.b + self.alpha*np.mean(b_derivate)

return self

def predict(self,X):

p_1 = 1/(1 + np.exp(-np.dot(X,self.W) - self.b))

return np.where(p_1>0.5, 1, 0)

def accuracy(pred, true):

count = 0

for i in range(len(pred)):

if(pred[i] == true[i]):

count += 1

return count/len(pred)

def normalize(x):

return (x - np.min(x))/(np.max(x) - np.min(x))

if __name__ == "__main__":

# input datasets

digits = datasets.load_breast_cancer()

X = digits.data

y = digits.target

# 归一化

X_norm = normalize(X)

X_train = X_norm[:int(len(X_norm)*0.8)]

X_test = X_norm[int(len(X_norm)*0.8):]

y_train = y[:int(len(X_norm)*0.8)]

y_test = y[int(len(X_norm)*0.8):]

# model 1

lr = LogisticRegression(epochs=500,alpha=0.03)

lr.fit(X_train,y_train)

y_pred = lr.predict(X_test)

# 评估准确率

acc = accuracy(y_pred, y_test)

print("acc", acc)

# model 2

clf_lr = LR()

clf_lr.fit(X_train, y_train)

y_pred2 = clf_lr.predict(X_test)

print("acc2", accuracy(y_pred2, y_test))

运行结果:

acc 0.9473684210526315

acc2 0.9298245614035088

可以看到自己写的LR模型比sklearn里边实现的效果更好,原因,可能是我们设定的超参数(如alpha,epoch)更加适合这个小数据集吧。

6. 其他问题

LR特征离散化原因:

1.离散特征容易增加和减少特征,快速迭代模型;

2.稀疏向量内积乘法运算速度更快,计算易于存储、扩展;

3.离散特征对异常值不敏感,鲁棒性强;

4.简化了逻辑斯蒂模型,降低模型过拟合。

5.离散化的特征方便进行特征交叉,使得模型的表达能力更强。

把高度相关的特征去掉原因:

使得模型的可解释性更强;提高训练速度。

如果模型很多特征高度相关,损失函数本身收敛了,参数仍然没有收敛,训练时间变长。

避免局部极小方法:

1.以多组不同参数值进行初始化;

2.使用随机梯度下降,加入随机的因素。

特征系数绝对值能认为是特征重要性吗?

1.特征系数绝对值越大,对分类效果的影响越显著,但不能认为特征系数更大的特征更重要。

2.改变变量尺度会改变系数绝对值;

3.特征相关,系数可以认为从一个特征转移到另一个特征;

逻辑斯谛回归需要标准化?

理论上不需要,因为特征尺寸发生改变,并不影响到最优决策面;但是,为了加快模型的收敛速度,一般也进行标准化。

但是,像Lasso回归,岭回归,是需要对数据进行标准化的,因为在输入的缩放比例下不是等变的。

参考:

- zhihu 为什么机器学习的分类器用logistic模型?;

- 机器学习面试题汇总(逻辑斯蒂回归相关);

- Logistic 回归的三个视角(极大似然估计/熵/形式化损失函数);

- 机器学习之逻辑回归(Logistic Regression);

- 浅析机器学习:线性回归 & 逻辑回归;

- 在进行数据分析的时候,什么情况下需要对数据进行标准化处理?;

- 在进行逻辑回归之前需要标准化吗?;

- sklearn lr;

- 逻辑回归L1与L2正则,L1稀疏,L2全局最优(凸函数梯度下降)