姓名 郭宇

学号 16130130299

转载自 【深度学习的应用:语音识别、图像理解、自然语言处理】

http://m.toutiao12.com/group/6490130609275404814/?iid=17602826099&app=news_article&tt_from=android_share&utm_medium=toutiao_android&utm_campaign=client_share

【嵌牛导读】:深度学习的主要应用领域

【嵌牛鼻子】 深度学习 人工智能 大数据

【嵌牛提问】深度学习主要应用在哪些方面和其发展情况

【嵌牛正文】:随着大数据时代的到来,深度学习技术已经成为当前人工智能领域的一个研究热点,其在图像识别、语音识别、自然语言处理等领域展现出了巨大的优势,并且仍在继续发展变化。

随着传感器技术、存储技术、计算机技术和网络技术的迅猛发展以及人类管理与知识水平的提高,使得数据的膨胀趋势日益加剧,信息技术发展的瓶颈已不仅仅存在于数据的获取、存储与传输,而更受限于数据的加工、分析和利用。采用有效的人工智能技术从大数据中获取抽象信息并将其转换为有用的知识,是当前大数据分析所面临的核心问题之一。大数据时代,如何对纷繁复杂的数据进行有效分析,让其价值得以体现和合理的利用,是当前迫切需要思考和解决的问题,而近期兴起的深度学习方法正是开启这扇大门的一把钥匙。

深度学习是新兴的机器学习研究领域,旨在研究如何从数据中自动提取多层特征表示,其核心思想是通过数据驱动的方式,采用一系列的非线性变换,从原始数据中提取由低层到高层、由具体到抽象、由一般到特定语义的特征。深度学习不仅改变着传统的机器学习方法,也影响着本文对人类感知的理解,迄今已在语音识别、图像理解、自然语言处理等应用领域引发了突破性的变革。

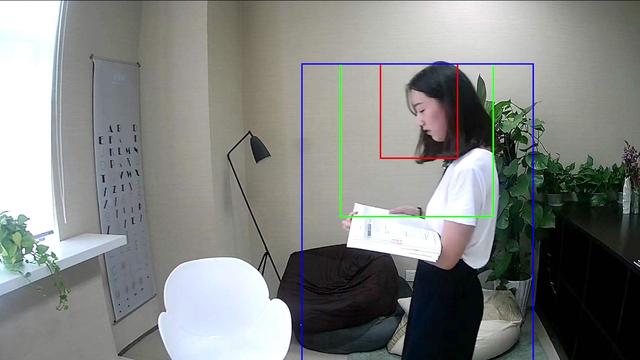

1.图像识别

物体检测和图像分类是图像识别的两个核心问题,前者主要定位图像中特定物体出现的区域并判定其类别,后者则对图像整体的语义内容进行类别判定。Yang 等人是传统图像识别算法中的代表,他们在2009 年提出的采用稀疏编码来表征图像,通过大规模数据来训练支持向量机(support vector machine,SVM)进行图像分类,该方法在2010年和2011年的ImageNet图像分类竞赛中取得了最好成绩。图像识别是深度学习最早尝试的应用领域,早在1989 年,LeCun 和他的同事就发表了关于卷积神经网络的相关工作,在手写数字识别任务上取得了当时世界上最好的结果,并广泛应用于各大银行支票的手写数字识别任务中。百度在2012 年将深度学习技术成功应用于自然图像OCR 识别和人脸识别等问题上,并推出相应的移动搜索产品和桌面应用。从2012 年的ImageNet 竞赛开始,深度学习在图像识别领域发挥出巨大威力,在通用图像分类、图像检测、光学字符识别(optical character recognition,OCR)、人脸识别等领域,最好的系统都是基于深度学习的。2012 年是深度学习技术第一次被应用到ImageNet 竞赛中,可以看出相对于2011 年传统最好的识别错误率大幅降低了41.1%,且2015 年基于深度学习技术的图像识别率错误率已经超过了人类,2016 年最新的ImageNet 识别错误率已经达到2.991%。

2.语音识别

长久以来,人与机器交谈一直是人机交互领域内的一个梦想,而语音识别是其基本技术。语音识别(automatic speech recognition,ASR)是指能够让计算机自动地识别语音中所携带信息的技术。语音是人类实现信息交互最直接、最便捷、最自然的方式之一。自人工智能(artificial intelligence,AI)的概念出现以来,让计算机甚至机器人像自然人一样实现利用语音进行交互就一直是AI 领域研究者的梦想。最近几年,深度学习(deep learning,DL)理论在语音识别和图像识别领域取得了令人振奋的性能提升,迅速成为了当下学术界和产业界的研究热点,为处在瓶颈期的语音等模式识别领域提供了一个强有力的工具。在语音识别领域,深度神经网络(deep neural network,DNN)模型给处在瓶颈阶段的传统的GMM-HMM模型带来了巨大的革新,使得语音识别的准确率又上了一个新的台阶。目前国内外知名互联网企业(谷歌、科大讯飞及百度等)的语音识别算法都采用的是DNN 方法。2012年11 月,微软在中国天津的一次活动上公开演示了一个全自动的同声传译系统,讲演者用英文演讲,后台的计算机一气呵成自动完成语音识别、英中机器翻译和中文语音合成,效果非常流畅,其后台支撑的关键技术就是深度学习。近期,百度将Deep CNN 应用于语音识别研究,使用了VGGNet,以及包含Residual连接的深层卷积神经网络(convolutional neuralnetwork,CNN)等结构,并将长短期记忆网络(long short-term memory,LSTM)和CTC 的端到端语音识别技术相结合,使得识别错误率相对下降了10%以上。2016 年9 月,微软的研究者在产业标准Switchboard 语音识别任务上,取得了产业中最低的6.3%的词错率。以及国内科大讯飞提出的前馈型序列记忆网络(feed-forward sequential memory network,FSMN)的语音识别系统,该系统使用大量的卷积层直接对整句语音信号进行建模,更好的表达了语音的长时相关性,其效果比学术界和工业界最好的双向RNN(recurrent neural network,RNN)语音识别系统识别率提升了15%以上。由此可见,深度学习技术对语言识别率的提高有着不可忽略的贡献。

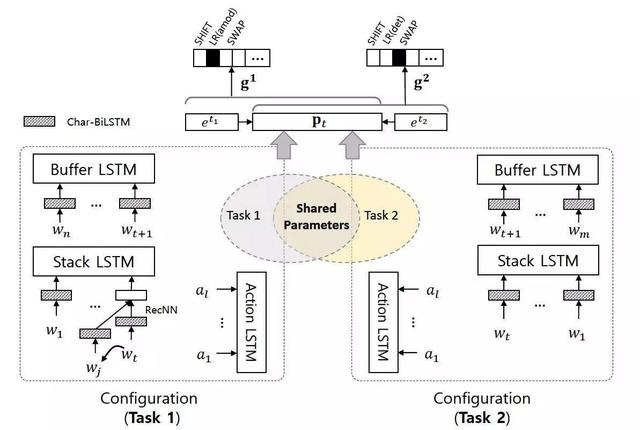

3.自然语言处理

自然语言处理(natural language processing,NLP)也是深度学习的一个重要应用领域,经过几十年多的发展,基于统计的模型已经成为NLP 的主流,同时人工神经网络在NLP 领域也受到了理论界的足够重视。加拿大蒙特利尔大学教授Bengio等在2003 年提出用embedding的方法将词映射到一个矢量表示空间,然后用非线性神经网络来表示N-Gram 模型。世界上最早的深度学习用于NLP 的研究工作诞生于NEC Labs American,其研究员Collobert 和Weston从2008年开始采用embedding 和多层一维卷积的结构,用于词性标注、分块、命名实体识别、语义角色标注等4 个典型NLP 问题。值得注意的是,他们将同一个模型用于不同的任务,都取得了与现有技术水平相当的准确率。Mikolov 等通过对Bengio 等提出的神经网络语言模型的进一步研究发现,通过添加隐藏层的多次递归,可以提高语言模型的性能,语音识别任务中,在提高后续词预测准确率及总体识别错误率方面都超越了当时最好的基准系统,Schwenk 等将类似的模型用在统计机器翻译任务中,采用BLEU(bilingual evaluation understudy,BLEU)评分机制评判,提高了近2 个百分点。此外,基于深度学习模型的特征学习还在语义消歧、情感分析[等自然语言处理任务中均超越了当时最优系统,取得优异表现。

参考文献:

[1]Yang J, Yu K, Gong Y, et al. Linear spatial pyramid matching using sparse codingfor image classification [J]. 2009: 1794-1801.

[2]Hinton G E, Salakhutdinov R R. Reducing the dimensionality of data with neuralnetworks. [J]. Science, 2006, 313 (5786): 504.

[3]Lecun Y, Boser B, Denker J S, et al. Backpropagation applied to handwritten zipcode recognition [J]. Neural Computation, 2014, 1 (4):541-551.

[4]Bengio Y, Vincent P, Janvin C. A neural probabilistic language model [J]. Journalof Machine Learning Research, 2003, 3 (6): 1137-1155.

[5]Collobert R, Weston J, Karlen M, et al. Natural Language Processing (Almost)fromScratch [J]. Journal of Machine Learning Research, 2011, 12(1): 2493-2537.

[6]Mikolov T, Deoras A, Kombrink S, et al. Empirical evaluation and combination ofadvanced language modeling techniques [C]// Proc of Conference of theInternational Speech Communication Association. 2011:605-608.

[7]Schwenk H, Rousseau A, Attik M. Large, pruned or continuous space languagemodels on a GPU for statistical machine translation [C]// Will We Ever ReallyReplace the N-Gram Model?on the Future of Language Modeling for Hlt.Association for Computational Linguistics, 2012: 11-19.