CNN1x1卷积核的作用

1x1卷积核的作用

之前只是知道1x1的卷积核用在Inception模块中具有降维的作用,并没有认真的思考它是怎么样实现降维的,以及它还有哪些作用。于是查阅了一些资料,并记录了它的一些作用,如下:

一、灵活的控制特征图的深度

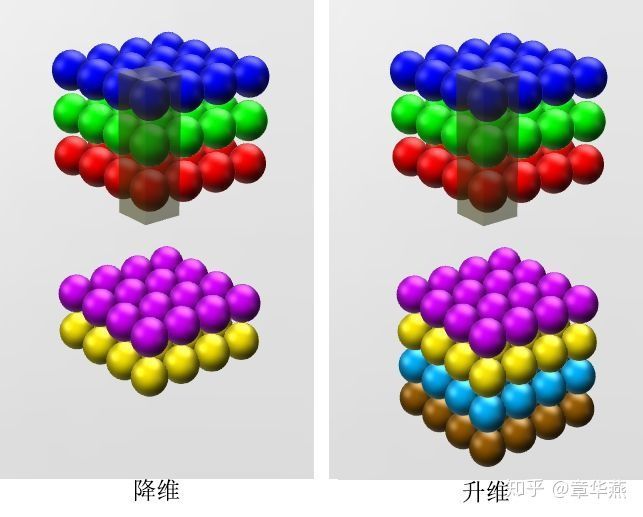

1x1的卷积核由于大小只有1x1,所以并不需要考虑像素跟周边像素的关系,它主要用于调节通道数,对不同的通道上的像素点进行线性组合,然后进行非线性化操作,可以完成升维和降维的功能,如下图所示,选择2个1x1大小的卷积核,那么特征图的深度将会从3变成2,如果使用4个1x1的卷积核,特征图的深度将会由3变成4。

二、减少参数

前面所说的降维,其实也是减少了参数,因为特征图少了,参数也自然跟着就减少,相当于在特征图的通道数上进行卷积,压缩特征图,二次提取特征,使得新特征图的特征表达更佳。接着再通过两个例子来看看它是如何减少参数的。

1、在GoogleNet的3a模块中,假设输入特征图的大小是2828192,1x1卷积通道为64,3x3卷积通道为128,5x5卷积通道为32,如下图所示:

左边的卷积核参数计算如下:

192 × (1×1×64) +192 × (3×3×128) + 192 × (5×5×32) = 387072

而右图的3x3卷积层前加入通道数为96的1x1的卷积,5x5的特征图后面加入通道数为16的1x1的卷积,参数的计算如下:

192 × (1×1×64) +(192×1×1×96+ 96 × 3×3×128)+(192×1×1×16+16×5×5×32)= 157184

Inception结构相关内容补充:

Inception 结构的主要思路是怎样用密集成分来近似最优的局部稀疏结构。

上面左图是作者提出来的基本结构,说明如下:

(1)采用不同大小的卷积核意味着不同大小的感受野,最后拼接意味着不同尺度特征的融合;

(2)之所以卷积核大小采用1、3和5,主要是为了方便对齐。设定卷积步长stride=1之后,只要分别设定pad=0、1、2,那么卷积之后便可以得到相同维度的特征,然后这些特征就可以直接拼接在一起了;

(3)文章说很多地方都表明pooling挺有效,所以Inception里面也嵌入了。

(4)网络越到后面,特征越抽象,而且每个特征所涉及的感受野也更大了,因此随着层数的增加,3x3和5x5卷积的比例也要增加。

Factorizing Convolutions with Large Filter Size,也就是分解大的卷积,用小的卷积核替换大的卷积核,因为大尺寸的卷积核可以带来更大的感受野,但也意味着更多的参数,比如5x5卷积核参数是3x3卷积核的25/9=2.78倍。因此可以用2个连续的3x3卷积层(stride=1)组成的小网络来代替单个的5x5卷积层,(保持感受野范围的同时又减少了参数量),也就产生了Inception V2;而nxn的卷积核又可以通过1xn卷积后接nx1卷积来替代,也就是Inception V3结构,但是作者发现在网络的前期使用这种分解效果并不好,还有在中度大小的feature map上使用效果才会更好。(对于mxm大小的feature map,建议m在12到20之间).

如下图:从左到右是Inception V1~IncVeption V3,需要指出的是将7´7卷积拆成1x7卷积和7x1卷积,比拆成3个3x3卷积更节约参数。

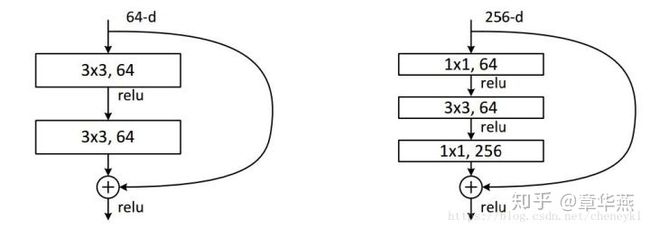

2、在ResNet模块中,假设输入的特征图的维度是wh256,并且最后要输出的也是256个特征图,如下图所示:

左边的计算如下:

wh25633256 =589824wh

右边的计算如下:

wh2561164 + wh643364 +wh6411256 = 69632wh

结果相差大概8.5倍。

三、现了跨通道的信息组合,并增加了非线性特征

使用1*1卷积核,实现降维和升维的操作其实就是channel间信息的线性组合变化,3*3,64channels的卷积核前面添加一个1*1,28channels的卷积核,就变成了3*3,28channels的卷积核,原来的64个channels就可以理解为跨通道线性组合变成了28channels,这就是通道间的信息交互。因为1*1卷积核,可以在保持feature map尺度不变的(即不损失分辨率)的前提下大幅增加非线性特性(利用后接的非线性激活函数),把网络做的很deep,增加非线性特性。

传统的卷积层中每个滤波器需要同时映射跨通道和空间维度的相关性,包含2个空间维度信息(图像的长和宽)和一个通道维度信息。因此研究者考虑可以将传统的卷积层操作分离开来,分别从空间维度和通道维度提取特征。

Extreme Inception module首先使用一个1*1卷积核映射跨通道相关性,然后分别映射每一个输出通道的空间相关性,而Xception module则使用一种深度可分卷积运算,首先提取每个通道上的空间相关性(depthwise convolution),然后再经过1*1卷积核获取跨通道的相关性(pointwise convolution)。

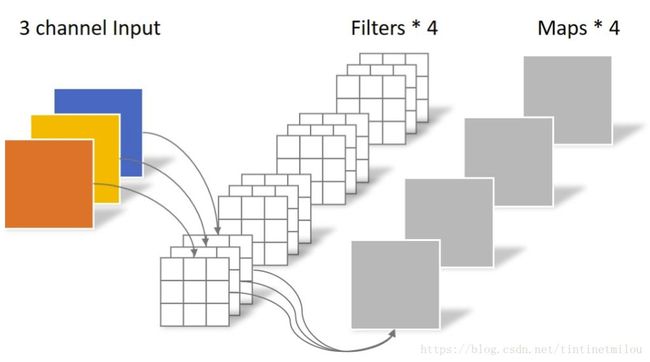

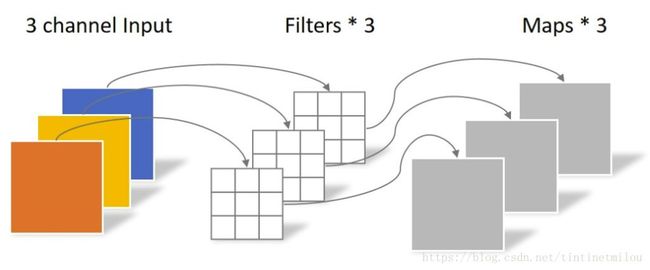

下面来看看Xception module如何降低了参数量。当考虑输入为3通道图像,要求输出为256通道,有两种操作可实现:

(1)直接经过3*3*256卷积层,则参数量为3*3*3*256=6912 ;

(2)先经过3*3卷积核进行depthwise convolution操作,再经过1*1*256卷积层进行pointwise convolution操作,那么参数量为3*3*3+3*1*1*256=795 ;

可见使用参数量大幅下降。

四、解决了需要固定输入图像尺寸的问题回想我们之前所提到的全连接层的结构图,由于全连接层与前一层特征图每个像素进行运算,因此其参数数量与前一层featuremap尺寸密切相关。如果输入图片大小不一样,那么经过各个卷积层后,最后一层卷积层产生的feature map尺寸也不尽相同,这样便无法实现前向传递,因此必须固定输入图像大小。

但是,在全卷积网络(Full Convolution Network)中,最后一个卷积层使用了1*1卷积核代替全连接层进行分类,此时不需考虑输入图像的大小,整个网络的参数数量,仅与每一卷积层卷积核大小和数量相关,与输入图像无关。