最小二乘法及其正则化——求导、几何、概率角度

目录

-

- 求导角度

- 几何角度

- 概率角度

- 正则化

-

- 频率角度

- 贝叶斯角度

- 总结汇总

求导角度

数据集:n个p维样本集用矩阵X表示,值Y为n维向量,W为p维向量。

X = [ x 1 x 2 . . . x n ] T = [ x 1 T x 2 T . . . x n T ] = [ x 11 x 12 . . . x 1 p x 21 x 22 . . . x 2 p . . . . . . . . . . . . x n 1 x n 2 . . . x n p ] n p X = \left[ \begin{matrix} x_1 & x_2 & ... & x_n \end{matrix} \right]^T = \left[ \begin{matrix} x_1^T \\ x_2^T\\ ... \\ x_n^T \end{matrix} \right] = \left[ \begin{matrix} x_{11} & x_{12} & ... & x_{1p} \\ x_{21} & x_{22} & ... & x_{2p} \\ ... & ... & ... & ... \\ x_{n1} & x_{n2} & ... & x_{np} \\ \end{matrix} \right]_{np} X=[x1x2...xn]T=⎣⎢⎢⎡x1Tx2T...xnT⎦⎥⎥⎤=⎣⎢⎢⎡x11x21...xn1x12x22...xn2............x1px2p...xnp⎦⎥⎥⎤np

Y = [ y 1 y 2 . . . y n ] , W = [ ω 1 ω 2 . . . ω p ] Y = \left[ \begin{matrix} y_1 \\ y_2\\ ... \\ y_n \end{matrix} \right],W = \left[ \begin{matrix} \omega_1 \\ \omega_2\\ ... \\ \omega_p \end{matrix} \right] Y=⎣⎢⎢⎡y1y2...yn⎦⎥⎥⎤,W=⎣⎢⎢⎡ω1ω2...ωp⎦⎥⎥⎤

所以可得损失函数L:

L ( ω ) = ∑ i = 1 n ∣ ∣ W T x i − Y ∣ ∣ 2 = ∑ i = 1 n ( W T x i − Y ) T ( W T x i − Y ) = [ ( W T x 1 , W T x 2 , . . . , W T x n ) − ( y 1 , y 2 , . . . , y m ) ] [ ( W T x 1 , W T x 2 , . . . , W T x n ) − ( y 1 , y 2 , . . . , y m ) ] T = ( W T X T − Y T ) ( W T X T − Y T ) T = ( W T X T − Y T ) ( X W − Y ) = W T X T X W − W T X T Y − Y T X W + Y T Y = W T X T X W − 2 W T X T Y + Y T Y L(\omega) = \sum_{i=1}^n ||W^Tx_i - Y||^2 = \sum_{i=1}^n (W^Tx_i - Y)^T (W^Tx_i - Y) \\ = [(W^Tx_1,W^Tx_2,...,W^Tx_n)-(y_1,y_2,...,y_m)][(W^Tx_1,W^Tx_2,...,W^Tx_n)-(y_1,y_2,...,y_m)]^T \\ =(W^TX^T-Y^T)(W^TX^T-Y^T)^T = (W^TX^T-Y^T)(XW-Y) \\ = W^TX^TXW - W^TX^TY - Y^TXW + Y^TY \\ =W^TX^TXW - 2W^TX^TY + Y^TY L(ω)=i=1∑n∣∣WTxi−Y∣∣2=i=1∑n(WTxi−Y)T(WTxi−Y)=[(WTx1,WTx2,...,WTxn)−(y1,y2,...,ym)][(WTx1,WTx2,...,WTxn)−(y1,y2,...,ym)]T=(WTXT−YT)(WTXT−YT)T=(WTXT−YT)(XW−Y)=WTXTXW−WTXTY−YTXW+YTY=WTXTXW−2WTXTY+YTY

对L( ω \omega ω)求导可得最优解 ω ^ \widehat{\omega} ω = argmin L( ω \omega ω) :

∂ L ∂ ω = 2 X T X W − 2 X T Y = 0 , 即 W ^ = ( X T X ) − 1 X T Y \frac{\partial L}{\partial \omega} = 2X^TXW - 2X^TY = 0,即 \widehat{W} = (X^TX)^{-1}X^TY ∂ω∂L=2XTXW−2XTY=0,即W =(XTX)−1XTY

这里默认XTX是一个可逆矩阵。

几何角度

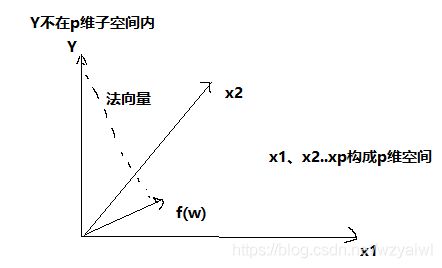

f( ω \omega ω) =X ω \omega ω ,这里将X矩阵的每一列看成一个向量,即是一个p维行向量,乘以p维列向量 ω \omega ω 相当于几何上的线性组合,合成一个新的向量Y,但往往因为噪声的存在,新的向量Y并不在p维子空间内。

上图的法向量等于Y- f( ω \omega ω) = Y- X ω \omega ω ,因为法向量和垂直于p维空间,所以XT (Y- X ω \omega ω) = 0

所以可得:

ω = ( X T X ) − 1 X T Y \omega = (X^TX)^{-1}X^TY ω=(XTX)−1XTY

此结果和导数角度算出是一样的。

概率角度

这里先引入一个定理:

已知p维向量服从X~N( μ \mu μ, ∑ \sum ∑),Y = Ax+B,其中B为q维向量,A为qp维矩阵,Y为q维向量。

则Y~N(A μ \mu μ+B,A ∑ \sum ∑AT)

∑ = [ σ 11 σ 12 . . . σ 1 p σ 21 σ 22 . . . σ 2 p . . . . . . . . . . . . σ p 1 σ p 2 . . . σ p p ] , 实 对 称 矩 阵 \sum = \left[ \begin{matrix} \sigma_{11} & \sigma_{12} & ... & \sigma_{1p} \\ \sigma_{21} & \sigma_{22} & ... & \sigma_{2p} \\ ... & ...& ... & ... \\ \sigma_{p1} & \sigma_{p2} & ... & \sigma_{pp} \end{matrix} \right] ,实对称矩阵 ∑=⎣⎢⎢⎡σ11σ21...σp1σ12σ22...σp2............σ1pσ2p...σpp⎦⎥⎥⎤,实对称矩阵

假设噪声 ξ \xi ξ服从高斯分布,即 ξ \xi ξ~N(0, σ \sigma σ2),对于单个样本y = ω \omega ωTx + ξ \xi ξ ,则y|x; ω \omega ω ~N( ω \omega ωTx, σ \sigma σ2)

即 P ( y ∣ x ; ω ) = 1 2 π σ e − ( y − ω T x ) 2 2 σ 2 P(y|x;\omega ) = \frac{ 1}{ \sqrt{ 2\pi } \sigma} e^{\frac{- (y-\omega^Tx)^2}{2\sigma^2}} P(y∣x;ω)=2πσ1e2σ2−(y−ωTx)2

由极大似然估计可得

φ ( ω ) = l n P ( Y ∣ X ; ω ) = I n ∏ i = 1 n P ( y i ∣ x i ; ω ) = ∑ i = 1 n I n 1 2 π σ e − ( y − ω T x i ) 2 2 σ 2 = ∑ i = 1 n ( I n 1 2 π σ − ( y − ω T x i ) 2 2 σ 2 ) = n I n 1 2 π σ − 1 2 σ 2 ∑ i = 1 n ( ( y − ω T x i ) 2 ) \varphi(\omega) = lnP(Y|X;\omega) = In\prod_{i=1}^nP(y_i|x_i;\omega) = \sum_{i=1}^n In \frac{ 1}{ \sqrt{ 2\pi } \sigma} e^{\frac{- (y-\omega^Tx_i)^2}{2\sigma^2}} \\ = \sum_{i=1}^n (In \frac{ 1}{ \sqrt{ 2\pi } \sigma}-\frac{ (y-\omega^Tx_i)^2}{2\sigma^2})\\ =nIn \frac{ 1}{ \sqrt{ 2\pi } \sigma} - \frac{ 1}{ 2\sigma^2 } \sum_{i=1}^n((y-\omega^Tx_i)^2) φ(ω)=lnP(Y∣X;ω)=Ini=1∏nP(yi∣xi;ω)=i=1∑nIn2πσ1e2σ2−(y−ωTxi)2=i=1∑n(In2πσ1−2σ2(y−ωTxi)2)=nIn2πσ1−2σ21i=1∑n((y−ωTxi)2)

ω ^ \widehat{\omega} ω = arg max ω \max_ω maxω φ ( ω ) \varphi(\omega) φ(ω) = n I n 1 2 π σ − 1 2 σ 2 ∑ i = 1 n ( ( y − ω T x i ) 2 ) nIn \frac{ 1}{ \sqrt{ 2\pi } \sigma} - \frac{ 1}{ 2\sigma^2 } \sum_{i=1}^n((y-\omega^Tx_i)^2) nIn2πσ1−2σ21∑i=1n((y−ωTxi)2) = ∑ i = 1 n − ( y − ω T x i ) 2 \sum_{i=1}^n-(y-\omega^Tx_i)^2 ∑i=1n−(y−ωTxi)2

即 ω ^ \widehat{\omega} ω = arg min ω \min_ω minω ∑ i = 1 n ( y − ω T x i ) 2 \sum_{i=1}^n(y-\omega^Tx_i)^2 ∑i=1n(y−ωTxi)2

总结:最小二乘估计 ⟹ \Longrightarrow ⟹ 极大似然估计(条件是噪音服从高斯分布)

正则化

频率角度

当你数据的样本数N》维度P,就容易出现过拟合现象,在数据上的体现就是XTX不可逆,其下面的式子也不会成立。

W ^ = ( X T X ) − 1 X T Y \widehat{W} = (X^TX)^{-1}X^TY W =(XTX)−1XTY

为了解决过拟合,除了数据增强、降维,正则化也是常用的措施。

正则化框架:

J ( ω ) = L ( ω ) + λ P ( ω ) , 其 中 λ > 0 J(\omega) = L(\omega) + \lambda P(\omega),其中\lambda>0 J(ω)=L(ω)+λP(ω),其中λ>0

L1范式表示P( ω \omega ω) = ||w||1

L2范式表示P( ω \omega ω) = ||w||2

可知:

J ( ω ) = L ( ω ) + λ P ( ω ) = W T X T X W − 2 W T X T Y + Y T Y + λ W T W = W T ( X T X + λ I ) W − 2 W T X T Y + Y Y Y J(\omega) = L(\omega) + \lambda P(\omega) =W^TX^TXW - 2W^TX^TY + Y^TY+ \lambda W^TW \\ =W^T(X^TX+\lambda I)W-2W^TX^TY+Y^YY J(ω)=L(ω)+λP(ω)=WTXTXW−2WTXTY+YTY+λWTW=WT(XTX+λI)W−2WTXTY+YYY

则 W ^ = a r g min ω J ( ω ) \widehat{W} = arg\min_{\omega} J(\omega) W =argωminJ(ω)

对J求导可得:

∂ J ∂ ω = 2 ( X T X + λ I ) W − 2 X T Y = 0 \frac{\partial J}{\partial \omega} = 2(X^TX+\lambda I)W-2X^TY = 0 ∂ω∂J=2(XTX+λI)W−2XTY=0

所以可得:

ω = ( X T X + λ I ) − 1 X T Y \omega = (X^TX+\lambda I)^{-1}X^TY ω=(XTX+λI)−1XTY

XTX是一个半正定矩阵,不一定可逆,但 XTX+ λ \lambda λ I一定是一个可逆矩阵,这样就解决了过拟合在数据上体现的缺陷,可清楚求出 ω \omega ω。

下面给出 XTX+ λ \lambda λ I可逆的证明:

∵ ( X T X + λ I ) x = 0 \because (X^TX+\lambda I)x=0 ∵(XTX+λI)x=0

∴ X T X x = − λ x \therefore X^TXx=-\lambda x ∴XTXx=−λx

∵ X T X 是 半 正 定 矩 阵 , 其 对 应 特 征 值 非 负 , λ > 0 \because X^TX是半正定矩阵,其对应特征值非负,\lambda > 0 ∵XTX是半正定矩阵,其对应特征值非负,λ>0

∴ x = 0 , 即 齐 次 方 程 组 有 唯 一 零 解 , 故 X T X + λ I 满 秩 , 故 其 可 逆 \therefore x=0 ,即齐次方程组有唯一零解,故X^TX+\lambda I满秩,故其可逆 ∴x=0,即齐次方程组有唯一零解,故XTX+λI满秩,故其可逆

下面给出ATA是半正定的证明(为了区分变量,改证ATA):

∵ X T ( A T A ) X = ( A X ) T A X = ∣ ∣ A X ∣ ∣ 2 ≥ 0 \because X^T(A^TA)X = (AX)^TAX = ||AX||^2 \geq 0 ∵XT(ATA)X=(AX)TAX=∣∣AX∣∣2≥0

由 半 正 定 矩 阵 的 定 义 : 如 果 二 次 型 X ′ A X 半 正 定 , 即 对 于 任 意 不 为 0 的 实 列 向 量 X , 都 有 X ′ A X ≥ 0 , 则 实 对 称 矩 阵 A 称 为 半 正 定 由半正定矩阵的定义:如果二次型X'AX半正定,即对于任意不为0的实列向量X,都有X'AX≥0,则实对称矩阵A称为半正定 由半正定矩阵的定义:如果二次型X′AX半正定,即对于任意不为0的实列向量X,都有X′AX≥0,则实对称矩阵A称为半正定

∴ A T A 是 半 正 定 矩 阵 \therefore A^TA是半正定矩阵 ∴ATA是半正定矩阵

总结:半正定矩阵加上对角矩阵一定是一个可逆矩阵。

贝叶斯角度

f( ω \omega ω) =xT ω \omega ω,噪音 ξ \xi ξ服从高斯分布,即 ξ \xi ξ~N(0, σ \sigma σ2),对于单个样本y = ω \omega ωTx + ξ \xi ξ ,则y|x; ω \omega ω ~N( ω \omega ωTx, σ \sigma σ2),假设 ω \omega ω~N(0, σ 0 \sigma_0 σ02)。

y代表已知结果, ω \omega ω代表原因。故先验概率为P( ω \omega ω),后验概率为P( ω \omega ω|y),由贝叶斯理论可得:

P ( ω ∣ y ) = P ( y ∣ ω ) P ( ω ) P ( y ) P(\omega|y) = \frac{ P(y|\omega) P(\omega)}{ P(y) } P(ω∣y)=P(y)P(y∣ω)P(ω)

其中

P ( ω ) = 1 2 π σ 0 e − ∣ ∣ ω ) ∣ ∣ 2 2 σ 0 2 P(\omega) = \frac{ 1}{ \sqrt{ 2\pi } \sigma_0} e^{\frac{- ||\omega)||^2}{2\sigma_0^2}} P(ω)=2πσ01e2σ02−∣∣ω)∣∣2

P ( y ∣ ω ) = 1 2 π σ e − ∣ ( y − ω T x ) 2 2 σ 2 P(y|\omega) = \frac{ 1}{ \sqrt{ 2\pi } \sigma} e^{\frac{- |(y-\omega^Tx)^2}{2\sigma^2}} P(y∣ω)=2πσ1e2σ2−∣(y−ωTx)2

由最大后验概率可得(P(y)已知,是一个实数):

ω ^ = a r g max ω I n ( P ( ω ∣ Y ) ) = a r g max ω I n ∏ i = 1 n ( P ( y ∣ ω ) P ( ω ) ) = a r g max ω I n ∏ i = 1 n ( 1 2 π σ σ 0 e − ( ∣ ∣ ω ) ∣ ∣ 2 2 σ 0 2 + ∣ ( y − ω T x ) 2 2 σ 2 ) ) = a r g max ω ∑ i = 1 n − ( ∣ ∣ ω ) ∣ ∣ 2 2 σ 0 2 + ∣ ( y − ω T x ) 2 2 σ 2 ) = a r g min ω ∑ i = 1 n ( ∣ ∣ ω ) ∣ ∣ 2 2 σ 0 2 + ∣ ( y − ω T x ) 2 2 σ 2 ) = a r g min ω ∑ i = 1 n ( ∣ ∣ ω ) ∣ ∣ 2 σ 2 σ 0 2 + ( y − ω T x ) 2 ) = a r g min ω ∑ i = 1 n ( y − ω T x ) 2 + σ 2 σ 0 2 ∣ ∣ ω ∣ ∣ 2 ) \widehat{\omega} = arg\max_{\omega} In(P(\omega|Y) )= arg\max_{\omega} In \prod_{i=1}^n(P(y|\omega) P(\omega) )\\ = arg\max_{\omega} In \prod_{i=1}^n (\frac{1}{2\pi \sigma \sigma_0} e^{-(\frac{ ||\omega)||^2}{2\sigma_0^2}+ \frac{|(y-\omega^Tx)^2}{2\sigma^2})}) \\ =arg\max_{\omega} \sum_{i=1}^n -(\frac{ ||\omega)||^2}{2\sigma_0^2}+ \frac{|(y-\omega^Tx)^2}{2\sigma^2}) \\ =arg\min_{\omega} \sum_{i=1}^n (\frac{ ||\omega)||^2}{2\sigma_0^2}+ \frac{|(y-\omega^Tx)^2}{2\sigma^2}) \\ = arg\min_{\omega} \sum_{i=1}^n (\frac{ ||\omega)||^2 \sigma^2}{\sigma_0^2}+(y-\omega^Tx)^2) \\ = arg\min_{\omega} \sum_{i=1}^n (y-\omega^Tx)^2 +\frac{ \sigma^2}{\sigma_0^2} ||\omega||^2 ) ω =argωmaxIn(P(ω∣Y))=argωmaxIni=1∏n(P(y∣ω)P(ω))=argωmaxIni=1∏n(2πσσ01e−(2σ02∣∣ω)∣∣2+2σ2∣(y−ωTx)2))=argωmaxi=1∑n−(2σ02∣∣ω)∣∣2+2σ2∣(y−ωTx)2)=argωmini=1∑n(2σ02∣∣ω)∣∣2+2σ2∣(y−ωTx)2)=argωmini=1∑n(σ02∣∣ω)∣∣2σ2+(y−ωTx)2)=argωmini=1∑n(y−ωTx)2+σ02σ2∣∣ω∣∣2)

可以看出最后的结果和频率角度加入正则化L2是一样的,其中 λ = σ 2 σ 0 2 \lambda = \frac{ \sigma^2}{\sigma_0^2} λ=σ02σ2.

总结:正则化后的最小二乘估计 ⟹ \Longrightarrow ⟹ 最大后验概率(其中噪音和权重 ω \omega ω均服从高斯分布)

总结汇总

总结:最小二乘估计 ⟹ \Longrightarrow ⟹ 极大似然估计(条件是噪音服从高斯分布)

总结:半正定矩阵加上对角矩阵一定是一个可逆矩阵。

总结:正则化后的最小二乘估计 ⟹ \Longrightarrow ⟹ 最大后验概率(其中噪音和权重 ω \omega ω均服从高斯分布)