Python3.7 Scrapy 提示TypeError: write() argument must be str, not bytes

第一步:新建Scrapy项目

scrapy startproject dingdin第二步:项目结构说明:

dingdian/

scrapy.cfg = 项目的配置文件

dingdian/ = 项目的Python模块

__init__.py

items.py = 项目的目标文件

pipelines.py = 项目的管道文件

settings.py = 项目的设置文件

...

spiders/ = 存储爬虫代码

__init__.py

...

第三步:爬虫模板(dingdian/item)

抓取 http://www.itcast.cn/channel/teacher.shtml 网站里的所有讲师的姓名、职称和个人信息

1、打开 dingdian目录下的 items.py

2、Item 定义结构化数据字段,用来保存爬取到的数据。

3、可以通过创建一个 scrapy.Item 类, 并且定义类型为 scrapy.Field 的类属性来定义一个 Item(可以理解成类似于 ORM 的映射关系)

import scrapy

class ItcastItem(scrapy.Item):

name = scrapy.Field()

title = scrapy.Field()

info = scrapy.Field()

第四步:制作爬虫(dingdian/itcast)

爬虫功能分为两步:

第一步:在当前目录下输入命令,将在dingdian/spider目录下创建一个名为itcast的爬虫,并指定爬取域的范围:

scrapy genspider itcast "itcast.cn"打开 dingdian/spider目录里的 itcast.py,默认增加了下列代码:

# -*- coding: utf-8 -*-

import scrapy

class ItcastSpider(scrapy.Spider):

name = 'itcast'

allowed_domains = ['itcast.cn']

start_urls = ['http://www.itcast.cn/channel/teacher.shtml']

def parse(self, response):

filename = "teacher.html"

open(filename, 'wb+').write(response.body)

功能说明:

建立一个Spider, 你必须用scrapy.Spider类创建一个子类,并确定了三个强制的属性 和 一个方法。

name = "" :这个爬虫的识别名称,必须是唯一的,在不同的爬虫必须定义不同的名字。

allow_domains = [] 是搜索的域名范围,也就是爬虫的约束区域,规定爬虫只爬取这个域名下的网页,不存在的URL会被忽略。

start_urls = () :爬取的URL元祖/列表。爬虫从这里开始抓取数据,所以,第一次下载的数据将会从这些urls开始。其他子URL将会从这些起始URL中继承性生成。

parse(self, response) :解析的方法,每个初始URL完成下载后将被调用,调用的时候传入从每一个URL传回的Response对象来作为唯一参数,主要作用如下:

负责解析返回的网页数据(response.body),提取结构化数据(生成item)

生成需要下一页的URL请求。

第五步:执行爬虫

爬虫指令:

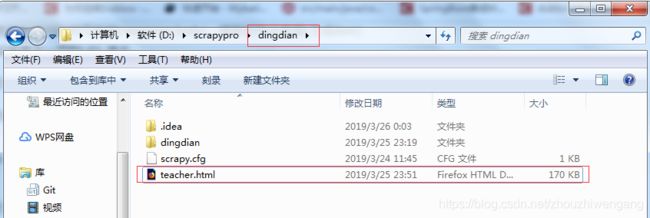

scrapy crawl itcast运行之后,如果打印的日志出现 [scrapy] INFO: Spider closed (finished),代表执行完成。 之后当前文件夹中就出现了一个 teacher.html 文件,里面就是我们刚刚要爬取的网页的全部源代码信息。

遇到的错误:TypeError: write() argument must be str, not bytes

产生错误的代码:open(filename, 'w').write(response.body)

正确的代码:open(filename, 'wb+').write(response.body)