Python 高斯朴素贝叶斯的优缺点

关注微信公共号:小程在线

![]()

关注CSDN博客:程志伟的博客

Sklearn基于这些分布以及这些分布上的概率估计的改进,为我们提供了四个朴素贝叶斯的分类器

| 类 | 含义 |

| naive_bayes.BernoulliNB | 伯努利分布下的朴素贝叶斯 |

| naive_bayes.GaussianNB | 高斯分布下的朴素贝叶斯 |

| naive_bayes.MultinomialNB | 多项式分布下的朴素贝叶斯 |

| naive_bayes.ComplementNB | 补集朴素贝叶斯 |

| linear_model.BayesianRidge | 贝叶斯岭回归,在参数估计过程中使用贝叶斯回归技术来包括正则化参数 |

虽然朴素贝叶斯使用了过于简化的假设,这个分类器在许多实际情况中都运行良好,著名的是文档分类和垃圾邮件过滤。而且由于贝叶斯是从概率角度进行估计,它所需要的样本量比较少,极端情况下甚至我们可以使用1%的数据作为训练集,依然可以得到很好的拟合效果。

1 不同分布下的贝叶斯

1.1 高斯朴素贝叶斯GaussianNB

1.1.1 认识高斯朴素贝叶斯

class sklearn.naive_bayes.GaussianNB (priors=None, var_smoothing=1e-09)

高斯朴素贝叶斯,通过假设 是服从高斯分布(也就是正态分布),来估计每个特征下每个类别上的条件概率。对于每个特征下的取值,高斯朴素贝叶斯有如下公式:

对于任意一个Y的取值,贝叶斯都以求解最大化的 为目标,这样我们才能够比较在不同标签下我们的样本究竟更靠近哪一个取值。以最大化 为目标,高斯朴素贝叶斯会为我们求解公式中的参数 和 。求解出参数后,带入一个 的值,就能够得到一个 的概率取值。

导入需要的库和数据

import numpy as np

import matplotlib.pyplot as plt

from sklearn.naive_bayes import GaussianNB

from sklearn.datasets import load_digits

from sklearn.model_selection import train_test_split

digits = load_digits()

X, y = digits.data, digits.target

Xtrain,Xtest,Ytrain,Ytest = train_test_split(X,y,test_size=0.3,random_state=420)

查看训练集数据的维度

Xtrain.shape

Out[4]: (1257, 64)

查看有几个不同的标签

np.unique(Ytrain)

Out[5]: array([0, 1, 2, 3, 4, 5, 6, 7, 8, 9])

建模,探索建模结果

gnb = GaussianNB().fit(Xtrain,Ytrain)

#查看分数

acc_score = gnb.score(Xtest,Ytest)

acc_score

Out[7]: 0.8592592592592593

#查看预测的概率结果

prob = gnb.predict_proba(Xtest)

prob.shape

Out[8]: (540, 10)

prob[1,:]

Out[9]:

array([0.00000000e+00, 1.00000000e+00, 9.26742456e-13, 0.00000000e+00,

0.00000000e+00, 0.00000000e+00, 0.00000000e+00, 0.00000000e+00,

0.00000000e+00, 0.00000000e+00])

#每一行的和都是一

prob[1,:].sum()

Out[10]: 1.000000000000003

prob.sum(axis=1).shape

Out[11]: (540,)

#查看预测结果

Y_pred = gnb.predict(Xtest)

使用混淆矩阵来查看贝叶斯的分类结果

from sklearn.metrics import confusion_matrix as CM

CM(Ytest,Y_pred)

Out[14]:

array([[47, 0, 0, 0, 0, 0, 0, 1, 0, 0],

[ 0, 46, 2, 0, 0, 0, 0, 3, 6, 2],

[ 0, 2, 35, 0, 0, 0, 1, 0, 16, 0],

[ 0, 0, 1, 40, 0, 1, 0, 3, 4, 0],

[ 0, 0, 1, 0, 39, 0, 1, 4, 0, 0],

[ 0, 0, 0, 2, 0, 58, 1, 1, 1, 0],

[ 0, 0, 1, 0, 0, 1, 49, 0, 0, 0],

[ 0, 0, 0, 0, 0, 0, 0, 54, 0, 0],

[ 0, 3, 0, 1, 0, 0, 0, 2, 55, 0],

[ 1, 1, 0, 1, 2, 0, 0, 3, 7, 41]], dtype=int64)

ROC曲线是不能用于多分类的。多分类状况下最佳的模型评估指标是混淆矩阵和整体的准确度

1.1.2 探索贝叶斯:高斯朴素贝叶斯擅长的数据集

import numpy as np

import matplotlib.pyplot as plt

from matplotlib.colors import ListedColormap

from sklearn.model_selection import train_test_split

from sklearn.preprocessing import StandardScaler

from sklearn.datasets import make_moons, make_circles, make_classification

from sklearn.naive_bayes import GaussianNB, MultinomialNB, BernoulliNB, ComplementNB

h = .02

names = ["Multinomial","Gaussian","Bernoulli","Complement"]

classifiers = [MultinomialNB(),GaussianNB(),BernoulliNB(),ComplementNB()]

X, y = make_classification(n_features=2, n_redundant=0, n_informative=2,

random_state=1, n_clusters_per_class=1)

rng = np.random.RandomState(2)

X += 2 * rng.uniform(size=X.shape)

linearly_separable = (X, y)

datasets = [make_moons(noise=0.3, random_state=0),

make_circles(noise=0.2, factor=0.5, random_state=1),

linearly_separable

]

figure = plt.figure(figsize=(6, 9))

i = 1

for ds_index, ds in enumerate(datasets):

X, y = ds

X = StandardScaler().fit_transform(X)

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=.4,

random_state=42)

x1_min, x1_max = X[:, 0].min() - .5, X[:, 0].max() + .5

x2_min, x2_max = X[:, 1].min() - .5, X[:, 1].max() + .5

array1,array2 = np.meshgrid(np.arange(x1_min, x1_max, 0.2),

np.arange(x2_min, x2_max, 0.2))

cm = plt.cm.RdBu

cm_bright = ListedColormap(['#FF0000', '#0000FF'])

ax = plt.subplot(len(datasets), 2, i)

if ds_index == 0:

ax.set_title("Input data")

ax.scatter(X_train[:, 0], X_train[:, 1], c=y_train,

cmap=cm_bright,edgecolors='k')

ax.scatter(X_test[:, 0], X_test[:, 1], c=y_test,

cmap=cm_bright, alpha=0.6,edgecolors='k')

ax.set_xlim(array1.min(), array1.max())

ax.set_ylim(array2.min(), array2.max())

ax.set_xticks(())

ax.set_yticks(())

i += 1

ax = plt.subplot(len(datasets),2,i)

clf = GaussianNB().fit(X_train, y_train)

score = clf.score(X_test, y_test)

Z = clf.predict_proba(np.c_[array1.ravel(),array2.ravel()])[:, 1]

Z = Z.reshape(array1.shape)

ax.contourf(array1, array2, Z, cmap=cm, alpha=.8)

ax.scatter(X_train[:, 0], X_train[:, 1], c=y_train, cmap=cm_bright,

edgecolors='k')

ax.scatter(X_test[:, 0], X_test[:, 1], c=y_test, cmap=cm_bright,

edgecolors='k', alpha=0.6)

ax.set_xlim(array1.min(), array1.max())

ax.set_ylim(array2.min(), array2.max())

ax.set_xticks(())

ax.set_yticks(())

if ds_index == 0:

ax.set_title("Gaussian Bayes")

ax.text(array1.max() - .3, array2.min() + .3, ('{:.1f}%'.format(score*100)),

size=15, horizontalalignment='right')

i += 1

plt.tight_layout()

plt.show()

从图上来看,高斯贝叶斯属于比较特殊的一类分类器,其分类效果在二分数据和月亮型数据上表现优秀,但是环形数

据不太擅长。我们之前学过的模型中,许多线性模型比如逻辑回归,线性SVM等等,在线性数据集上会绘制直线决策

边界,因此难以对月亮型和环形数据进行区分,但高斯朴素贝叶斯的决策边界是曲线,可以是环形也可以是弧线,所

以尽管贝叶斯本身更加擅长线性可分的二分数据,但朴素贝叶斯在环形数据和月亮型数据上也可以有远远胜过其他线

性模型的表现

1.1.3 探索贝叶斯:高斯朴素贝叶斯的拟合效果与运算速度

1. 首先导入需要的模块和库

import numpy as np

import matplotlib.pyplot as plt

from sklearn.naive_bayes import GaussianNB

from sklearn.svm import SVC

from sklearn.ensemble import RandomForestClassifier as RFC

from sklearn.tree import DecisionTreeClassifier as DTC

from sklearn.linear_model import LogisticRegression as LR

from sklearn.datasets import load_digits

from sklearn.model_selection import learning_curve

from sklearn.model_selection import ShuffleSplit

from time import time

import datetime

2. 定义绘制学习曲线的函数

#找出每个图像的横纵坐标,learning_curve

#绘制子图所在的子图

def plot_learning_curve(estimator,title, X, y,

ax, #选择子图

ylim=None, #设置纵坐标的取值范围

cv=None, #交叉验证

n_jobs=None #设定索要使用的线程

):

train_sizes, train_scores, test_scores = learning_curve(estimator, X, y

,cv=cv,n_jobs=n_jobs)

ax.set_title(title)

if ylim is not None:

ax.set_ylim(*ylim)

ax.set_xlabel("Training examples")

ax.set_ylabel("Score")

ax.grid() #显示网格作为背景,不是必须

ax.plot(train_sizes, np.mean(train_scores, axis=1), 'o-', color="r",label="Training score")

ax.plot(train_sizes, np.mean(test_scores, axis=1), 'o-', color="g",label="Test score")

ax.legend(loc="best")

return ax

3. 导入数据,定义循环

digits = load_digits()

X, y = digits.data, digits.target

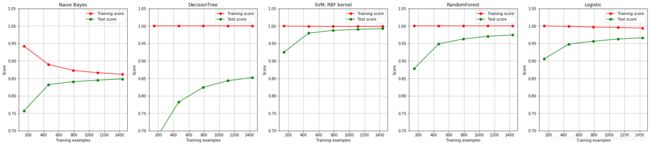

title = ["Naive Bayes","DecisionTree","SVM, RBF kernel","RandomForest","Logistic"]

model = [GaussianNB(),DTC(),SVC(gamma=0.001),RFC(n_estimators=50),LR(C=.1,solver="lbfgs")]

cv = ShuffleSplit(n_splits=50, test_size=0.2, random_state=0)

4. 进入循环,绘制学习曲线

fig, axes = plt.subplots(1,5,figsize=(30,6))

for ind,title_,estimator in zip(range(len(title)),title,model):

times = time()

plot_learning_curve(estimator, title_, X, y,

ax=axes[ind], ylim = [0.7, 1.05],n_jobs=4, cv=cv)

print("{}:{}".format(title_,datetime.datetime.fromtimestamp(time()-times).strftime("%M:%S:%f")))

plt.show()

Naive Bayes:00:06:160353

DecisionTree:00:02:359413

SVM, RBF kernel:00:12:704179

RandomForest:00:15:797081

Logistic:00:40:925605

我们首先返回的结果是各个算法的运行时间。可以看到,决策树和贝叶斯不相伯仲。决策树之所以能够运行非常快速是因为

sklearn中的分类树在选择特征时有所“偷懒”,没有计算全部特征的信息熵而是随机选择了一部分特征来进行计算,因

此速度快可以理解,但我们知道决策树的运算效率随着样本量逐渐增大会越来越慢,但朴素贝叶斯却可以在很少的样

本上获得不错的结果,因此我们可以预料,随着样本量的逐渐增大贝叶斯会逐渐变得比决策树更快。朴素贝叶斯计算

速度远远胜过SVM,随机森林这样复杂的模型,逻辑回归的运行受到最大迭代次数的强烈影响和输入数据的影响(逻

辑回归一般在线性数据上运行都比较快,但在这里应该是受到了稀疏矩阵的影响)。因此在运算时间上,朴素贝叶斯

还是十分有优势的。

我们来看一下每个算法在训练集上的拟合。手写数字数据集是一个较为简单的数据集,决策树,森林,SVC

和逻辑回归都成功拟合了100%的准确率,但贝叶斯的最高训练准确率都没有超过95%,这也应证了我们最开始说

的,朴素贝叶斯的分类效果其实不如其他分类器,贝叶斯天生学习能力比较弱。并且我们注意到,随着训练样本量的

逐渐增大,其他模型的训练拟合都保持在100%的水平,但贝叶斯的训练准确率却逐渐下降,这证明样本量越大,贝

叶斯需要学习的东西越多,对训练集的拟合程度也越来越差。反而比较少量的样本可以让贝叶斯有较高的训练准确

率。

过拟合问题。首先一眼看到,所有模型在样本量很少的时候都是出于过拟合状态的(训练集上表现好,测试

集上表现糟糕),但随着样本的逐渐增多,过拟合问题都逐渐消失了,不过每个模型的处理手段不同。比较强大的分

类器们,比如SVM,随机森林和逻辑回归,是依靠快速升高模型在测试集上的表现来减轻过拟合问题。相对的,决策

树虽然也是通过提高模型在测试集上的表现来减轻过拟合,但随着训练样本的增加,模型在测试集上的表现善生却非

常缓慢。朴素贝叶斯独树一帜,是依赖训练集上的准确率下降,测试集上的准确率上升来逐渐解决过拟合问题。

每个算法在测试集上的拟合结果,即泛化误差的大小。随着训练样本数量的上升,所有模型的测试表现。

都上升了,但贝叶斯和决策树在测试集上的表现远远不如SVM,随机森林和逻辑回归。SVM在训练数据量增大到

1500个样本左右的时候,测试集上的表现已经非常接近100%,而随机森林和逻辑回归的表现也在95%以上,而决策

树和朴素贝叶斯还徘徊在85%左右。但这两个模型所面临的情况十分不同:决策树虽然测试结果不高,但是却依然具

有潜力,因为它的过拟合现象非常严重,我们可以通过减枝来让决策树的测试结果逼近训练结果。然而贝叶斯的过拟

合现象在训练样本达到1500左右的时候已经几乎不存在了,训练集上的分数和测试集上的分数非常接近,只有在非

常少的时候测试集上的分数才能够比训练集上的结果更高,所以我们基本可以判断,85%左右就是贝叶斯在这个数据

集上的极限了。可以预测到,如果我们进行调参,那决策树最后应该可以达到90%左右的预测准确率,但贝叶斯却几

乎没有潜力了。

结论:贝叶斯是速度很快,但分类效果一般,并且初次训练之后的结果就很接近算法极限

的算法,几乎没有调参的余地。也就是说,如果我们追求对概率的预测,并且希望越准确越好,那我们应该先选择逻

辑回归。如果数据十分复杂,或者是稀疏矩阵,那我们坚定地使用贝叶斯。如果我们分类的目标不是要追求对概率的

预测,那我们完全可以先试试看高斯朴素贝叶斯的效果(反正它运算很快速,还不需要太多的样本),如果效果很不

错,我们就很幸运地得到了一个表现优秀又快速的模型。如果我们没有得到比较好的结果,那我们完全可以选择再更

换成更加复杂的模型。

其中的参数结果:

[*zip(range(len(title)),title,model)]

Out[23]:

[(0, 'Naive Bayes', GaussianNB(priors=None, var_smoothing=1e-09)),

(1,

'DecisionTree',

DecisionTreeClassifier(class_weight=None, criterion='gini', max_depth=None,

max_features=None, max_leaf_nodes=None,

min_impurity_decrease=0.0, min_impurity_split=None,

min_samples_leaf=1, min_samples_split=2,

min_weight_fraction_leaf=0.0, presort=False,

random_state=None, splitter='best')),

(2,

'SVM, RBF kernel',

SVC(C=1.0, cache_size=200, class_weight=None, coef0=0.0,

decision_function_shape='ovr', degree=3, gamma=0.001, kernel='rbf',

max_iter=-1, probability=False, random_state=None, shrinking=True,

tol=0.001, verbose=False)),

(3,

'RandomForest',

RandomForestClassifier(bootstrap=True, class_weight=None, criterion='gini',

max_depth=None, max_features='auto', max_leaf_nodes=None,

min_impurity_decrease=0.0, min_impurity_split=None,

min_samples_leaf=1, min_samples_split=2,

min_weight_fraction_leaf=0.0, n_estimators=50,

n_jobs=None, oob_score=False, random_state=None,

verbose=0, warm_start=False)),

(4,

'Logistic',

LogisticRegression(C=0.1, class_weight=None, dual=False, fit_intercept=True,

intercept_scaling=1, l1_ratio=None, max_iter=100,

multi_class='warn', n_jobs=None, penalty='l2',

random_state=None, solver='lbfgs', tol=0.0001, verbose=0,

warm_start=False))]