什么是网络爬虫

简单的说,网络爬虫就是一种自动抓去互联网上资源的程序。

简单的网络爬虫

简单的网络爬虫原理就是使用特定的 url 作为种子,通过一定的规则去获取网页上的所需要的信息和新的 url,并对新的 url 进行爬取。

简单的网络爬虫的架构

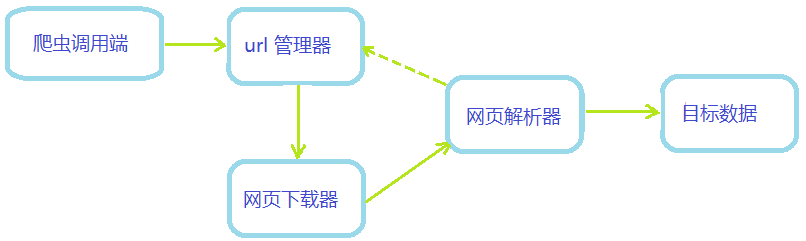

如下图,是简单网络爬虫的主要架构。主要分为三部分: url解析器,网页下载器,网页解析器。

url 解析器 :负责管理待抓取的 url 集合以及抓取的 url 集合。其中包括:防止重复抓取,防止循环抓取等。

网页下载器:将已经抓取的 url 对应的网页下载下来,供给网页解析器使用。

网页解析器:主要的功能是获取下载的网页中的目标数据以后生成新的url 集合给 url 管理器。

简单网络爬虫的工作流程

写一个简单的网络爬虫

以抓取百度百科中的 python 词条页面的超链接为例,代码使用python语言。

url 管理器

url 管理器主要是管理 url 集合,这里使用了 python 的 set() 集合,因为 set() 里面的不存在相同元素。

class UrlManager(object):

def __init__(self):

#创建待爬取和已爬取url集合

self.new_urls = set()

self.old_urls = set()

#添加新的url到待爬取url集合

def add_new_url(self,url):

if url is None:

return

if url not in self.new_urls and url not in self.old_urls:

self.new_urls.add(url)

#判断是否待爬取集合为空

def has_new_url(self):

return len(self.new_urls) != 0

#从待爬取集合中取出一个url

def get_new_url(self):

new_url = self.new_urls.pop()

self.old_urls.add(new_url)

return new_url

#往待爬取集合添加新的url

def add_new_urls(self,urls):

if urls is None or len(urls) == 0:

return

for url in urls:

self.add_new_url(url)

网页下载器

这里是使用 python 的基础库 urllib2.urlopen() 方法下载 url对于网页。

import urllib2

class HtmlDownloader(object):

def download(self,url):

if url is None:

return None

#直接请求

response = urllib2.urlopen(url)

#获取状态码,返回200代表下载成功

if response.getcode()!= 200:

return None;

return response.read()

网页解析器

这里使用了python 的库— BeautifulSoup,其主要的功能是从网页抓取数据,之后从抓取到的数据找到目标数据以及新的新的url集合给url管理器。代码如下:

from bs4 import BeautifulSoup

import re

import urlparse

class HtmlParse(object):

#使用BeautifulSoup解析网页下载器下载的网页数据

def parse(self,page_url,html_cont):

if page_url is None or html_cont is None:

return

soup = BeautifulSoup(html_cont,'html.parser',from_encoding='utf8')

#获取新的url集合

new_urls = self._get_new_urls(page_url,soup)

#获取目标数据

new_data = self._get_new_data(page_url,soup)

return new_urls,new_data

#获取新的待爬取url

def _get_new_urls(self, page_url, soup):

new_urls = set()

#使用正则表达式从BeautifulSoup获取的数据中找到新的url

#页面的url格式/item/%E8%9C%98%E8%9B%9B/8135707

#这里的soup.find_all() 可获取全部符合条件的标签对象

links = soup.find_all('a',href =re.compile(r"/item/[%A_Z0_9]+"))

for link in links:

new_url = link['href']

#生成完整的的url:http://baike.baidu.com/item/%E8%9C%98%E8%9B%9B/8135707

new_full_url = urlparse.urljoin(page_url,new_url)

new_urls.add(new_full_url)

return new_urls

#获取目标数据,这里只是获取了标签和中的内容

def _get_new_data(self, page_url, soup):

res_data = {}

#url

res_data['url'] = page_url

#Python

#这里的soup.find() 将获取第一个符合条件的标签对象

title_node = soup.find('dd',class_="lemmaWgt-lemmaTitle-title").find("h1")

res_data["title"] = title_node.getText()

#

#这里的soup.find() 将获取第一个符合条件的标签对象

summary_node = soup.find("div",class_="lemma-summary")

res_data["summary"] = summary_node.getText()

return res_data

数据输出

这里只是将获取的数据输出到html文件上,当然也可以输出到其他地方如数据库,本地文件,看具体需要了。

class HtmlOutputer(object):

def __init__(self):

self.datas = []

def collect_data(self,data):

if data is None:

return

self.datas.append(data)

def output_html(self):

fout = open('output.html','w')

fout.write("")

fout.write("")

fout.write("")

#默认是ascii,为了防止中文乱码,需要转成utf8

for data in self.datas:

fout.write("")

fout.write("%s " % data['url'])

fout.write("%s " % data['title'].encode('utf8'))

fout.write("%s " % data['summary'].encode('utf8'))

fout.write(" ")

fout.write("

")

fout.write("")

fout.write("")

最后,将所有的类连接起来:

#不要忘记引入其他类

from baike_py import html_downloader, html_outputer, html_parser

from baike_py import url_manager

class SpiderMain(object):

def __init__(self):

self.urls =url_manager.UrlManager()

self.downloader = html_downloader.HtmlDownloader()

self.parser = html_parser.HtmlParse()

self.outputer = html_outputer.HtmlOutputer()

def craw(self, root_url):

count = 1

self.urls.add_new_url(root_url)

while self.urls.has_new_url():

try:

new_url = self.urls.get_new_url()

print ("craw %d : %s" % (count,new_url))

html_cont = self.downloader.download(new_url)

new_urls,new_data = self.parser.parse(new_url,html_cont)

self.urls.add_new_urls(new_urls)

self.outputer.collect_data(new_data)

#这里只是抓取了1000条url数据

if count == 1000:

break

count = count + 1

except :

print (“craw failed”)

self.outputer.output_html()

if __name__=="__main__":

root_url = "http://baike.baidu.com/item/Python"

obj_spider = SpiderMain()

obj_spider.craw(root_url)

总结

- python 语言有很多相关的库,用起来很方便,功能也很强大,如 对于url

下载网页的方式这里只是最简单的方法。当然,了解了其中的原理用什么语言都是一样的。

- 以上只是一个简单爬虫,只是抓取静态html上的url和目标数据。实际上网页有很多资源是通过JavaScript 等动态方式显示出来的,这样还需要做额外处理;

- 对于网络爬虫还需要有更多学习的地方,如应对反爬取的策略,代理访问,有的网站还需要使用cookie,分布式爬取等等。弱水三千,道阻且长。